NULL-text Inversion for Editing Real Images Using Guided Diffusion Models

一、核心思想与背景

传统基于扩散模型的图像编辑方法(如DDIM Inversion)在结合分类器无引导(Classifier-Free Guidance, CFG)时,存在隐变量轨迹反转不准确的问题,导致编辑后的图像与原图结构偏离或细节丢失。本文提出了一种名为NULL-text Inversion的优化方法,旨在通过仅调整CFG中的空文本嵌入(null-text embedding),实现真实图像的高保真编辑。其核心思想是:通过优化空文本嵌入而非模型参数,解决传统方法在隐空间反转中的累积误差问题,从而更精确地保留原始图像的结构与细节。

传统方法的局限性

- 隐空间反转误差累积:DDIM反转在CFG模式下因噪声预测偏差导致反转轨迹偏离真实分布。

- 编辑保真度低:直接应用文本引导编辑时,全局结构易被破坏。

- 计算成本高:现有方法需微调模型参数,难以快速适配不同编辑任务。

二、方法原理

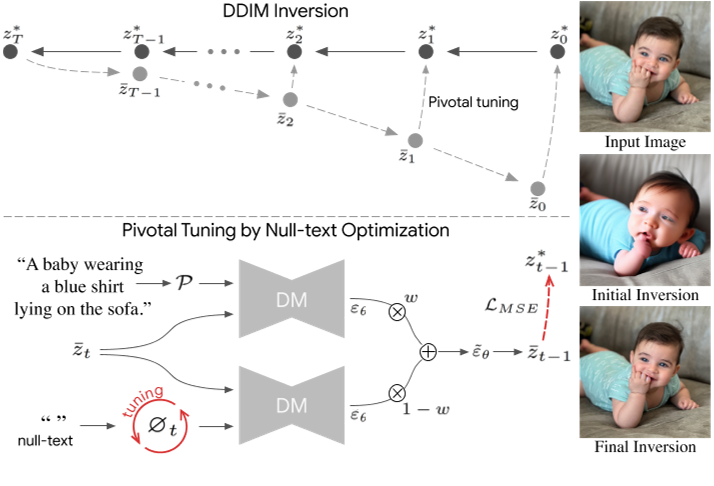

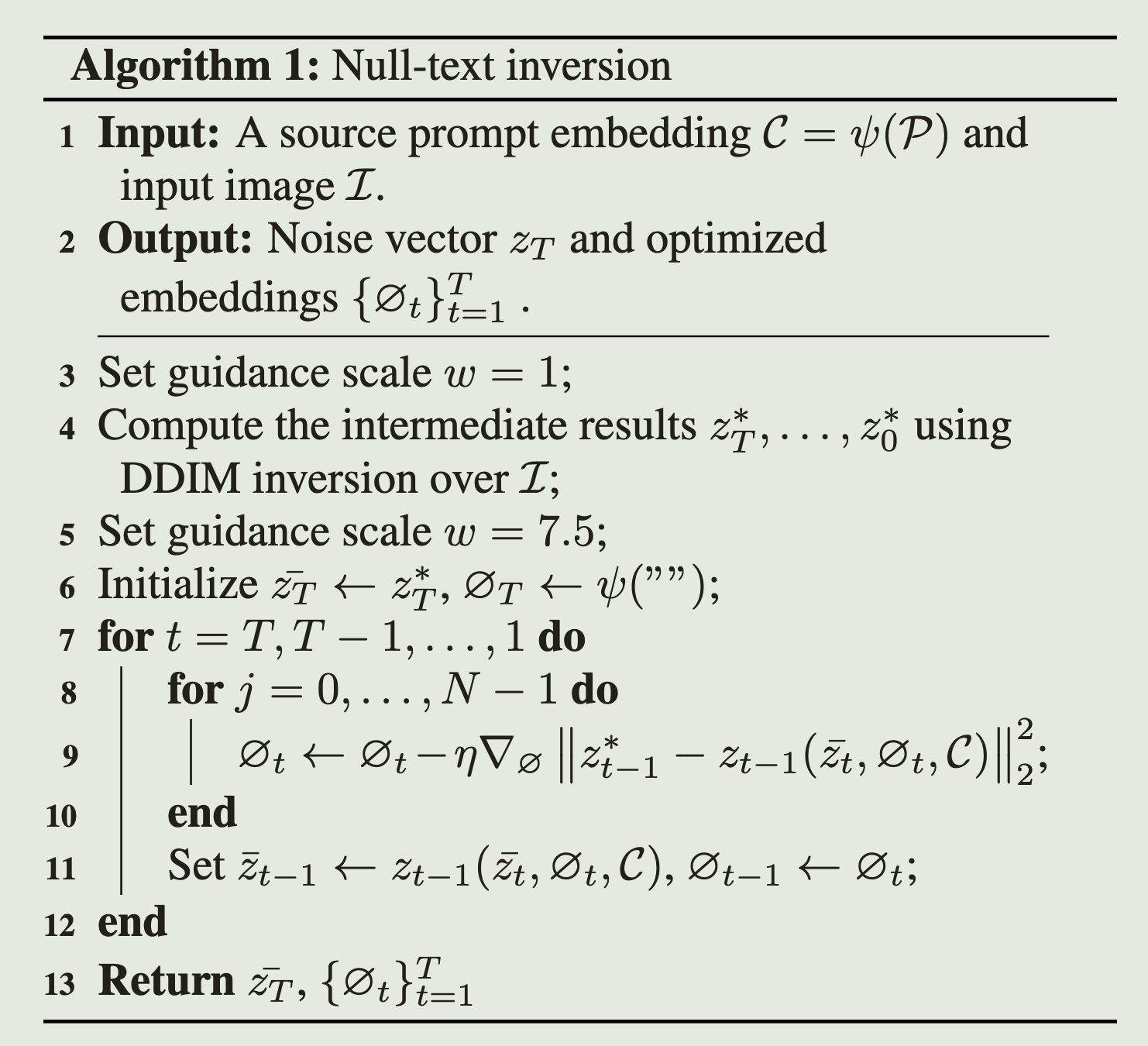

NULL-text Inversion的流程分为两步:Pivotal Inversion(关键反转)和Null-text Optimization(空文本优化)。

1. Pivotal Inversion

- 目标:生成初始隐变量轨迹 \( {z_ T ^ *, \dots, z _ 0 ^ *} \),作为后续优化的起点。

- 实现:关闭CFG(guidance scale=1),使用标准DDIM反转将输入图像 \( I \) 编码至隐空间。此时反转轨迹 \( z_0^* = z_0 \) 保留了图像的低频结构,但高频细节可能因误差累积而丢失。

2. Null-text Optimization

- 目标:优化每个时间步 \( t \) 的空文本嵌入 \( \emptyset_t \),以最小化反转轨迹的预测误差。

- 实现:

-

按时间步从 \( t=T \) 到 \( t=1 \) 逆序优化,每个步骤迭代 \( N \) 次。

-

初始化 \( z_t = z_t^* \),固定扩散模型参数,仅优化空文本嵌入 \( \emptyset_t \)。

-

损失函数为:

\(\min_{\emptyset_t} | z_{t-1}^* - z_{t-1}(z_t, \emptyset_t, C) |_2^2\)

其中 \( C \) 为条件文本嵌入,\( z_{t-1}(z_t, \emptyset_t, C) \) 是结合CFG的反向扩散预测结果。

-

通过逐步优化,空文本嵌入被调整为适配当前图像的条件,从而减少反转误差。

-

3. 编辑生成

优化后的空文本嵌入与目标文本提示结合,通过扩散模型的反向过程生成编辑后的图像。由于空文本嵌入已适配原图结构,编辑仅局部修改与目标文本相关的区域,保留非编辑区域细节。

三、技术贡献与优势

- 无需模型微调:仅优化空文本嵌入,保留预训练模型的生成能力,支持即插即用式编辑。

- 高保真编辑:通过逆序优化策略,有效抑制反转误差累积,保留原图结构与细节。

- 兼容性强:可无缝集成至Stable Diffusion等主流扩散模型,支持文本引导的多样化编辑(如替换、风格迁移)。

- 计算高效:单张图像优化仅需数分钟,显著低于传统参数微调方法。

四、实验验证

1. 定性评估

- 复杂场景编辑:在自然图像数据集(如ImageNet)中展示物体替换(如“狗→猫”)、属性调整(如“调整光照强度”)等任务,生成结果在结构一致性与文本对齐性上优于DiffEdit、SDEdit等基线方法。

- 真实图像编辑:通过结合Prompt-to-Prompt框架,实现局部语义控制(如仅修改“背景”或“物体颜色”)。

2. 定量对比

- 用户研究:70%参与者认为NULL-text Inversion的编辑结果在保真度与编辑质量上优于基线方法。

- 指标分析:CLIP得分(衡量文本-图像对齐性)与LPIPS(评估结构相似性)显示,该方法在两者间达到最佳平衡。

3. 消融实验

- 优化顺序影响:逆序优化(\( t=T→1 \))相比顺序优化(\( t=1→T \))显著降低误差累积。

- 空文本嵌入必要性:若不优化空文本,直接使用默认嵌入会导致编辑区域模糊或结构失真。

五、理论分析与局限

- 理论基础

NULL-text Inversion的本质是通过优化空文本嵌入,调整CFG的条件分布,使其适配特定图像的隐空间轨迹。这一过程可视为一种隐式的分布对齐,减少条件生成中的域偏移。 - 局限性:

- 复杂语义修改受限:若目标文本与原图语义差异过大(如“汽车→飞机”),可能生成结构不合理的结果。

- 高分辨率计算开销:需结合分层扩散模型或加速采样策略(如DDIM子序列采样)以降低耗时。

- 多对象编辑挑战:同时修改多个不相关区域时,注意力机制可能产生冲突。

六、应用与拓展

- 医学图像编辑:结合局部注意力控制,实现病灶区域的精准修改(如肿瘤尺寸调整)。

- 艺术创作:支持风格迁移与内容保留的独立控制,例如将真实照片转为特定艺术风格。

- 多模态扩展:与IP-Adapter等图像提示技术结合,实现多模态条件生成(如草图+文本联合引导)。

七、总结

《NULL-text Inversion for Editing Real Images Using Guided Diffusion Models》通过优化空文本嵌入,为基于扩散模型的图像编辑提供了一种高效、高保真的解决方案。其核心创新在于将编辑过程解耦为隐空间轨迹优化与条件分布适配,既保留了原始图像结构,又实现了多样化的语义修改。尽管存在复杂编辑与计算效率的挑战,该方法为后续研究(如可控生成、多模态对齐)提供了重要参考,并在医疗影像、艺术创作等领域展现了广阔的应用前景。