Introduction

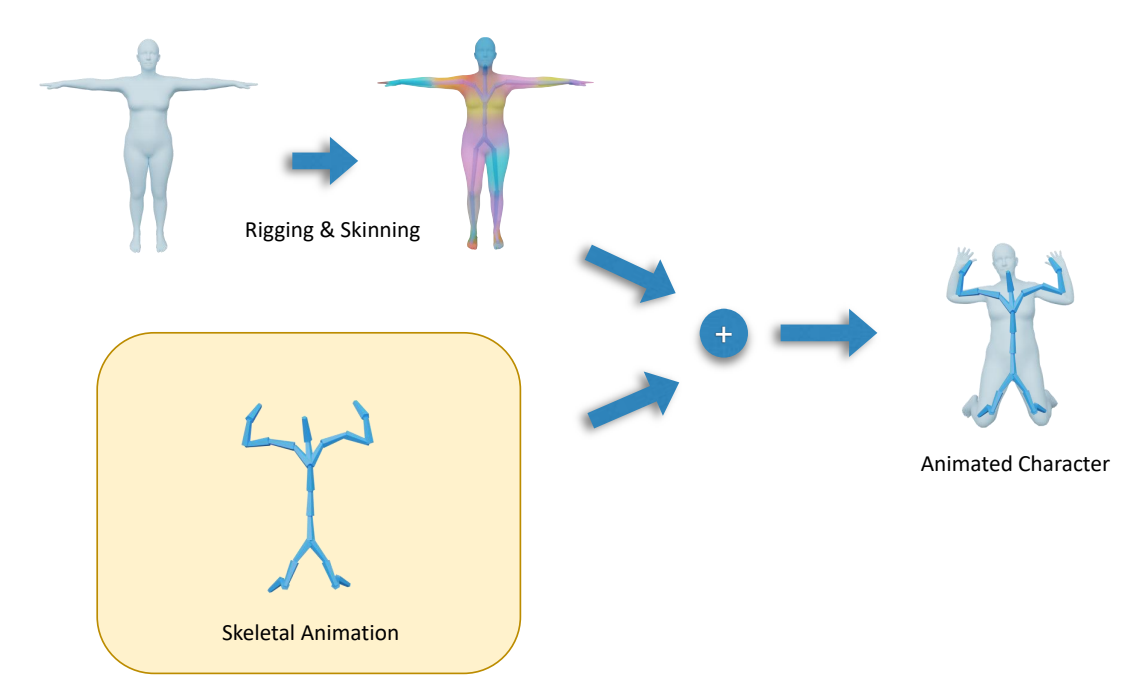

基于LBS的3D骨骼蒙皮动画的相关技术

Refereneces

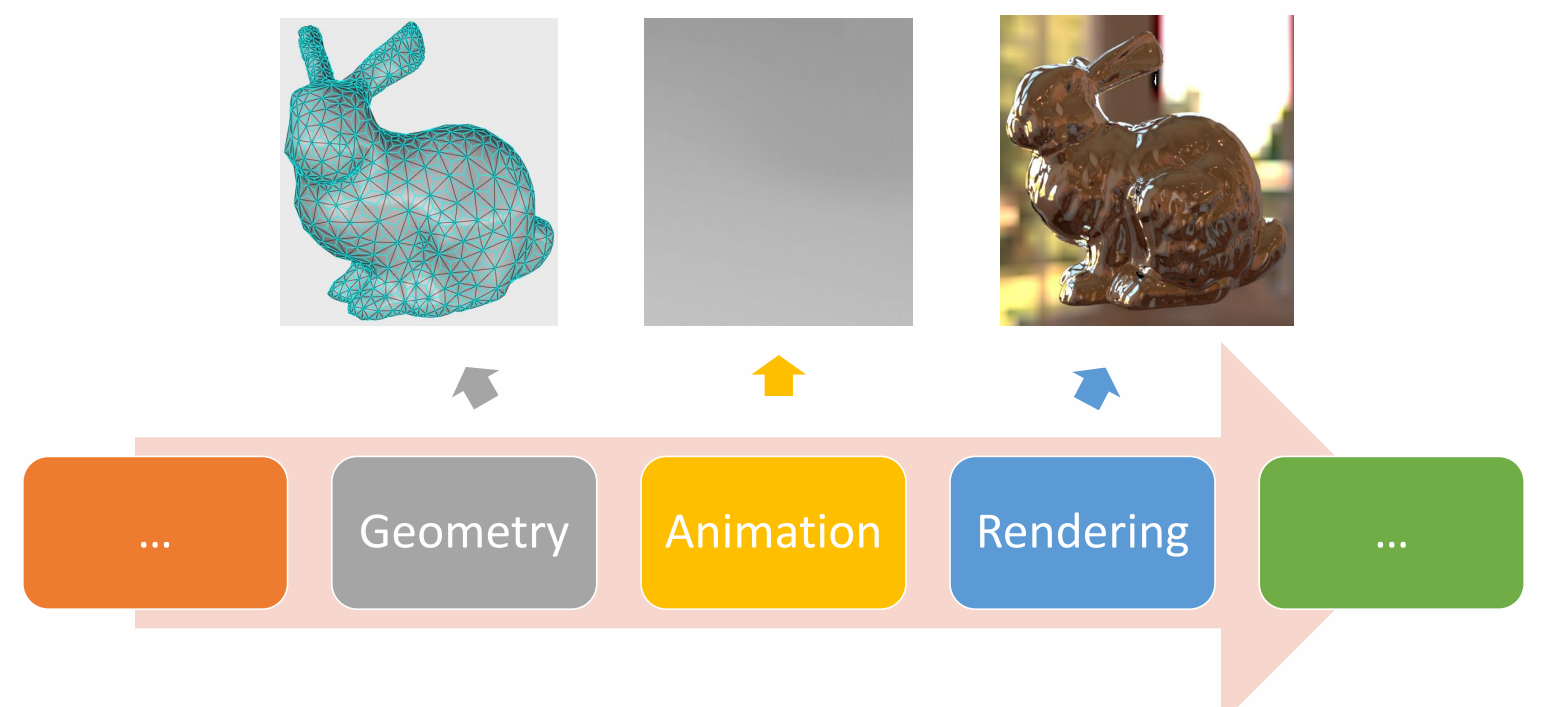

P7

3D Computer Graphics

P10

3D Computer Animation

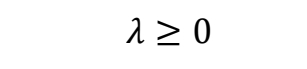

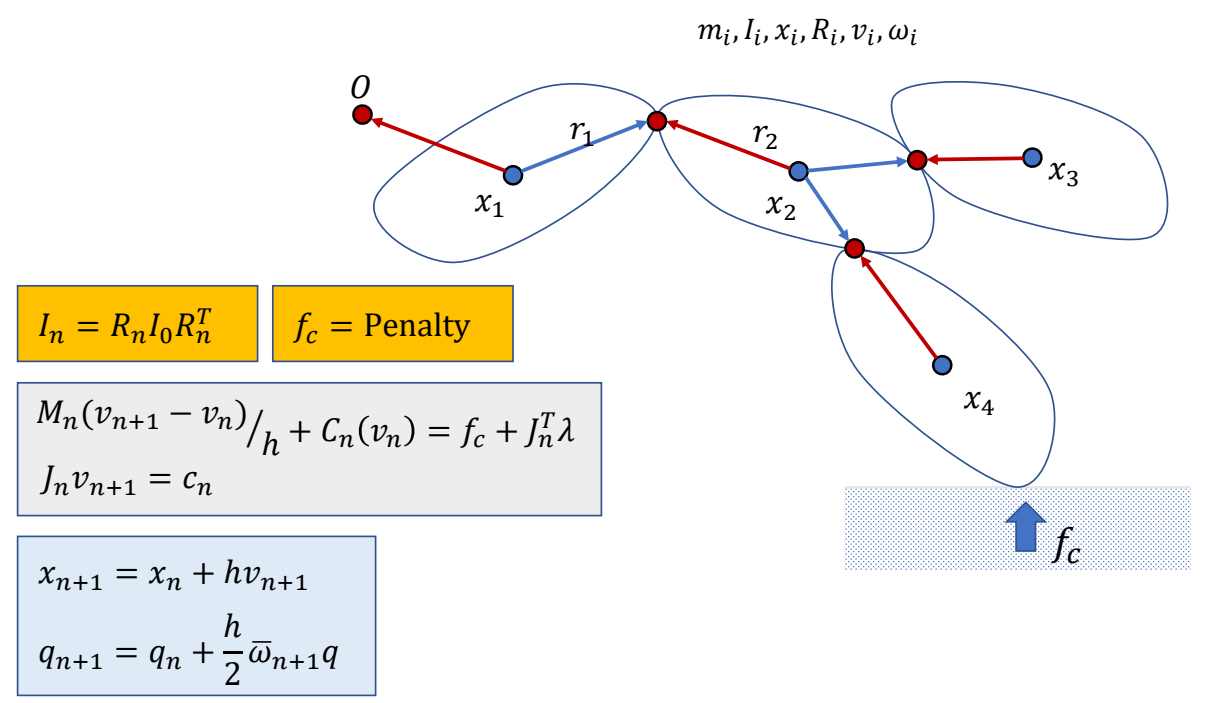

✅ 仿真,用于描述客观事物,它们的运动规律可以用精确的数来描述。GAMES103

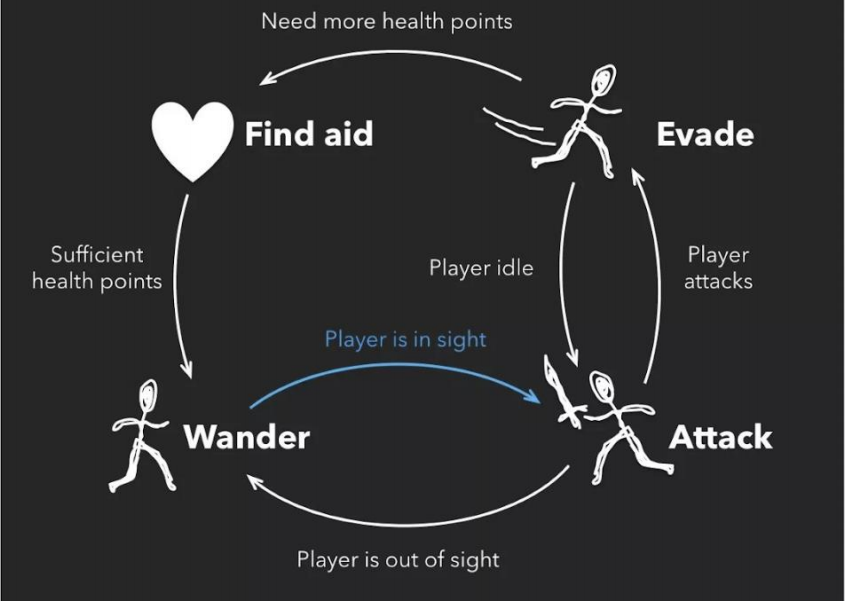

✅ 动画,用于描述有主观意志的事物,使用统计的方式来对它们的行为建模(例如AI建模)。 GAMES105

P11

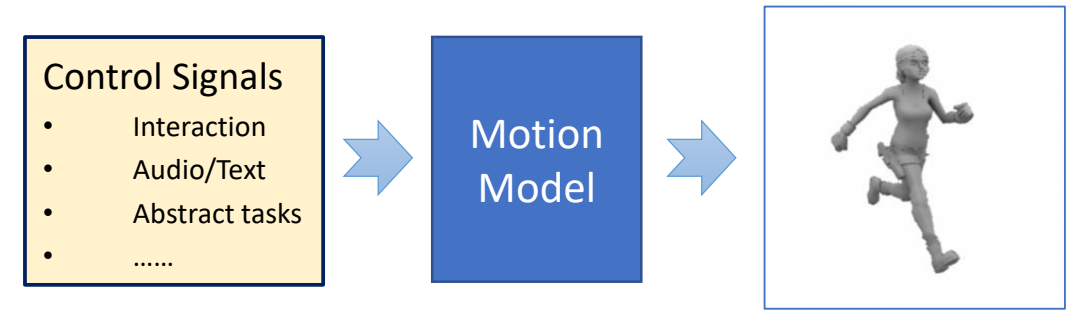

Why Do We Study Character Animation

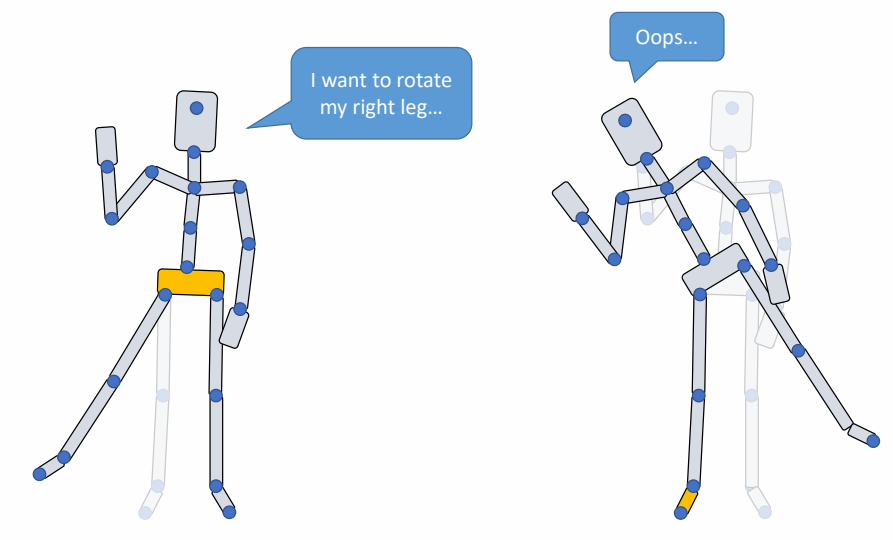

- A character typically has 20+ joints, or 50-100+ parameters

- It is not super high-dimensional, so most animation can be created manually, by posing the character at keyframes

- Labor-intensive, not for interactive applications

- Character animation techniques

- Understanding the mechanism behind motions and behaviors

- Smart editing of animation/ Reuse animation / Generate new animation

- “Compute-intensive”

✅ 计算机角色动画把原本劳动密集型的动画师工作变成计算密集型的工作。

P13

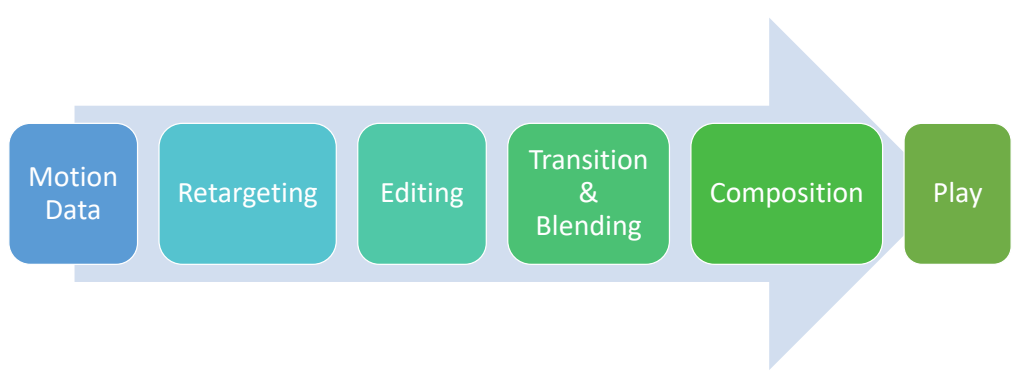

Character Animation Pipeline

P15

Where does a Motion Come From

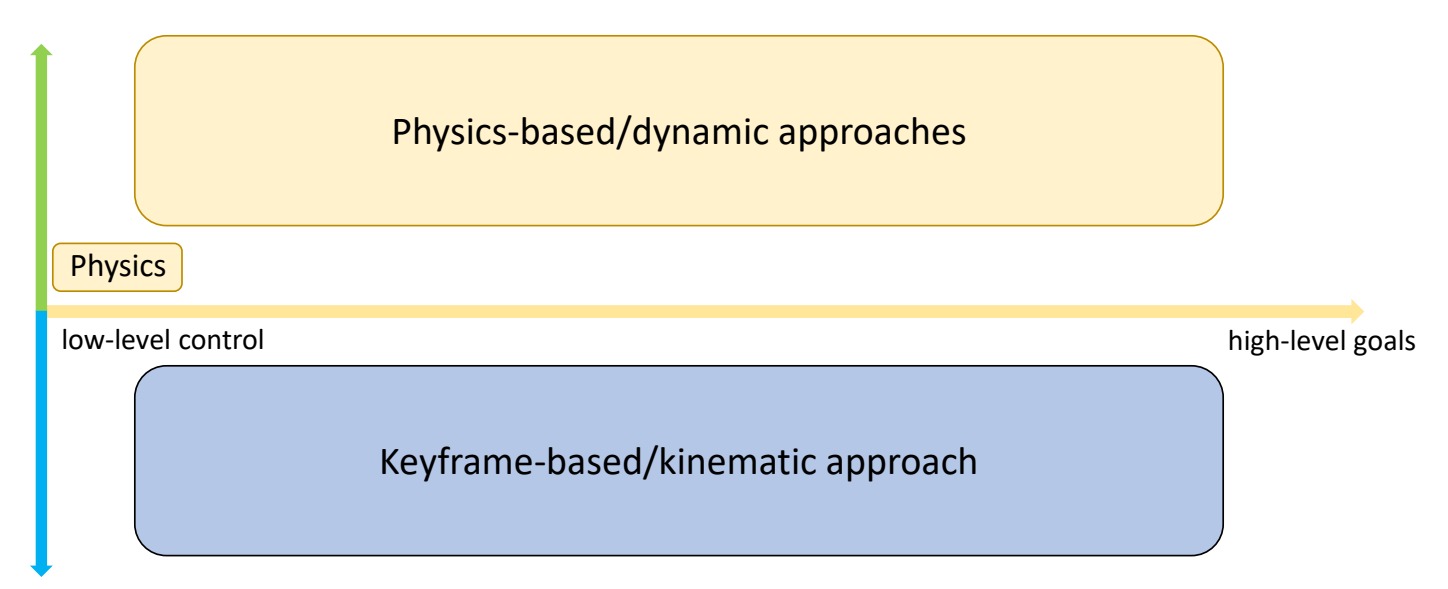

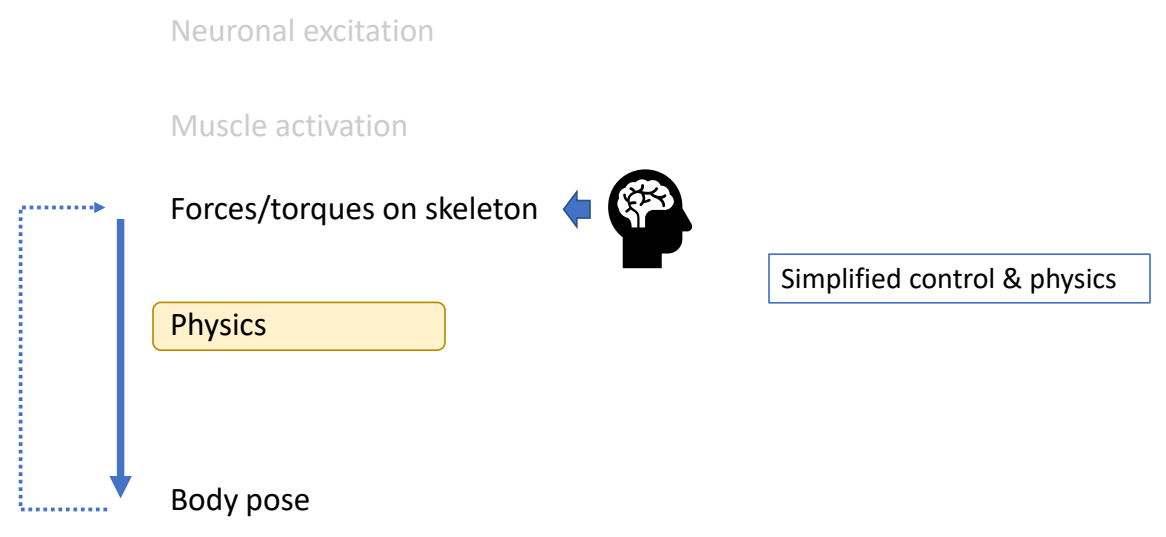

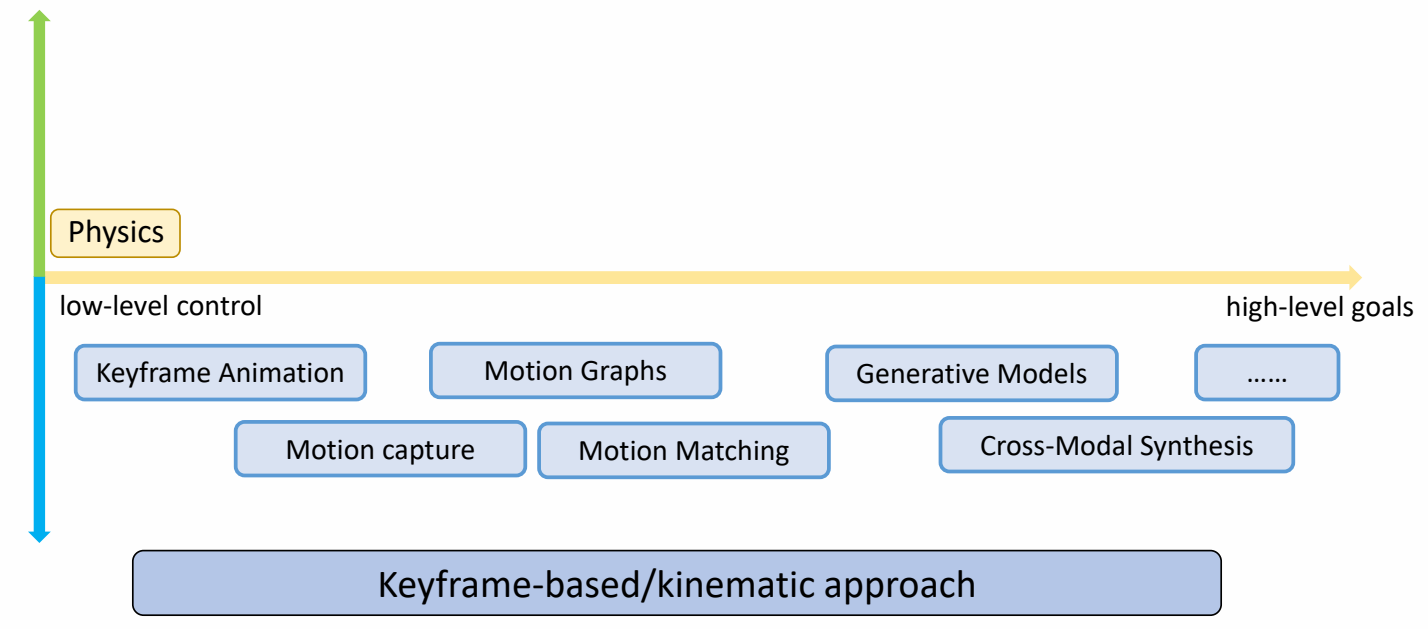

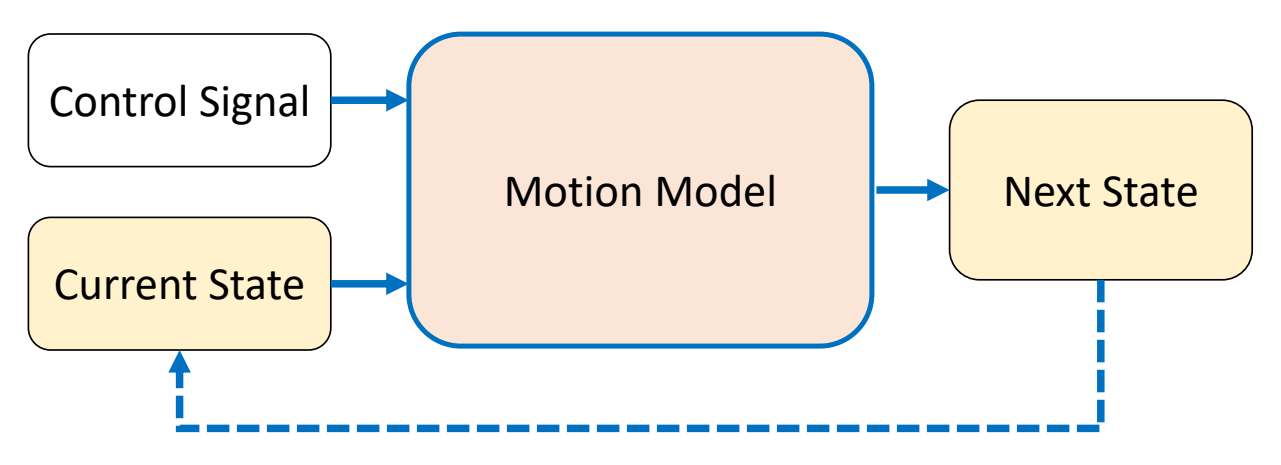

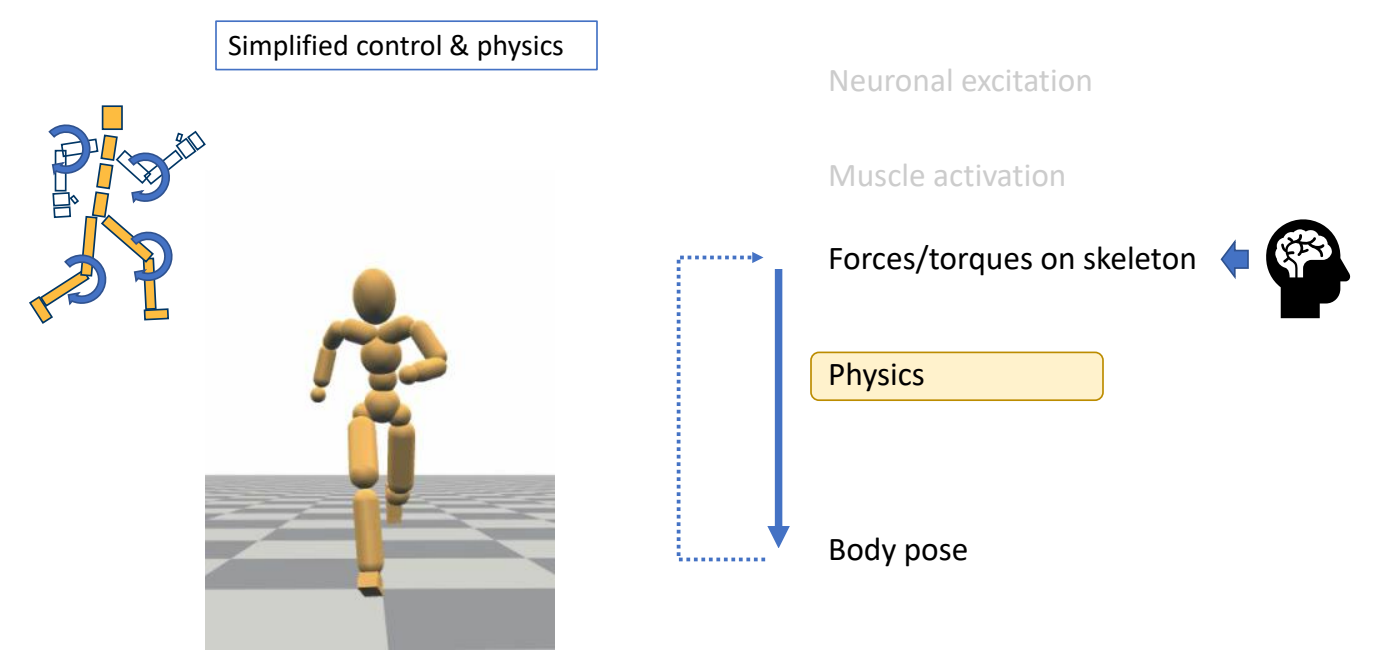

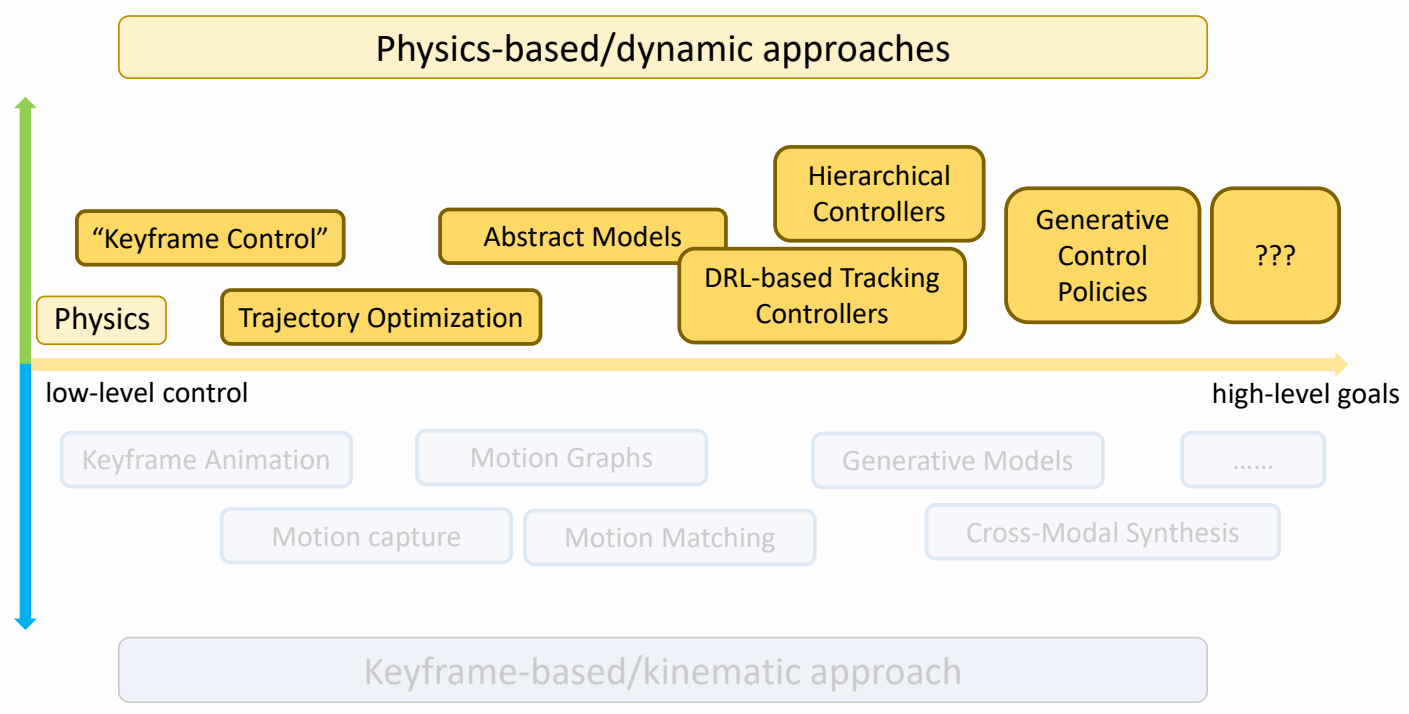

根据是否使用物理,把角色动画分为两大类。

运动学 vs. 动力学对比

| 维度 | 运动学方法 (Kinematic) | 动力学方法 (Dynamic) |

|---|---|---|

| 核心思想 | 直接控制关节姿态/速度 | 通过力/力矩驱动角色 |

| 是否考虑质量 | 否 | 是 |

| 是否物理仿真 | 否 | 是 |

| 输出 | 关节姿态/速度 | 关节力矩/PD 控制目标 |

| 抗扰动能力 | 无 | 有 |

| 动作质量 | 高(来自动捕/关键帧) | 取决于控制方法 |

| 计算成本 | 低 | 高 |

| 典型应用 | 关键帧动画、Motion Matching、VR 化身 | 物理仿真、Ragdoll、交互式控制 |

✅ 运动学方法:基于运动学直接更新角色状态,运动可以不符合物理规律。 ✅ 动力学方法:基于物理仿真,但实际会有简化,不能直接干预角色姿态。

P16

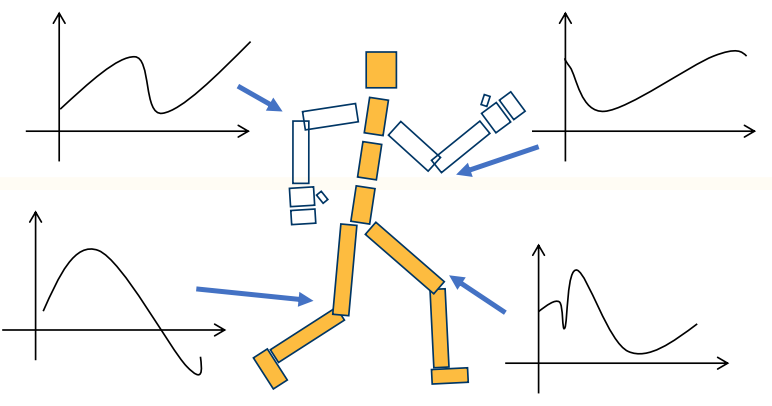

Keyframe-based/Kinematic Approaches

✅ 基于运动学直接更新角色状态,运动可以不符合物理规律。

P18

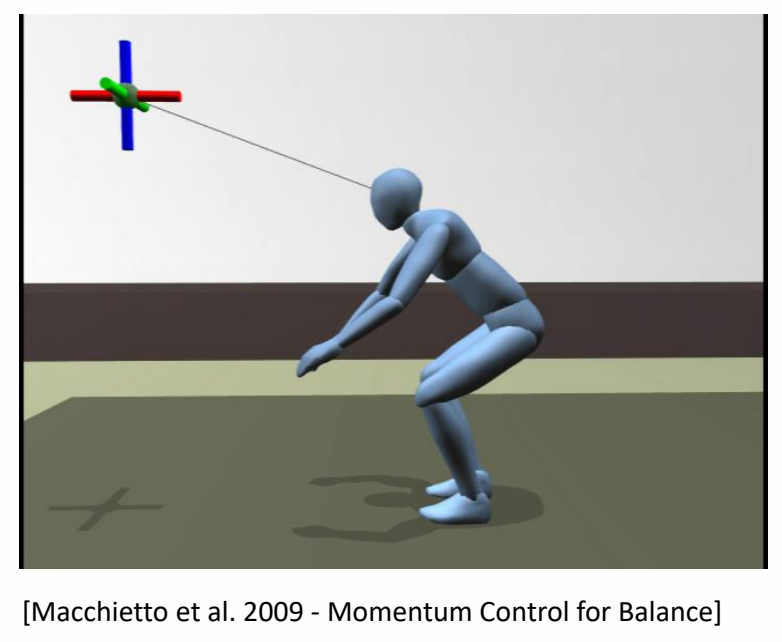

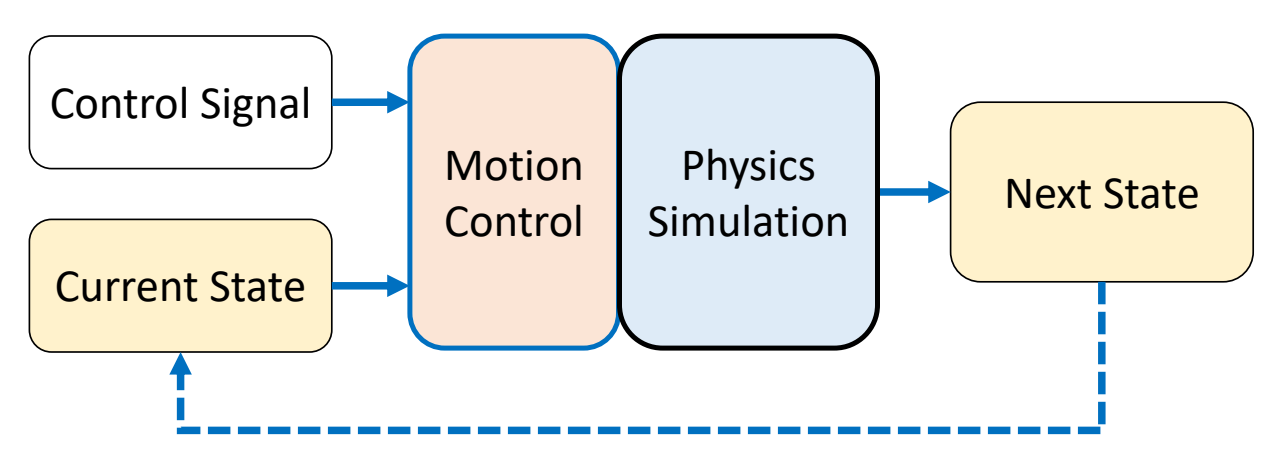

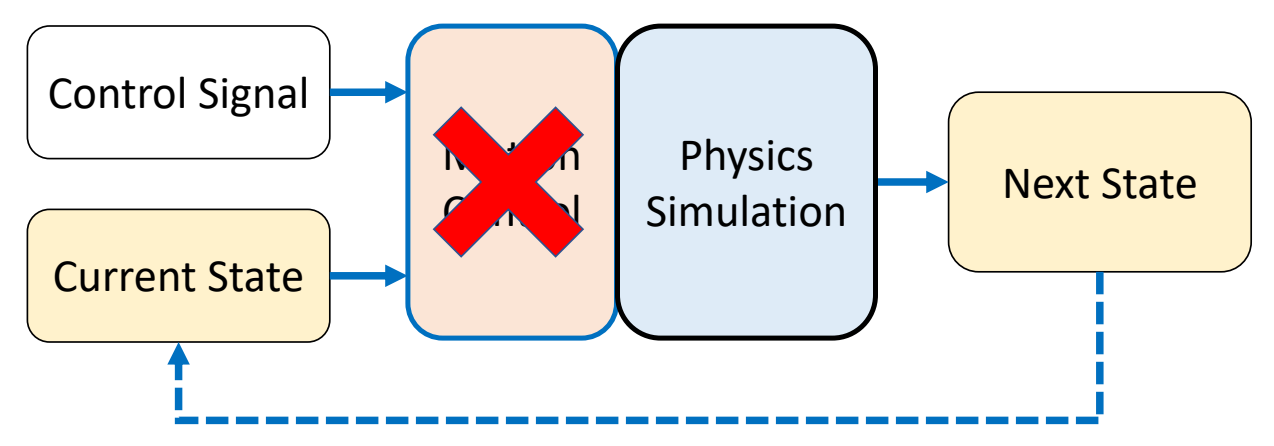

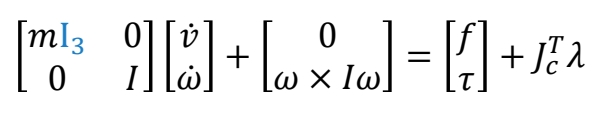

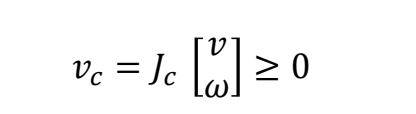

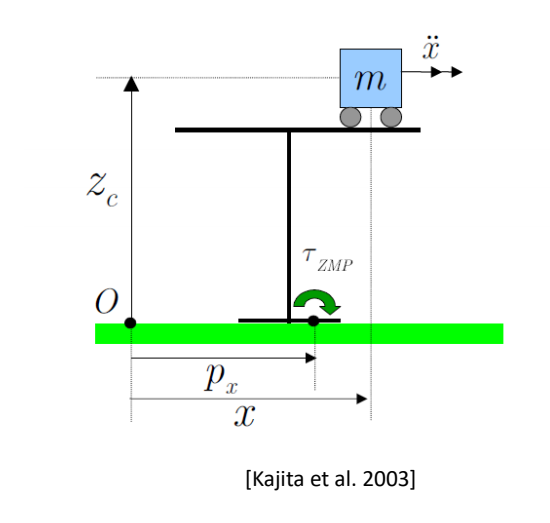

Physics-based/Dynamic Approaches

✅ 基于物理,但实际情况会有简化,不能直接干预角色姿态。

P19

Control Level

根据控制方式的高度,可以分为Low Level和Heigh Level

P20

low-level control

✅ 对每一帧每一个姿态进行精确控制每个细节。

✅ 优点:精确控制;缺点:低效。

P21

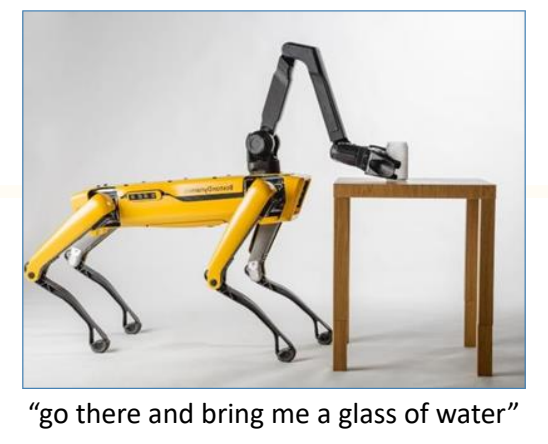

high-level control

✅ 控制高级目标。

Keyframe-based/Kinematic Approaches

P24

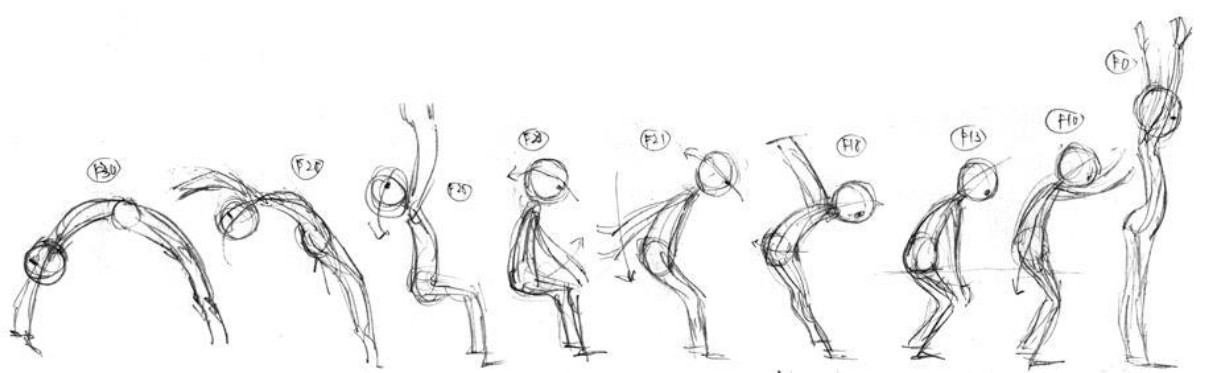

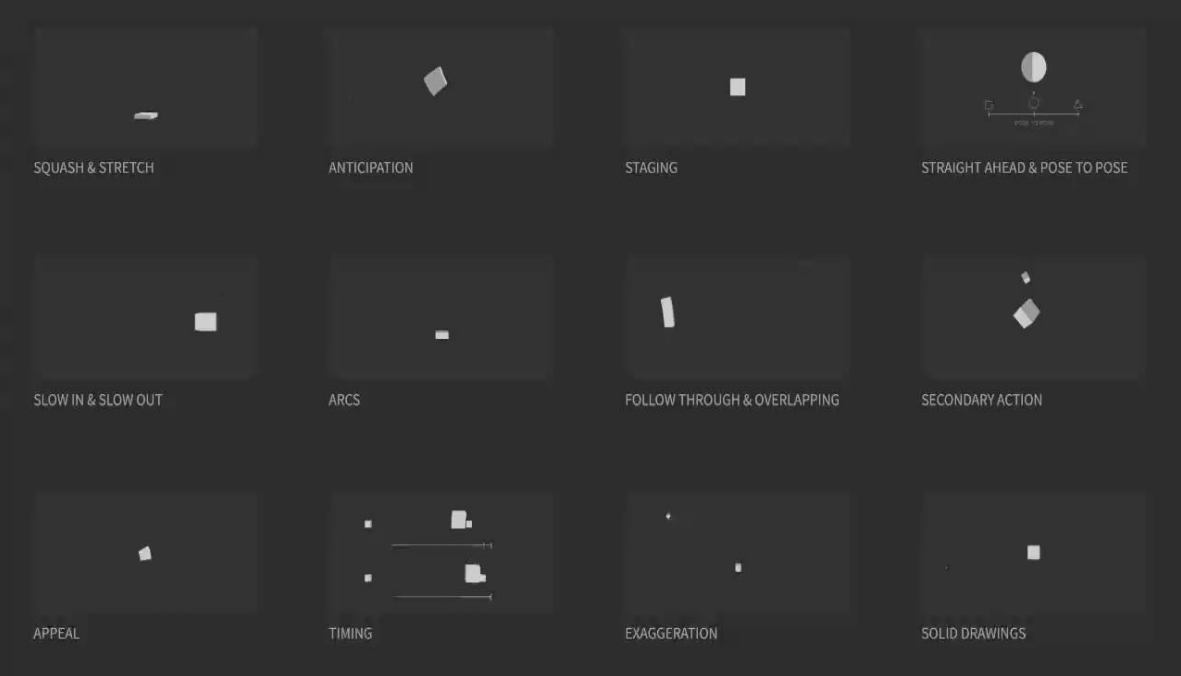

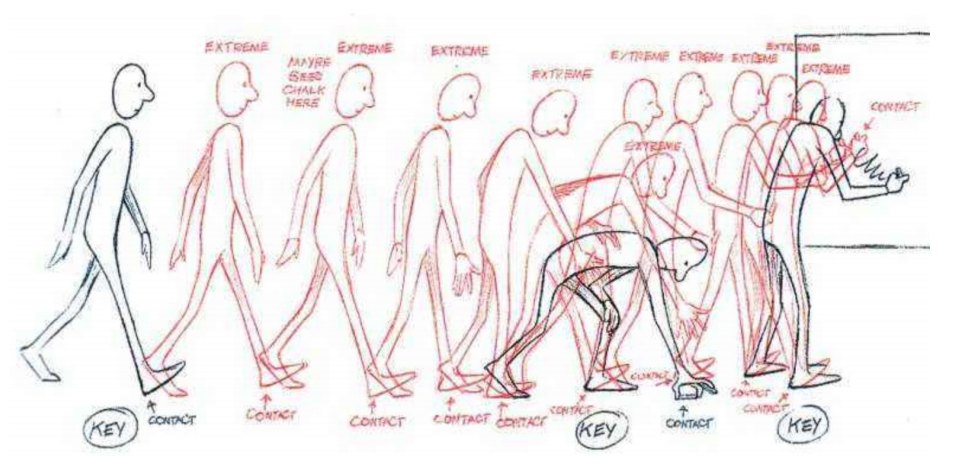

Disney’s 12 Principles of Animation

[http://the12principles.tumblr.com/]

✅ 在动画师总结的准则里隐藏了物理规则和艺术夸张

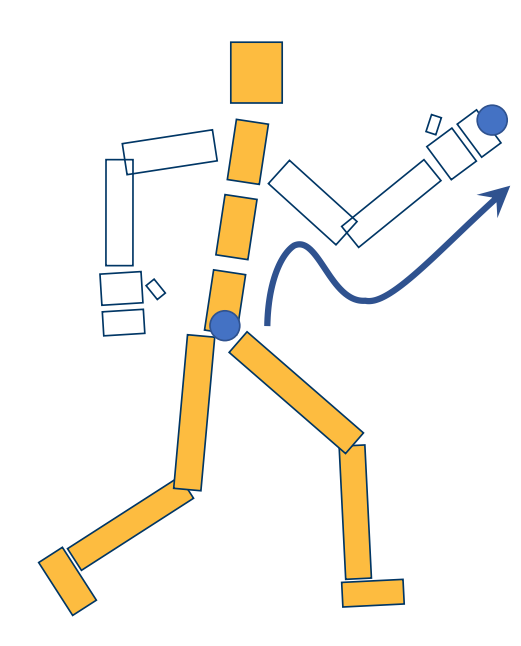

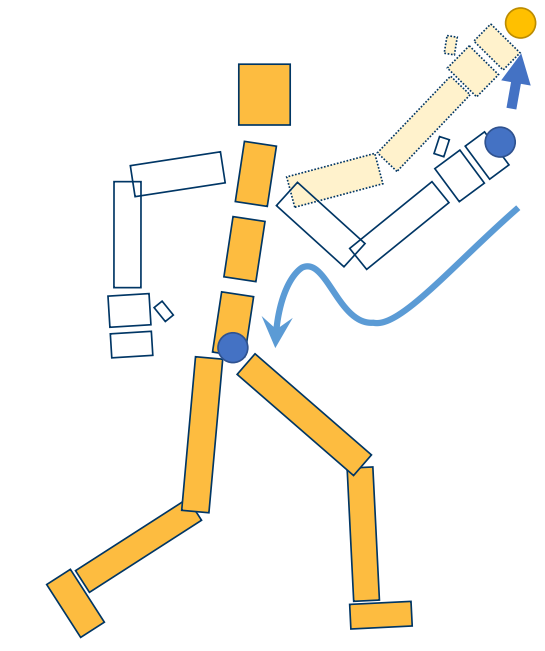

Keyframe Animation

✅ 这是一种非常low level的控制方法,可以保证所有细节,但非常慢

P26

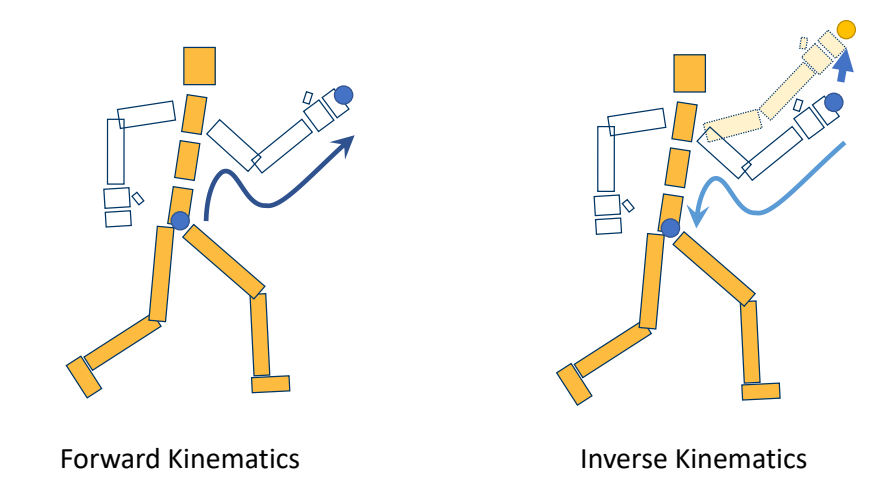

Forward Kinematics

Given rotations of every joints

Compute position of end-effectors

P27

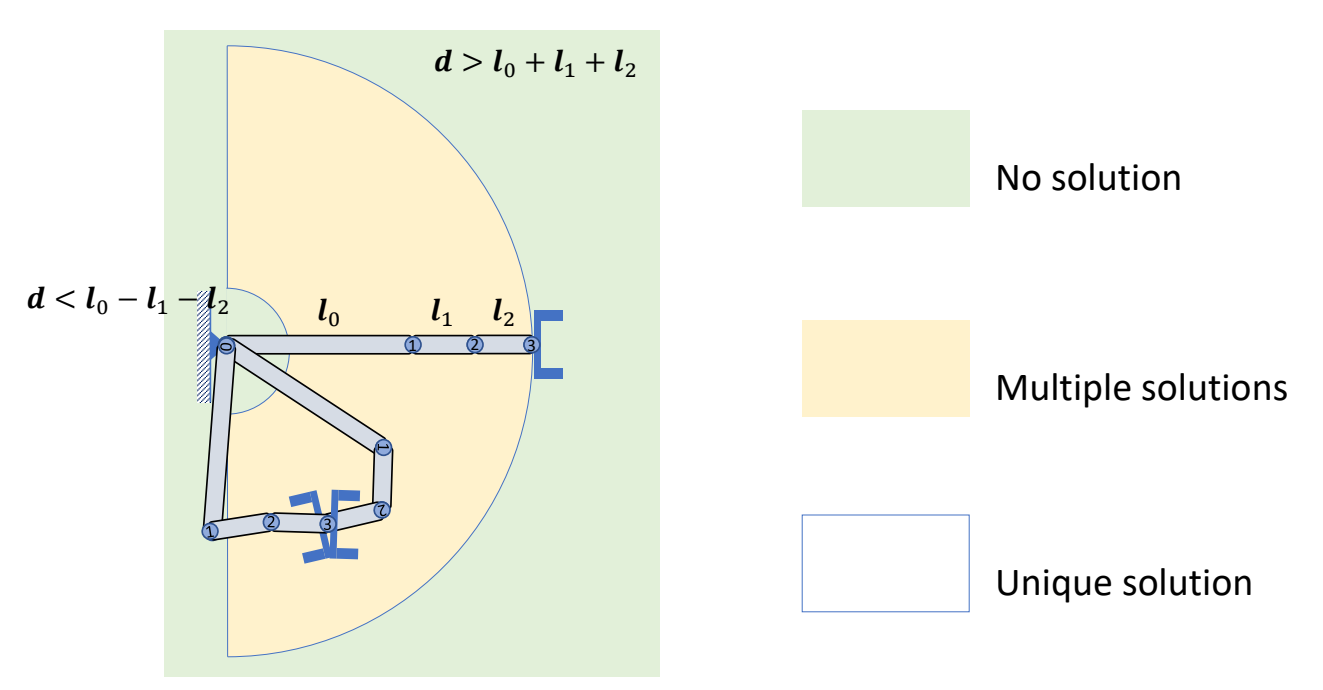

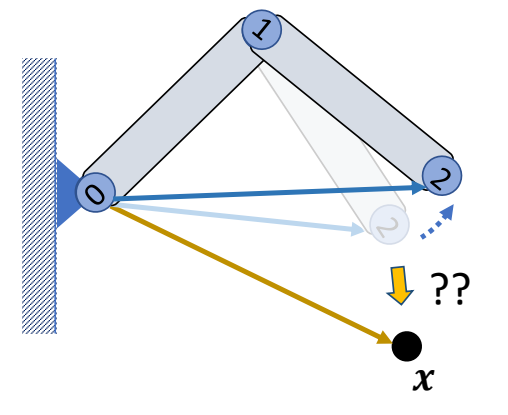

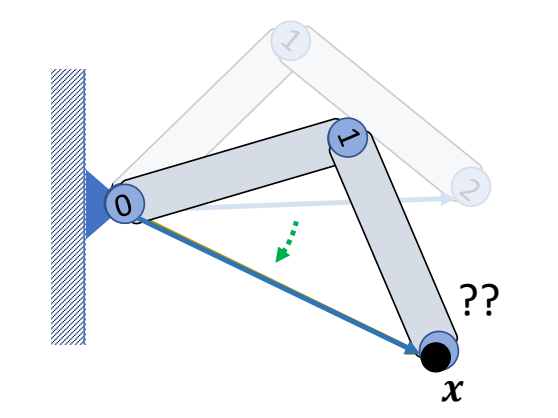

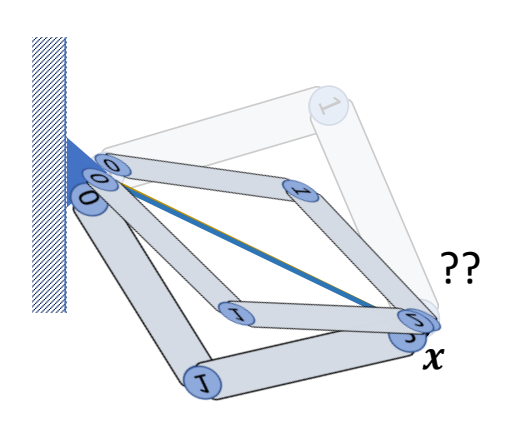

Inverse Kinematics

Given position of end-effectors

Compute rotations of every joints

P28

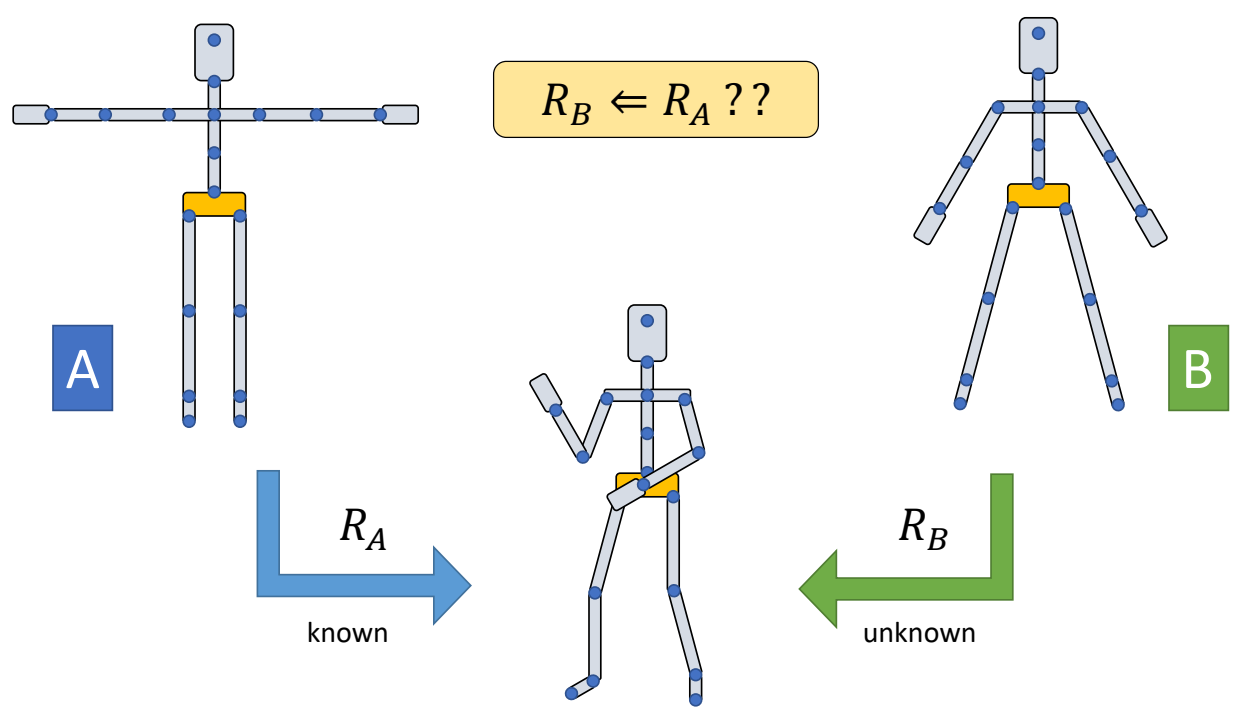

Interpolation

Motion Capture

动捕设备、视频动捕,把动捕角色应用到角色身上,需要经过重定向

动作捕捉和重放,不能产生新的数据

✅ 光学动捕、视频动捕、穿戴传感器动捕。

P34

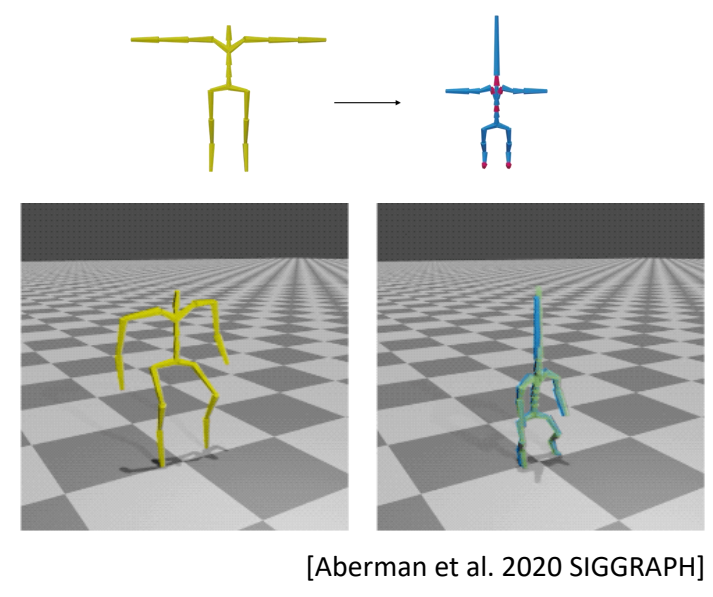

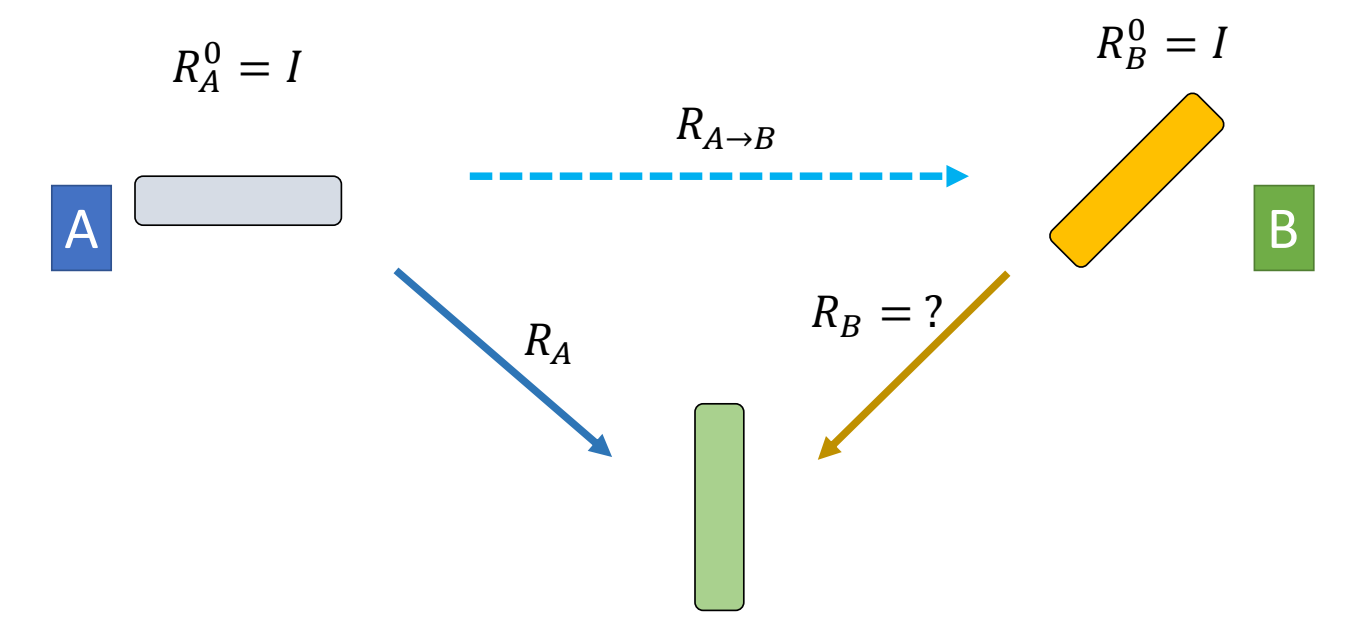

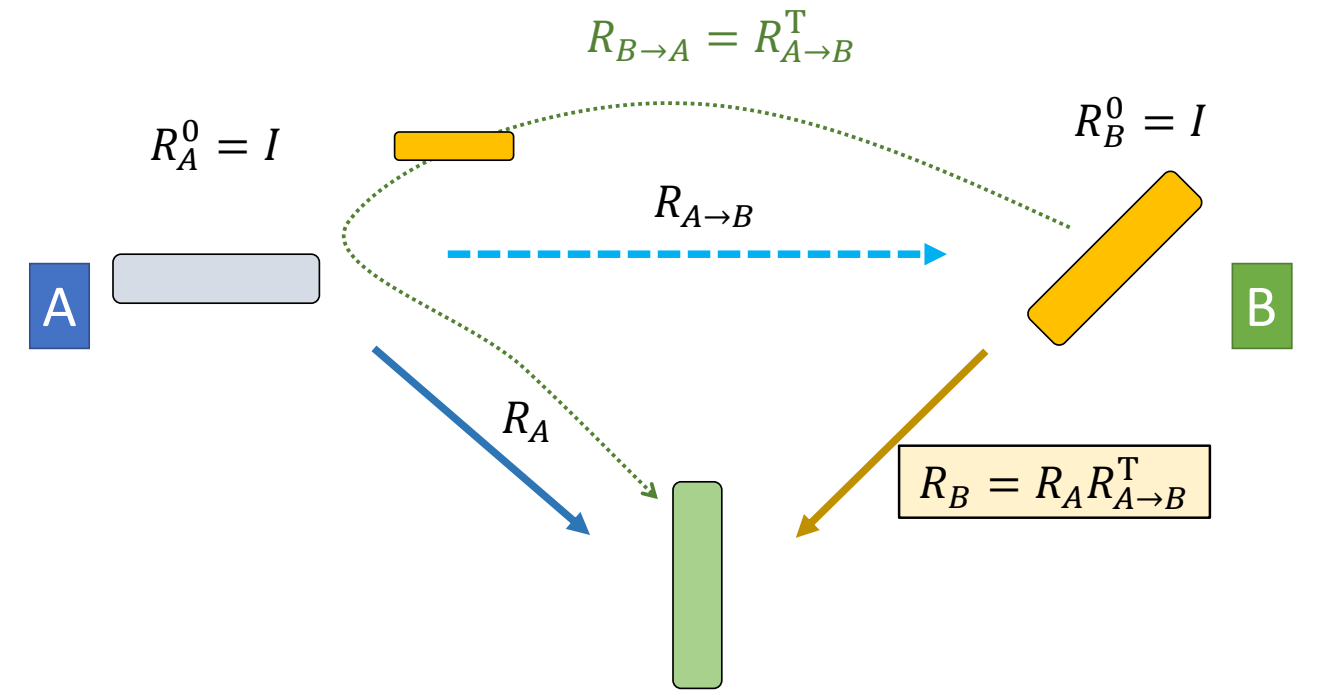

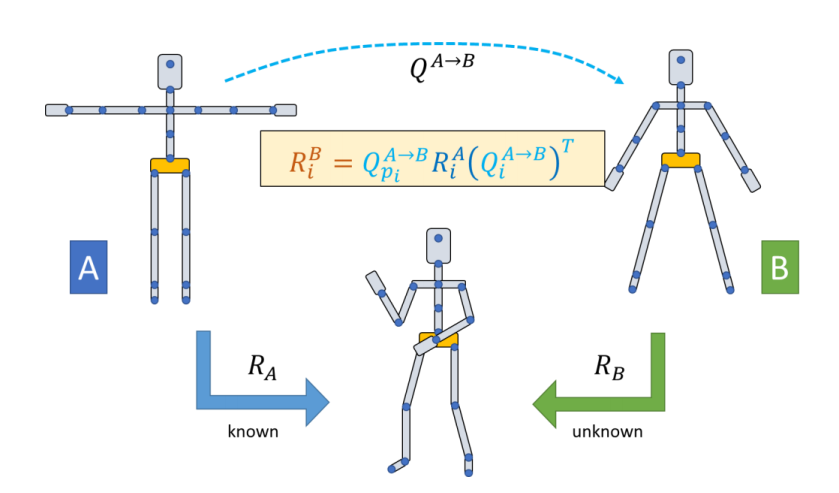

Motion Retargeting

Given motions of a source character

Compute motions for target characters with

- different skeleton sizes

- different number of bones

- different topologies

- ……

P36

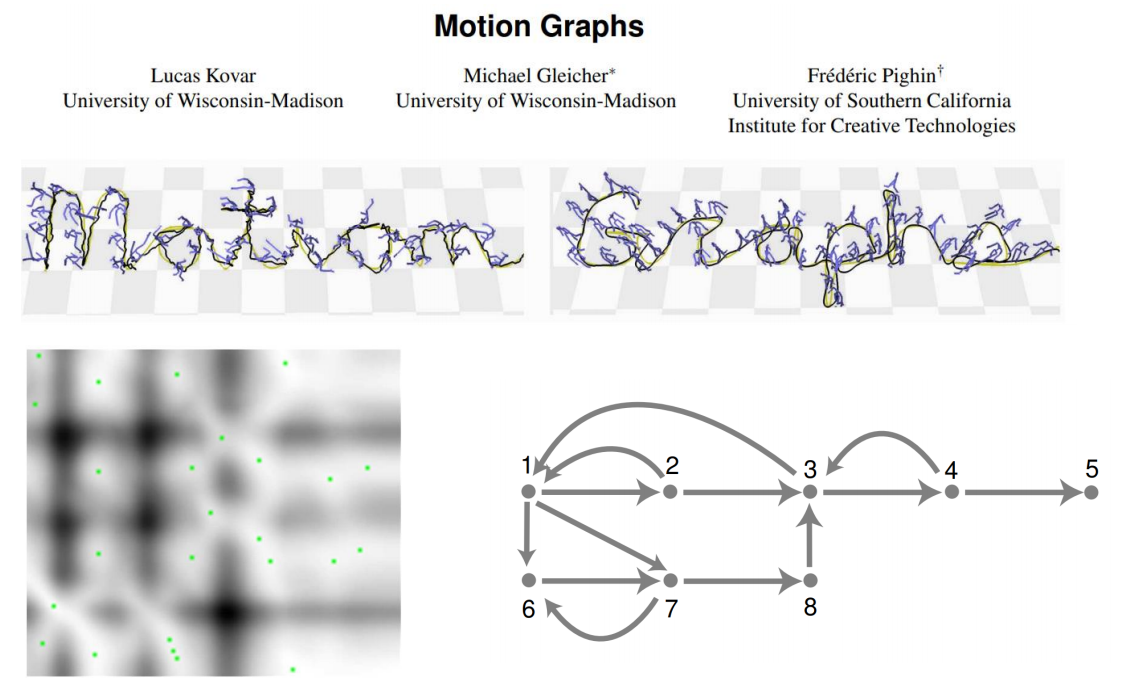

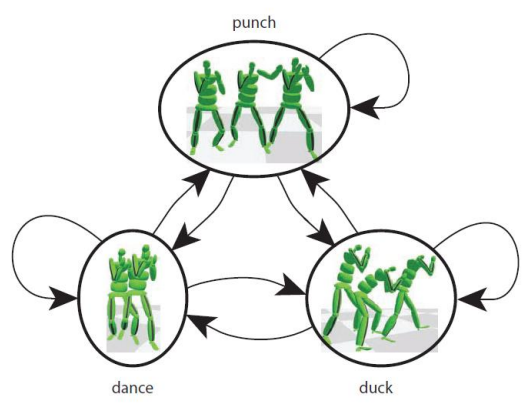

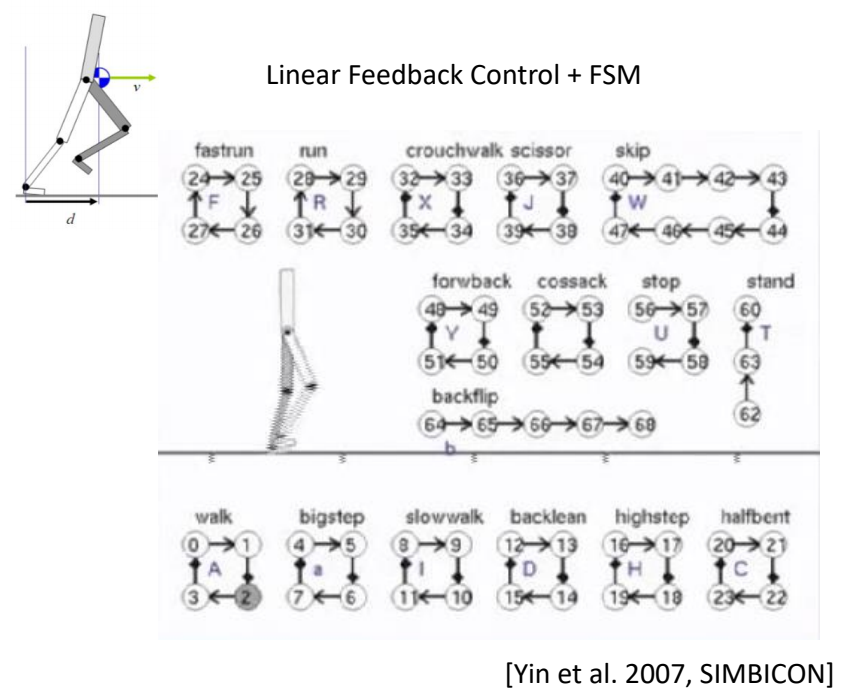

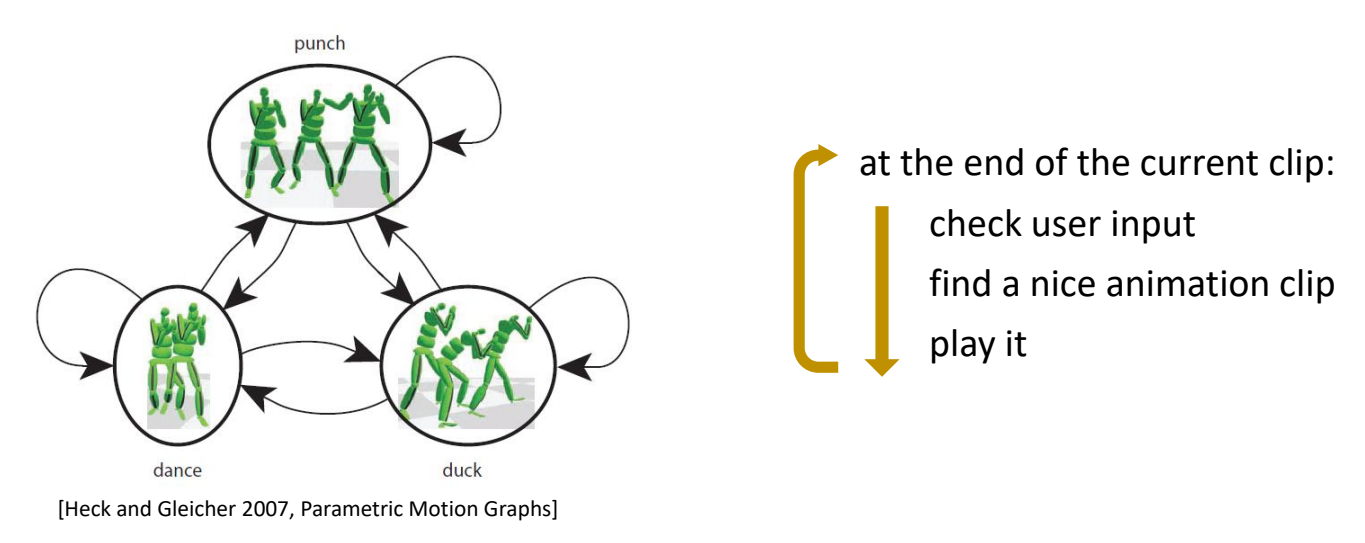

Motion Graphs / State Machines

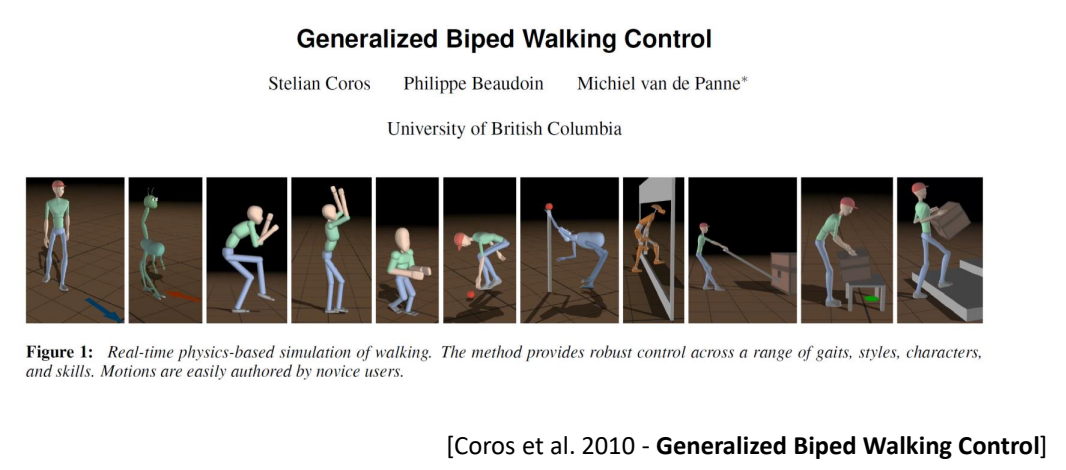

✅ 把捕出来的动作进行分解和重组,生成新的动作。

P37

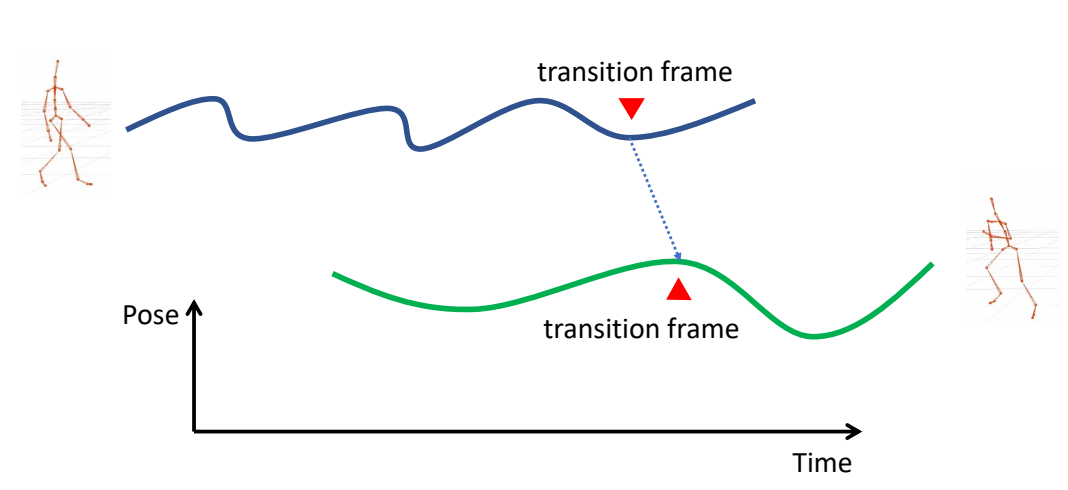

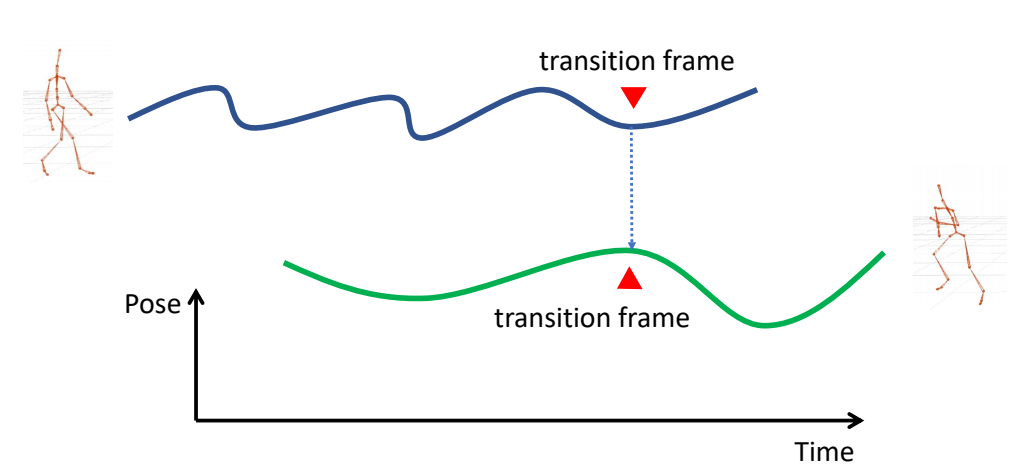

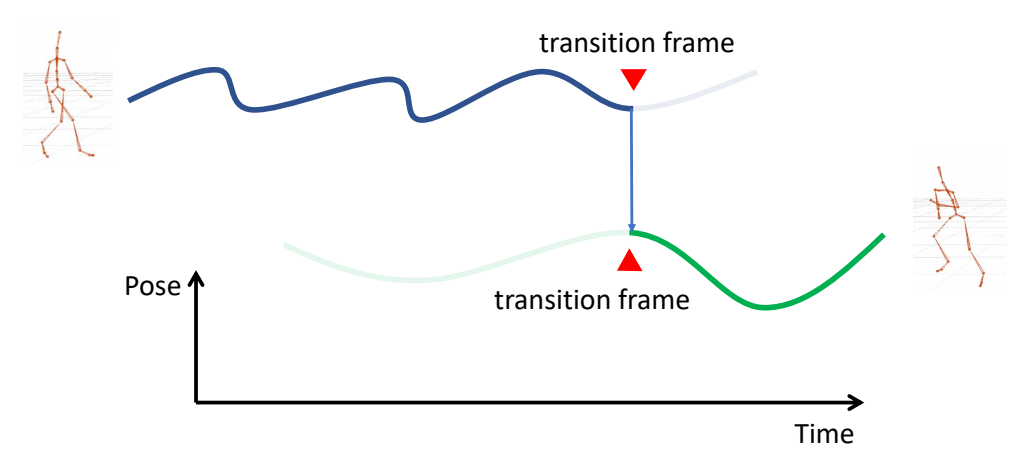

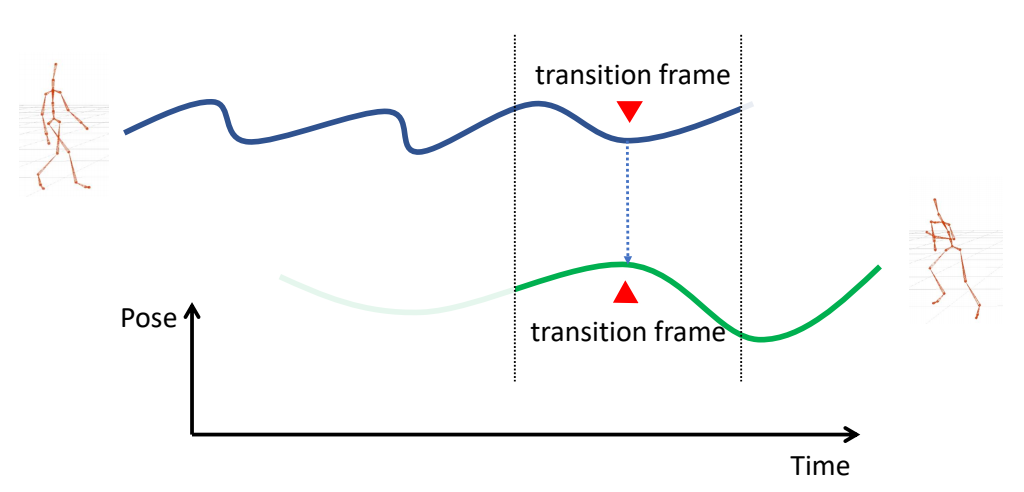

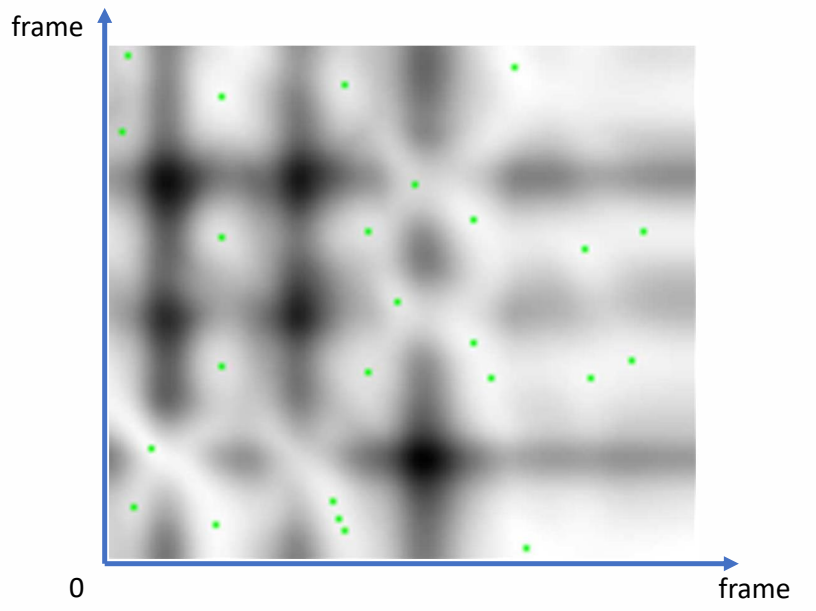

Motion Graphs

✅ 给一段任意的动作,寻找能够构建状态机切换的位。

P38

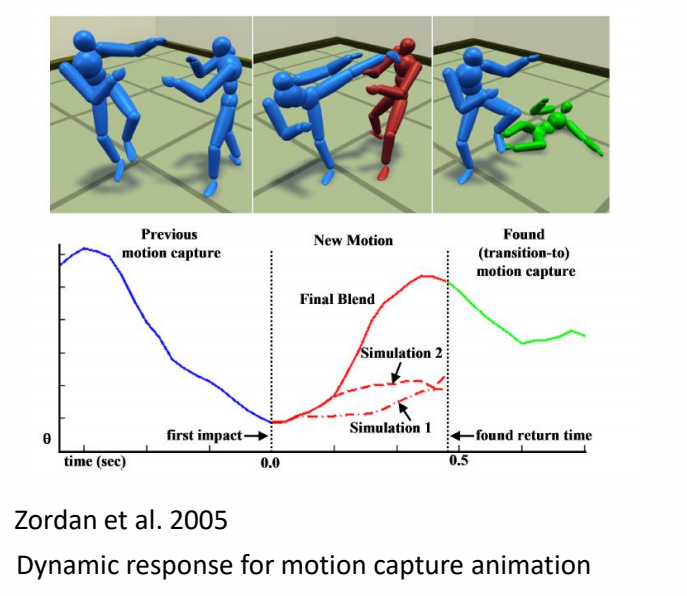

Motion Graphs的改进 - Interactively Controlled Boxing

[Heck and Gleicher 2007, Parametric Motion Graphs]

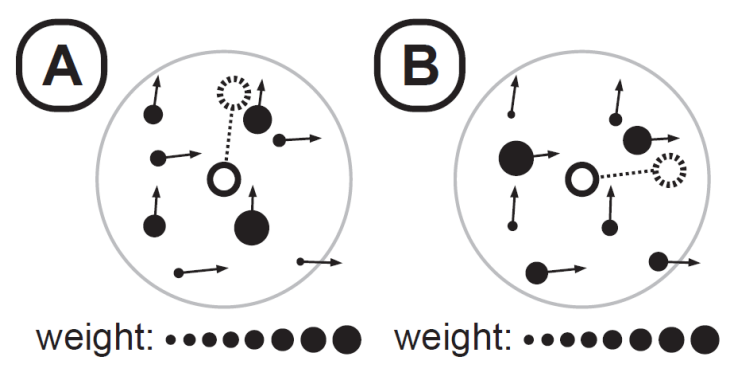

✅ 对Motion Graph的改进,比如一个节点中有很多动作,对这些动作进行插值,来实现精确控制。

P39

Motion Graphs的高级应用

Character Animation in Two-Player Adversarial Games

KEVIN WAMPLER,ERIK ANDERSEN, EVAN HERBST, YONGJOON LEE, and ZORAN POPOVIC Univoersity of Washington

Near-optimal Character Animation with Continuous Control

Adrien Treuille \(\quad\) Yongjoon Lee \(\quad\) Zoran Popovic

University of Washington

✅ Motion Graph+AI,实现高级控制

✅ 例如:AI使用Motion Graph,通过选择合适的边,进行执行,完成高级语义。

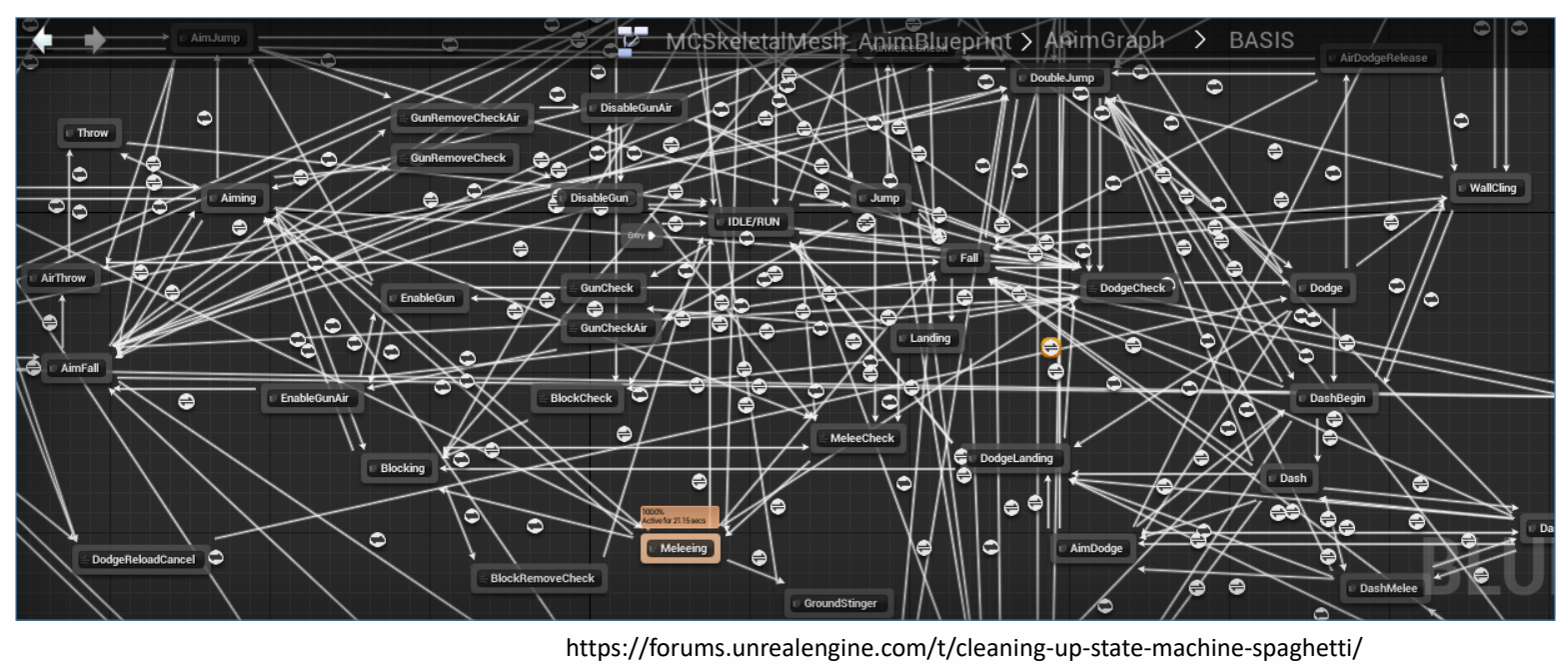

P42

Complex Motion Graphs

✅ 动作图非常复杂,容易出BUG.

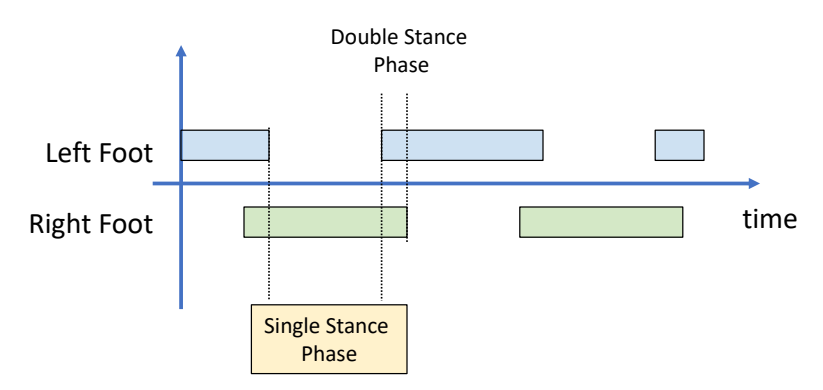

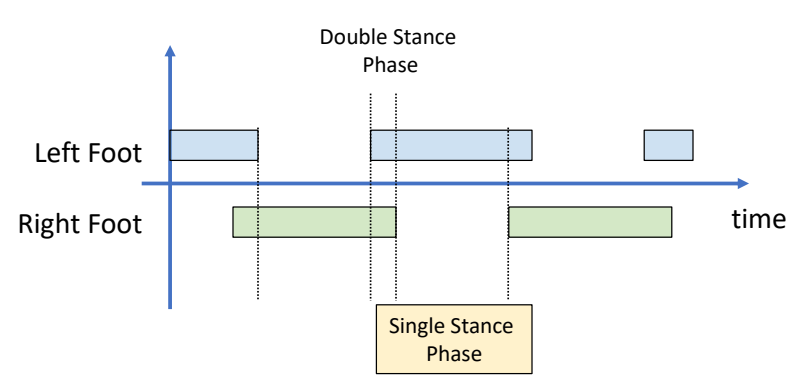

P43

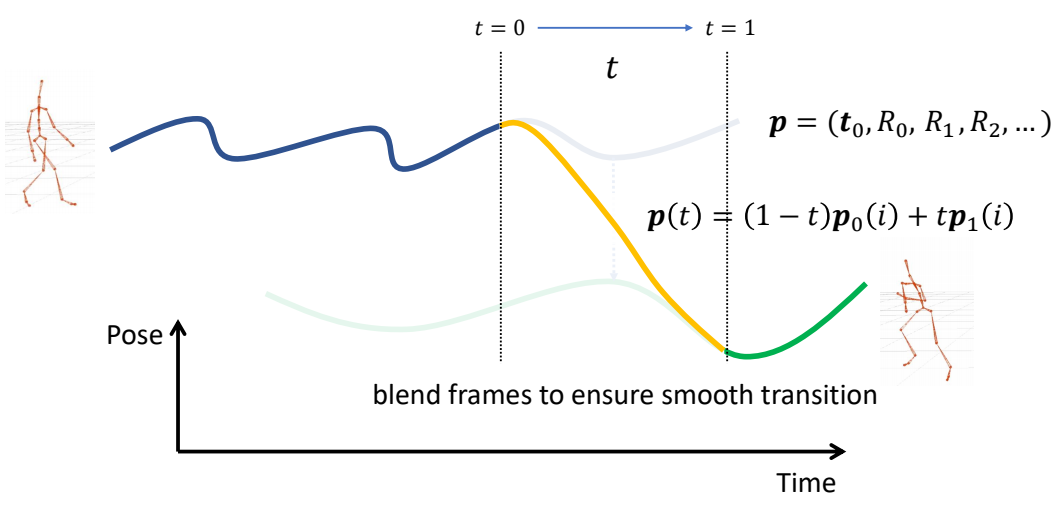

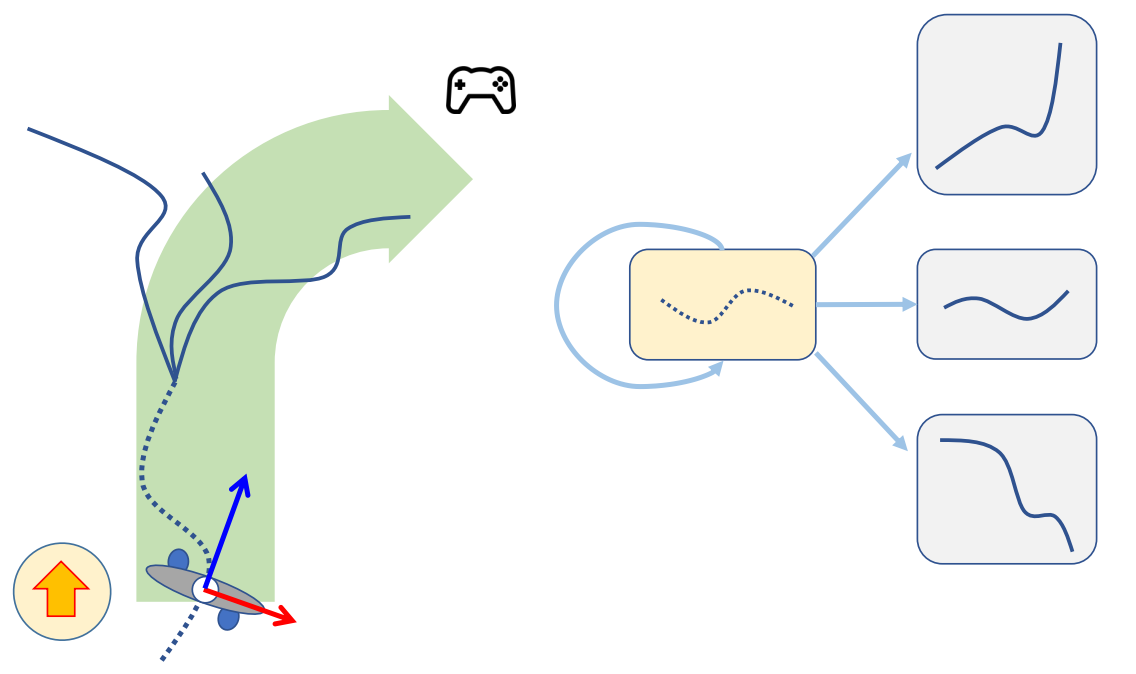

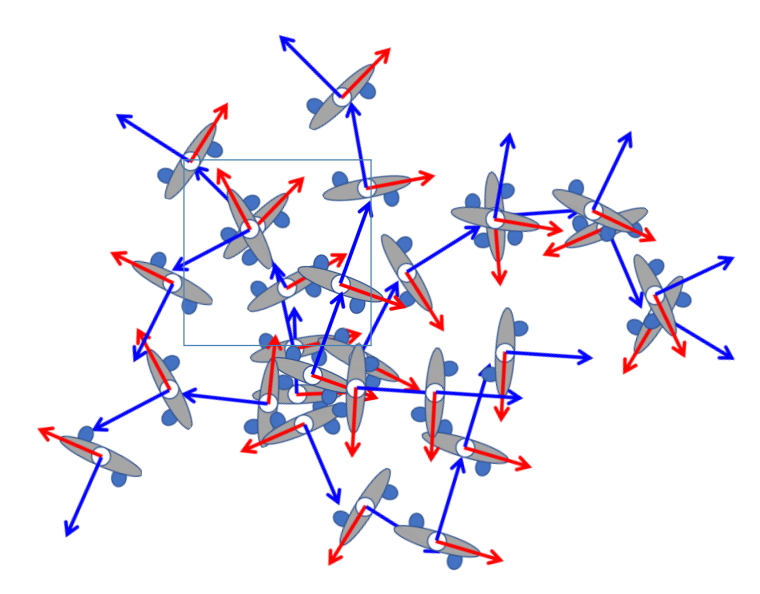

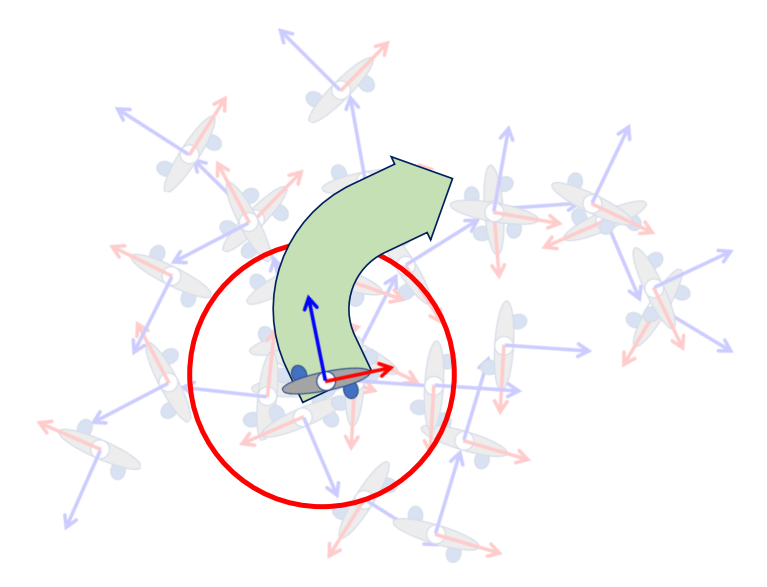

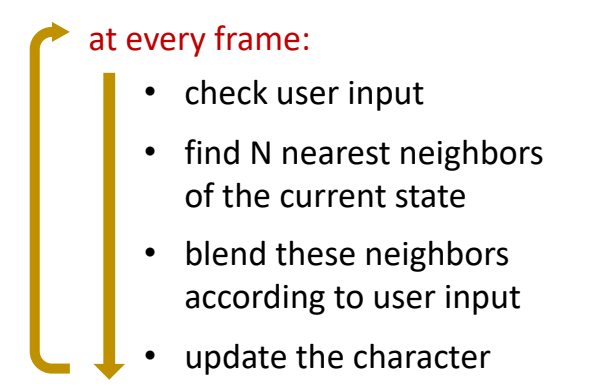

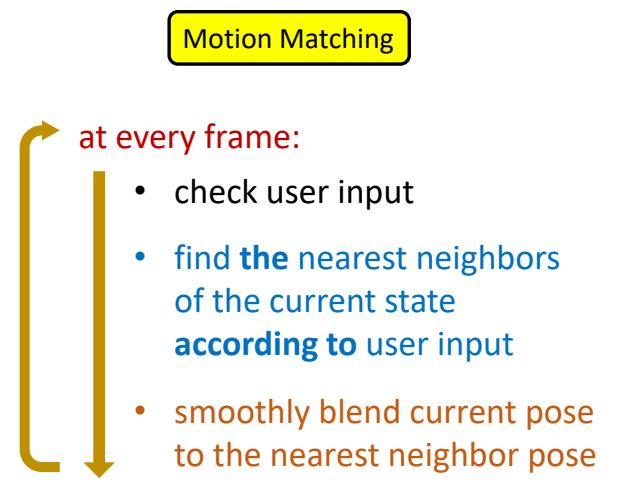

Motion Mathing

✅ 改进,Motion Graph的动作都是完整的片断,可以把动作再分细一点,切到每一帧。

✅ 不是完整地播放一段动作,而是每一帧结束后,通过最近邻搜索找到一个新的姿态,

✅ 满足:(1)接近控制目标(2)动作连续

✅ 关键:(1)定义距离函数(2)设计动作库

P45

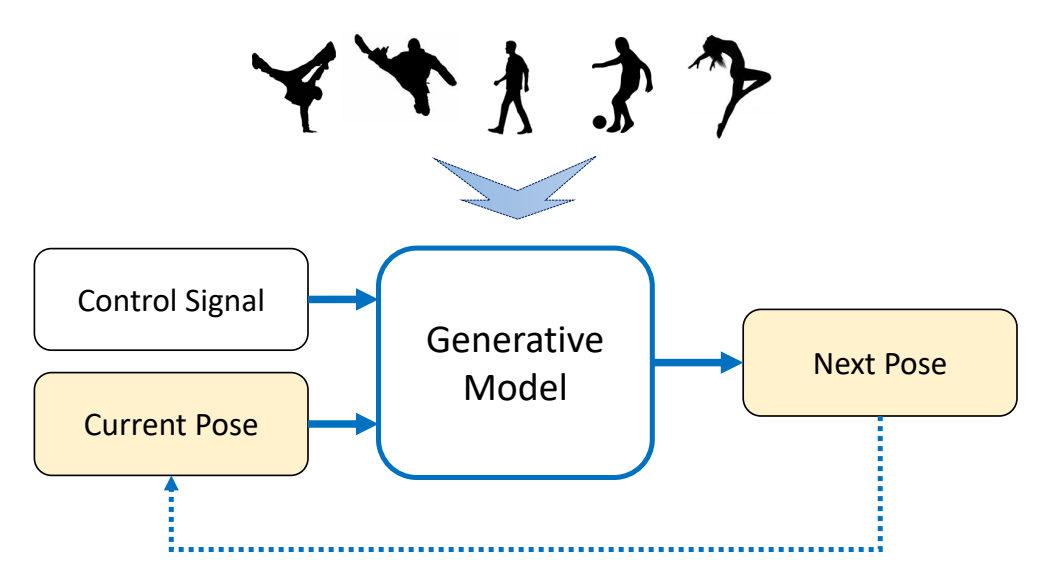

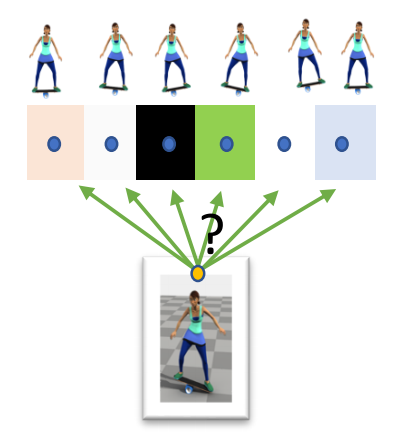

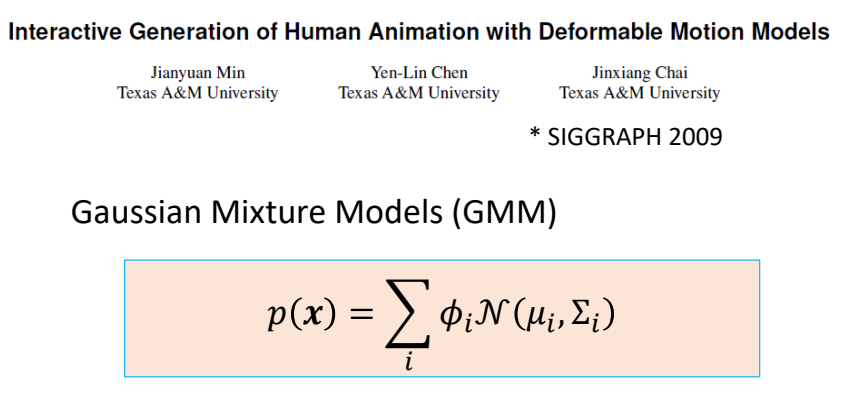

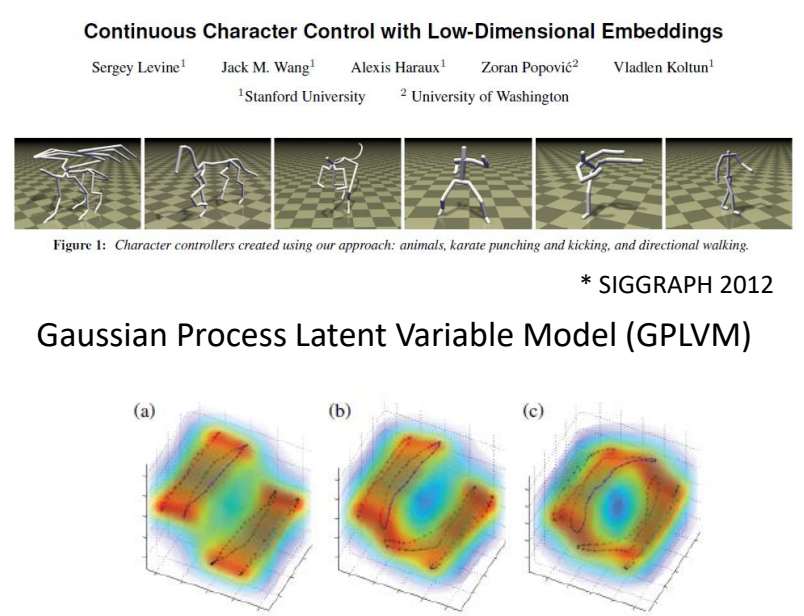

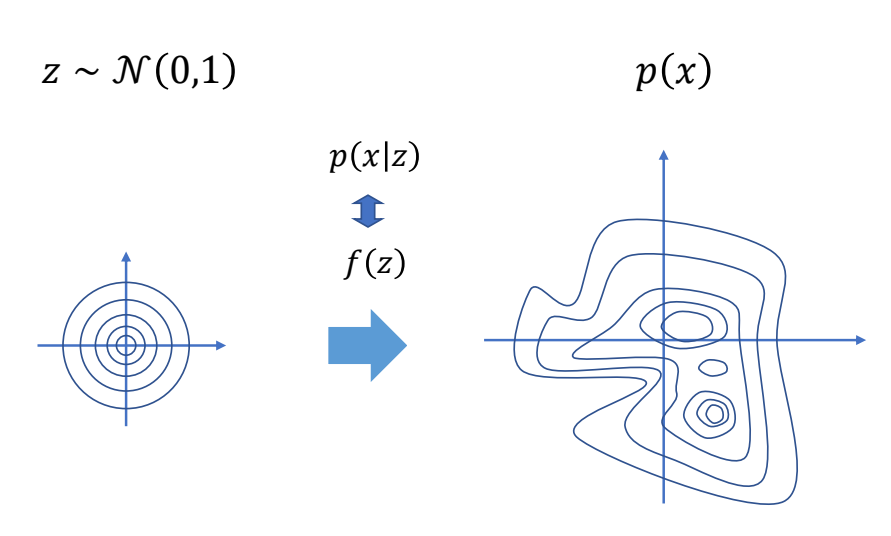

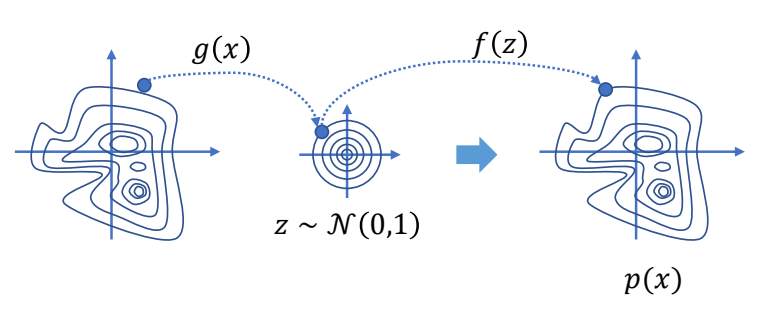

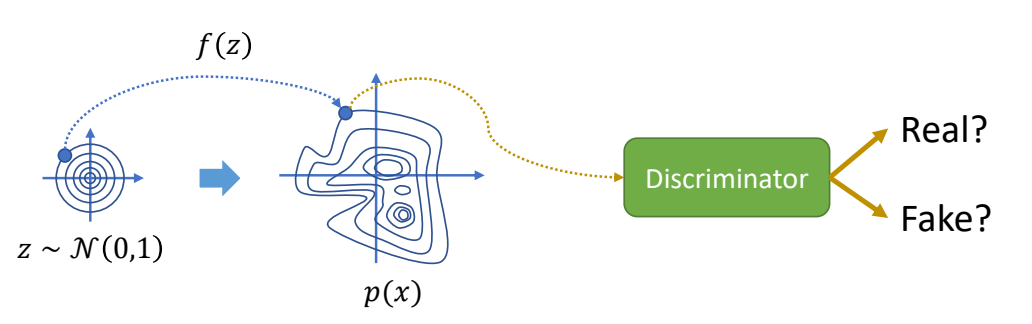

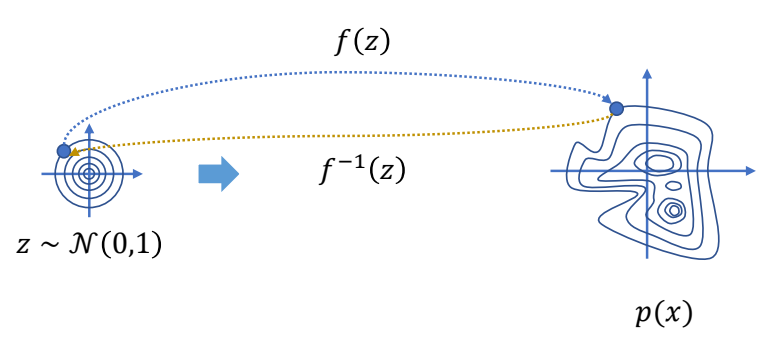

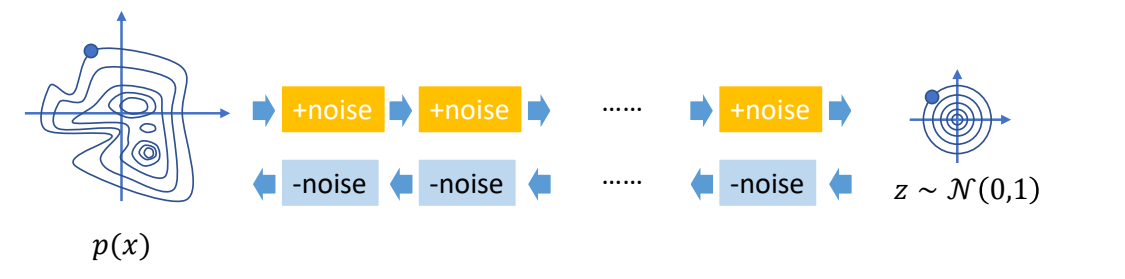

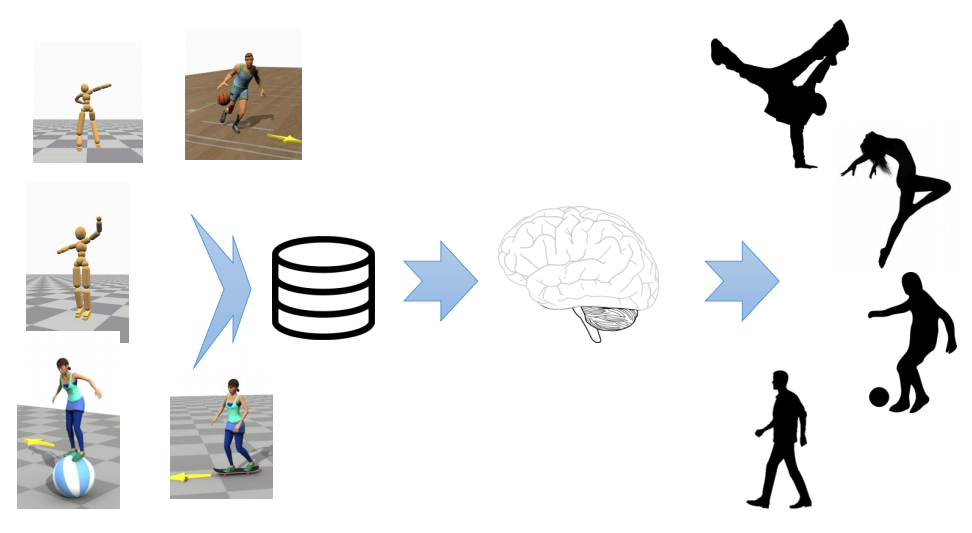

Learning-based Approaches

https://caterpillarstudygroup.github.io/ImportantArticles/CharacterAnimation/HumanMotionGenerationSummary.html

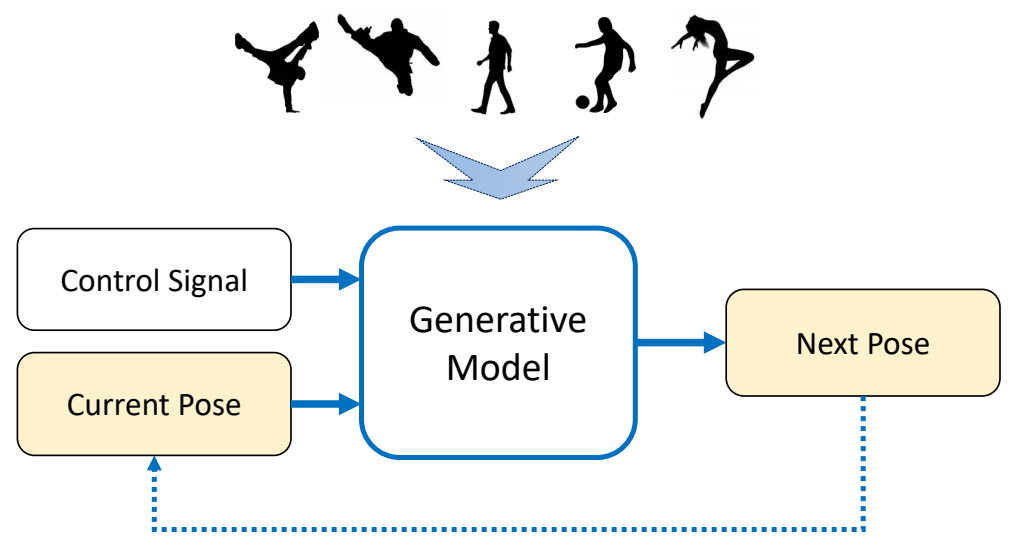

✅ 对角色动作的内在规律去理解和建模,从数据学习统计规律。

✅ 生成模型:只需要采足够的动作去给模型就能生成新的动作。

✅ 不需要手工作切分、生成状态机

P49

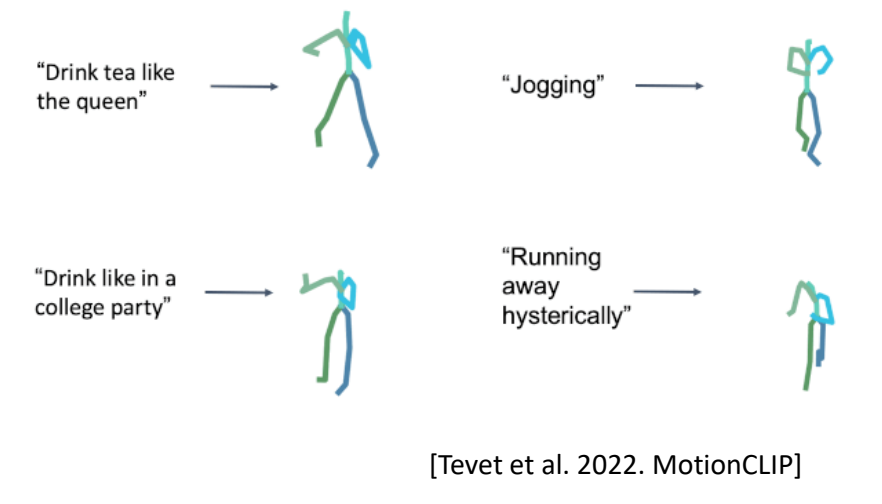

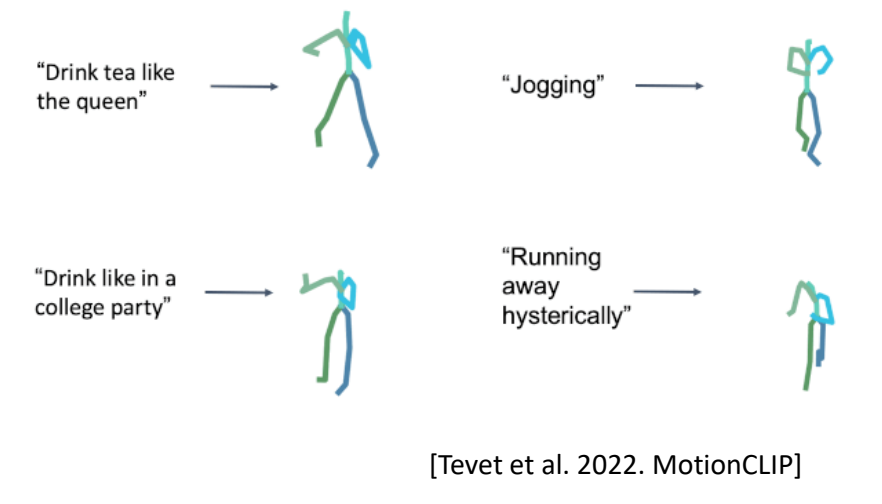

Cross-Modal Motion Synthesis

- Audio-driven animation

- Music to dance

- Co-speech gesture

- ……

- Natural language to animation

- Descriptions to actions

- Scripts to performance

- ……

| ID | Year | Name | Note | Tags | Link |

|---|---|---|---|---|---|

| 2022 | Rhythmic Gesticulator | ✅ 语言和动作都有内存的统计规律,把两种统计模型之间建关系,实现跨模态生成。 |  |

总结

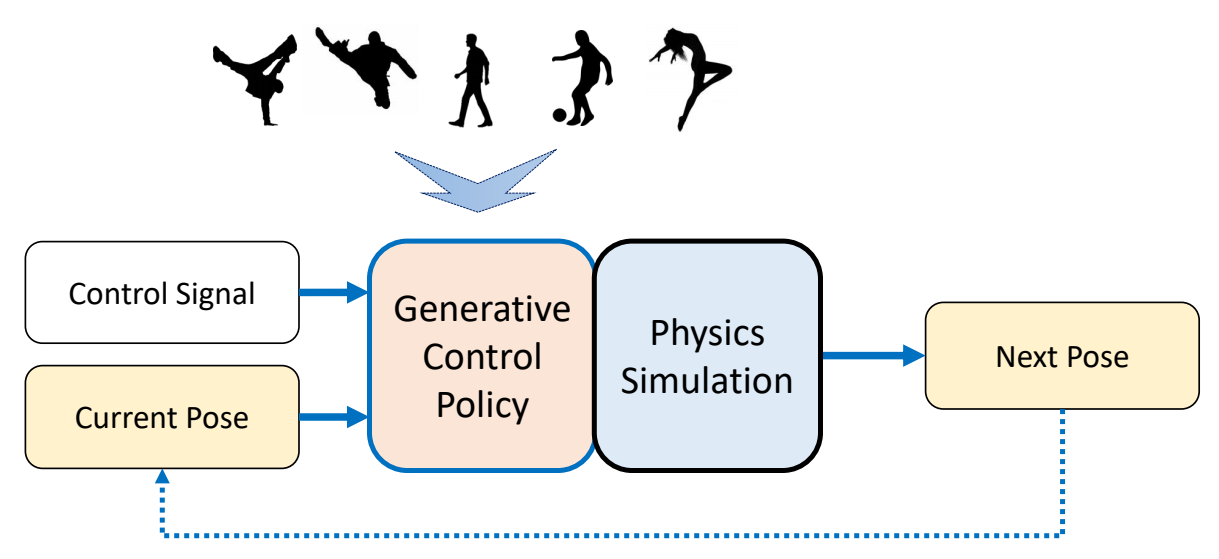

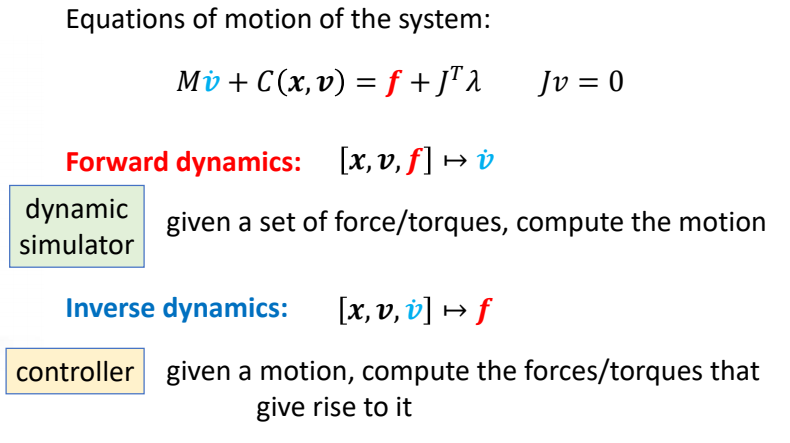

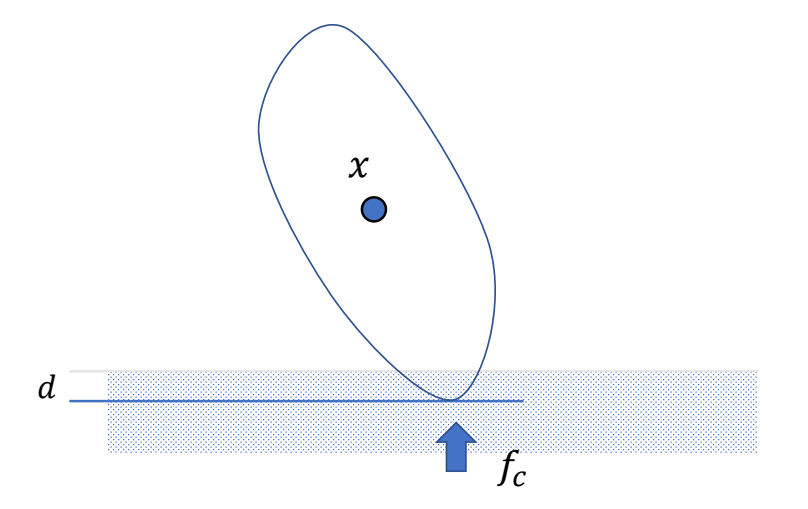

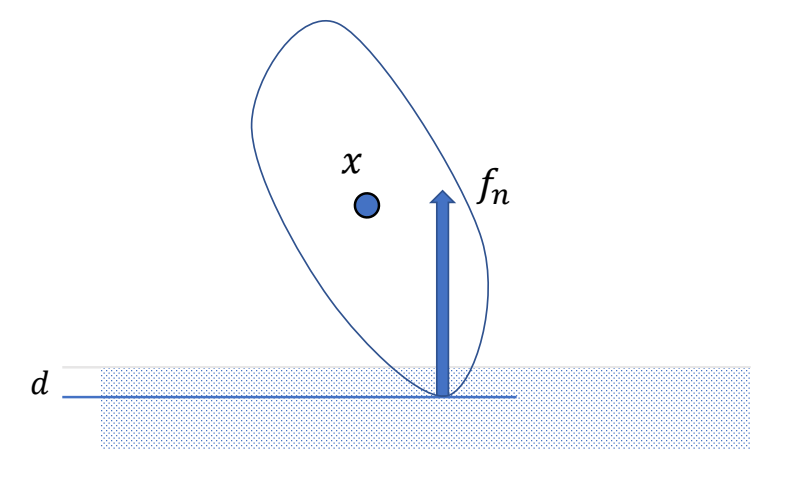

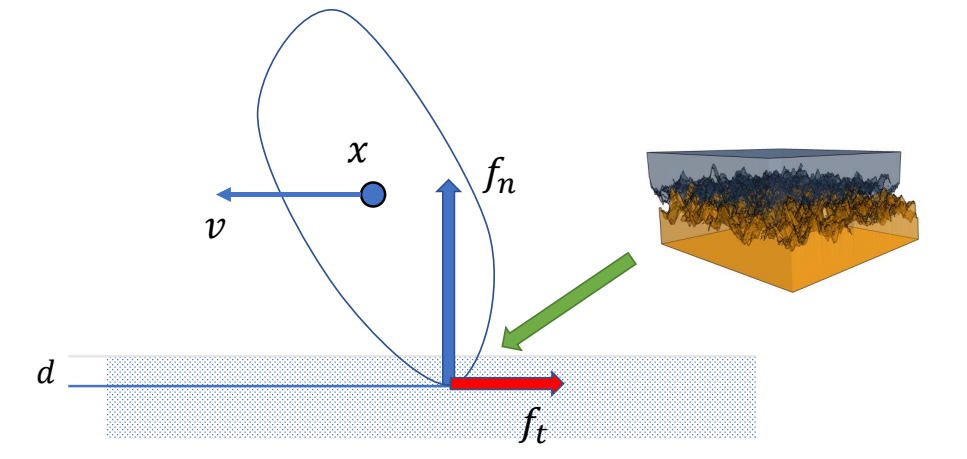

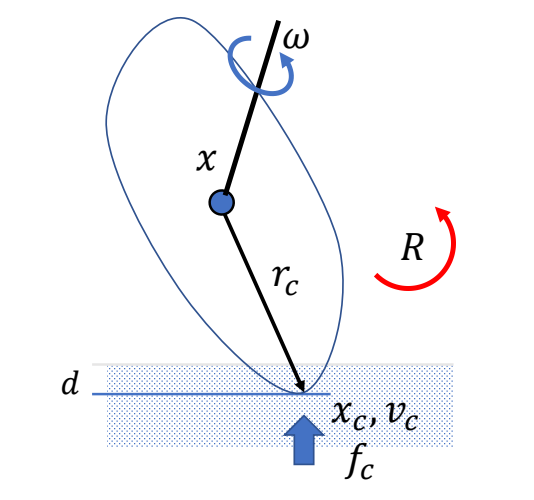

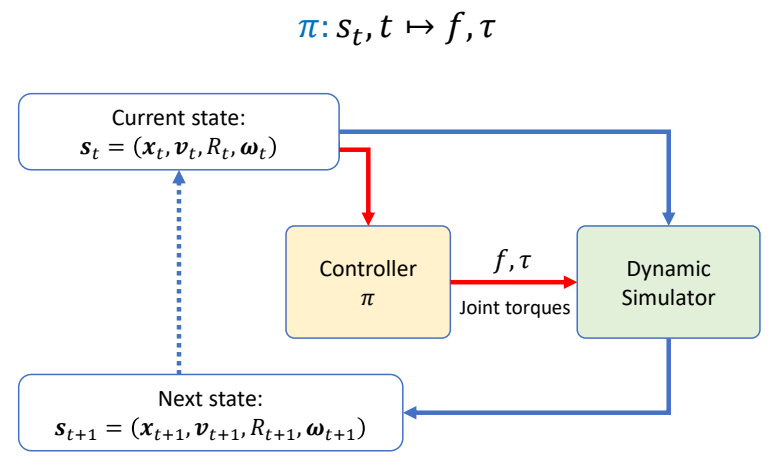

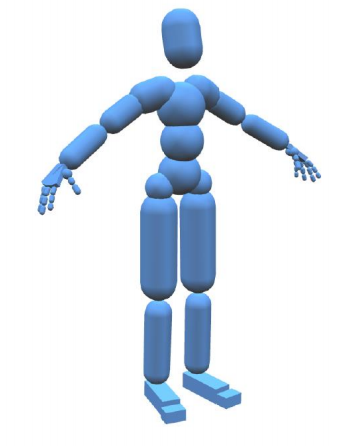

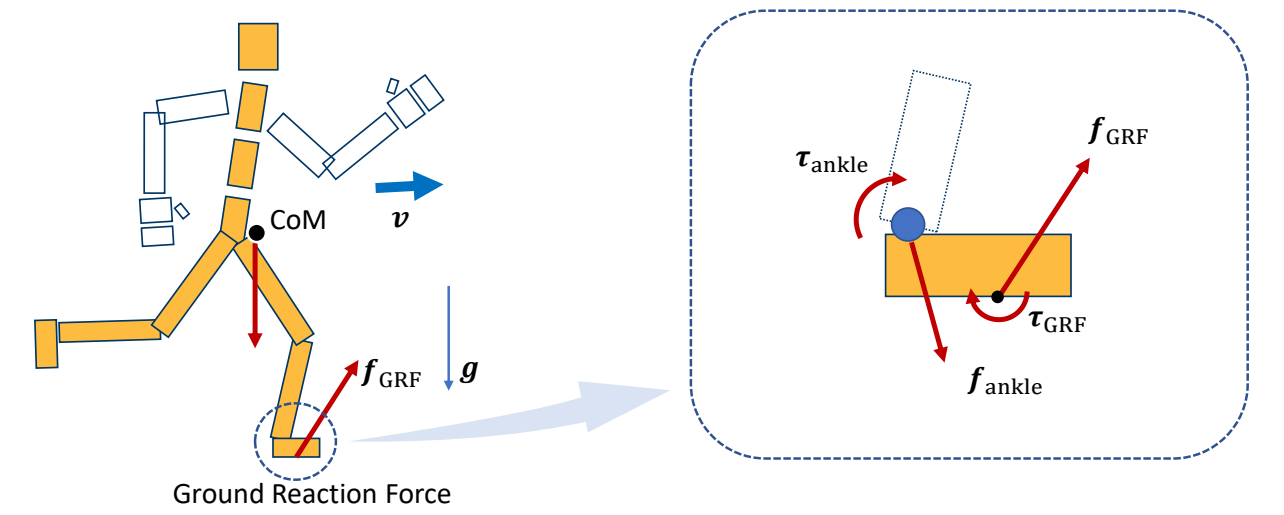

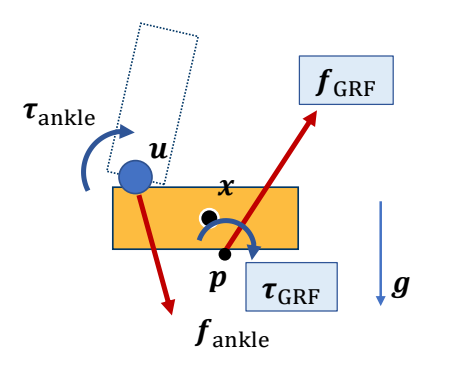

Physics-based/Dynamic Approaches

✅ 不直接生成姿态,而是控制量(例如力),通过物理仿真真正改变角色。

P59

Ragdoll Simulation

✅ 用于人死掉、失去意识、突发事件来不及响应的情况。

P63

物理仿真角色动画的应用

[DeepMotion: Virtual Reality Tracking]

[Ye et al. 2022: Neural3Points]

[Yang et al. 2022: Learning to Use Chopsticks]

✅ 抓住手指动作细节 P67

P68

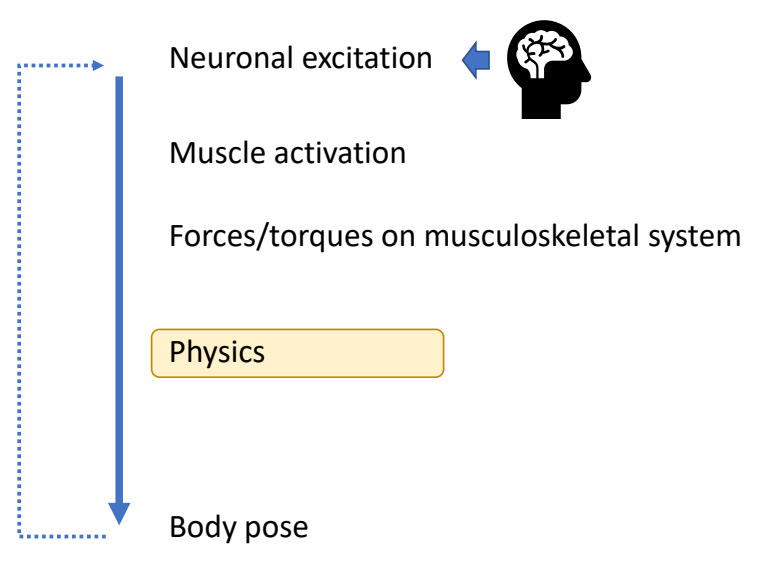

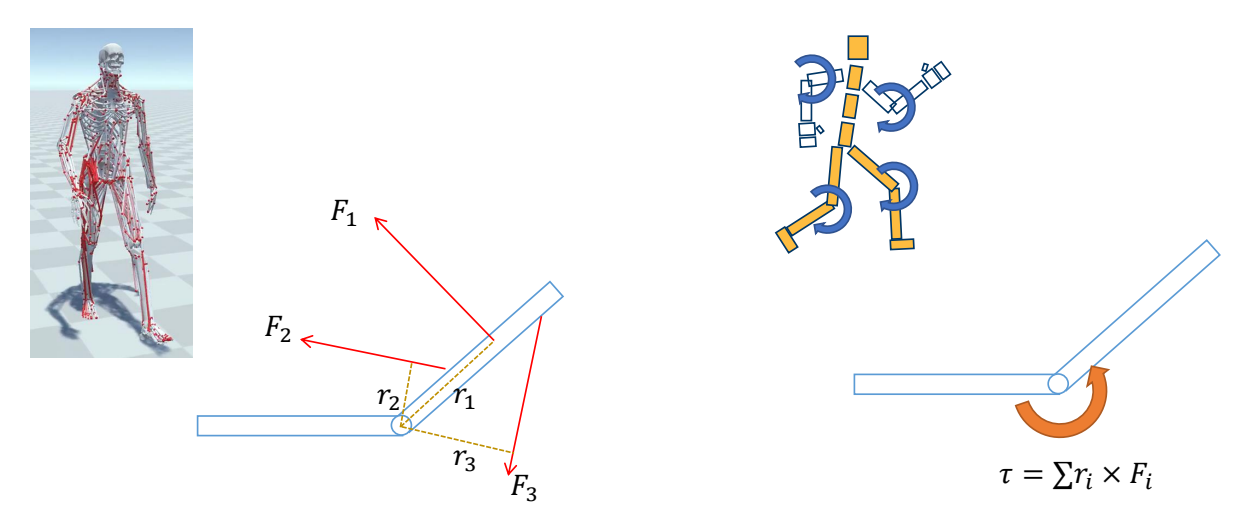

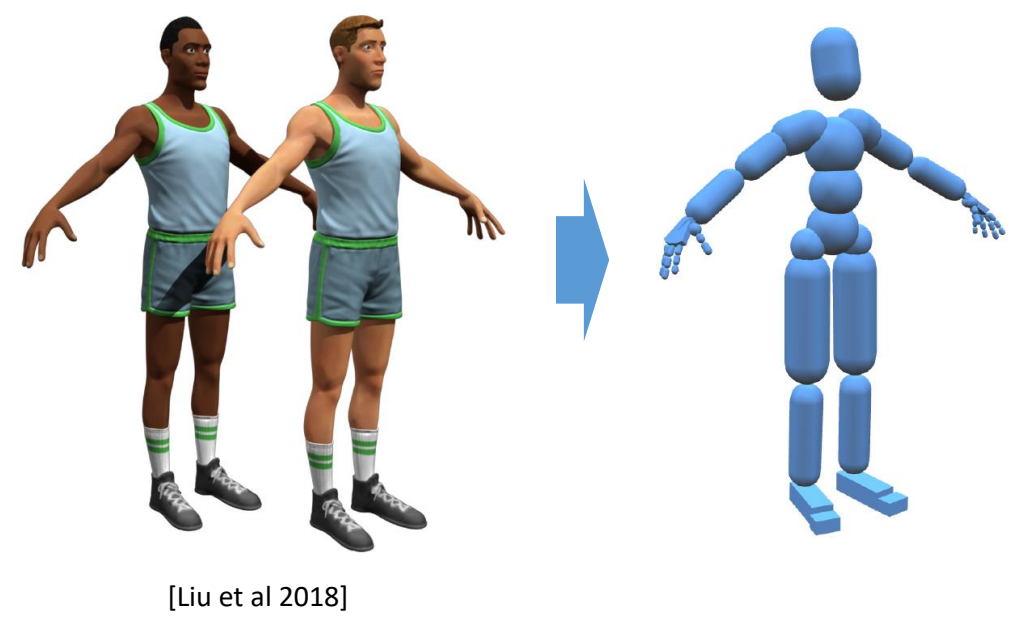

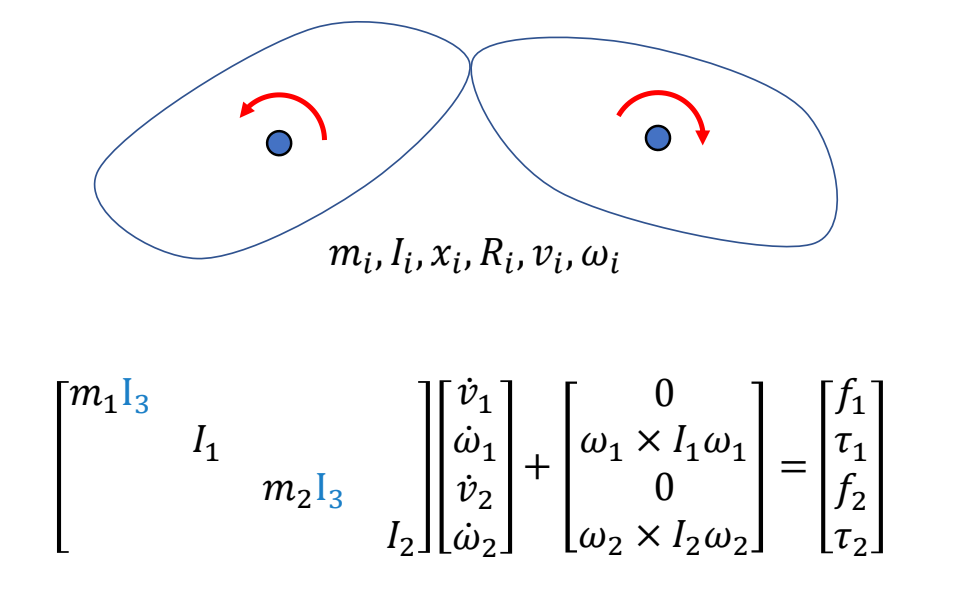

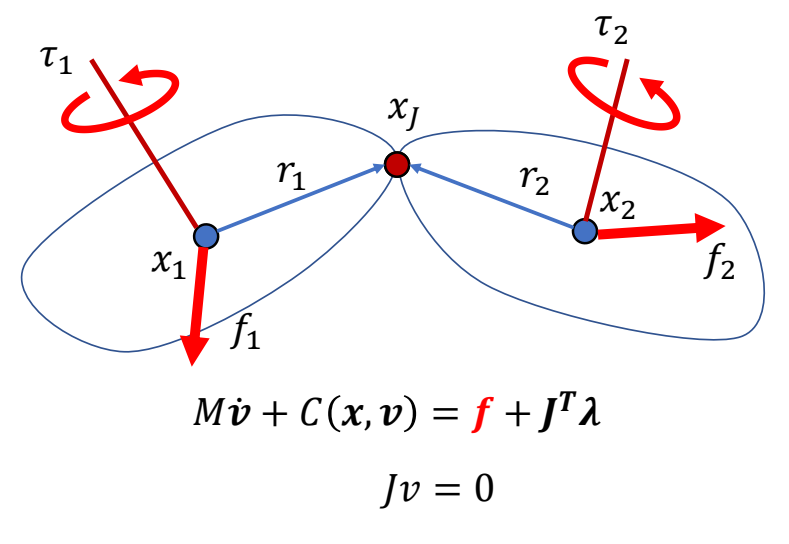

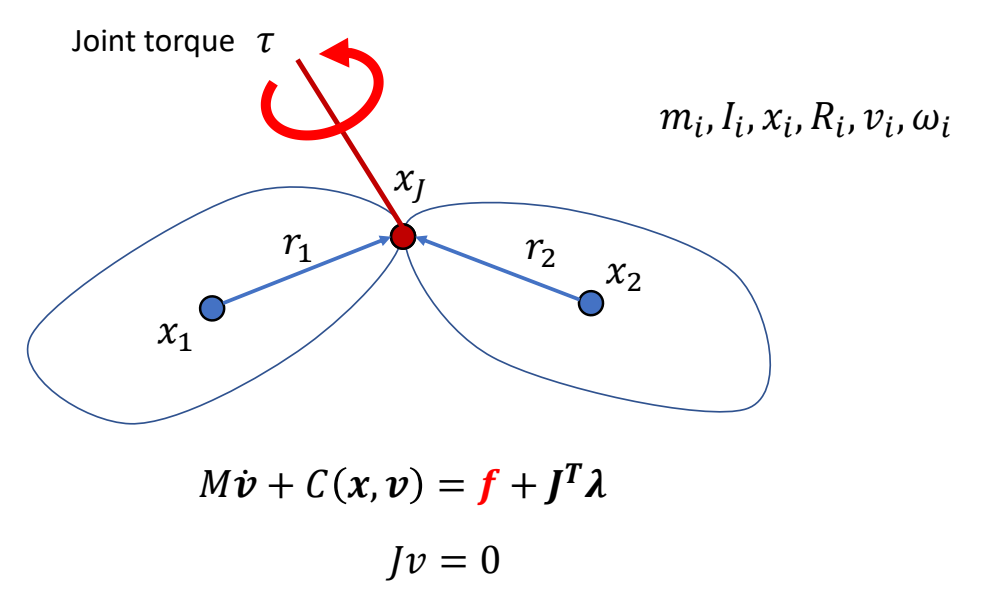

物理角色的建模方法

✅ 构建完整的神经系统和肌肉系统。

✅ (1)神经肌肉机理不清楚。

✅ (2)自由度高,仿真效率低。

✅ 所以实际上会做简化,对关节力矩进行建模

✅ 用关节力矩仿真肌肉的力。

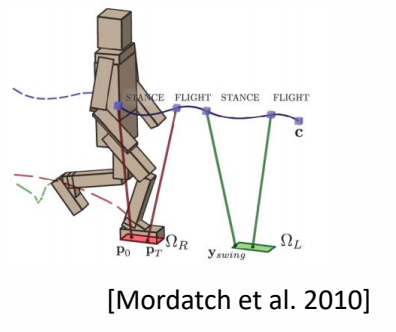

P70

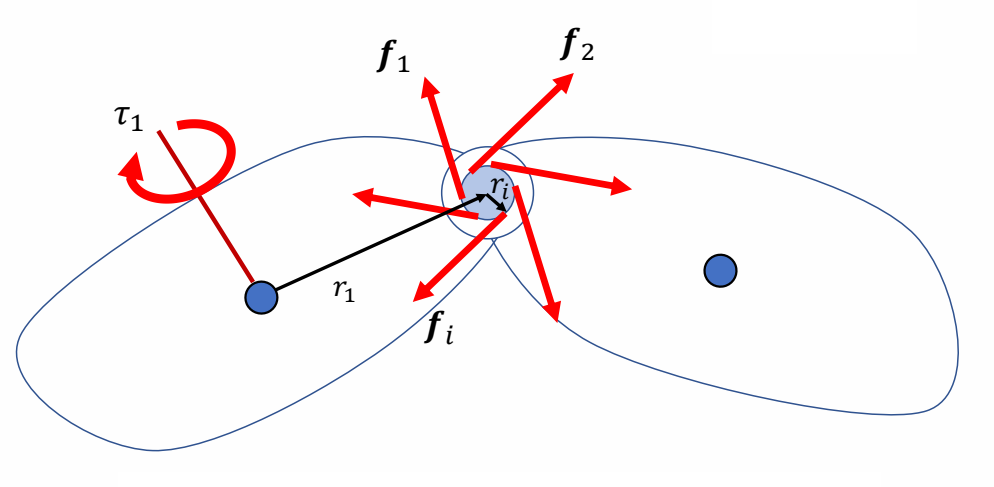

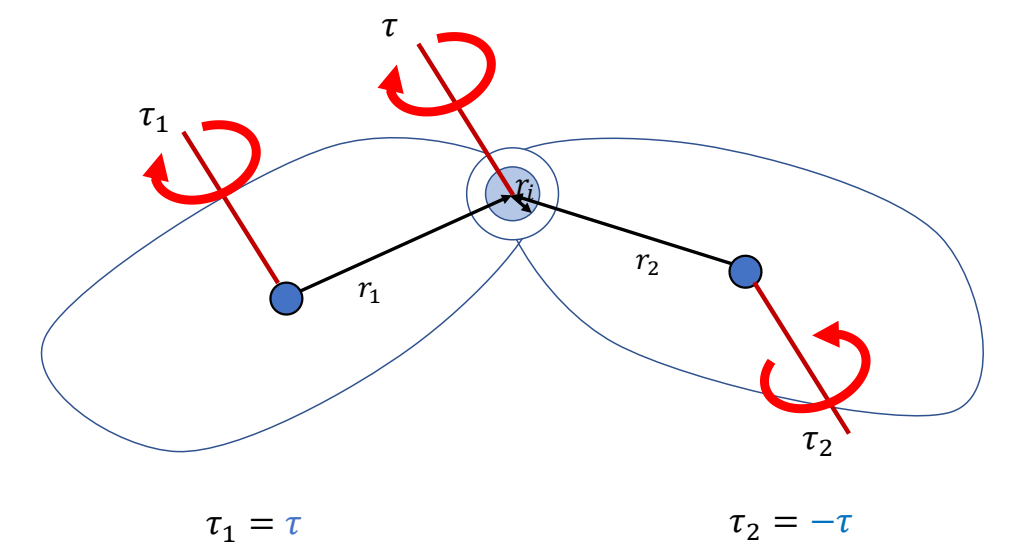

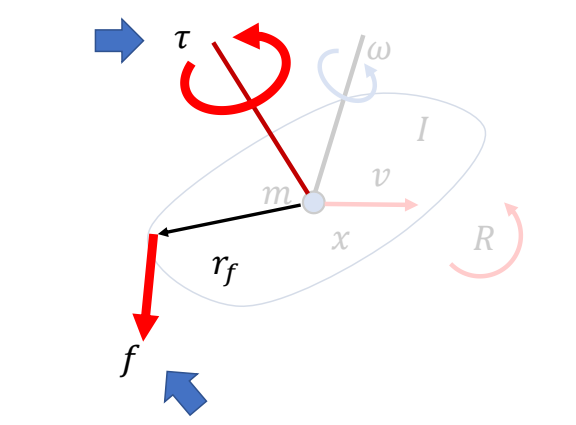

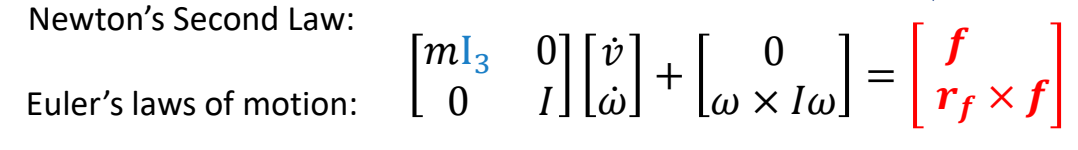

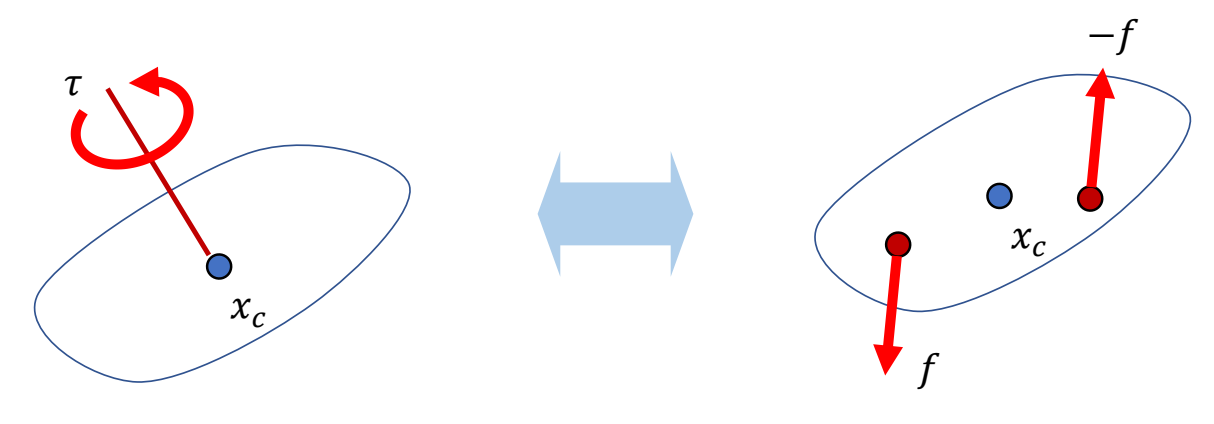

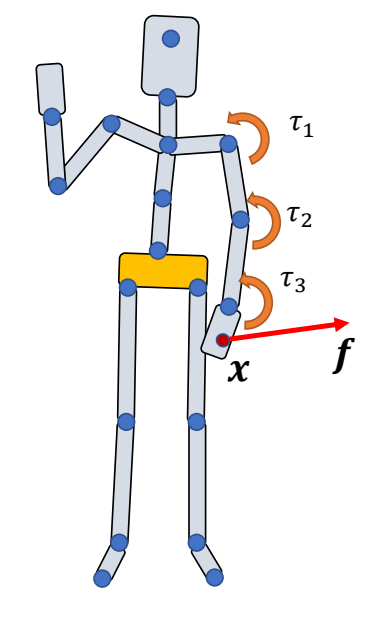

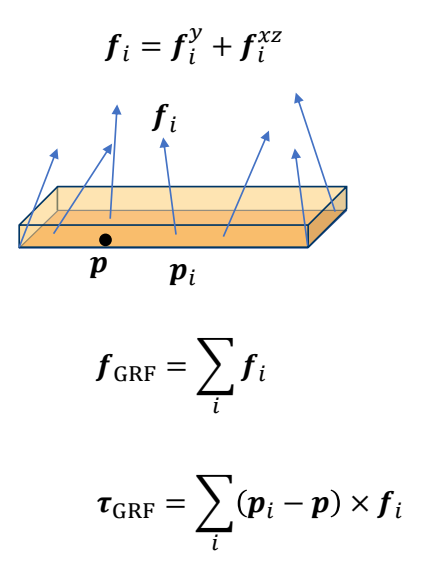

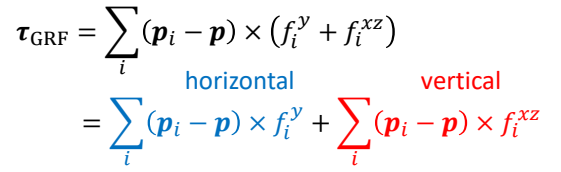

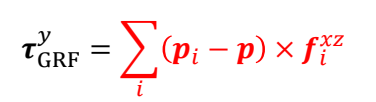

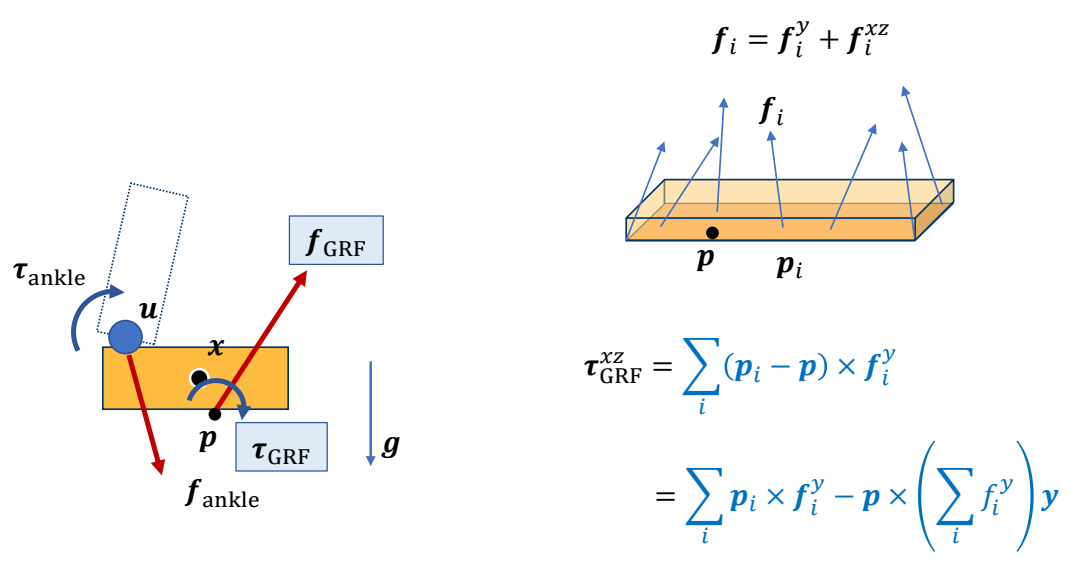

Force & Torque

P71

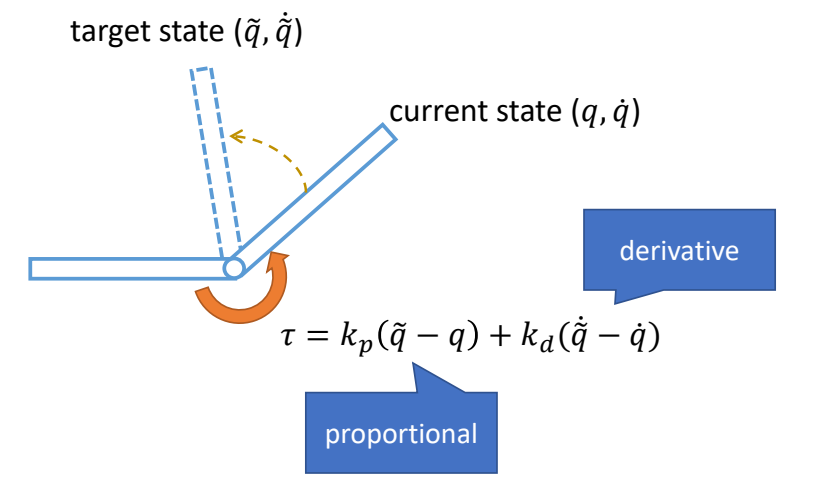

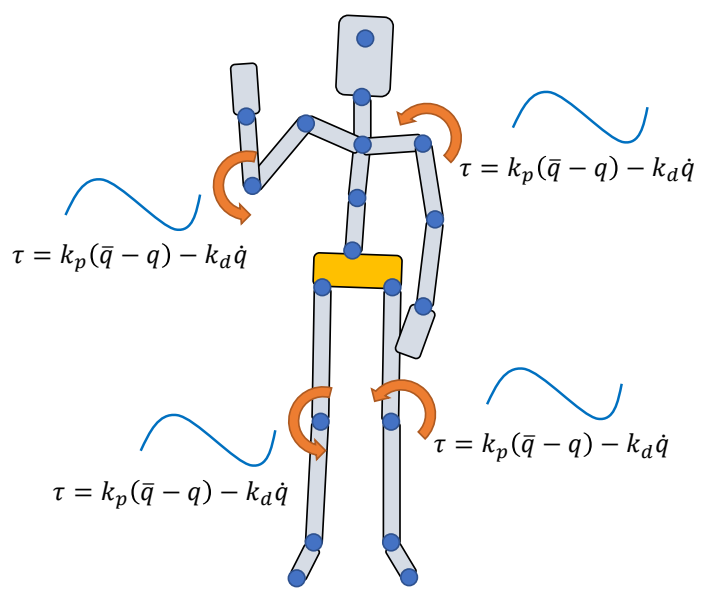

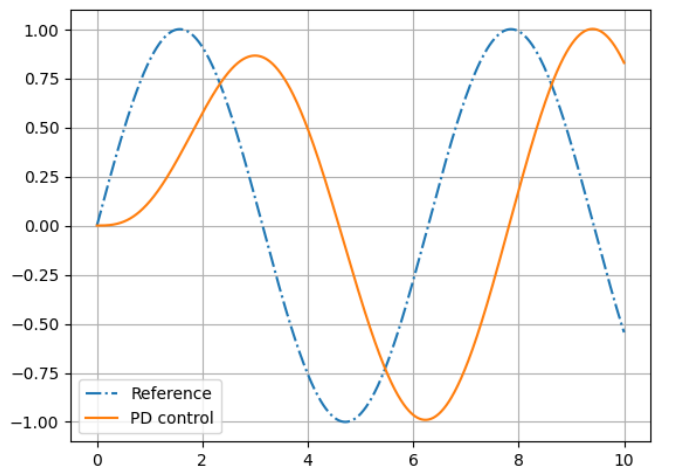

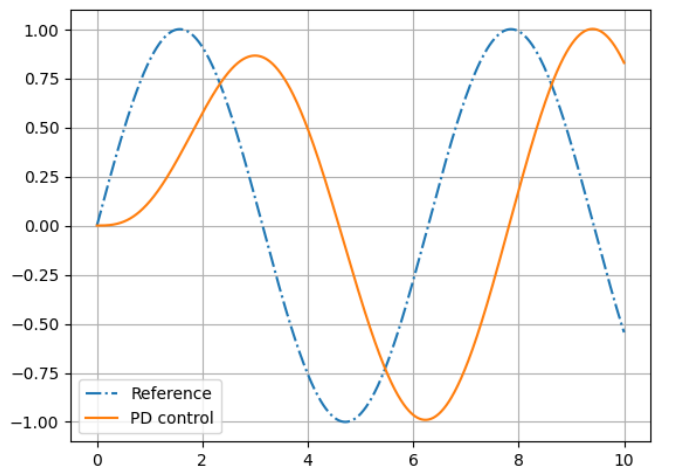

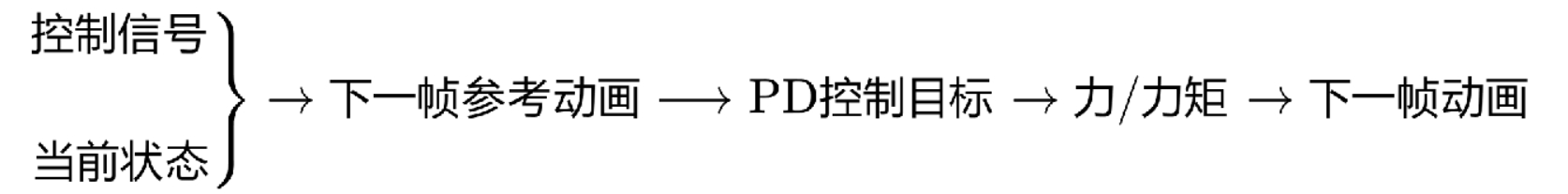

Keyfrmae Control

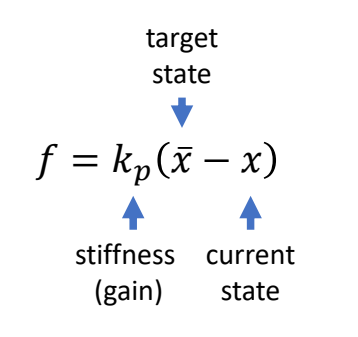

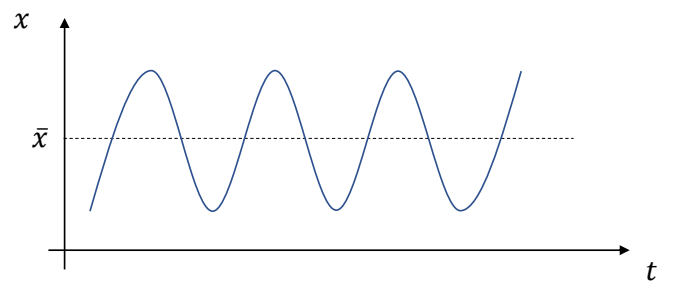

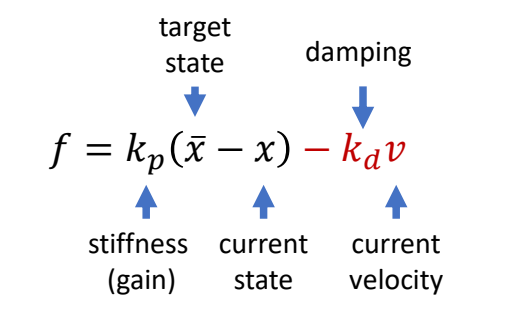

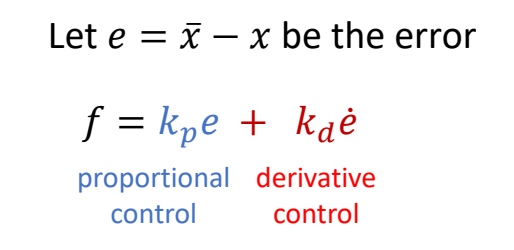

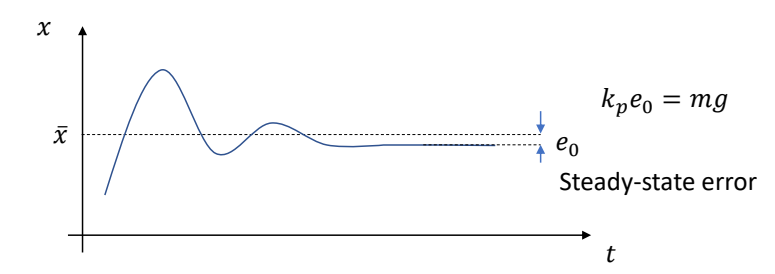

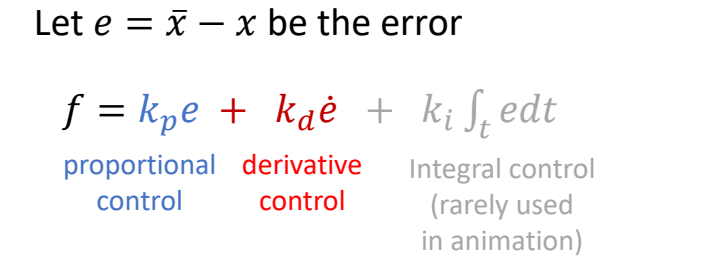

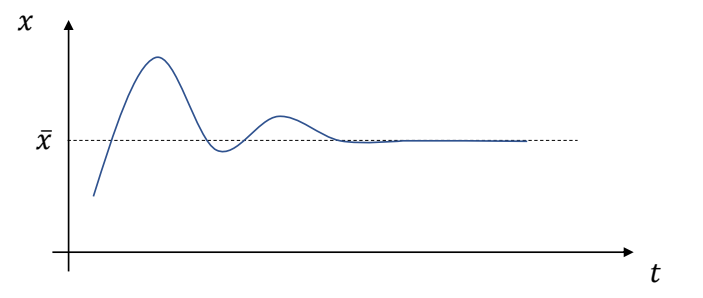

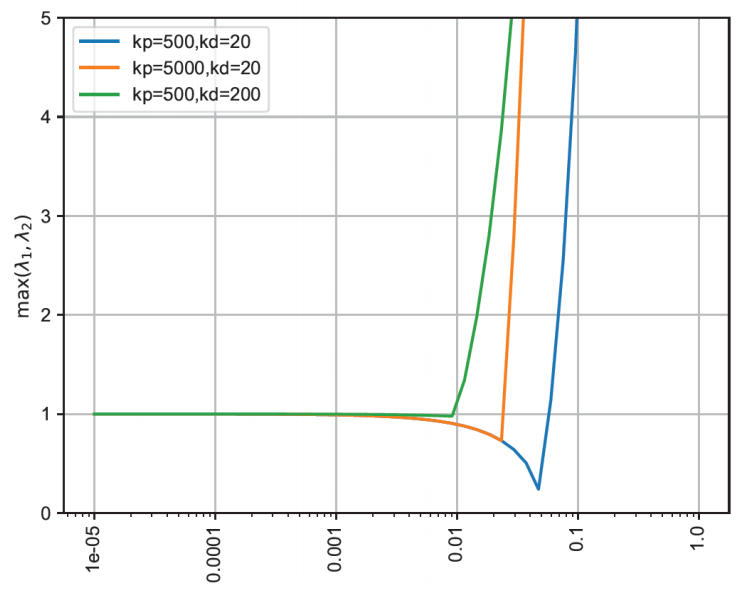

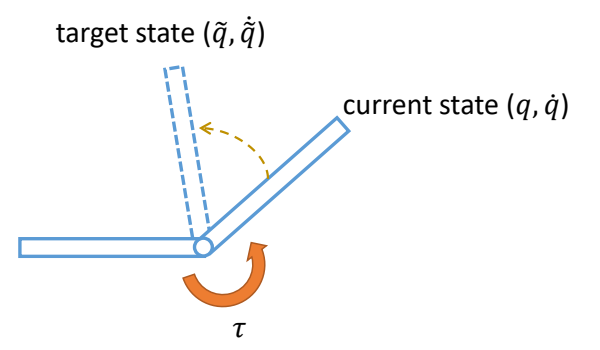

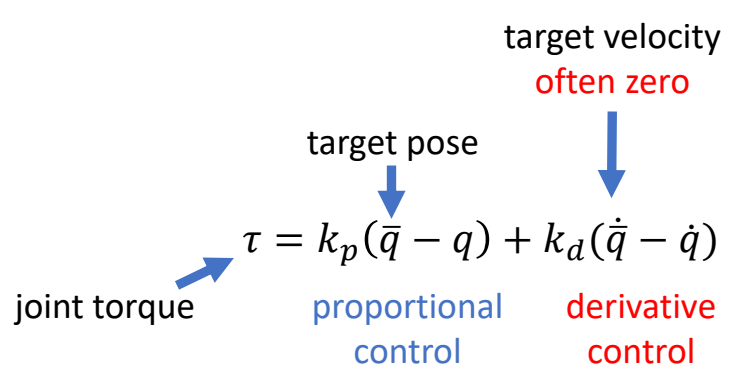

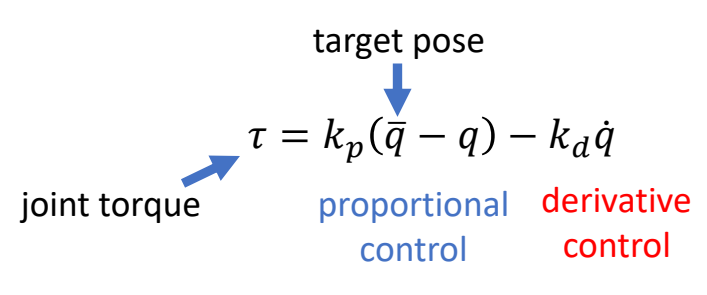

Proportional-Derivative (PD) Control

✅ 根据当前状态与目标状态的差距,计算出当前状态运动到目标状态所需要的力矩。

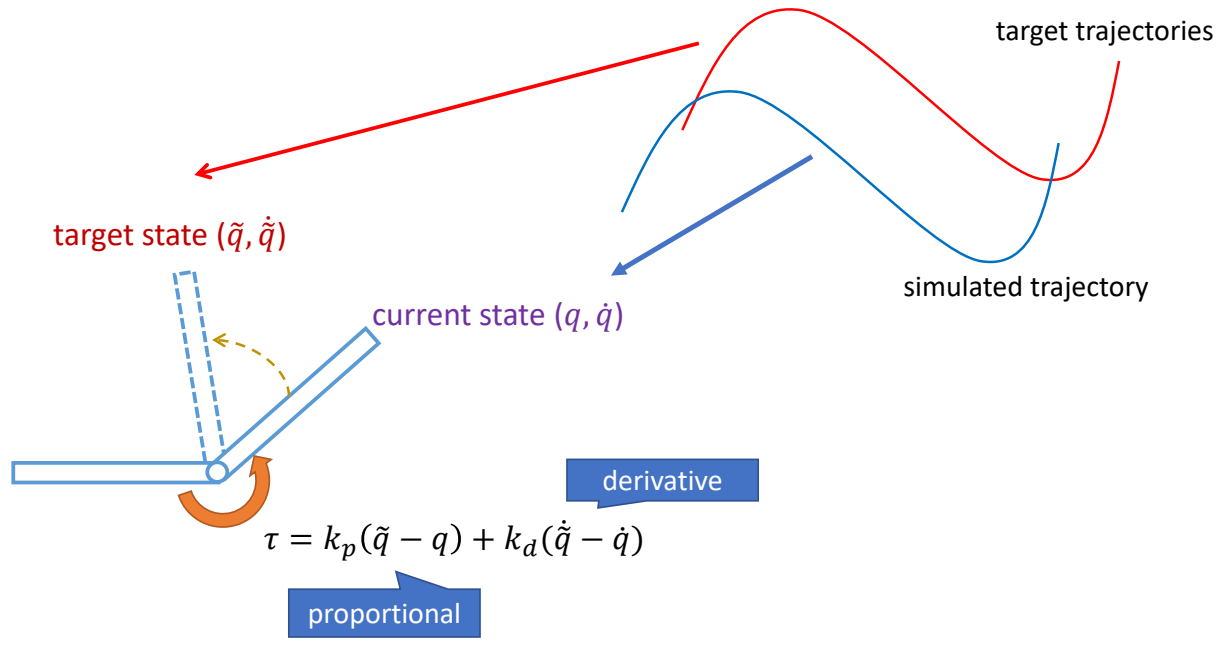

P72

Tracking Controllers

✅ 比如要做一个动作,给出目标高度的轨迹,采用PD控制生成每个关节的力矩,大概能产生要做的动作

[Hodgins and Wooten 1995, Animating Human Athletics]

P76

Trajectory Crafting

NaturalMotion - Endorphin

✅ 关键帧→力→仿真

实际上这个方法很难用起来,因为调整仿真参数甚至比直接做关键帧更花时间。

P79

Spacetime/Trajectory Optimization

✅ 用优化方法实现,结合重定向

[Liu et al 2010. SAMCON]

[Wampler and Popović. 2009. Optimal gait and form for animal locomotion]

[Hamalainen et al. 2020, Visualizing Movement Control Optimization Landscapes]

✅ 这是高维非线性优化问题,非常准解。

P83

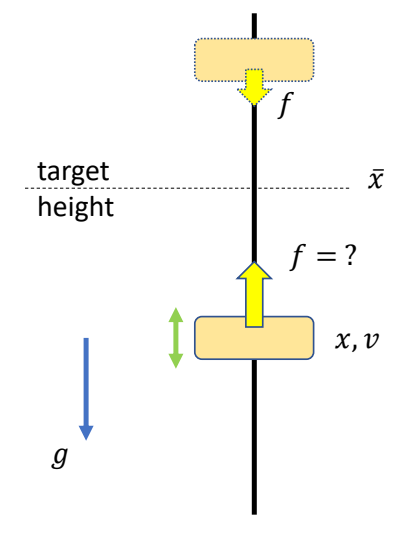

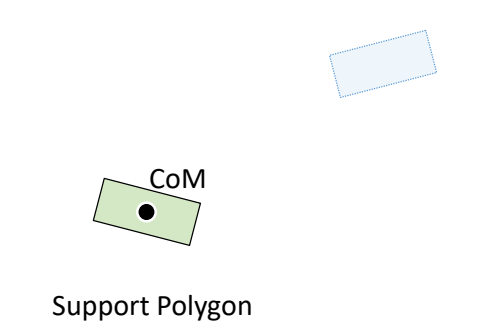

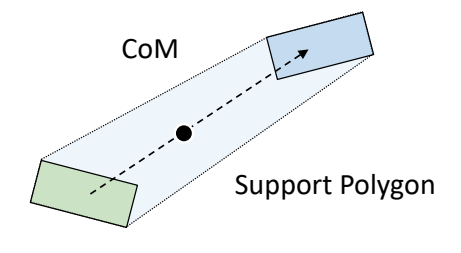

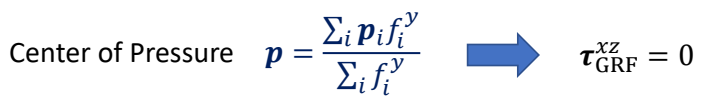

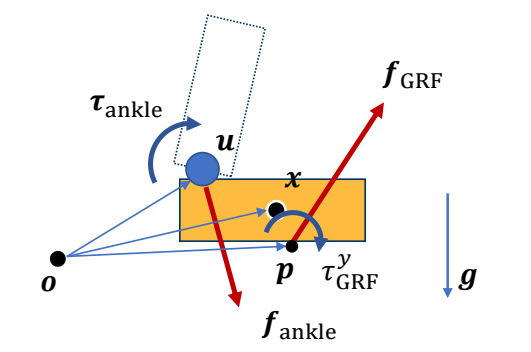

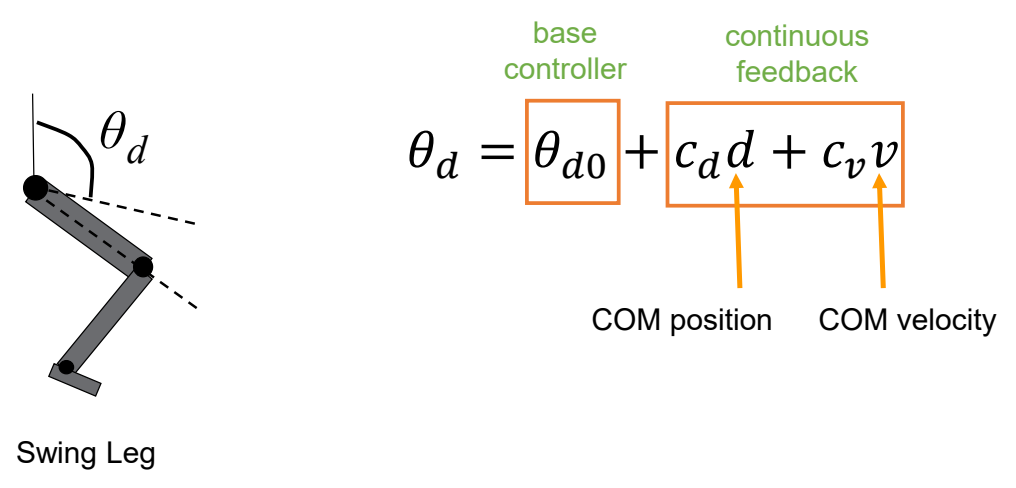

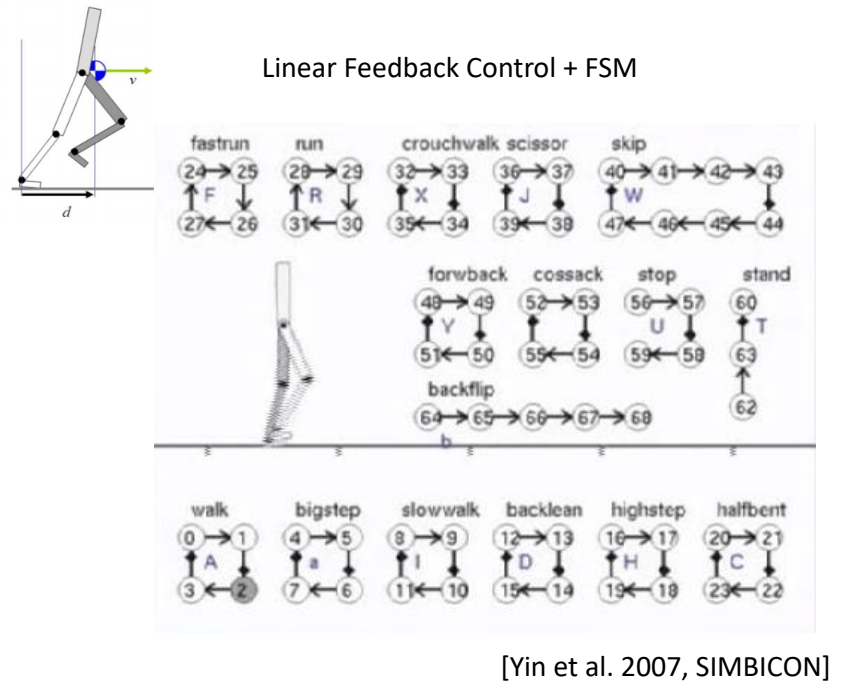

Abstract Models 简化模型

通过简化模型实现对一些动作的控制,但只能做简单动作

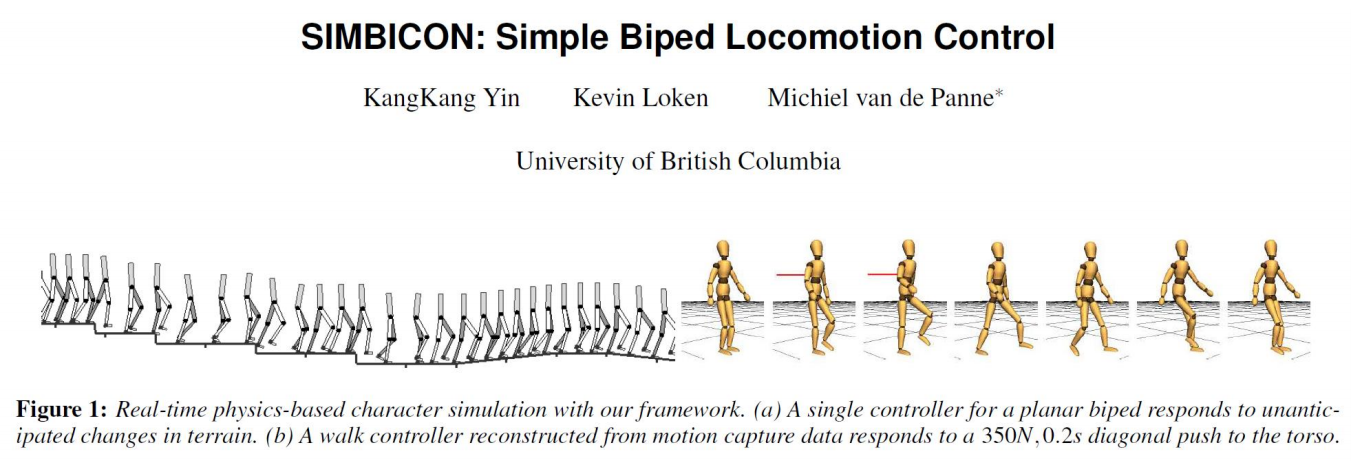

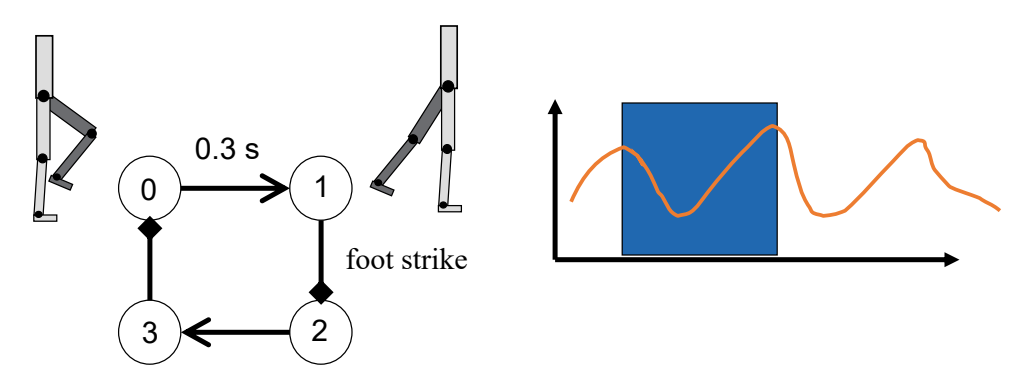

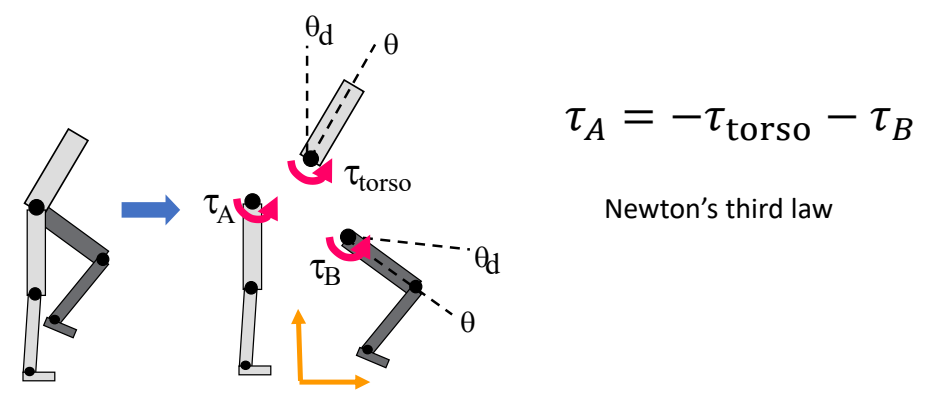

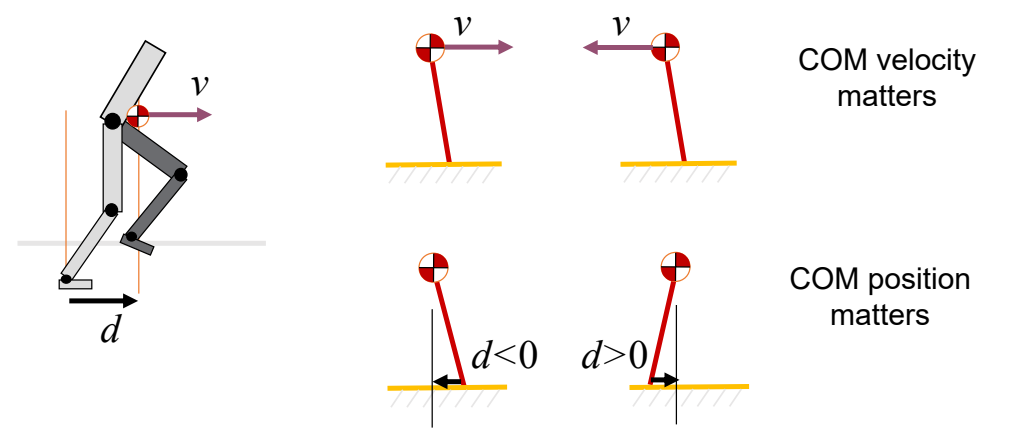

SIMBICON

✅ 用简化模型把想要的动作描述出来,来指导角色控制。

✅ 基于此实现稳定的多技能的控制策略。

✅ 控制简化、缺少细节,走路像机器人。

✅ 简化模型思路,可以实现对一些动作进行控制,且结果鲁棒,允许使用外力与角色交互。

✅ 缺点:只能走路,不能复杂动作。

P85

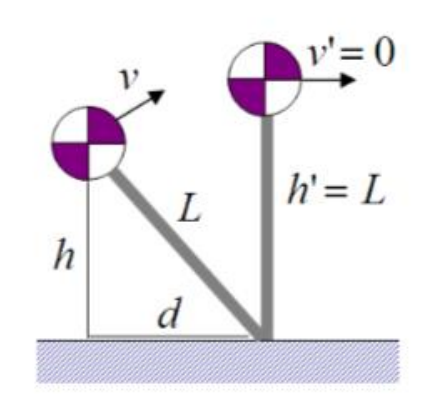

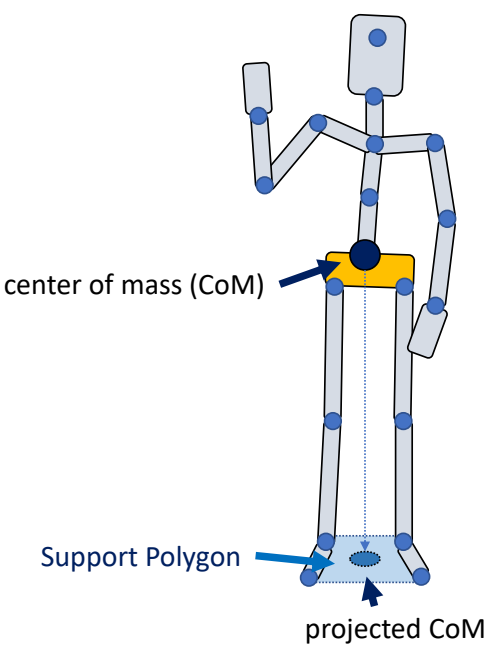

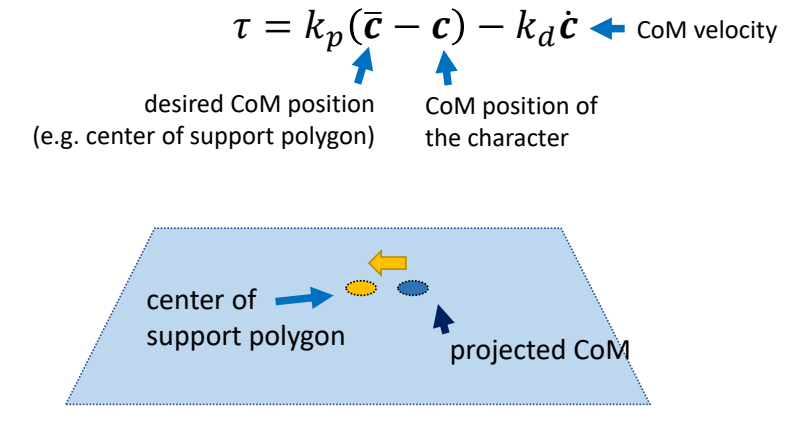

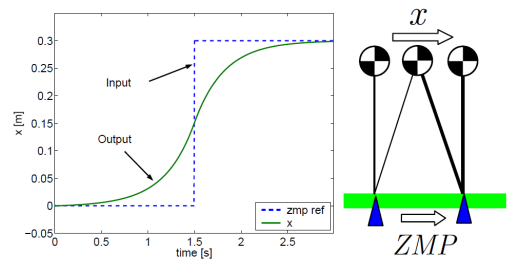

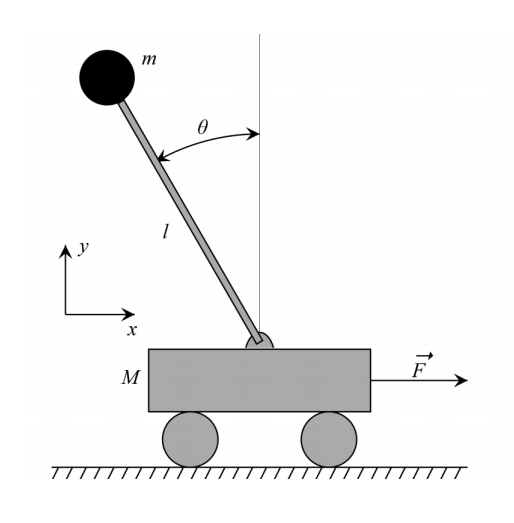

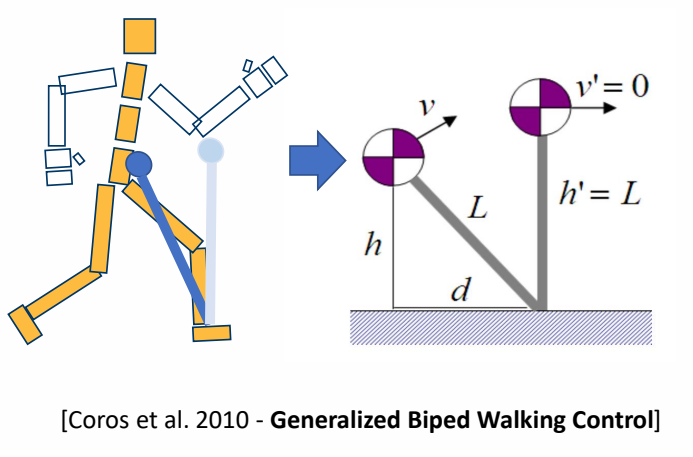

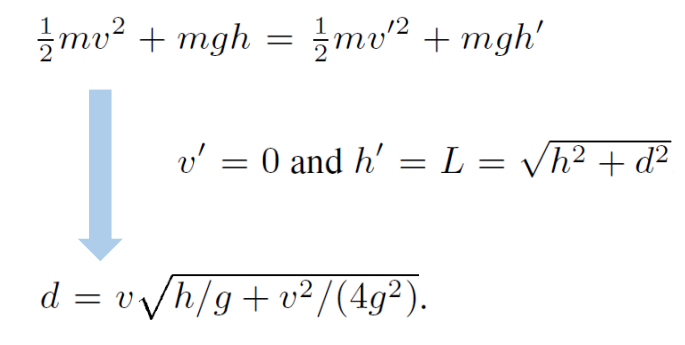

Inverted Pendulum Model

[Coros et al. 2010]

P87

Reinforcement Learning

P89

DRL-based Tracking Controllers

[Liu et al. 2016. ControlGraphs]

[Liu et al. 2018]

[Peng et al. 2018. DeepMimic]

✅ 利用DRL做复杂动作,但还只是动作复现。

P90

Multi-skill Characters

引入状态机,完成更复杂动作。

State Machines of Tracking Controllers

引入Motion Maching

[Liu et al. 2017: Learning to Schedule Control Fragments]

Hierarchical Controllers

在高级指令控制下,综合使用动作来完成功能

Generative Control Policies

| 运动生成模型 | 控制生成模型 |

|---|---|

|  |

总结

✅ 回顾计算机角色动化领域最近30年主要研究方向。

P102

About This Course

-

What will not be covered

- How to use Maya/Motion Builder/Houdini/Unity/Unreal Engine…

- How to become an animator

-

What will be covered

-

Methods, theories, and techniques behind animation tools

- Kinematics of characters

- Physics-based simulation

- Motion control

-

Ability to create an interactive character

-

本文出自CaterpillarStudyGroup,转载请注明出处。

https://caterpillarstudygroup.github.io/GAMES105_mdbook/

P2

Outline

-

Review of Linear Algebra

- Vector and Matrix

- Translation, Rotation, and Transformation

-

Representations of 3D rotation

- Rotation matrices

- Euler angles

- Rotation vectors/Axis angles

- Quaternions

✅ 这节课大部分内容会跳过,因为前面课程讲过好多遍了

P3

Review of Linear Algebra

Vectors and Matrices

a few slides were modified from GAMES-101 and GAMES-103

P24

✅ 两个单位向量的叉乘不一定是单位向量。

✅ 要得到方向,应先叉乘再单位化

✅ \(n=\frac{a\times b}{||a\times b||}\)(正确)、\(n=\frac{a}{||a||} \times \frac{b}{||b||}\)(错误)

P26

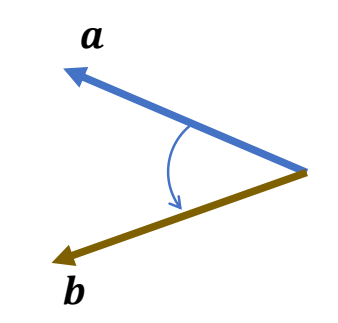

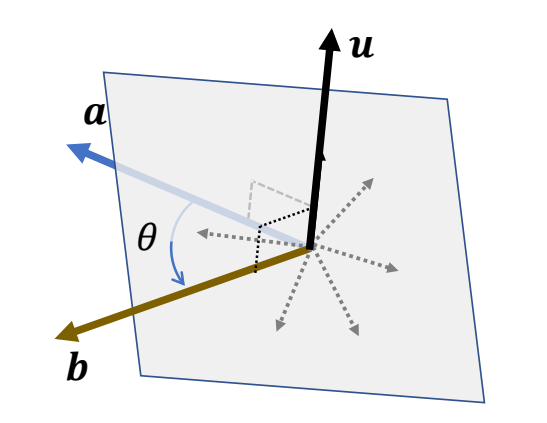

How to find the rotation between vectors?

问题描述

✅ 已知\(a,b\) , 求旋转。

求旋转轴

P27

Any vector in the bisecting plane can be the axis

$$ 𝒖 =\frac{𝒂 × 𝒃}{||𝒂 × 𝒃||} $$

求旋转角

P28

The minimum rotation:

$$

\theta = \mathrm{arg} \cos \frac{a\cdot b}{||a||||b||}

$$

✅ \(u\) 为旋转轴,\( \theta \) 为旋转角。

P33

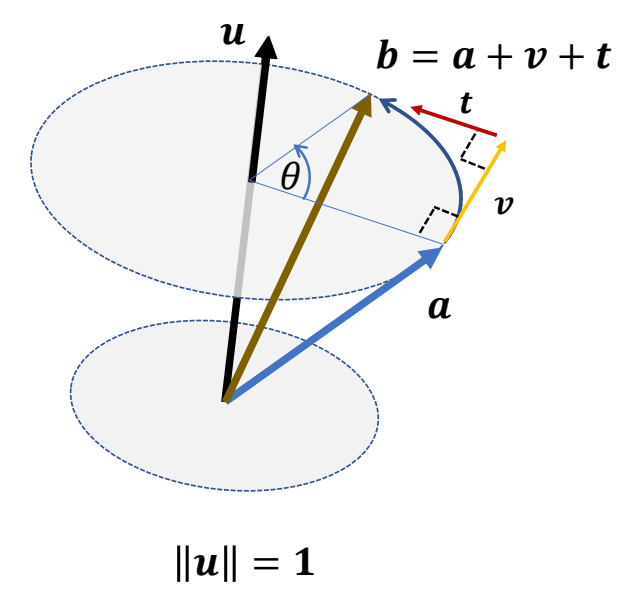

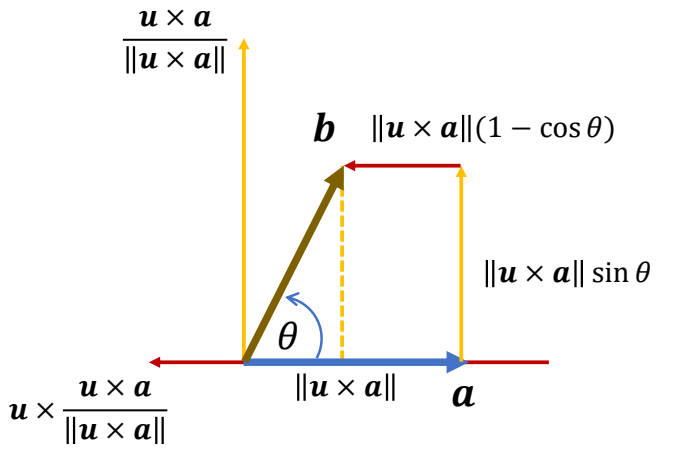

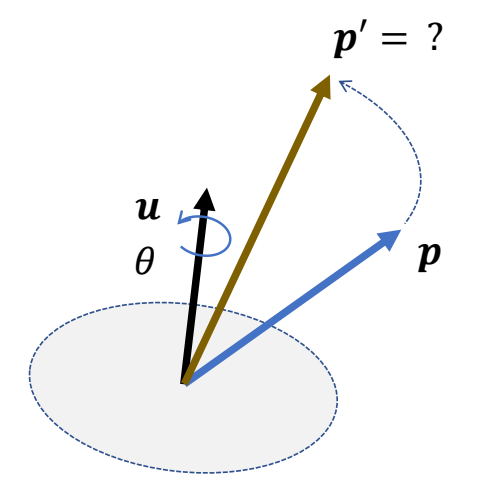

How to rotate a vectors?

问题描述

已知 \(a\) 和旋转 \((𝒖, \theta )\) 求终点 \(b\)

解题方法

\(a\) 移动到 \(b\) 看作是先移动 \(𝒗\) 再移动 \(t\),分别计算 \(𝒗\) 和 \(t\) 的方向和长度。

$$ 𝒗 \gets 𝒖 \times 𝒂 $$

$$ 𝒕 \gets 𝒖 \times 𝒗 = 𝒖 \times( 𝒖 \times 𝒂) $$

计算过程

P35

$$ 𝒗 = (\sin \theta) 𝒖 \times 𝒂 𝒕 =(1-\cos \theta ) 𝒖 \times( 𝒖 \times 𝒂) $$

Rodrigues' rotation formula

$$ 𝒃 = 𝒂 + (\sin \theta) 𝒖 × 𝒂 + (1-\cos \theta ) 𝒖 \times( 𝒖 \times 𝒂) $$

P53

Matrix

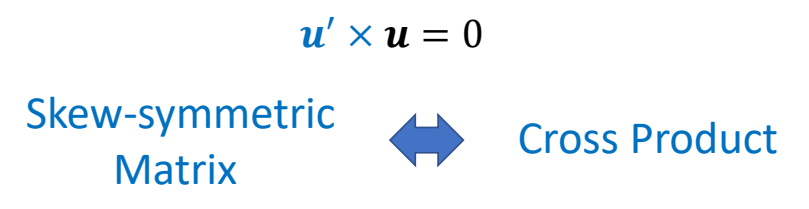

Matrix Form of Cross Product

$$ \begin{align*} c=a\times b= & \begin{bmatrix} a_yb_z-a_zb_y \\ a_zb_x-a_xb_z \\ a_xb_y-a_yb_x \end{bmatrix}\\ = & \begin{bmatrix} 0 & -a_z & a_y \\ a_z & 0 & -a_x \\ -a_y & a_x & 0 \end{bmatrix}\begin{bmatrix} b_x \\ b_y \\ b_z \end{bmatrix}=[a]_\times b \end{align*} $$

$$ [a]_\times +[a]^ \mathbf{T} _\times =0 \quad \quad \mathrm{skewsymmetric} $$

P56

$$ \begin{align*} a \times b = &[a] _ \times b \\ a \times (b \times c) = & [a] _ \times ( [b] _ \times c ) \\ = & [a] _ \times [b] _ \times c \\ a \times (a \times c) = & [a] ^2 _ \times b \\ (a \times b) \times c = & [a\times b] _ \times c \\ \end{align*} $$

✅ 最后一个公式注意一下,叉乘不满足结合律。

P57

How to rotate a vectors?

问题描述

已知 \(a\) 和旋转 \((𝒖, \theta )\) 求终点 \(b\)

把前面的结论转化为矩阵形式

$$ \begin{align*} b = & a+(\sin \theta )u \times a +(1-\cos \theta)u \times(u \times a) \\ b = & (I+(\sin \theta ))[u]_ \times + (1-(\cos \theta )[u]^2_ \times ) a \\ = & Ra \end{align*} $$

✅ 把前面的叉乘公式转化为点乘形式

结论

Rodrigues' rotation formula

$$ R = I+(\sin \theta )[u]_ \times + (1-\cos \theta )[u]^2_ \times $$

✅ \(R\) 是旋转 \((u, \theta )\) 对应的旋转矩阵。

P62

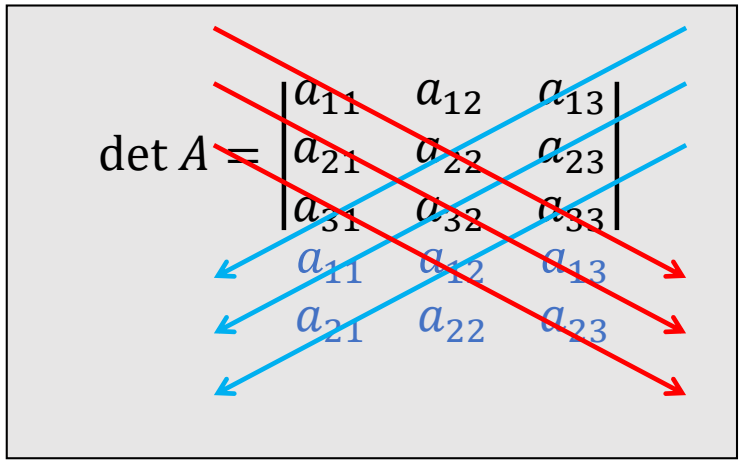

Determinant of a Matrix

定义

✅ 行列式的计算:红色相乘减蓝色相乘。

P63

公式

- det \(I = 1\)

- det \(AB = \text{ det } A ∗ \text{det } B\)

- det \(A^T\) = det \(A\)

- If \(A\) is invertible,det \(A^{−1}\) = \((\text{det } A)^{−1}\)

- If \(U\) is orthogonal,\(\text{det } U = ± 1\)

P64

Cross Product as a Determinant

$$ \begin{align*} c=a\times b= & \begin{bmatrix} a_yb_z-a_zb_y \\ a_zb_x-a_xb_z \\ a_xb_y-a_yb_x \end{bmatrix}\\ = & \text{det } \begin{bmatrix} i & j & k \\ a_x & a_y & a_z \\ b_x & b_y & b_z \end{bmatrix} \end{align*} $$

✅ 用行列式运算规则来计算叉乘结果。

P66

Eigenvalues and Eigenvectors

For a matrix \(A\), if a nonzero vector \(x\) satisfies

$$

Ax=\lambda x

$$

Then:

\(\lambda\): an eigenvalue of \(A\)

\(x\): an eigenvector of \(A\)

Especially, a \(3\times 3\) orthogonal matrix \(U\)

has at least one real eigenvalue: \(\lambda=\text{det } U = ±1\)

P67

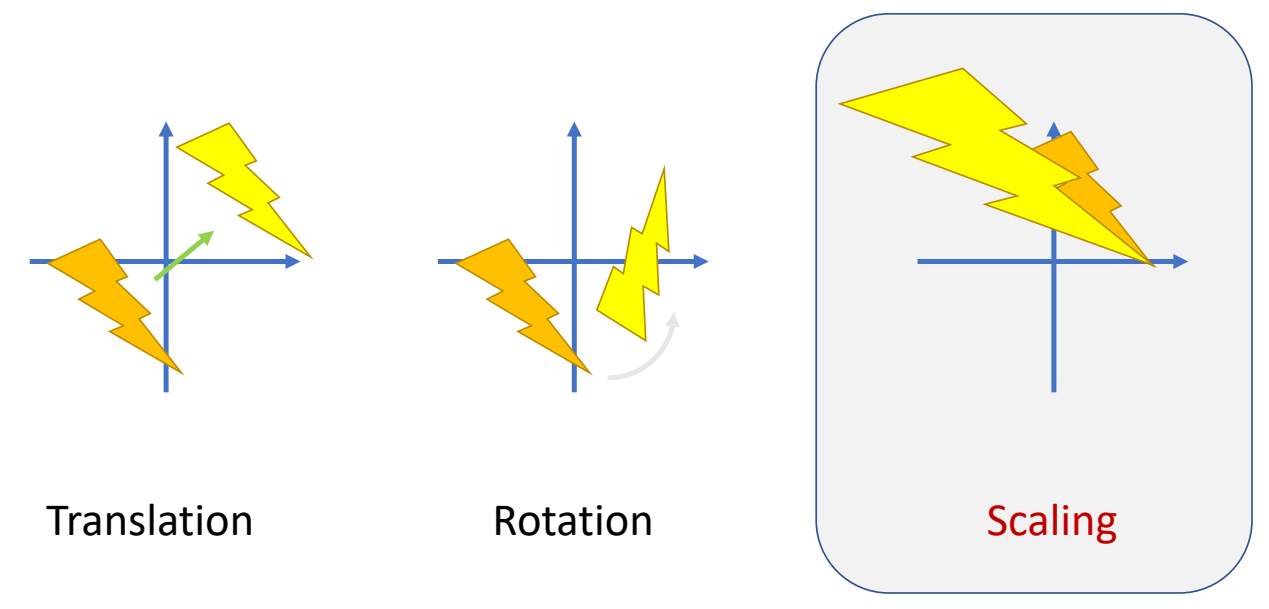

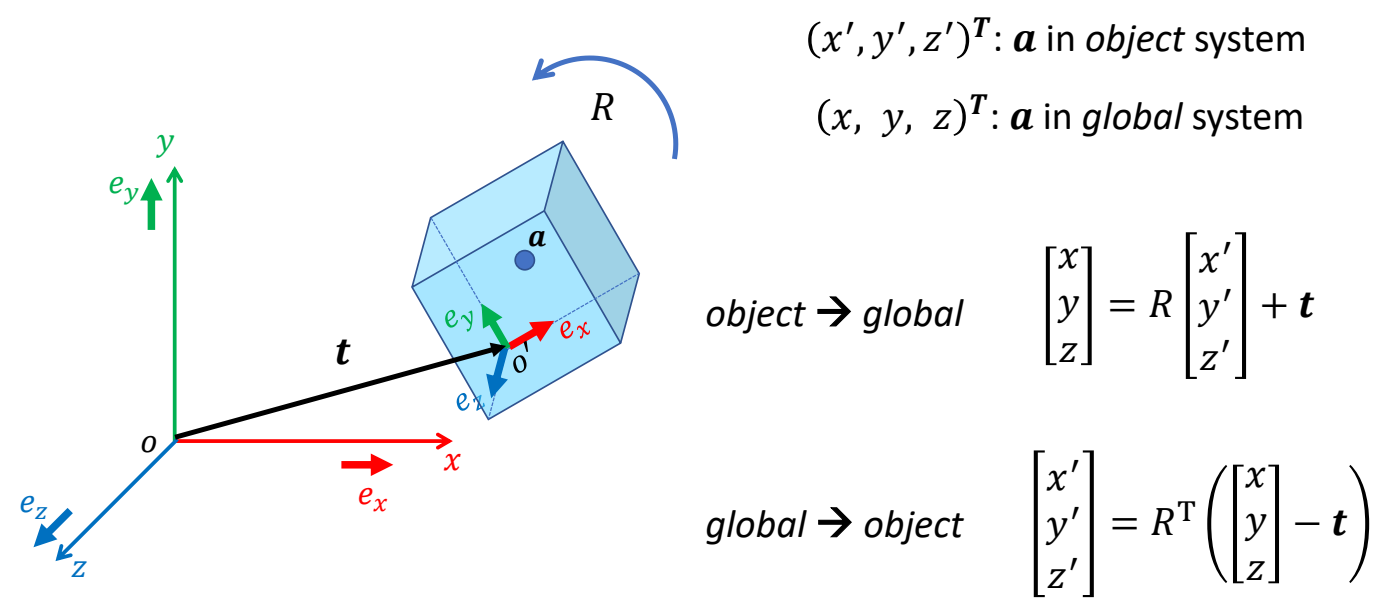

Rigid Transformation

Translation, rotation, and coordinate transformation

✅ 刚体变换不能改变形状和大小,因此没有Scaling

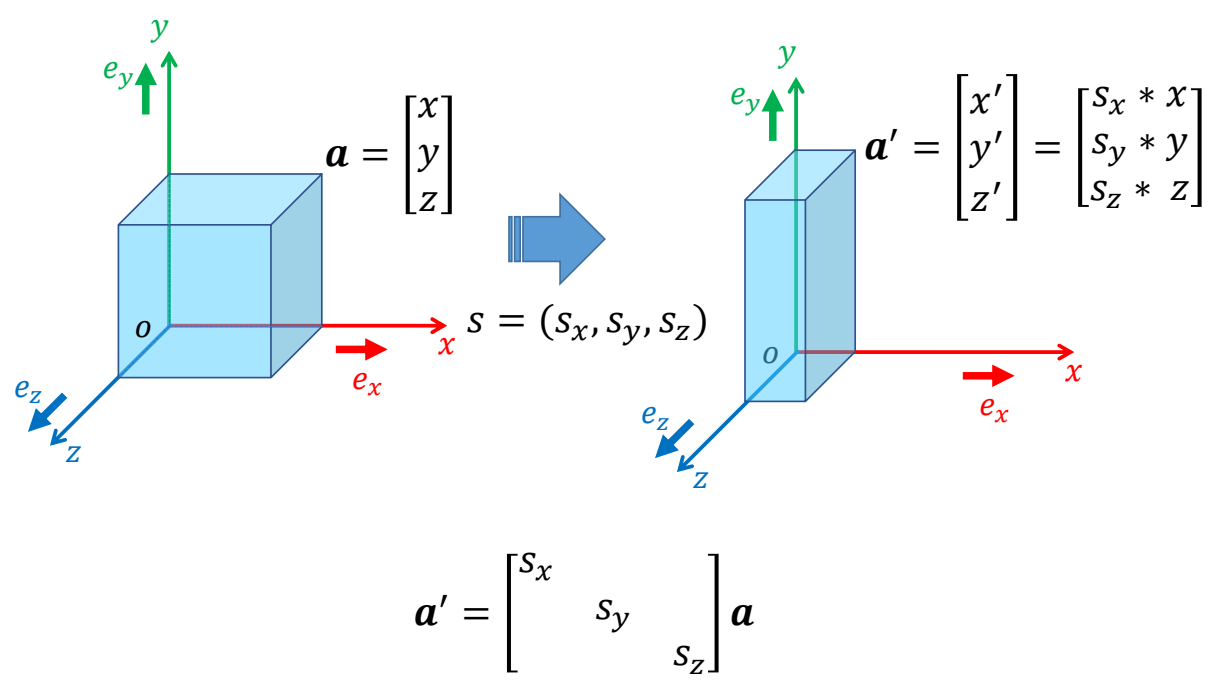

P69

Scaling

P70

Translation

P72

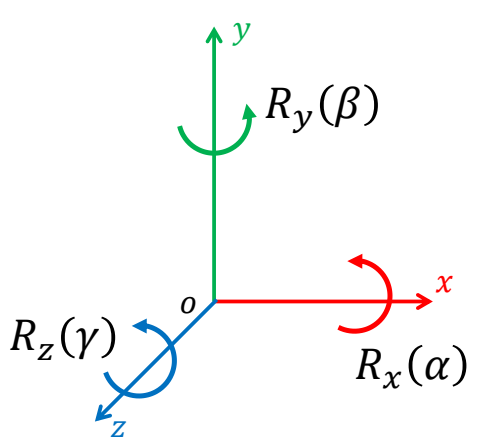

Rotation

P73

Rotation Matrix

定义

- Rotation matrix is orthogonal:

$$ R^{-1}=R^{T} \quad R^TR=RR^T=1 $$

- Determinant of \(R\)

$$ \text{det } R = + 1 $$ - Rotation maintains length of vectors $$ ||Rx|| = ||x|| $$

✅ 公式2:\(R\) 不会改变左、右手系

✅ 公式3:\(R\) 是刚性变换,不改变大小

P75

Combination of Rotations

P76

Rotation around Coordinate Axes

$$ R_x(\alpha )=\begin{pmatrix} 1 & 0 & 0 \\ 0 & \cos\alpha & -\sin \alpha \\ 0 & \sin \alpha & \cos \alpha \end{pmatrix} $$

$$ R_y(\beta )=\begin{pmatrix} \cos \beta & 0 & \sin \beta \\ 0 & 1 & 0 \\ -\sin \beta & 0 & \cos \beta \end{pmatrix} $$

$$ R_z(\gamma )=\begin{pmatrix} \cos \gamma & -\sin \gamma & 0 \\ \sin \gamma & \cos \gamma & 0 \\ 0 & 0 & 1 \end{pmatrix} $$

✅ 沿着哪个轴转,那个轴上的坐标不会改变。

✅ 三个基本旋转可以组合出复杂旋转。

P79

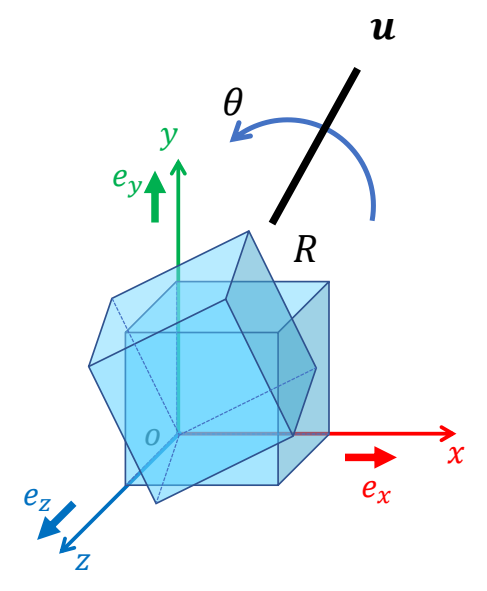

Rotation Axis and Angle

Rotation matrix \(R\) has a real eigenvalue: +1

$$

Ru=u

$$

In other words, \(R\) can be considered as a rotation around axis \(u\) by some angle \(\theta \)

How to find axis 𝒖 and angle \(\theta \)?

✅ 用 \(R\) 旋转时,向量 \(u\) 不会变化。

✅ 对于任意 \(R\),都存在这样一个 \(u\).

✅ \(u\) 是 \(R\) 的旋转轴。

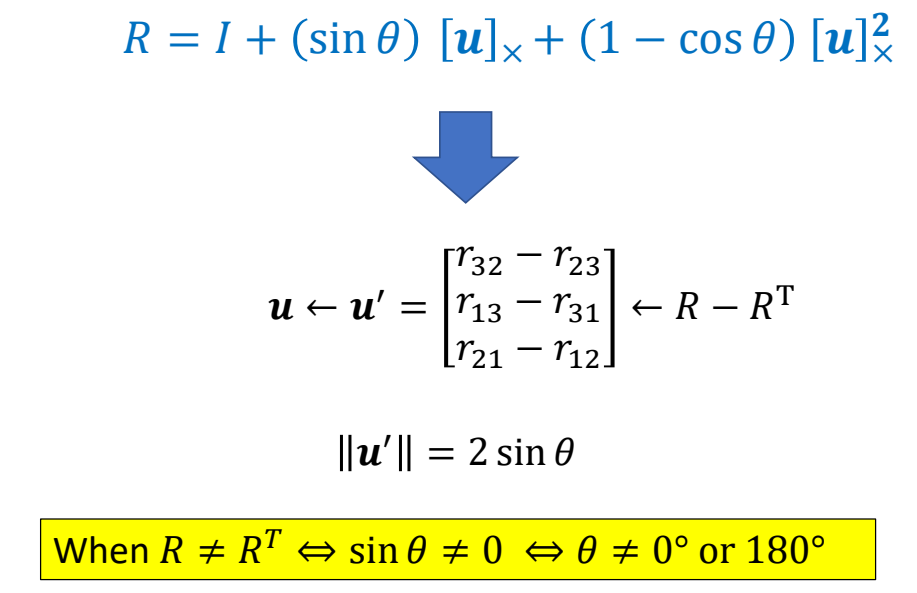

P80

根据旋转矩阵求轴角

P81

✅ \({u}' \) 与 \({u} \) 共线,\({u}' \) 单位化得到 \({u} \).

✅ \(q\) 和 \(-q\) 两种表示方法会引入插值问题,需要注意。

P82

$$ u\gets {u}' =\begin{bmatrix} r_{32}-r_{23} \\ r_{13}-r_{31} \\ r_{21}-r_{12} \end{bmatrix} $$

$$ \text{When } R\ne R^T \Leftrightarrow \sin \theta \ne 0\Leftrightarrow \theta \ne 0^{\circ} \text{ or } 180^{\circ} $$

P83

基于罗德里格公式求轴角

✅ 从 \(R\) 的公式也能得出相同的结论

✅ \(u → {u}' → \)旋转角度

P85

旋转矩阵的意义

旋转

P86

旋转 + 平移

P87

Representations of 3D Rotation

P91

旋转矩阵

Parameterization of Rotation

旋转矩阵有9个参数,但实际上degrees of freedom (DoF) = 3

✅ det 只是把空间减少一半,没有降低自由度

P93

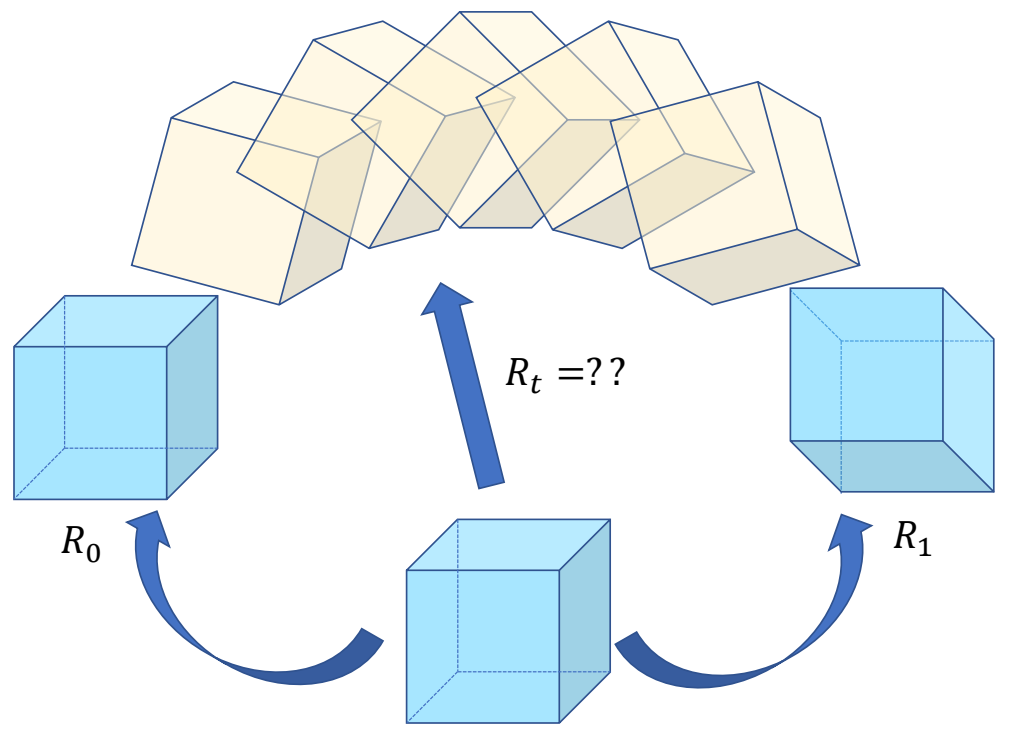

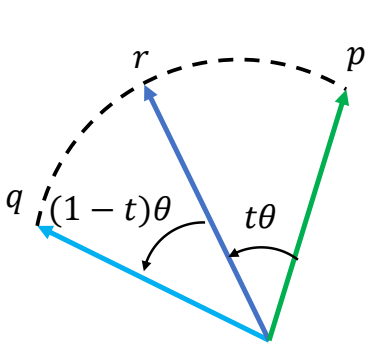

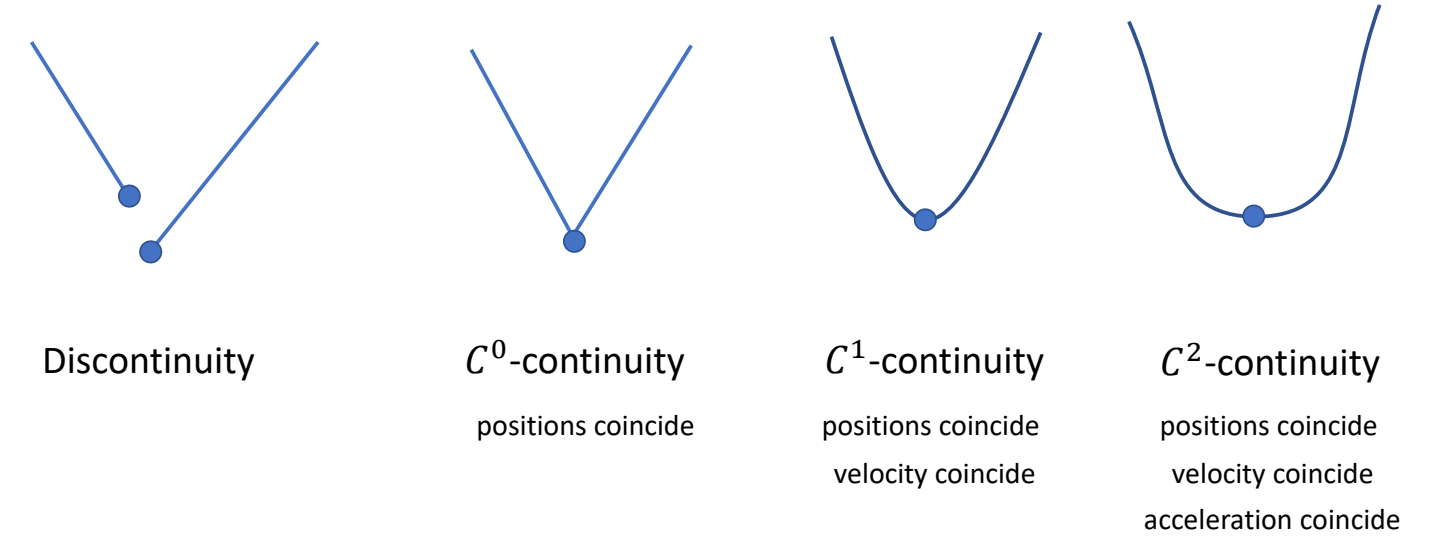

Interpolation

What is good interpolation?

- result is valid at any time \(t\)

- Constant speed is preferred

| 平移 | 旋转 | |

|---|---|---|

|  | |

| \(x_t=(1-t)x_0+tx_1\) ✅ 平移使用线性插值 | ✅ 旋转不适合线性插值。 | |

| 合法 | ✅ 对于任意 \(t\), \(x_t\) 一定是合法的。 | |

| 速度可控 | ✅ 运动的速度是常数,因此速度可控。 |

P99

结论

- Easy to compose? \(\quad \quad \quad {\color{Red} \times } \)

✅ 9个参数没有直接的意义,且为了满足正交阵,参数之间是耦合的。

- Easy to apply? \(\quad \quad \quad \quad {\color{Green} \surd }\)

- Easy to interpolate? \(\quad \quad {\color{Red} \times } \)

P100

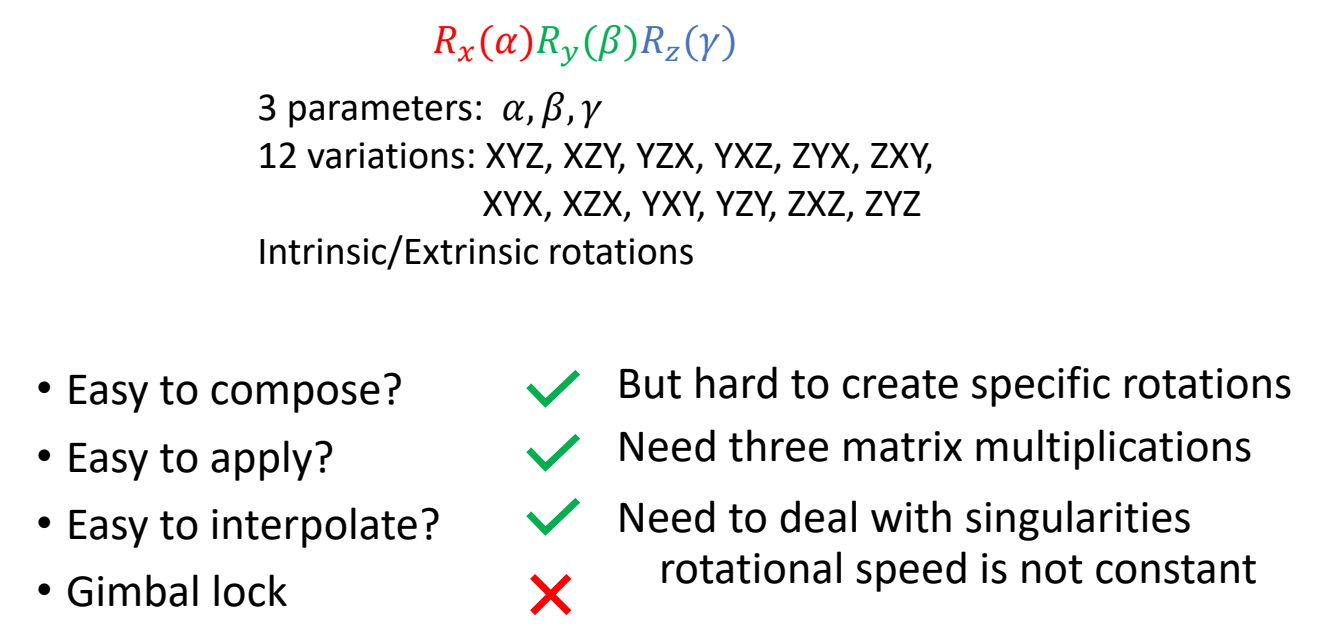

Euler angles

Basic rotations

$$ R_x(\alpha )=\begin{pmatrix} 1 & 0 & 0 \\ 0 & \cos\alpha & -\sin \alpha \\ 0 & \sin \alpha & \cos \alpha \end{pmatrix} $$

$$ R_y(\beta )=\begin{pmatrix} \cos \beta & 0 & \sin \beta \\ 0 & 1 & 0 \\ -\sin \beta & 0 & \cos \beta \end{pmatrix} $$

$$ R_z(\gamma )=\begin{pmatrix} \cos \gamma & -\sin \gamma & 0 \\ \sin \gamma & \cos \gamma & 0 \\ 0 & 0 & 1 \end{pmatrix} $$

combination of three basic rotations

Any rotation can be represented as a combination of three basic rotations

P102

Any combination of three basic rotations are allowed

- Excluding those rotate twice around the same axis

- XYZ, XZY, YZX, YXZ, ZYX, ZXY, XYX, XZX, YXY, YZY, ZXZ, ZYZ

P103

Conventions of Euler Angles

intrinsic rotations: axes attached to the object

$$ R_x(\alpha )R_y(\beta )R_z(\gamma ) $$

extrinsic rotations: axes fixed to the world

$$ R_z(\gamma )R_y(\beta )R_x(\alpha ) $$

✅ 使用欧拉角时应先明确所使用的 convetion 和顺序。

✅ 不同的商业软件可能有不同的内置参数。

✅ maya 和 unity 都是 extrinsic.

✅ maya 可选顺序,Unity 固定 Zxy

P104

Gimbal Lock

When two local axes are driven into a parallel configuration, one degree of freedom is “locked”

✅ 当其中两个轴共线时,会丢失一个自由度,此时表示不唯一(奇异点)

P105

结论

✅ 插值时需注意作用域为 \([-\pi , \pi ]\),否则容易出现翻转现象。

P107

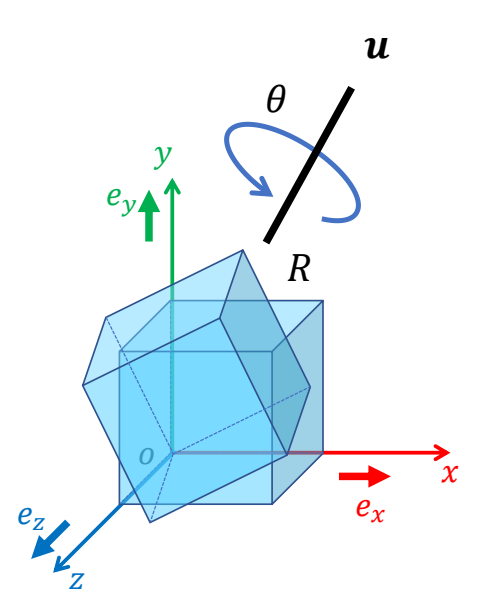

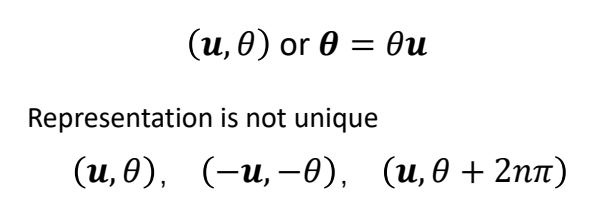

Rotation Vectors / Axis Angles

✅ 粗体 \(\theta \):轴角表示法描述的旋转

✅ 细体 \(\theta \):以 \(u\) 为轴的旋转角度

✅ 应用时要先转为旋转矩阵,做旋转组合时也要借助旋转矩阵

P110

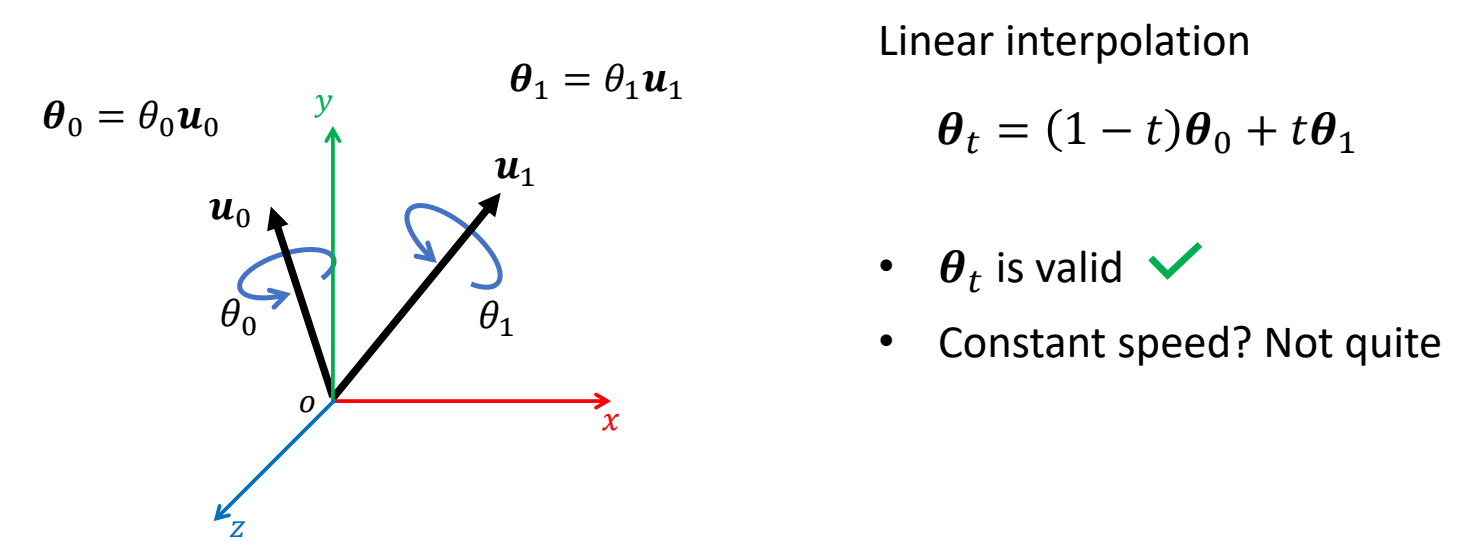

Interpolating Rotation Vectors / Axis Angles

线性插值

可以保证插值结果合法,但不能保证旋转速度恒定

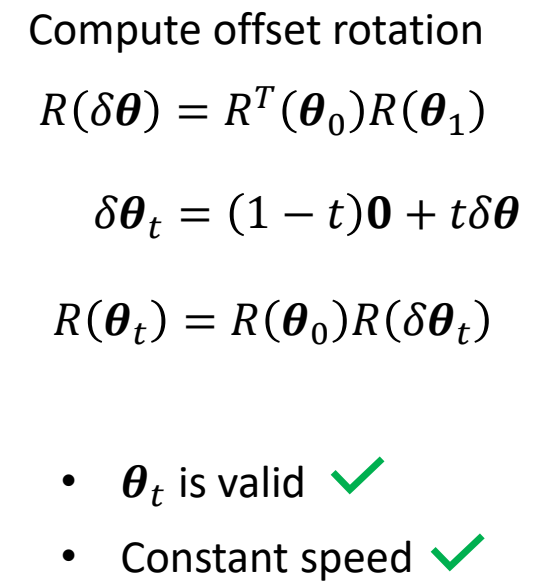

P111

匀速插值

可以保证插值结果合法且匀速,但旋转较复杂

✅ 这个方法没听懂,可以实现允许插值。

P112

结论

- Easy to compose? \(\quad \quad {\color{Green} \surd } \quad \quad \) But hard to manipulate

- Easy to apply? \(\quad \quad \quad {\color{Red} \times } \quad \quad \) Need to convert to matrix

- Easy to interpolate? \(\quad \quad {\color{Green} \surd } \quad \quad \) Linear interpolation works, but not perfect

- No Gimbal lock \(\quad \quad {\color{Green} \surd } \quad \quad \) need to deal with singularities

P113

Quaternions

P116

定义

-

Extending complex numbers

$$ q =a+bi +cj +dk \in \mathbb{H} ,a,b,c,d\in \mathbb{R} $$ -

\(i^2=j^2=k^2=ijk=-1\)

-

\(ij=k,ji=-k(^*\text{cross product})\)

-

\(jk=i,kj=-i\)

-

\(ki=j,ik=-j\)

$$ q=w+xi+yj+zk \quad \Rightarrow \quad q=\begin{bmatrix} w\\ x\\ y\\ z \end{bmatrix}=\begin{bmatrix} w\\ v \end{bmatrix} $$

$$ q =[w,v]^T \in \mathbb{H} ,w\in \mathbb{R},v\in \mathbb{R}^3 $$

$$ w =[w,0]^T : \text{ scalar quaternion } $$

$$ v =[0,v]^T : \text{ pure quaternion } $$

P117

Quaternion Arithmetic

$$ q =a+bi +cj +dk \in \mathbb{H} ,a,b,c,d\in \mathbb{R} $$

Conjugation: \(\quad \quad q^*=a-bi-cj-dk\)

\(

\)

Scalar product: \(\quad \quad tq=ta+tbi+tcj+tdk\)

\(

\)

Addition: \(\quad \quad q_1+q_2=(a_1+a_2)+(b_1+b_2)i+(c_1+c_2)j+(d_1+d_2)k\)

\(

\)

Dot product: \(\quad \quad q_1\cdot q_2=a_1a_2+b_1b_2+c_1c_2+d_1d_2\)

\(

\)

Norm: \(\quad \quad ||q||=\sqrt{a^2+b^2+c^2+d^2} =\sqrt{q\cdot q}\)

P118

Quaternion Multiplication

$$ q_1q_2=(a_1+b_1i+c_1j+d_1k)*(a_2+b_2i+c_2j+d_2k) $$

$$ q_1q_2=a_1a_2-b_1b_2-c_1c_2-d_1d_2 $$

$$

+(b_1a_2+a_1b_2-d_1c_2+c_1d_2)i

$$

$$

+(c_1a_2+d_1b_2+a_1c_2-b_1d_2)j

$$

$$ +(d_1a_2-c_1b_2+b_1c_2+a_1d_2)k $$

note:

- \(i^2=j^2=k^2=ijk=-1\)

- \(ij=k,ji=-k (^* \text{cross product})\)

- \(jk=i,kj=-i\)

- \(ki=j,ik=-j\)

✅ \(q_1 \cdot q_2\) 和 \(q_1q_2\) 是两种不同的运算。

P120

Conjugation: \(\quad \quad q^*=[w,-v]^T\)

\(

\)

Scalar product: \(\quad \quad tq=[tw,tv]^T\)

\(

\)

Addition: \(\quad \quad q_1+q_2=[w_1+w_2,v_1+v_2]^T\)

\(

\)

Dot product: \(\quad \quad q_1\cdot q_2=w_1w_2+v_1 \cdot v_2\)

\(

\)

Norm: \(\quad \quad ||q||=\sqrt{w_1w_2+v_1 \cdot v_2} =\sqrt{q\cdot q}\)

P122

$$ q_1q_2=\begin{bmatrix} w_1\\ v_1 \end{bmatrix}\begin{bmatrix} w_2 \\ v_2 \end{bmatrix}=\begin{bmatrix} w_1w_2-v_1\cdot v_2\\ w_1v_2+w_2v_1+v_1\times v_2 \end{bmatrix} $$

Non-Commutativity:

$$ q_1q_2\ne q_2q_1 $$

Associativity:

$$ q_1q_2q_3=(q_1q_2)q_3=q_1(q_2q_3) $$

P123

Conjugation:

$$ (q_1q_2)^\ast=q^\ast_2q^\ast_1 $$

Norm:

$$ ||q||^2 = q^ \ast q =qq^\ast $$

Reciprocal:

$$ \begin{matrix} qq^{-1}=1 & \Rightarrow & q^{-1}=\frac{q^*}{||q||^2}\\ q^{-1}q=1 & & \end{matrix} $$

P124

Unit Quaternions

$$ \begin{matrix} q=\begin{bmatrix} w\\ v \end{bmatrix} &||q||=1 \end{matrix} $$

For any non-zero quaternion \(\tilde{q} \):

$$ q=\frac{\tilde{q}}{||\tilde{q}||} $$

Reciprocal:

$$ \begin{matrix} q^{-1}=q^\ast =\begin{bmatrix} w\\ -v \end{bmatrix} &\Leftrightarrow & R^{-1}=R^T \end{matrix} $$

P125

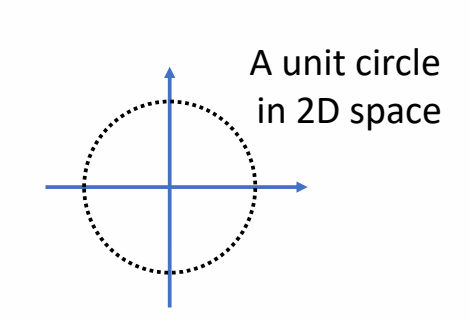

| 2D | 3D |

|---|---|

|  |

| unit complex number | unit quaternion ✅ 所有单位四元数构成 4D 空间上的单位球核。 |

| \(z = \cos \theta + i\sin \theta\) | \(q = \begin{bmatrix} w\\v\end{bmatrix}= [\cos \frac{\theta}{2} , u\sin \frac{\theta}{2}] \quad \mid\mid u \mid\mid = 1\) |

same information as axis angles \((u,\theta)\) But in a different form

P127

轴角表示 -> 四元数表示

Any 3D rotation \((v,\theta)\) can be represented as a unit quaternion

$$ \begin{matrix} \text{Angle}: & \theta =2 \text{ arg } \cos w\\ \text{ Axis}: & u=\frac{v}{||v||} \end{matrix} $$

P128

Rotation a Vector Using Unit Quaternions

已经向量p和单位四元数q,求p经过q旋转后的向量。

$$ \begin{matrix} \text{Unit quaternion}: & q=\begin{bmatrix} w\\ v \end{bmatrix}=[\cos \frac{\theta }{2} ,u\sin \frac{\theta }{2}]\\ \text{ 3D vector}:p & \text{ Rotation result }: {p}' \end{matrix} $$

Then the rotation can be applied by quaternion multiplication:

✅ 纯方向 \(p\) 可用四元数表示为 \([0 \quad p ]\)

✅ \({p}' = R (q) \cdot p\)

P129

$$ \begin{bmatrix} 0 \\ {p}' \end{bmatrix}=q\begin{bmatrix} 0\\ p \end{bmatrix}q^\ast =(-q)\begin{bmatrix} 0\\ p \end{bmatrix}(-q)^\ast $$

\(\mathbf{q}\) and \(−\mathbf{q}\) represent the same rotation

P131

Combination of Rotations

证明过程跳过,结论:

$$ \begin{matrix} \text{Combined rotation}: & q=q_2q_1 \end{matrix} $$

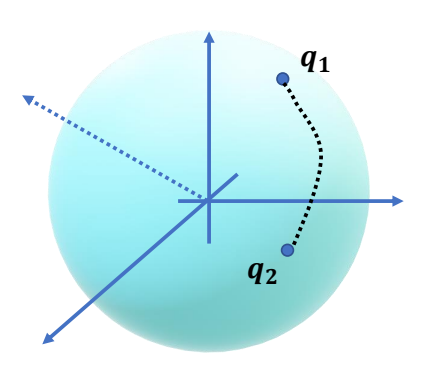

P133

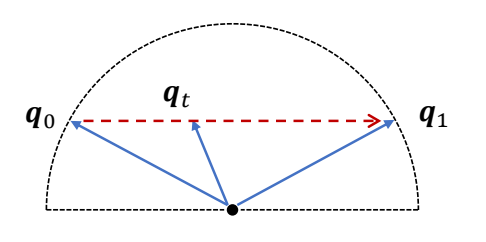

Quaternion Interpolation

A unit hypersphere in 4D space

✅ 单位四元数表现出来是 4D 空间中的球核,\(q_1q_2\) 是球核上的两个点,希望沿球面轨迹插值。

P135

Linear Interpolation

$$ q_t=(1-t)q_0+tq_1 $$

\(q_t\) is not a unit quaternion

P136

Linear Interpolation + Projection

$$ \begin{matrix} \tilde{q}_t=(1-t)q_0+tq_1 & q_t=\frac{\tilde{q}_t }{||\tilde{q}_t||} \end{matrix} $$

$$ \begin{matrix} q_t \text{ is a unit quaternion}\\ \text{Rotational speed is not constant} \end{matrix} $$

✅ 当 \(u_0=-u_1\) 时,可能得到某个 \(\tilde{q} _t = 0\),无法单位化

✅ 解决方法:根据 \(u_0=-u_0\),先找到 \(u_0\) 和 \(u_1\) 在数值上最接近的四元数表示。

P137

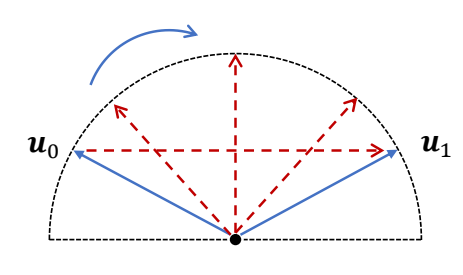

SLERP: Spherical Linear Interpolation

思考

$$ q_t=a(t)q_0+b(t)q_1 $$

如何设计a和b,让插值结果速度恒定?

$$ r=a(t)p+b(t)q $$

计算

Consider the angle \(\theta\) between \(p,q\):

$$ \cos \theta =p\cdot q $$

We have:

$$ \begin{matrix} p \cdot r=a(t)p\cdot p+b(t)q\cdot p\\ \Rightarrow \cos t \theta =a(t)+b(t)\cos \theta \end{matrix} $$

similarly:

$$

\begin{matrix}

q \cdot r=a(t)q\cdot p+b(t)\\

\Rightarrow \cos (1- t) \theta =a(t)\cos\theta +b(t)

\end{matrix}

$$

结论

then we have:

$$ a(t)=\frac{\sin [(1-t)\theta ]}{\sin \theta } ,b(t)=\frac{\sin t \theta }{\sin \theta } $$

P139

$$ q_t=\frac{\sin [(1-t)\theta ]}{\sin \theta }q_0+\frac{\sin t \theta }{\sin \theta }q_1 $$

$$ \cos \theta=q_0\cdot q_1 $$

P140

结论

Rotations can be represented by unit quaternions

Representation is not unique

\(q, −q\) represent the same rotation

- Easy to compose? \(\quad \quad {\color{Green} \surd }\quad \quad \) Need normalization, hard to manipulate,

- Easy to apply? \(\quad \quad \quad {\color{Green} \surd }\quad \quad \) Quaternion multiplication

- Easy to interpolate? \(\quad {\color{Green} \surd }\quad \quad \) SLERP, need to deal with singularities

- No Gimbal lock \(\quad \quad \quad {\color{Green} \surd }\quad \quad \)

本文出自CaterpillarStudyGroup,转载请注明出处。

https://caterpillarstudygroup.github.io/GAMES105_mdbook/

角色位移控制 (Locomotion Control) 技术洞察

更新时间: 2026-03-30

范围: 2010-2025 年角色位移 (locomotion) 控制技术分析

一、概述

角色位移控制是计算机图形学、机器人学和游戏开发的核心问题,目标是生成自然、稳定、可控的角色运动(如行走、跑步、跳跃等)。

1.1 为什么 Locomotion 是一个难题?

- 高维状态空间: 人形角色通常有 30+ 自由度

- 强非线性动力学: 接触力、摩擦力、碰撞使系统高度非线性

- 多模态行为: 行走、跑步、跳跃等不同步态需要不同控制策略

- 实时性要求: 游戏/VR 应用需要 60+ FPS

- 鲁棒性要求: 需要抵抗外部扰动、适应地形变化

1.2 技术分类:运动学 vs 动力学

| 维度 | 运动学方法 (Kinematics) | 动力学方法 (Dynamics) |

|---|---|---|

| 核心目标 | 生成视觉上合理的动作 | 生成物理可行的动作 |

| 输出 | 关节姿态/速度 | 关节力矩/PD 控制目标 |

| 是否物理仿真 | 否 | 是 |

| 典型应用 | 动画生成、VR 化身 | 游戏、机器人仿真 |

| 优势 | 速度快、质量高 | 物理交互、抗扰动 |

| 局限 | 无法处理物理交互 | 训练成本高、实现复杂 |

二、基于运动学的方法 (Kinematics-based Methods)

核心特征:直接从数据学习动作生成,不经过物理仿真,输出为关节姿态。

2.1 技术流派总览

运动学方法经过十余年发展,形成了四大主要流派:

flowchart TB

subgraph Phase["流派一:相位系 (Phase-based)"]

direction TB

PFNN["PFNN (2017)"] --> LP["Local Phases (2020)"]

LP --> SM["Style Modelling (2020)"]

LP --> PM["Phase Manifolds (2023)"]

end

subgraph Trans["流派二:RTN (Transition Generation)"]

direction TB

RTN["RTN (2018)"]

end

subgraph MM["流派三:Motion Matching 系"]

direction TB

MM0["Motion Matching (2019)"] --> LMM["Learned MM (2020)"]

LMM --> MOCHA["MOCHA (2023)"]

end

subgraph Diff["流派四:扩散模型系"]

direction TB

AMDM["A-MDM (2024)"] --> CAMDM["CAMDM (2024)"]

CAMDM --> AAMDM["AAMDM (2024)"]

AAMDM --> DART["DART (2025)"]

end

style Phase fill:#e1f5fe

style Trans fill:#fff3e0

style MM fill:#f0f0f0

style Diff fill:#e8f5e9

关键洞察:Local Phases (2020) 是相位系的核心分支点 —— 一支朝风格转换方向发展(Style Modelling),另一支朝相位流形插值方向发展(Phase Manifolds)。

| 流派 | 核心思想 | 优势 | 局限 |

|---|---|---|---|

| 相位系 | 相位解耦动作状态 / 相位流形插值 | 流畅无 artifacts / 自然过渡 | 相位定义需领域知识 |

| RTN (Transition Generation) | RNN 连接两个状态 | 无需标注、固定内存 | 过渡长度固定 |

| Motion Matching 系 | 数据搜索/预测 | 工业验证质量高 | 内存/训练成本 |

| 扩散模型系 | 概率扩散生成 | 高质量多样性 | 推理速度挑战 |

2.2 流派一:相位系 (Phase-based Methods)

核心思想:引入相位变量 $\phi \in [0, 2\pi)$ 作为动作周期的隐式表示,用相位解耦不同动作状态或在相位空间进行插值。

演进路径:

flowchart LR

subgraph Phase["相位表示分支"]

PFNN --> FS["Few-shot Styles"]

FS --> LP["Local Phases"]

LP --> SM["Style Modelling"]

end

subgraph Manifold["相位流形分支"]

LP --> PM["Phase Manifolds"]

end

两大分支:

从演进路径可以看出,Local Phases (2020) 是核心分支点,衍生出两个方向:

| 分支 | 演进路径 | 核心目标 | 典型应用 |

|---|---|---|---|

| 相位表示分支 | PFNN → Local Phases → Style Modelling | 用相位解耦不同动作状态 | VR 化身、风格化动画 |

| 相位流形分支 | Local Phases → Phase Manifolds | 在相位空间进行插值 | 过渡生成、动作补间 |

统一框架:

| 演进阶段 | 代表论文 | 核心贡献 | 典型应用 |

|---|---|---|---|

| 全局相位 | PFNN (2017) | 相位函数化权重,避免 artifacts | 复杂地形 locomotion |

| 少样本风格 | Few-shot Styles (2018) | 残差适配器 + CP 分解 | 风格迁移 |

| 局部相位 | Local Phases (2020) | 每个身体部位独立相位 | 多接触交互 |

| 风格调制 | Style Modelling (2020) | 特征变换 + 局部相位 | 实时风格切换 |

| 相位流形 | Phase Manifolds (2023) | 相位流形插值与过渡生成 | 动作补间 |

两大分支:

从演进路径可以看出,Local Phases (2020) 是核心分支点,衍生出两个方向:

| 分支 | 演进路径 | 核心目标 | 典型应用 |

|---|---|---|---|

| 相位表示分支 | PFNN → Local Phases → Style Modelling | 用相位解耦不同动作状态 | VR 化身、风格化动画 |

| 相位流形分支 | Local Phases → Phase Manifolds | 在相位空间进行插值 | 过渡生成、动作补间 |

代表论文:

- PFNN (2017): 相位函数化权重

- Few-shot Locomotion Styles (2018): 残差适配器 + CP 分解,少样本风格学习

- Local Motion Phases (2020): 局部相位表示

- Style Modelling (2020): 特征变换 + 局部相位

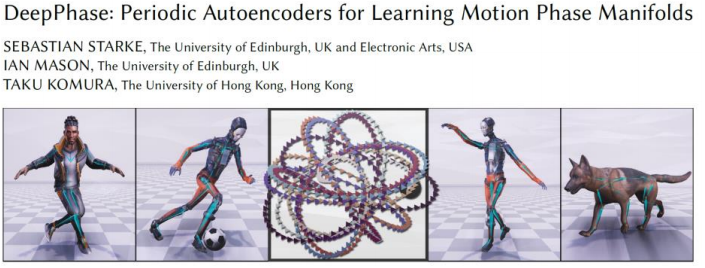

- Phase Manifolds (2023): 相位流形插值

- RTN (2018): 循环转移网络,transition 生成

注意:MOCHA (2023) 虽然使用了 AdaIN 进行风格转换(继承自 Style Modelling),但其核心是 Neural Context Matcher 进行上下文匹配,不属于相位系,而是属于Motion Matching 系(见 2.4 节)。

注意:POMP (2023) 虽然使用相位表示,但其核心是物理一致运动生成,输出关节力矩并使用物理仿真器,属于动力学方法(见 3.8.3 节)。

2.2.1 PFNN: Phase-Functioned Neural Networks (SIGGRAPH 2017)

论文: 113.md

核心创新: 将相位从「网络输入特征」升级为「网络权重的参数化变量」

架构:

flowchart LR

Input["输入:状态 + 控制 + 相位φ"] --> PhaseFunc["相位函数Θ(φ)"]

PhaseFunc --> Weights["生成网络权重"]

Weights --> Expert1["专家 1"]

Weights --> Expert2["专家 2"]

Weights --> Expert3["专家 3"]

Expert1 & Expert2 & Expert3 --> Mix["混合输出"]

Mix --> Output["输出:姿态/速度/触地"]

关键洞察:

- 相位作为权重参数,避免不同相位动作混合导致的 artifacts

- 使用 Cubic Catmull-Rom Spline 插值专家权重

- 地形数据增强:从平地 mocap 生成崎岖地形训练数据

优点:

- 相位解耦,避免 artifacts

- 仅 10MB 模型大小

- 实时 60 FPS

缺点:

- 仍需手工标注相位和步态标签

- 泛化能力有限,仅支持训练过的步态

2.2.2 Few-shot Locomotion Styles (EG 2018)

论文: 214.md

核心创新: 首个少样本风格学习框架,几秒视频即可学会新走路风格

背景: PFNN 需要大量数据训练每种新风格,但动画师通常只有几秒参考视频。

方法框架:

flowchart TB

subgraph Stage1["第一阶段:预训练"]

data1["8 种风格大量数据"]

pfnn["PFNN 主干网络"]

adapter["残差适配器"]

agnostic["风格无关参数 β_ag"]

specific["风格相关参数 β_s (8 套)"]

end

subgraph Stage2["第二阶段:少样本学习"]

data2["新风格几秒视频"]

freeze["冻结主干网络"]

learn["只学习新残差适配器"]

cp["CP 分解降维"]

end

data1 --> pfnn

pfnn --> agnostic

pfnn --> adapter

adapter --> specific

data2 --> learn

freeze --> learn

learn --> cp

style Stage1 fill:#e1f5fe

style Stage2 fill:#fff3e0

关键技术:

| 技术 | 作用 | 效果 |

|---|---|---|

| 残差适配器 | 分离风格无关/相关参数 | 只需学习少量新参数 |

| CP 分解 | 3D 张量分解为三个矩阵 | 参数从 4MB 降至 0.13MB (30 倍压缩) |

| 可变 Dropout | 根据数据量调整正则化 | 防止少样本过拟合 |

CP 分解公式:

$$ X_k = A D(k) B^T $$

- $A, B$: 与相位无关的矩形矩阵

- $D(k)$: 与相位相关的对角矩阵

训练数据:

- 预训练:8 种风格 × 23104 帧(愤怒、孩子气、沮丧、中性、老人、骄傲、性感、大摇大摆)

- 少样本:50 种新风格,每种仅 1-5 秒视频

性能:

- 推理时间:0.0011 秒/帧(约 900 FPS)

- 存储:每风格仅需 0.13MB

优点:

- 几秒视频即可学会新风格

- 支持实时生成

- 参数效率高,内存占用低

缺点:

- 仅支持 Homogeneous 迁移(走→走,不能走→跑)

- 无法处理非周期性动作

- 生成动作略平滑,丢失高频细节

与 PFNN 的继承关系:

- PFNN: 每风格单独训练,需要大量数据

- Few-shot: 添加残差适配器,风格无关参数共享

2.2.3 Local Motion Phases (SIGGRAPH 2020)

论文: 216.md

核心创新: 每个身体部位学习独立相位,支持多接触交互

背景: PFNN 的全局相位假设所有部位同步运动,无法处理多接触动作(如手扶墙、脚踩台阶)。

全局相位 vs 局部相位:

| 全局相位 | 局部相位 |

|---|---|

| 单一相位值 | 每个身体部位独立相位 |

| 适用于周期性 locomotion | 适用于多接触交互 |

| 相位手动标注 | 无监督学习相位 |

局部相位表示:

$$ \phi = {\phi_{left_foot}, \phi_{right_foot}, \phi_{left_hand}, \phi_{right_hand}, ...} $$

与 PFNN 的继承关系:

- PFNN: 全局相位,需手动标注

- Local Phases: 局部相位,无监督学习

- 共同点:相位作为解耦变量

优点:

- 支持多接触交互

- 相位自动学习

- 异步运动建模

缺点:

- 相位数量固定

- 新接触类型需要训练

2.2.4 Style Modelling: 特征变换与局部相位 (SIGGRAPH 2020)

论文: 211.md

核心创新: Feature-Wise Transformations + Local Motion Phases

架构:

flowchart LR

motion["输入动作 x"] --> Enc["动作编码器"]

style["风格代码 z"] --> StyleEnc["风格编码器"]

Enc --> FWT["Feature-Wise Transformation"]

StyleEnc --> FWT

FWT --> Dec["动作解码器"]

Dec --> out["风格化动作 y"]

AdaIN 公式:

$$ \text{AdaIN}(x, z) = \sigma(z) \cdot \frac{x - \mu(x)}{\sigma(x)} + \mu(z) $$

Local Motion Phases vs 全局相位:

| 全局相位 | 局部相位 |

|---|---|

| 单一相位值 | 每个身体部位独立相位 |

| 适用于周期性动作 | 适用于非同步动作 |

| 难以处理复杂动作 | 灵活处理多接触动作 |

与 PFNN 的继承关系:

- PFNN: 全局相位,适用于 locomotion

- Style Modelling: 局部相位,适用于更复杂动作

- 继承:相位作为解耦变量的思想

优点:

- 实时 60+ FPS

- 支持多种风格平滑过渡

- 少样本风格学习

缺点:

- 仅适用于 locomotion

- 极端风格可能失真

2.2.5 Phase Manifolds: 相位流形插值 (2023)

论文: 212.md

核心创新: 使用 Periodic Autoencoder 学习相位变量,在相位流形空间进行插值生成过渡动作

注意: 虽然本论文与 Style Modelling (211) 同样使用局部相位表示,但其核心是相位流形插值用于 transition 生成,与 POMP (112) 的物理一致运动生成不同,本论文属于运动学相位系。

架构:

flowchart TB

start["起始帧 s"] --> PAE["Periodic<br/>Autoencoder"]

target["目标帧 t"] --> PAE

duration["过渡时长 T"] --> Interp["相位流形插值"]

PAE --> PhaseS["起始相位φ_s"]

PAE --> PhaseT["目标相位φ_t"]

PhaseS --> Interp

PhaseT --> Interp

Interp --> MoE["Mixture of Experts"]

MoE --> Motion["过渡动作序列"]

相位流形约束:

- 相位在单位圆上:$\phi \in [0, 2\pi)$

- 周期性:$\phi(t) = \phi(t + T)$

- 流形插值:$\phi_t = \text{slerp}(\phi_s, \phi_t, t)$(球面线性插值)

与 Style Modelling 的关系:

- 共同点: 都使用局部相位表示解耦身体部位

- 差异: Style Modelling 用于风格转换,Phase Manifolds 用于过渡生成

与 POMP 的差异:

- Phase Manifolds (212): 运动学过渡生成,输出关节位置

- POMP (112): 物理一致运动生成,输出关节力矩 + 物理仿真

优点:

- 生成自然流畅的过渡

- 支持用户约束(end effector 位置)

- 多样化过渡生成

缺点:

- 依赖训练数据

- 长过渡质量下降

- 无法处理物理交互

2.3 流派二:RTN: Recurrent Transition Networks (SIGGRAPH 2018)

论文: 210.md

核心创新: 首个专门为 transition 生成设计的未来感知(future-aware)深度循环网络

背景: 在大型游戏中,动画图(Animation Graph)需要大量 transition 动画。传统方法的问题:

- 手工制作 transition 非常耗时:动画师需要手动制作大量的过渡动画

- 内存占用大:Motion Graph 方法需要将动画数据和图结构加载到内存中

- 扩展性差:随着数据集增大,内存需求线性增长

- 需要标注:很多方法需要 gait、phase、contact 等标签

方法框架:

flowchart TB

past["过去上下文<br/>10 帧"] --> Enc["Frame Encoder"]

target["目标姿态<br/>归一化"] --> TargetEnc["Target Encoder"]

offset["全局偏移<br/>目标 - 当前"] --> OffsetEnc["Offset Encoder"]

Enc --> LSTM["改进的 LSTM<br/>512 单元"]

TargetEnc --> LSTM

OffsetEnc --> LSTM

LSTM --> Dec["Frame Decoder"]

Dec --> out["下一帧预测"]

style Enc fill:#e1f5fe

style LSTM fill:#fff3e0

style Dec fill:#e8f5e9

核心架构:

| 组件 | 架构 | 作用 |

|---|---|---|

| Frame Encoder | 2 层 MLP, 512 单元 | 编码当前帧 + 地形(可选) |

| Target Encoder | 2 层 MLP, 128 单元 | 编码目标姿态(整序列恒定) |

| Offset Encoder | 2 层 MLP, 128 单元 | 编码目标与当前的差异 |

| Recurrent Generator | 改进 LSTM, 512 单元 | 添加未来上下文条件化权重 |

| Frame Decoder | 2 层 MLP | 输出下一帧 |

改进的 LSTM:

$$i_t = \alpha(W^{(i)}h^E_t + U^{(i)}h^R_{t-1} + C^{(i)}h^{F,O}t + b^{(i)})$$ $$o_t = \alpha(W^{(o)}h^E_t + U^{(o)}h^R{t-1} + C^{(o)}h^{F,O}t + b^{(o)})$$ $$f_t = \alpha(W^{(f)}h^E_t + U^{(f)}h^R{t-1} + C^{(f)}h^{F,O}_t + b^{(f)})$$ $$\hat{c}t = W^{(c)}h^E_t + W^{(c)}h^R{t-1} + C^{(c)}h^{F,O}t + b^{(c)}$$ $$c_t = f_t \odot c{t-1} + i_t \odot \tau(\hat{c}_t)$$ $$h^R_t = o_t \odot \tau(c_t)$$

关键设计:

- 添加了 $C^{(\cdot)}$ 权重用于未来上下文条件化

- Hidden State 初始化器:学习逆函数 $H(x_{past_first}) \to (h_0, c_0)$

- 地形感知:通过局部高度图(13×13 网格)实现崎岖地形导航

数据表示:

- 根节点相对位置:$\tilde{x}t = [v_t, j^t_1, ..., j^t{K-1}]^T$

- 根节点速度:$v_t = r_t - r_{t-1}$

- 标准化:$x_t = (\tilde{x}_t - \mu_x) / \sigma_x$

训练细节:

- Transition 长度:30 帧(1 秒)

- Past context:10 帧

- Future context:2 帧(目标姿态)

- 总窗口长度:50 帧

- 损失函数:$\mathcal{L} = \frac{1}{P} \sum_{t=1}^{P} ||x_{t+1} - \hat{x}_{t+1}||^2$

- 无需任何 gait、phase、contact 或 action 标签

优点:

- 自动生成高质量 transition,无需手工制作

- 固定大小的网络,内存占用恒定

- 无需任何标注即可训练

- 质量媲美 Mocap ground truth

缺点:

- Transition 长度固定,需要预设

- 自回归生成,推理速度取决于长度

- 无法处理复杂障碍物

与 PFNN 的对比:

- PFNN:相位条件化,生成连续 locomotion

- RTN:transition 专用,连接两个状态

- PFNN 需要相位标注,RTN 无需标注

应用场景:

- Animation Graph 的 transition 节点:替代手工制作的过渡动画

- 动画超分辨率:从 1fps 压缩动画恢复

- 地形导航:崎岖地形上的长 transition

2.4 流派三:Motion Matching 系

核心思想:从动作数据库搜索/预测最匹配当前状态的帧。

演进路径:

flowchart LR

MM["Motion Matching (2019)<br/>工业标准"] --> LMM["Learned Motion Matching (2020)<br/>神经网络替代"]

LMM --> MOCHA["MOCHA (2023)<br/>角色化扩展"]

Motion Matching 核心流程:

- 提取当前帧特征(姿势、速度、轨迹)

- 在数据库中搜索最近邻

- 返回对应帧并推进索引

Learned Motion Matching 创新:用三个神经网络替代数据库搜索,固定内存占用。

MOCHA 扩展:在 Learned Motion Matching 基础上,增加 Neural Context Matcher 实现角色风格转换和体型适配。

2.4.1 Learned Motion Matching (SIGGRAPH 2020)

论文: 208.md

核心创新: 用三个神经网络替代 Motion Matching 的数据库搜索

背景: Motion Matching 是游戏工业标准,但需要存储海量动画数据库,内存占用随数据量线性增长。

三网络功能:

| 网络 | 输入 | 输出 | 替代功能 |

|---|---|---|---|

| Decompressor | 特征向量 x + 潜变量 z | 姿态 y | Animation Database 查找 |

| Projector | 查询特征向量 | 最近邻索引 k* | 最近邻搜索 |

| Stepper | 当前索引 k* | 下一帧索引 | 数据库索引推进 |

优点:

- 保留 Motion Matching 的质量和可控性

- 固定内存占用(网络权重),不随数据量增长

- 已应用于多个 AAA 游戏

缺点:

- 训练时间比原始 Motion Matching 长

- 网络预测 vs 精确搜索有轻微质量损失

2.4.2 MOCHA: Real-Time Motion Characterization (SIGGRAPH Asia 2023)

论文: 209.md

核心创新: 首个实时角色表征框架,同时转换动作风格和身体比例

背景: 将中性动作转换为特定角色风格(如僵尸、公主、小丑),同时适配不同体型。

架构:

flowchart TB

src["Source Motion<br/>中性动作"] --> BodyEnc["Bodypart Encoder<br/>6 身体部位"]

BodyEnc --> SrcFeat["Source Feature"]

SrcFeat --> NCM["Neural Context Matcher<br/>C-VAE + 自回归"]

NCM --> CharFeat["Character Feature"]

CharFeat --> Charz["Characterizer<br/>Transformer+AdaIN"]

SrcFeat --> Charz

Charz --> OutFeat["Translated Feature"]

OutFeat --> Output["Characterized Motion"]

AdaIN 公式:

$$ \text{AdaIN}(z_{src}, z_{cha}) = \sigma(z_{cha}) \cdot \frac{z_{src} - \mu(z_{src})}{\sigma(z_{src})} + \mu(z_{cha}) $$

NCM Prior:

$$ p(s_i | z_{i-1}^{cha}, f(z_i^{src})) = \mathcal{N}(\mu, \sigma) $$

与 Style Modelling 的继承关系:

- Style Modelling: AdaIN 用于风格转换

- MOCHA: AdaIN + Transformer,同时处理风格 + 体型

优点:

- 实时 60 FPS

- 同时处理风格转换 + 身体比例适配

- 支持稀疏输入(VR tracker)

缺点:

- 训练数据中的角色有限,新角色需重新训练

- 极端风格可能失真

2.5 流派四:扩散模型系 (Diffusion-based Methods)

核心挑战:标准扩散模型需要 1000 步去噪,无法满足实时性要求(60 FPS)。

演进路径:

flowchart TB

DM["标准扩散模型<br/>1000 步去噪"] --> AMDM["A-MDM (2024)<br/>自回归 +50 步"]

DM --> CAMDM["CAMDM (2024)<br/>8 步 + 风格转换"]

DM --> AAMDM["AAMDM (2024)<br/>5 步 DD-GAN+ADM"]

AMDM --> DART["DART (2025)<br/>Latent Space Control"]

subgraph 加速演进

AMDM -.->|50 步 | CAMDM

CAMDM -.->|8 步 | AAMDM

AAMDM -.->|5 步 | DART

end

加速策略对比:

| 方法 | 去噪步数 | 加速策略 | 实时性 |

|---|---|---|---|

| A-MDM | 50 步 | 自回归设计 | 30+ FPS |

| CAMDM | 8 步 | 条件化 + 引导采样 | 60+ FPS |

| AAMDM | 5 步 | DD-GAN+ADM 级联 | 60+ FPS |

| DART | ~20 步 | Latent 空间扩散 | 60+ FPS |

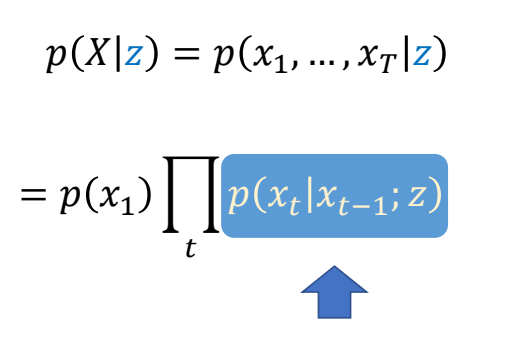

2.5.1 A-MDM: Auto-regressive Motion Diffusion Model (SIGGRAPH 2024)

论文: 206.md

核心创新: 将扩散模型从 space-time 重新设计为 auto-regressive

自回归公式:

$$ p(x_{1:T}) = \prod_{t=1}^{T} p(x_t | x_{1:t-1}) $$

架构: 简单 3 层 MLP,50 步去噪

控制套件:

- Task-oriented sampling

- Motion in-painting

- Keyframe in-betweening

- Hierarchical reinforcement learning

与 CAMDM 的差异:

- A-MDM: 强调控制套件,MLP 架构

- CAMDM: 强调风格转换,Transformer 架构

2.5.2 CAMDM: Conditional Autoregressive Motion Diffusion Model (SIGGRAPH 2024)

论文: 207.md

核心创新: 8 步去噪实现实时高质量多样角色动画

关键技术:

| 技术 | 作用 |

|---|---|

| 分离条件 Tokenization | 每个控制条件独立 token,避免特征主导 |

| Classifier-free guidance on history | 在历史动作上应用 guidance,实现风格转换 |

| 启发式轨迹扩展 | 回收上次预测轨迹,避免抖动 |

条件输入:

- 风格/步态

- 移动速度

- 朝向方向

- 未来轨迹

优点:

- 8 步去噪 ≈ 几毫秒,60+ FPS

- 支持多风格平滑转换

- 无需微调实现风格转换

缺点:

- 8 步去噪仍有优化空间

- 依赖 mocap 数据

2.5.3 AAMDM: Accelerated Auto-regressive Motion Diffusion Model (CVPR 2024)

论文: 204.md

核心创新: 5 步去噪 (3 DD-GAN + 2 ADM)

架构:

Autoencoder: 338D pose → 64D latent

↓

Generation Module: DD-GANs (3 步)

↓

Polishing Module: ADM (2 步)

↓

输出:高质量动作

总去噪步数: $T_{AA} = T_{GAN} + T_{ADM} = 3 + 2 = 5$

与 CAMDM 的差异:

- CAMDM: 8 步,强调风格转换

- AAMDM: 5 步,强调加速

2.5.4 DARTControl: Diffusion-based Autoregressive Motion Model (ICLR 2025)

论文: 205.md

核心创新: Motion Primitive 表示 + Latent Space Control

Motion Primitive:

- H=2 帧历史(与前一 primitive 重叠)

- F=8 帧未来

Latent Space Control 方法:

- 优化方法: latent noise optimization

- 学习方法: MDP + RL (PPO)

优势: 10x 加速 vs FlowMDM

与 A-MDM 的差异:

- A-MDM: 原始空间扩散

- DART: Latent 空间扩散,更高效

2.6 运动学方法总结

四大流派核心思想对比

| 流派 | 代表方法 | 核心贡献 | 典型应用 |

|---|---|---|---|

| 相位系 | PFNN → Few-shot Styles → Local Phases → Style Modelling → Phase Manifolds | 相位作为权重参数/条件输入,避免 artifacts | VR 化身、风格化动画、过渡生成 |

| RTN (Transition Generation) | RTN (2018) | RNN 连接两个状态 | 动画图 transition、超分辨率 |

| Motion Matching 系 | MM → Learned MM → MOCHA | 数据搜索/预测生成动作 + 角色化 | 游戏 NPC、在线游戏、角色设计 |

| 扩散模型系 | A-MDM → CAMDM → AAMDM → DART | 概率扩散模型生成 | 电影动画、多样性生成 |

流派选择指南

flowchart TD

Q1["需要什么类型的控制?"] --> |风格转换 | A1["MOCHA / CAMDM / Style Modelling"]

Q1 --> |稀疏输入 VR | A2["PFNN / MOCHA"]

Q1 --> |高质量多样性 | A3["CAMDM / DART"]

Q1 --> |低内存占用 | A4["Learned Motion Matching"]

Q1 --> |transition 生成 | A5["RTN / Phase Manifolds"]

Q1 --> |少样本学习 | A6["Few-shot Styles"]

运动学方法详细对比

| 方法 | 架构 | 去噪步数 | FPS | 风格转换 | 空间控制 | 物理感知 |

|---|---|---|---|---|---|---|

| PFNN | 混合专家 | N/A | 60+ | △ | △ | ✗ |

| Few-shot Styles (214) | 残差适配器+CP 分解 | N/A | 60+ | ✓ (少样本) | △ | ✗ |

| Local Motion Phases | 相位条件化 | N/A | 60+ | ✗ | △ | ✗ |

| Style Modelling | FWT+ 相位 | N/A | 60+ | ✓ | ✗ | ✗ |

| Phase Manifolds | MoE+PAE | N/A | 30+ | ✗ | ✓ | ✗ |

| RTN | LSTM | N/A | 60+ | ✗ | ✓ | △ |

| Learned MM | 三网络 | N/A | 60+ | ✗ | △ | ✗ |

| MOCHA | Transformer | N/A | 60+ | ✓ | ✗ | ✗ |

| A-MDM | MLP | 50 | 30+ | △ | △ | ✗ |

| CAMDM | Transformer | 8 | 60+ | ✓ | ✓ | ✗ |

| AAMDM | DD-GAN+ADM | 5 | 60+ | △ | ✗ | ✗ |

| DART | Latent Diffusion | ~20 | 60+ | ✓ | ✓ | ✗ |

2.7 常见问题解答 (FAQ)

Q1: 相位系的发展脉络是什么?

相位系是一个统一的方法论,其核心思想是引入相位变量 $\phi \in [0, 2\pi)$ 作为动作的解耦表示,通过相位来参数化网络权重或作为条件输入,避免不同动作状态的混合导致 artifacts。

统一演进框架:

| 阶段 | 代表论文 | 核心创新 | 相位角色 |

|---|---|---|---|

| 全局相位 | PFNN (2017) | 相位函数化网络权重 | 权重参数化变量 |

| 少样本风格 | Few-shot Styles (2018) | 残差适配器 + CP 分解 | 风格条件 |

| 局部相位 | Local Phases (2020) | 每个身体部位独立相位 | 多接触解耦 |

| 风格调制 | Style Modelling (2020) | 特征变换 + 局部相位 | 风格注入条件 |

| 相位流形 | Phase Manifolds (2023) | 周期自编码学习相位流形 | 流形空间坐标 |

关键洞察:

- Local Phases (2020) 是核心分支点,同时影响了 Style Modelling(风格转换)和 Phase Manifolds(过渡生成)两个方向

- 相位系内部的区别仅在于相位的使用方式(全局 vs 局部、解耦 vs 流形插值),但核心思想统一

注意:POMP (2023) 虽然使用相位表示,但其核心是物理一致运动生成,输出关节力矩并使用物理仿真器,属于动力学方法(见 3.8.3 节)。

Q2: MOCHA 属于哪个流派?

MOCHA 属于 Motion Matching 系,而不是相位系。理由如下:

| 维度 | 相位系 | MOCHA |

|---|---|---|

| 核心机制 | 相位作为权重参数或输入特征 | Neural Context Matcher 上下文匹配 |

| 相位使用 | 显式相位变量 $\phi$ | 无显式相位,用上下文特征条件化 |

| 继承关系 | PFNN → Local Phases → Style Modelling | Motion Matching → Learned MM → MOCHA |

MOCHA 的核心贡献:

- Neural Context Matcher: 用 C-VAE + 自回归生成替代数据库搜索

- Characterizer: 用 AdaIN + Cross-Attention 实现风格转换和体型适配

注意:MOCHA 虽然使用了 AdaIN(继承自 Style Modelling),但这只是风格注入的工具,其核心架构是基于上下文匹配的,因此属于 Motion Matching 系。

Q3: RTN 属于什么系?

RTN 不属于任何主要流派,它是一个专用场景方法:

| 维度 | RTN | 三大流派 |

|---|---|---|

| 目标场景 | Transition 生成 | 连续 locomotion |

| 相位需求 | 无需相位 | 需要相位或类似机制 |

| 标注需求 | 无需任何标注 | 通常需要相位/步态标注 |

| 网络结构 | 改进 LSTM | 多样化(混合专家、Transformer、扩散) |

RTN 的定位:

- RTN 是一个特殊的存在,专门处理游戏动画图中的transition 生成问题

- 它不属于相位系(无需相位)、不属于 Motion Matching 系(不用搜索)、不属于扩散模型系(2018 年工作)

- 在流派选择指南中,RTN 作为"transition 生成"的专用方案被推荐

三、基于动力学的方法 (Dynamics-based Methods)

核心特征: 输出为关节力矩或 PD 控制目标,需要物理仿真器执行。

3.1 技术演进时间线

timeline

title 动力学方法发展时间线

2010 : Feature-Based : 高层物理特征

2017 : DeepLoco : 分层 RL+ 环境感知

2018 : DeepMimic : RL+ 模仿

2018 : Mode-Adaptive : 四足统一控制

2019 : DReCon : MM+RL

2021 : AMP : 对抗运动先验

2022 : ASE : 预训练技能库

2023 : ControlVAE : 状态条件先验

2023 : Perpetual : 实时虚拟化身

2023 : UniRep : 统一表示 + 蒸馏

2024 : PDP/DiffuseLoco : 扩散策略

2024 : MaskedMimic : 掩码运动补全

2025 : PARC : 迭代数据扩增

2025 : UniPhys : 统一规划 + 控制

3.2 核心思想继承关系

动力学方法经过十余年发展,形成了四条主要演进主线:

flowchart TB

subgraph RL["RL lineage"]

FB["Feature-Based"] --> DL["DeepLoco"]

DL --> DM["DeepMimic"]

DM --> AMP["AMP"]

AMP --> ASE["ASE"]

end

subgraph Hybrid["Hybrid lineage"]

DL --> DReCon["DReCon<br/>MM+RL"]

DM --> DReCon

DReCon --> PDP["PDP<br/>RL 专家蒸馏"]

end

subgraph Pretrain["Pretraining lineage"]

ASE --> CVAE["ControlVAE"]

ASE --> UniRep["Universal Representation"]

end

subgraph Diffusion["Diffusion lineage"]

PDP --> DiffuseLoco["DiffuseLoco"]

ASE --> MaskedMimic["MaskedMimic"]

MaskedMimic --> UniPhys["UniPhys"]

DReCon --> PARC["PARC<br/>迭代扩增"]

end

四条演进主线详解

| 主线 | 演进路径 | 核心问题 | 解决方案 |

|---|---|---|---|

| RL Lineage | DeepLoco → DeepMimic → AMP → ASE | 如何从数据学习控制策略? | 分层 RL → RL 模仿 → 对抗学习 → 预训练技能库 |

| Hybrid Lineage | DeepLoco → DReCon → PDP | 如何统一多技能控制? | 分层架构 → 动态参考选择 → 多专家蒸馏 |

| Pretraining Lineage | ASE → ControlVAE → UniRep | 如何提高样本效率? | 对抗预训练 → 状态条件先验 → Prior+ 蒸馏 +RL 范式 |

| Diffusion Lineage | PDP → DiffuseLoco / ASE → MaskedMimic → UniPhys / DReCon → PARC | 2024 年扩散模型如何应用? | 扩散策略 / 掩码补全 / 迭代扩增 |

关键洞察:

- DeepLoco (2017) 是分层 RL 的开创者,首次实现环境感知(32×32 高度图)+ 双控制器架构(HLC 规划 + LLC 执行)

- DeepMimic (2018) 是深度学习时代的起点,首次证明 RL+ 模仿可以学习高质量动态动作(后空翻、旋转)

- AMP (2021) 解决数据标注问题,从需要精确跟踪 → 无标注对抗学习

- ASE (2022) 解决技能复用问题,预训练的技能库可以微调至下游任务

- DReCon (2019) 开创混合控制范式,生成器 (MM) + 跟踪器 (RL) 的架构被 PDP/PARC 继承

- 2024 年趋势:扩散模型成为主流(DiffuseLoco、MaskedMimic、UniPhys、PARC)

3.3 主线一:RL 模仿学习 (RL Lineage)

演进路径: Feature-Based Control (2010) → DeepLoco (2017) → DeepMimic (2018) → AMP (2021) → ASE (2022)

3.3.1 Feature-Based Control (SIGGRAPH 2010)

论文: 200.md

核心思想: 用高层物理特征设计控制器

方法框架:

flowchart LR

Define["定义特征"] --> Obj["设计目标函数"]

Obj --> Priority["优先级优化"]

Priority --> Solve["求解关节力矩τ"]

关键公式:

- Setpoint 目标:$E(x) = ||\ddot{y}_d - \ddot{y}||^2$

- 角动量目标:$E_{AM}(x) = ||\dot{L}_d - \dot{L}||^2$

- 优先级优化:$h_i = \min_x E_i(x)$ s.t. $E_k(x) = h_k, \forall k < i$

优点: 可解释、无需数据 缺点: 实现复杂、动态性差

3.3.2 DeepLoco (SIGGRAPH 2017)

论文: 218.md

核心创新: 分层深度强化学习 + 环境感知

方法框架:

flowchart TB

Terrain["32×32 地形图"] --> HLC["高层控制器 HLC<br/>2Hz 规划步法"]

HLC -->|"p̂₀, p̂₁, θ̂_root"| LLC["低层控制器 LLC<br/>30Hz 执行动作"]

LLC --> PD["PD 控制器"]

PD --> Sim["物理仿真"]

分层架构:

| 控制器 | 频率 | 输入 | 输出 |

|---|---|---|---|

| HLC | 2Hz | 地形图 + 任务目标 | 步法计划 (p̂₀, p̂₁, θ̂_root) |

| LLC | 30Hz | 状态 + 步法计划 | 关节 PD 目标 |

关键技术:

- 双线性相位变换: 将相位φ分 4 区间,强制不同阶段用不同子网络

- 参考动作引导: 不精确跟踪,只模仿风格

- 迁移学习: 同一 LLC 可复用多个 HLC 任务

优点: 环境感知、多任务支持、组件可复用 缺点: 训练时间长 (LLC 2 天+HLC 7 天)、采样效率低

3.3.3 DeepMimic (SIGGRAPH 2018)

论文: 201.md

核心创新: 深度 RL + 模仿学习

方法框架:

flowchart LR

Mocap["参考动作 mocap"] --> Reward["定义奖励 r^I+r^G"]

Reward --> PPO["PPO 训练π(a|s)"]

PPO --> PD["PD 控制器执行"]

PD --> Sim["物理仿真"]

模仿奖励:

$$ r^I_t = w_p r^p_t + w_v r^v_t + w_e r^e_t + w_c r^c_t $$

训练技巧:

- RSI (Reference State Initialization): 从参考动作随机状态开始

- ET (Early Termination): 跌倒立即终止

- 相位条件化: $\phi_t = (t \mod T_{cycle}) / T_{cycle}$

优点: 动作质量高、可学习动态动作 缺点: 每技能单独训练、样本效率低

3.4 主线二:混合控制 (Hybrid Lineage)

演进路径: DReCon (2019) → PDP (2024) → PARC (2025)

核心思想: 生成器(选择/生成参考轨迹)+ RL 跟踪器(保证物理稳定性)。

3.4.1 DReCon (SIGGRAPH Asia 2019)

论文: 190.md

核心架构:

flowchart LR

MM["Motion Matching"] --> RL["RL 规划"]

RL --> PD["PD 执行"]

PD --> Sim["物理仿真"]

Sim --> MM

创新点:

- 用 Motion Matching 替代 mocap 参考轨迹

- RL 输出 PD 目标而非直接力矩

- 支持实时响应

与 DeepMimic 的差异:

- DeepMimic: 跟踪单一 mocap 片段

- DReCon: 用 Motion Matching 选择参考轨迹

3.3.3 AMP: Adversarial Motion Priors (SIGGRAPH 2021)

论文: 198.md

核心创新: 用对抗学习从无标注数据学习

方法框架:

flowchart LR

Data["无标注 mocap"] --> D["判别器 D(s,s')"]

D --> Policy["策略π"]

Policy --> Adv["对抗奖励-log(1-D)"]

Adv --> Policy

对抗奖励:

$$ r_{adv} = -\log(1 - D(s_t, s_{t+1})) $$

AMP 的核心优势:

- 无需精确跟踪参考动作

- 能够从多样化数据集学习

- 自动学习技能组合

局限性:

- 训练不稳定(对抗博弈)

- GAN+RL 训练难度大

3.3.4 ASE: Adversarial Skill Embeddings (SIGGRAPH 2022)

论文: 199.md

核心创新: 预训练通用技能库 + 下游微调

两阶段训练:

flowchart TB

subgraph PreTrain["阶段 1: 预训练"]

Data["无标注数据集"] --> LowPolicy["低级策略π(a|s,z)"]

Data --> Discriminator["对抗 + 互信息"]

end

subgraph TaskTrain["阶段 2: 任务训练"]

Goal["任务目标 g"] --> HighPolicy["高级策略ω(z|s,g)"]

LowPolicyFixed["低级策略 (固定)"] --> Output["输出动作 a"]

HighPolicy --> LowPolicyFixed

end

PreTrain --> TaskTrain

预训练目标:

$$ \max_{\pi} -D_{JS}(d_{\pi} || d_M) + \beta I(s, s'; z | \pi) $$

与 AMP 的差异:

- AMP: 每任务从头训练

- ASE: 预训练可复用,技能库学习

优点: 技能可复用、支持插值和组合 缺点: 需要大规模并行模拟(Isaac Gym)

3.5 特殊应用:四足动物控制 (Mode-Adaptive)

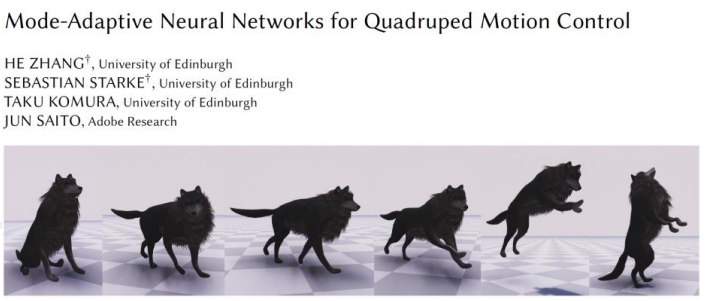

论文: 213.md

核心创新: 单个神经网络处理多种四足动物步态

架构:

flowchart TB

state["角色状态"] --> ModeEst["Mode 估计"]

cmd["用户命令"] --> ModeEst

terrain["地形信息"] --> ModeEst

ModeEst --> Adaptive["Adaptive 权重"]

state --> Control["控制器"]

cmd --> Control

Adaptive --> Control

Control --> Action["关节目标"]

优点:

- 流畅的步态切换

- 适应不同地形

- 自然运动质量

缺点:

- 仅适用于四足动物

- 需要 mocap 数据

3.6 主线三:预训练与统一表示 (Pretraining Lineage)

演进路径: ControlVAE (2023) → UniRep (2023) → MaskedMimic (2024) → UniPhys (2025)

3.6.1 ControlVAE (TOG 2023)

论文: 202.md

核心创新: 状态条件先验 + 世界模型

与 ASE 对比: | 维度 | ASE | ControlVAE | |------|-----|------------| | 先验类型 | 球面均匀分布 | 状态条件高斯 | | 学习方式 | 对抗 + 互信息 | 世界模型 + ELBO | | 技能表示 | 离散技能库 | 连续潜在空间 |

3.6.2 UniRep: Universal Humanoid Motion Representations (2023)

论文: 191.md

核心创新: 建立 Prior + Distillation + RL 的标准范式,用 CVAE 学习动作先验,再蒸馏进物理稳定的 Decoder

三阶段训练:

flowchart TB

Mocap["MoCap 数据"] --> CVAE["CVAE 训练"]

CVAE --> Prior["动作先验 z"]

TO["轨迹优化器"] --> Stable["物理稳定轨迹"]

Stable --> Distill["蒸馏到 Decoder"]

Prior --> RL["高层 RL"]

Distill --> RL

核心困境解决:

- MoCap 生成模型:动作自然但物理不稳定

- 纯轨迹优化:物理稳定但动作单调

方案: 用蒸馏将物理稳定性灌进网络,保留 z 的多样性

优点:

- 定型并普及了 Prior + Distillation + RL 的标准流水线

- 动作自然性与物理稳定性兼顾

缺点:

- 能力上限受限于轨迹优化器的求解能力

- 仅覆盖简单 Locomotion(走、跑、转向等)

3.7 特殊应用:实时虚拟化身 (Perpetual)

论文: 196.md

核心创新: 实时虚拟化身控制系统

系统架构:

flowchart LR

Input["视频/动捕/控制信号"] --> MotionGen["运动生成"]

MotionGen --> Track["物理跟踪控制器"]

Track --> Output["物理稳定全身控制"]

Output --> Disturb["扰动恢复"]

Disturb --> Track

特点:

- Meta 出品,面向 VR/AR 应用

- 实时优先,支持多种输入源

- 物理感知保证可行性

定位: 实时系统应用,不属于上述演进主线

3.8 主线四:扩散策略 (Diffusion Lineage)

演进路径: DiffuseLoco (2024)

核心思想: 使用扩散模型学习物理一致的控制策略。

3.8.1 DiffuseLoco (2024)

论文: 195.md

方法框架:

flowchart LR

Data["离线 mocap"] --> Diff["扩散模型π(a|s,goal)"]

Diff --> Distill["蒸馏 RL 策略"]

Distill --> Control["实时控制"]

优点: 离线训练、无需在线 RL

3.8.2 POMP: Physics-consistent Motion Prior (CVPR 2024)

论文: 112.md

核心创新: 基于相流形的物理一致运动先验,将动力学模块置于训练循环外

注意: POMP 虽然使用相位表示(类似相位系),但其核心是物理一致的运动生成,输出关节力矩并使用物理仿真器,因此属于动力学方法而非运动学相位系。

架构:

flowchart TB

subgraph Input["输入"]

state["角色状态 + 地形 + 轨迹"]

end

subgraph Kinematic["运动学模块"]

MoE["OrthoMoE Encoder"]

Diff["Diffusion Decoder"]

end

subgraph Dynamic["动力学模块"]

IK["逆动力学 PD 控制"]

FK["前向动力仿真"]

end

subgraph Phase["相位编码模块"]

PAE["Periodic Autoencoder"]

Align["语义对齐"]

end

Input --> MoE

MoE --> Diff

Diff --> IK

IK --> FK

FK --> Align

Align --> PAE

PAE --> MoE

style Kinematic fill:#e1f5fe

style Dynamic fill:#fff3e0

style Phase fill:#e8f5e9

三模块协作:

- 运动学模块: 基于扩散的运动先验生成初始姿态

- 动力学模块: 物理仿真确保物理合理性(接触力、碰撞)

- 相位编码模块: 将仿真姿态投影回运动先验的相流形

关键洞察:

- 直接反馈仿真结果会导致误差累积

- 相流形中的语义对齐解决领域鸿沟问题

- 动力学模块在训练循环外,计算高效

优点:

- 物理一致的运动生成

- 实时响应物理扰动

- 计算高效(动力学模块在训练循环外)

缺点:

- 依赖地形和冲量数据提取

- 复杂交互质量受限

3.8.3 PDP: Physics-Based Character Animation via Diffusion Policy (2024)

论文: 192.md

核心: RL 专家蒸馏 + 扩散策略

两阶段训练:

- 训练多个单任务 RL 专家

- 离线行为克隆蒸馏到单一 Diffusion Policy

与 DReCon 的继承关系:

- DReCon: Motion Matching + RL

- PDP: RL 专家 + Diffusion Policy

3.8.4 MaskedMimic (SIGGRAPH Asia 2024)

论文: 183.md

核心创新: 掩码运动补全统一多模态控制

CVAE 架构:

- 输入:多模态控制信号(掩码关键帧、对象、文本等)

- 输出:物理一致的 PD 控制目标

特点:

- 无需奖励工程

- 支持无缝任务切换

- 实时响应能力

与 UniPhys 的对比:

- MaskedMimic: 掩码补全范式

- UniPhys: Diffusion Forcing 范式

3.8.5 PARC (SIGGRAPH 2025)

论文: 189.md

核心创新: 基于物理仿真的迭代数据扩增框架

迭代循环:

flowchart TB

Gen["Motion Generator<br/>扩散模型"] --> Synth["合成新地形轨迹"]

Synth --> Track["Motion Tracker<br/>RL 物理修正"]

Track --> Filter["质量筛选"]

Filter --> Dataset["数据集扩增"]

Dataset --> Gen

四项关键机制防止性能退化:

- 固定采样比例: 保留原始 mocap 作为监督锚点

- 物理约束修正: RL 控制器修正为物理可信运动

- 质量筛选: 仅保留成功样本

- 小步迭代: 微调策略,防止分布漂移

应用场景: 敏捷地形穿越(如跑酷)

与 DReCon 的继承关系:

- DReCon: Motion Matching + RL 跟踪

- PARC: 扩散生成 + RL 跟踪 + 迭代扩增

3.8.6 UniPhys (2025)

论文: UniPhys: Unified Planner and Controller with Diffusion (2025)

核心创新: 统一规划器 + 控制器,Diffusion Forcing 范式

方法框架:

flowchart LR

Mocap["mocap 数据"] --> Preprocess["PD 控制预处理"]

Preprocess --> GT["物理合理 GT<br/>动作略僵硬"]

GT --> Train["训练 Diffusion 模型"]

MultiModal["多模态输入<br/>文本/轨迹/目标"] --> Infer["引导采样推理"]

Train --> Infer

Infer --> Output["物理合理运动"]

与 MaskedMimic 对比: | 维度 | MaskedMimic | UniPhys | |------|-------------|---------| | 训练范式 | 掩码补全 | Diffusion Forcing | | PD 目标来源 | mocap+ 跟踪 | mocap+PD 预处理 | | 长序列处理 | 较短序列 | 噪声历史去噪 |

优点:

- 无需强化学习和蒸馏

- 训练简单,单模型推理

- 物理合理但动作略僵硬

3.9 动力学方法对比

| 方法 | 训练范式 | 样本效率 | 动作质量 | 抗扰动 | 实时性 |

|---|---|---|---|---|---|

| Feature-Based | 无需训练 | N/A | 中 | 中 | ✓ |

| DeepLoco | 分层 RL | 低 | 高 | 高 | ✓ |

| DeepMimic | RL+ 模仿 | 低 | 极高 | 高 | ✓ |

| Mode-Adaptive | 模仿学习 | 中 | 高 | 高 | ✓ |

| DReCon | RL+MM | 中 | 高 | 高 | ✓ |

| AMP | 对抗学习 | 低 | 极高 | 高 | ✓ |

| ASE | 预训练 + 微调 | 高 | 极高 | 高 | ✓ |

| ControlVAE | 世界模型 | 高 | 高 | 高 | ✓ |

| Perpetual | 实时跟踪 | 高 | 高 | 高 | ✓ |

| UniRep | Prior+ 蒸馏 +RL | 高 | 高 | 高 | ✓ |

| DiffuseLoco | 离线蒸馏 | 高 | 极高 | 高 | ✓ |

| PDP | RL 专家蒸馏 | 中 | 极高 | 高 | ✓ |

| MaskedMimic | 掩码补全 | 高 | 极高 | 高 | ✓ |

| PARC | 迭代扩增 | 高 | 极高 | 高 | ⚠️ |

| UniPhys | 直接训练 | 高 | 高 | 高 | ⚠️ |

四、运动学 vs 动力学:技术选型指南

4.1 核心差异

| 维度 | 运动学方法 | 动力学方法 |

|---|---|---|

| 输出 | 关节姿态/速度 | 关节力矩/PD 控制目标 |

| 物理仿真 | 否 | 是 |

| 真实感来源 | 数据驱动 | 物理约束 + 数据 |

| 抗扰动能力 | 无 | 强 |

| 环境交互 | 有限 | 强 |

| 训练成本 | 低 - 中 | 中 - 高 |

| 实现难度 | 低 | 高 |

4.2 思想演进总结

运动学方法演进主线

-

相位表示线 (PFNN → Style Modelling → MOCHA → Phase Manifolds)

- 核心思想:用相位解耦不同动作状态

- 演进:全局相位 → 局部相位 → 相位流形插值

-

Motion Matching 线 (MM → Learned MM → MOCHA)

- 核心思想:用数据搜索生成动作

- 演进:数据库搜索 → 神经网络预测 → 角色化扩展

-

扩散模型线 (A-MDM → CAMDM → AAMDM → DART)

- 核心思想:扩散模型高质量生成

- 演进:1000 步 → 50 步 → 8 步 → 5 步,同时支持实时控制

动力学方法演进主线

-

RL 模仿线 (DeepMimic → AMP → ASE)

- 核心思想:从 mocap 数据学习控制策略

- 演进:单技能跟踪 → 对抗先验 → 预训练技能库

-

混合控制线 (DReCon → PDP → PARC)

- 核心思想:生成器 + RL 跟踪

- 演进:Motion Matching → RL 专家 → 扩散模型 + 迭代扩增

-

统一表示线 (ControlVAE → UniRep → MaskedMimic → UniPhys)

- 核心思想:统一潜在空间表示

- 演进:状态条件先验 → Prior+ 蒸馏 → 掩码补全 → Diffusion Forcing

4.3 应用场景推荐

| 应用场景 | 推荐方法 | 理由 |

|---|---|---|

| 游戏 NPC | DeepMimic / ASE / Learned MM | 实时、质量高、抗扰动 |

| 电影动画 | CAMDM / DART / MOCHA | 多样性、风格控制、无需物理 |

| VR 化身 | PFNN / CAMDM / MOCHA / Perpetual | 低延迟、稀疏输入支持 |

| 机器人仿真 | Feature-Based + RL / ASE | 安全、可解释、物理正确 |

| 在线游戏 | Learned Motion Matching | 低内存、服务器友好 |

| 角色设计 | MOCHA / Style Modelling | 风格转换、体型适配 |

| 四足动物 | Mode-Adaptive | 统一多步态控制 |

| 敏捷地形 | PARC / RTN (地形版) | 复杂地形穿越 |

| 多任务控制 | MaskedMimic / UniPhys | 统一框架处理多模态输入 |

4.4 方法选择决策树

flowchart TD

Q1["需要物理仿真/抗扰动?"] --> |否 | A1["运动学方法"]

Q1 --> |是 | A2["动力学方法"]

A1 --> Q2["需要风格转换?"]

Q2 --> |是 | A3["MOCHA / Style Modelling / CAMDM"]

Q2 --> |否 | A4["PFNN / Learned MM / AAMDM"]

A2 --> Q3["有无标注数据?"]

Q3 --> |无 | A5["AMP / ASE"]

Q3 --> |有 | A6["DeepMimic / DiffuseLoco"]

A6 --> Q4["需要多模态控制?"]

Q4 --> |是 | A7["MaskedMimic / UniPhys"]

Q4 --> |否 | A8["PDP / DiffuseLoco"]

A2 --> Q5["需要敏捷地形穿越?"]

Q5 --> |是 | A9["PARC"]

五、开放性问题与未来趋势

5.1 技术挑战

-

实时性与质量权衡

- 扩散模型推理速度仍是瓶颈

- 方向:一致性模型、蒸馏、更少去噪步数

-

长时序规划

- 当前方法多为短时域反应式

- 方向:分层控制、世界模型、Diffusion Forcing

-

多角色泛化

- 技能绑定特定形态

- 方向:形态无关表示、零样本迁移

-

与语言模型结合

- 自然语言指令驱动

- 方向:LLM + 运动生成联合训练

-

在线适应

- 适应新环境、新扰动

- 方向:Test-Time Training、元学习、迭代扩增(如 PARC)

5.2 未来趋势

-

运动学 + 动力学融合

- 运动学方法生成参考轨迹

- 动力学方法保证物理可行性

- 代表工作:UniPhys、PARC

-

世界模型 + 扩散

- 学习可微物理引擎

- 在 latent space 规划

-

多模态大模型

- 视觉 + 语言 + 运动联合训练

- 具身智能 (Embodied AI)

-

自动技能发现

- 无监督发现技能层级

- 类似 LLM 的 emergent abilities

-

数据高效学习

- 少样本风格学习

- 迭代数据扩增(PARC 范式)

六、关键论文索引

运动学方法

| 论文 | 年份 | 链接 | 核心贡献 |

|---|---|---|---|

| PFNN | 2017 | 113 | 相位函数化权重 |

| Few-shot Locomotion Styles | 2018 | 214 | 残差适配器 +CP 分解,少样本风格学习 |

| Local Motion Phases | 2020 | 216 | 局部相位表示 |

| RTN | 2018 | 210 | 循环转移网络 |

| Style Modelling | 2020 | 211 | 特征变换 + 局部相位 |

| Learned Motion Matching | 2020 | 208 | 神经网络替代数据库 |

| MOCHA | 2023 | 209 | 上下文匹配角色化 |

| Phase Manifolds | 2023 | 212 | 相位流形中间帧 |

| POMP | 2023 | 112 | 物理一致运动先验 |

| A-MDM | 2024 | 206 | 自回归扩散模型 |

| CAMDM | 2024 | 207 | 8 步去噪 + 风格转换 |

| AAMDM | 2024 | 204 | 5 步 DD-GAN+ADM |

| DARTControl | 2025 | 205 | 潜在空间控制 |

动力学方法

| 论文 | 年份 | 链接 | 核心贡献 |

|---|---|---|---|

| Feature-Based Control | 2010 | 200 | 高层物理特征控制 |

| DeepMimic | 2018 | 201 | RL+ 模仿学习 |

| Mode-Adaptive | 2018 | 213 | 四足动物统一控制 |

| DReCon | 2019 | 190 | Motion Matching+RL |

| AMP | 2021 | 198 | 对抗运动先验 |

| ASE | 2022 | 199 | 预训练技能嵌入 |

| ControlVAE | 2023 | 202 | 状态条件先验 |

| Perpetual | 2023 | 196 | 实时虚拟化身 |

| UniRep | 2023 | 191 | 统一表示 + 蒸馏 |

| DiffuseLoco | 2024 | 195 | 扩散策略 |

| PDP | 2024 | 192 | RL 专家蒸馏 |

| MaskedMimic | 2024 | 183 | 掩码运动补全 |

| PARC | 2025 | 189 | 迭代数据扩增 |

| UniPhys | 2025 | 184 | 统一规划 + 控制 |

七、总结

角色位移控制领域呈现双轨并行、多线演进的发展态势:

运动学方法沿四大主线演进:

- 相位系:PFNN 的相位函数化权重 (2017) → Few-shot Styles 的残差适配器 +CP 分解 (2018) → Local Motion Phases 的局部相位 (2020) → Style Modelling 的特征变换 (2020) → Phase Manifolds 的相位流形插值 (2023)

- RTN (Transition Generation): 循环转移网络 (2018),专用 transition 生成

- Motion Matching 系:工业界标准 Motion Matching → Learned Motion Matching 的神经网络替代 → MOCHA 的上下文匹配角色化

- 扩散模型系:A-MDM 的自回归设计 → CAMDM 的 8 步去噪 + 风格转换 → AAMDM 的 5 步加速 → DART 的潜在空间控制

动力学方法沿三条主线演进:

- RL 模仿线:DeepMimic 的 RL+ 模仿 → AMP 的对抗先验 → ASE 的预训练技能库

- 混合控制线:DReCon 的 Motion Matching+RL → PDP 的 RL 专家蒸馏 → PARC 的扩散生成 + 迭代扩增

- 统一表示线:ControlVAE 的状态条件先验 → UniRep 的 Prior+ 蒸馏范式 → MaskedMimic 的掩码补全 → UniPhys 的 Diffusion Forcing

融合趋势:2024-2025 年的工作开始探索运动学 + 动力学的融合:

- UniPhys 用 PD 预处理保证物理合理性

- PARC 用迭代扩增结合生成与物理修正

- Perpetual 实现实时物理跟踪

这将是未来的重要方向。

参考文献: 详见各论文笔记文件

本文出自CaterpillarStudyGroup,转载请注明出处。

P2

Outline

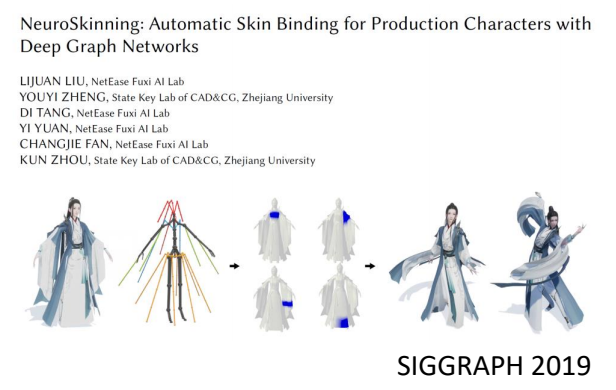

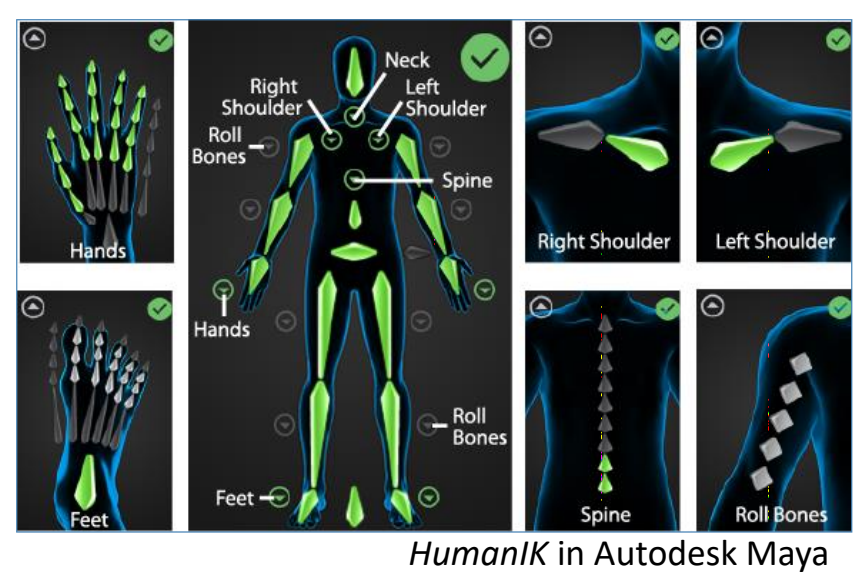

🔎 SIGGRAPH 经典的蒙皮课程。

Many images are from: https://skinning.org/

Alec Jacobson, Zhigang Deng, Ladislav Kavan, and J. P. Lewis. 2014.

Skinning: real-time shape deformation.

In ACM SIGGRAPH 2014 Courses (SIGGRAPH '14)

P7

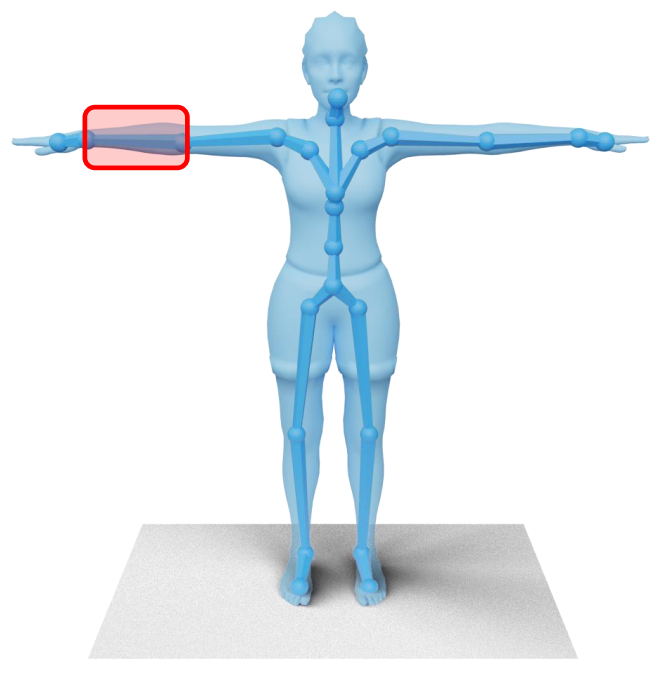

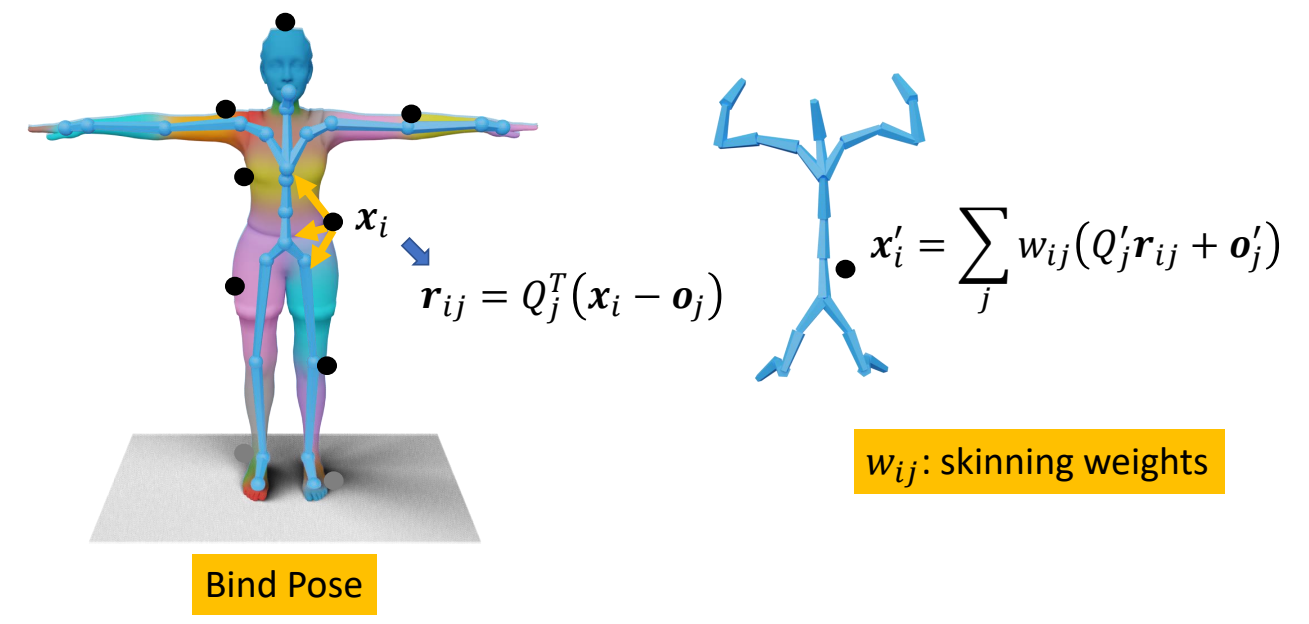

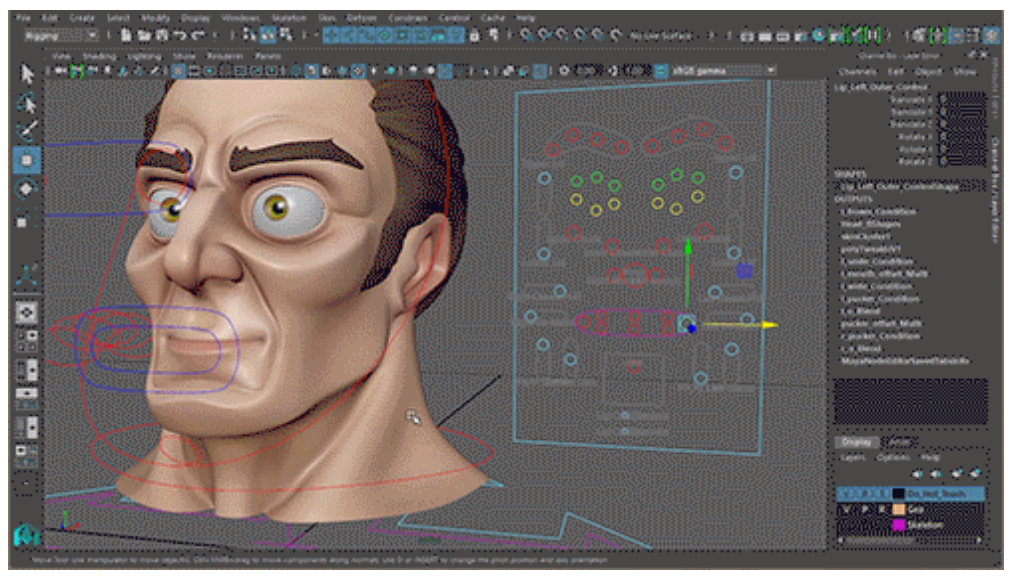

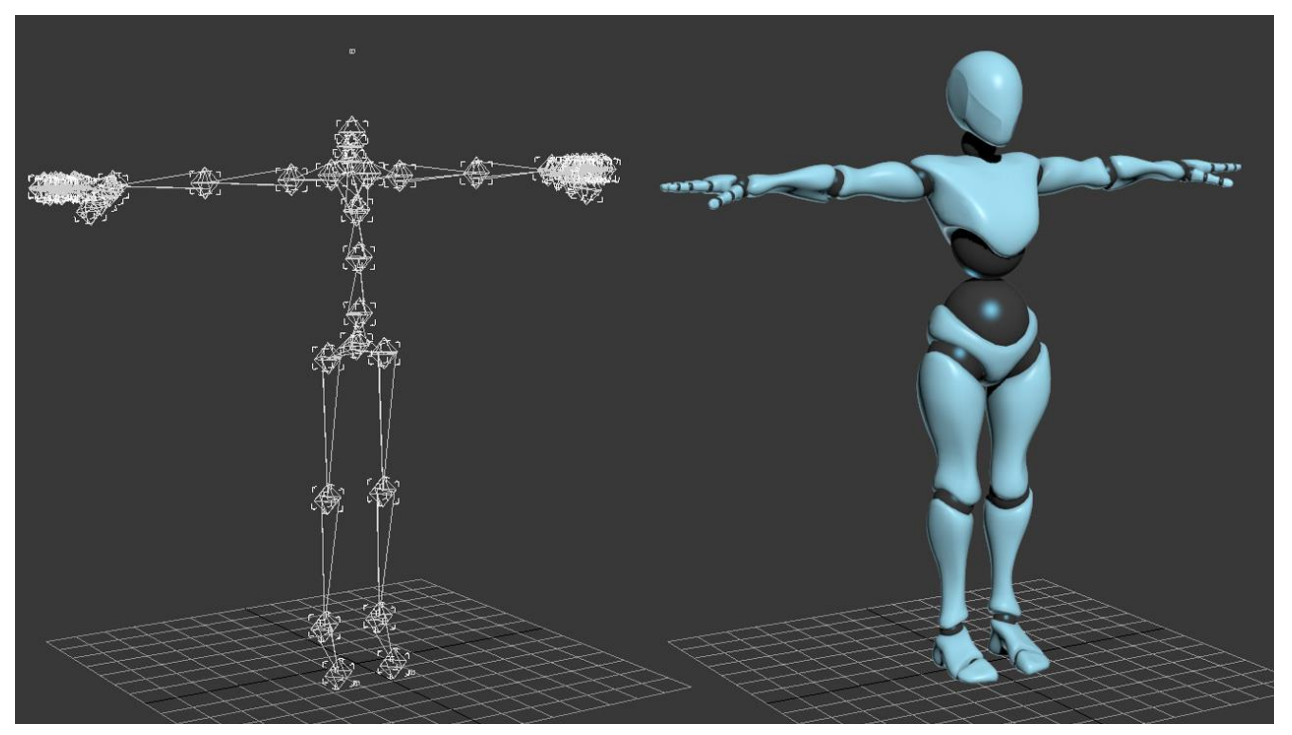

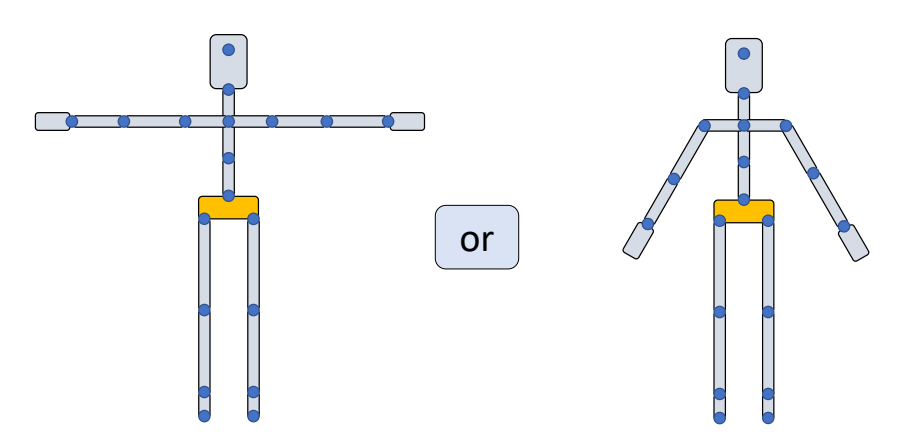

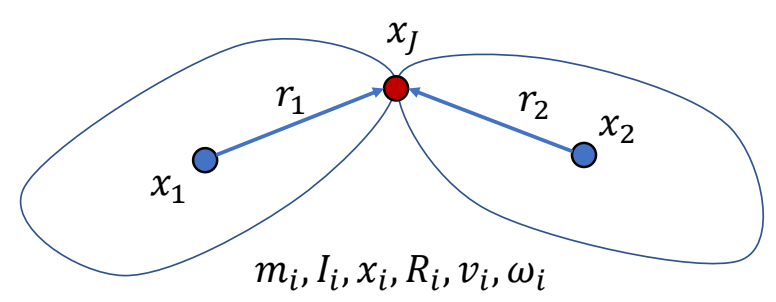

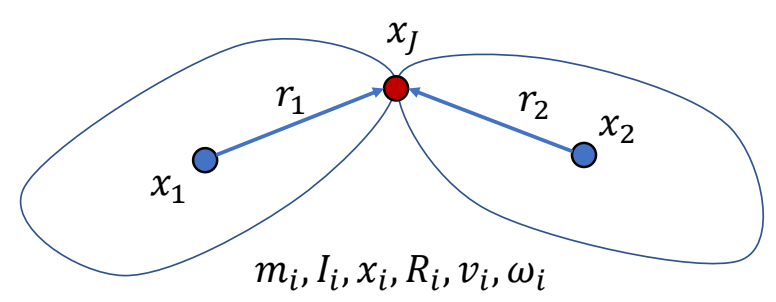

Skinning Deformation

绑定与蒙皮概念

✅ Rigging:创建脸部控制器或身体骨骼。黄色为在 Mesh 顶点内放置的骨骼。

✅ Sinning:让控制器带动皮肤运动。或让 Mesh 顶点跟着骨骼运动。

骨骼代理的角色驱动的局限性

- 非刚性形变:

- LBS(线性混合蒙皮)无法表达肌肉膨胀、软组织形变

- 解决方案:PartMM(Part-aware Mixture Model)替代LBS

- 高频细节丢失:

- 骨骼代理只能捕获低频运动(关节旋转)

- 解决方案:法线修正、位移残差学习

P12

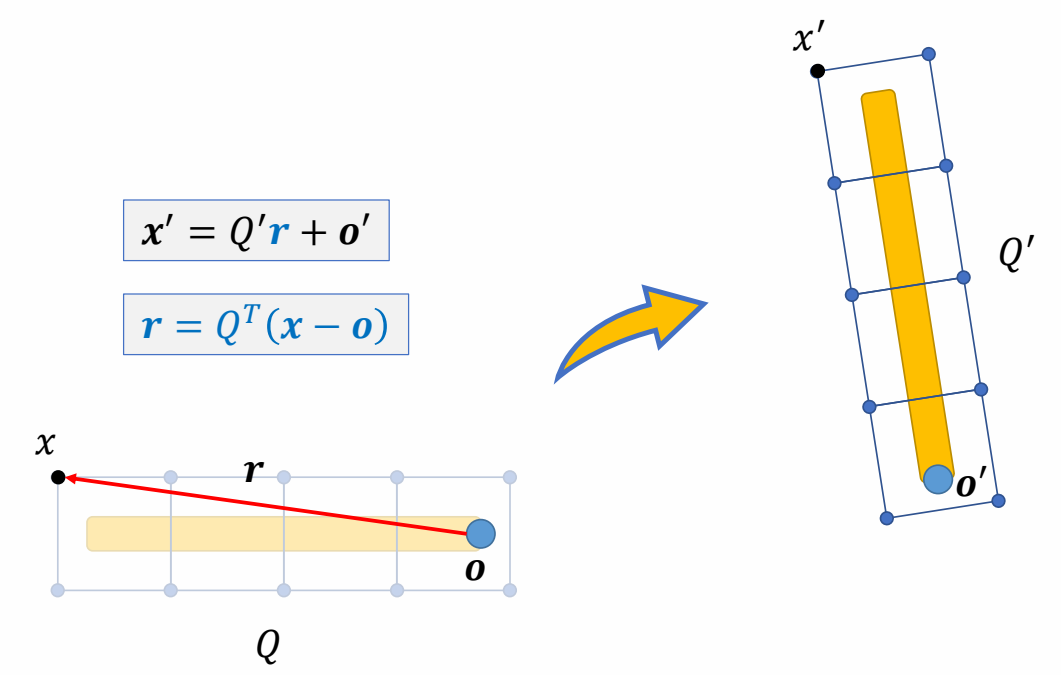

Skinning Deformation

计算方式一

✅ 骨骼运动的旋转和平移分别为 \(R\) 和 \(t\),关节的位置和朝向则变成了 \({Q}'\) 和 \({o}'\).

✅ 求 \(x\) 的新位置 \({x}'\). 本质上就是坐标系变换:世界坐标系 → \({o}\) 坐标系 → \({o}'\) 坐标系 → 世界坐标系

P13

计算方式二

✅ \(r\) 为 \(x\) 在骨骼坐标的表达,用 \(r\) 计算更简洁。

P16

Bind Pose

✅ 当骨骼参考姿态与 Mesh 参考姿态不一致时,需要先旋转骨骼到 Mesh 姿态。

P20

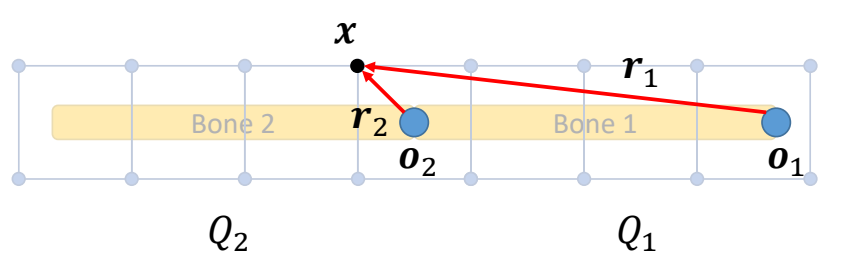

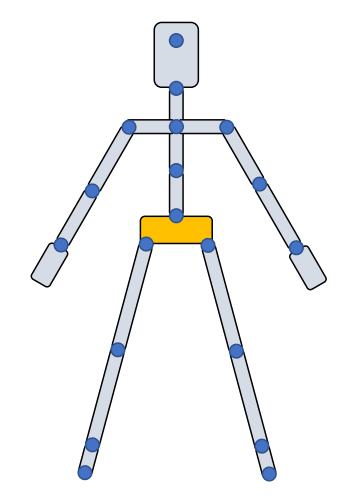

Skinning Deformation - 2 joints

$$ r_2=Q^T_2(x-o_2) \quad \quad r_1=Q^T_1(x-o_1) $$

✅ 多骨骼场景,\(x\) 在关节 \(O_1\) 和 \(O_2\) 下分别 \(r_1\) 和 \(r_2\) 两种表达。

P23

✅ 得到的旋转后表达分别为 \({x}'_1\) 和 \({x}'_2\),通过权重对它们结合。

P29

✅ 同时考虑所有 Mesh 顶点和所有关节。

补充:LBS 基础(

LBS 是最流行的角色蒙皮方法。它的核心公式:

$$ \mathbf{v} _{i} ^{t} = \sum _{j=1}^{|B|} w _{ij} \left( \mathbf{R} _{j} ^{t} \mathbf{p} _{i} + \mathbf{T} _{j} ^{t} \right) $$

| 符号 | 含义 | 通俗解释 |

|---|---|---|

| \(\mathbf{v} _{i} ^{t}\) | 第 \(t\) 个姿态中第 \(i\) 个顶点的位置 | 动画中某一帧的某个表面点 |

| \(\mathbf{p} _{i}\) | 静止姿态中第 \(i\) 个顶点的位置 | 角色摆好标准姿势时的那个点 |

| \(w _{ij}\) | 第 \(j\) 根骨头对第 \(i\) 个顶点的影响权重 | 这根骨头对这个点有多大的控制力 |

| \(\mathbf{R} _{j} ^{t}\) | 第 \(t\) 个姿态中第 \(j\) 根骨头的旋转矩阵 | 这根骨头转了多少 |

| \(\mathbf{T} _{j} ^{t}\) | 第 \(t\) 个姿态中第 \(j\) 根骨头的平移向量 | 这根骨头平移了多少 |

| \( | B | \) |

通俗理解:

想象你有一块橡皮泥(顶点),它被钉在几根棍子(骨头)上。

每根棍子上都有一个钉子,钉子对橡皮泥的拉力就是权重 w。

当棍子移动时,橡皮泥的位置 = 每根棍子拉力 × 棍子移动距离 的总和

LBS 权重的约束条件

为了让 LBS 模型有意义,权重 \(w _{ij}\) 需要满足三个条件:

-

非负性(Non-negativity):\(w _{ij} \geq 0\)

- 骨头不能"推"顶点,只能"拉"

-

凸性/仿射性(Affinity):\(\sum _{j=1}^{|B|} w _{ij} = 1\)

- 所有骨头对一个顶点的总影响权重等于 1

- 这保证了如果所有骨头都不动,顶点也不动

-

稀疏性(Sparseness):\(|\{w _{ij} | w _{ij} \neq 0\}| \leq |K|\)

- 每个顶点最多被 \(|K|\) 根骨头影响

- 在实际应用中,通常 \(|K| = 4\)(称为 4-bone skinning)

- 这是为了 GPU 加速——每个顶点只需计算 4 个变换

刚性骨骼约束

旋转矩阵 \(\mathbf{R} _{j} ^{t}\) 必须满足正交约束:

$$ \mathbf{R} _{j} ^{t} {}^{T} \mathbf{R} _{j} ^{t} = \mathbf{I}, \quad \det(\mathbf{R} _{j} ^{t}) = 1 $$

通俗理解:

"刚性"意味着骨头不能被拉伸、压缩或剪切。

旋转只会改变方向,不会改变长度。

对比:

- 刚性旋转:把一本书转个角度,书还是原来的形状

- 非刚性变换:把一本书拉长、压扁、撕扯——这些都不允许

P31

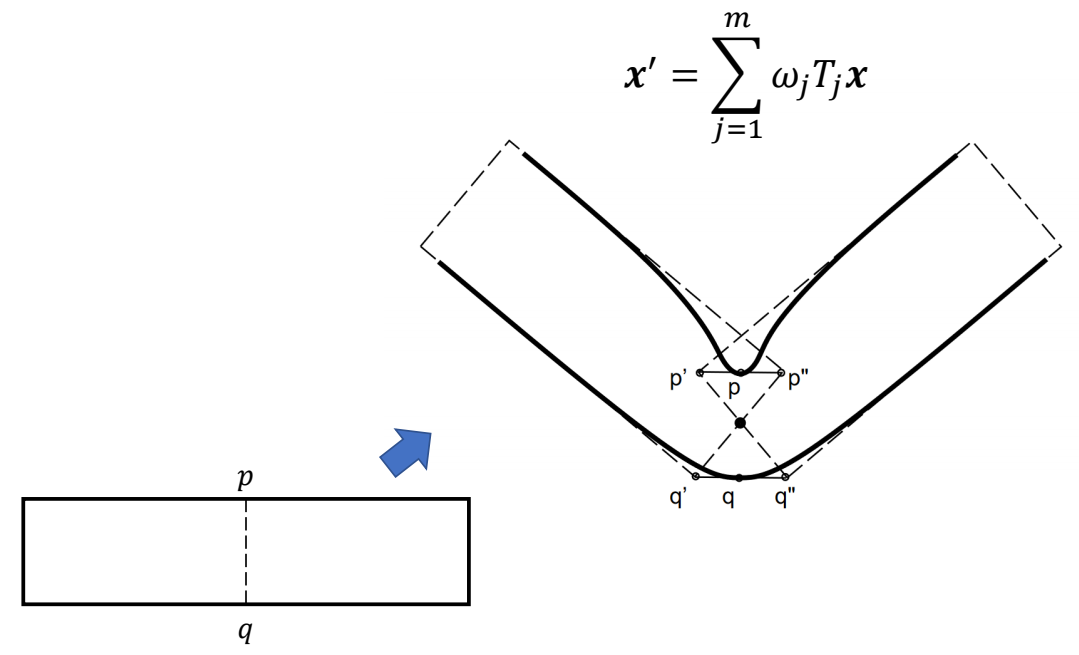

Linear Blend Skinning (LBS)

$$ {x}'_ i= \sum_ {j=1} ^ {m} w _ {ij}({Q}'_ jr_{ij}+{o}'_j) $$

- Used widely in industry

- Efficient and GPU-friendly

- Games like it

✅ Bind Pose:让骨骼与 Mesh 对齐,为 Bind Pose.

✅ Bind Pose 情况下 Motion 不一定为零。

P33

Automatic Skinning?

|

|

Pinocchio [Baran et al., 2007]

P37

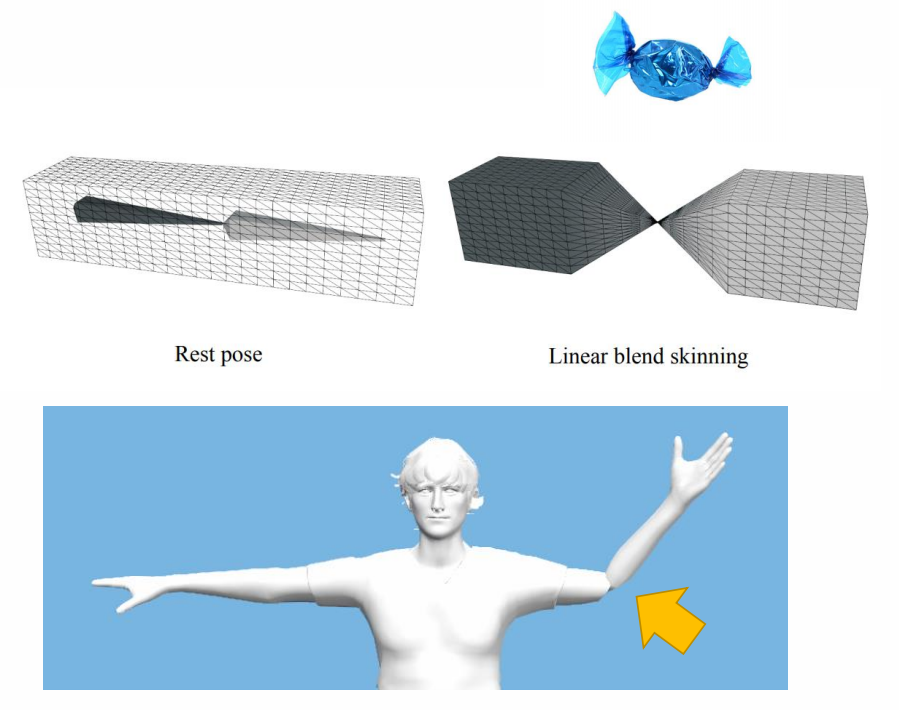

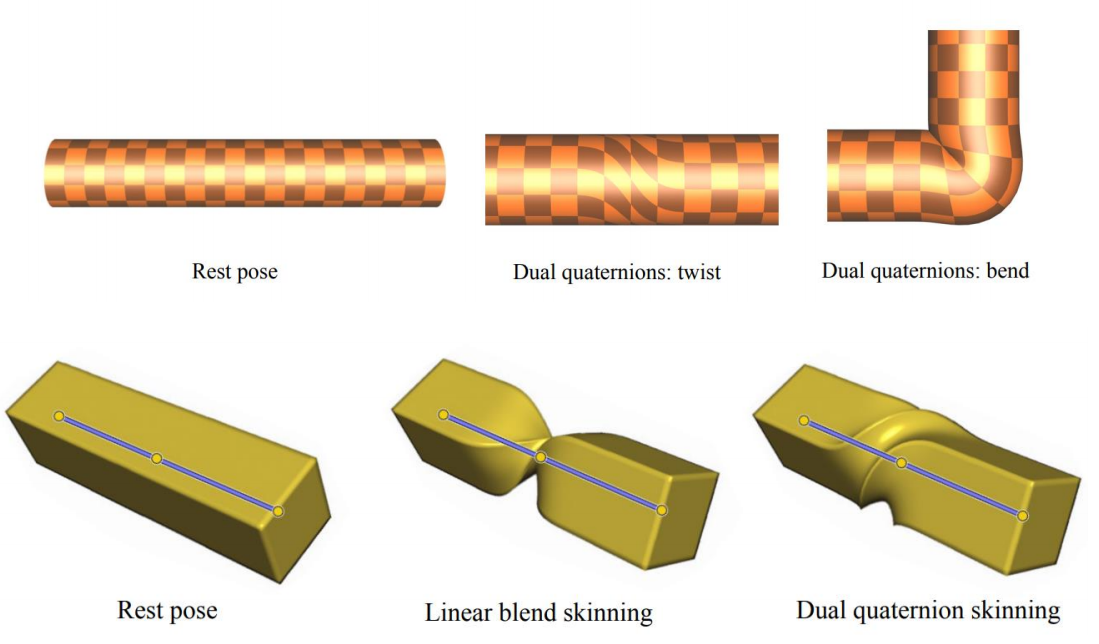

Linear Blend Skinning (LBS)

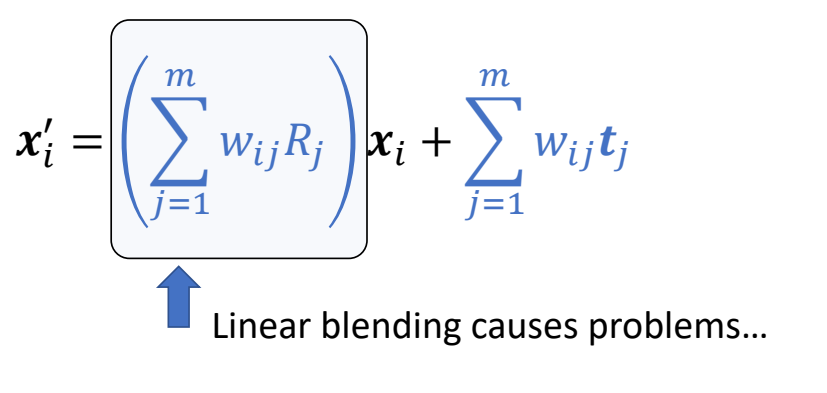

✅ 公式第一项对 \(R_j\) 所加权,所得到的很有可能不再是旋转矩阵。

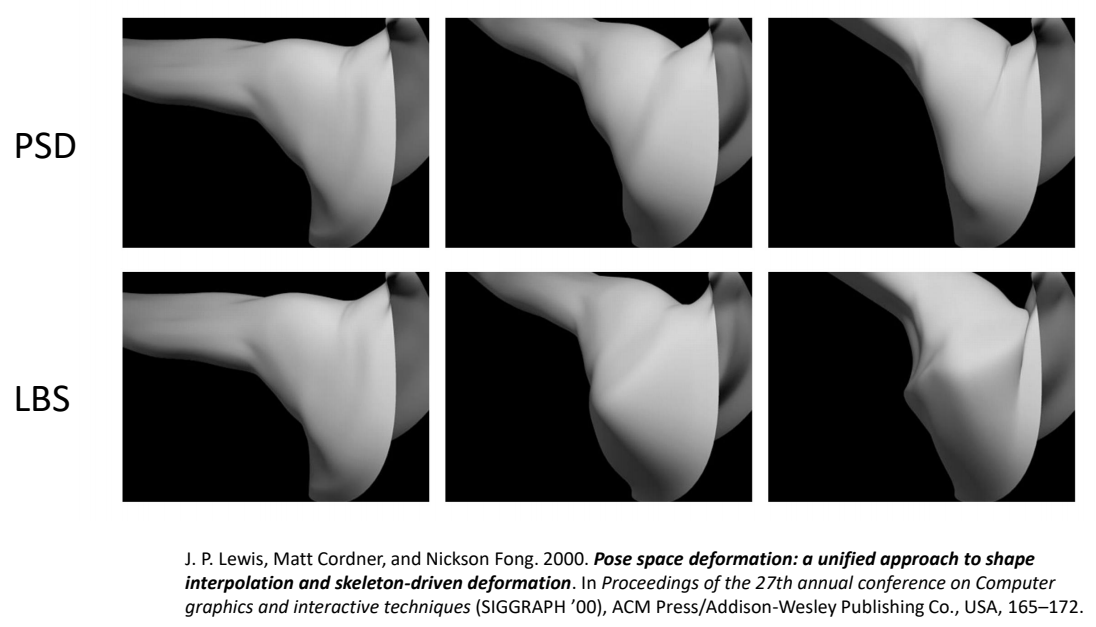

存在的问题: Candy-Wrapper Artifact

P40

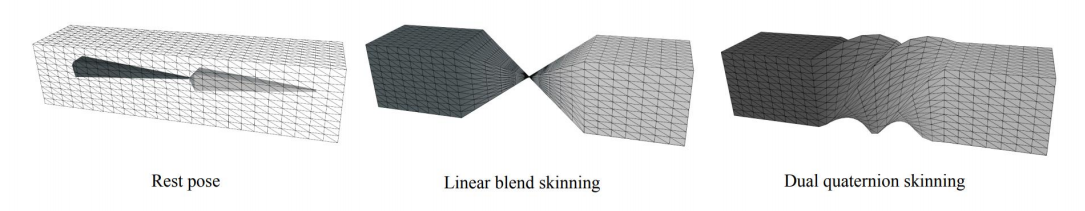

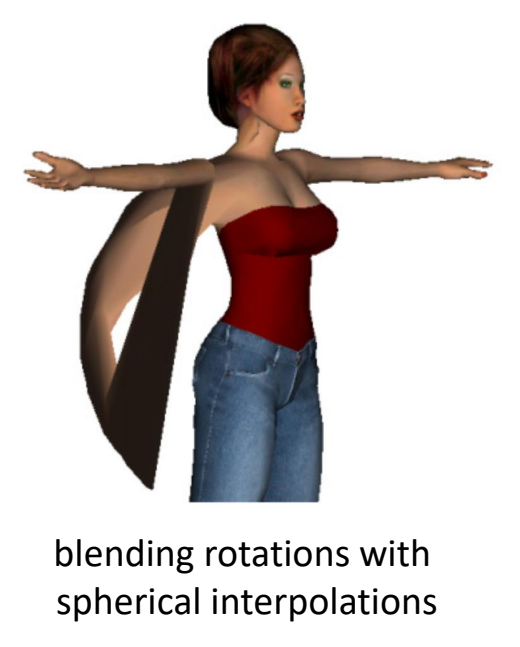

Advanced Skinning Methods

-

Multi-linear Skinning (we will not cover this)

- Multi-weight enveloping [Wang and Phillips 2002]

- Animation Space [Merry et al. 2006]

- ……

-

Nonlinear Skinning

- Dual-quaternion Skinning (DQS)

- Skelebones (PartMM) — GaussiAnimate (ReadPapers/220): 用 Part-aware Mixture Model 替代 LBS。核心:(1) 用空间距离 softmax 计算 part affinity 概率替代人工皮肤权重;(2) 用 MLP 学习的非线性残差 \(x + \Delta T_j(x)\) 替代刚体变换,突破 LBS 线性上限,PSNR 比 LBS 高 17.3%。原本用于 3DGS 驱动,理论上也可用于 Mesh 驱动,但 Mesh 场景下面临三个问题:(1) MLP 推理比 LBS 矩阵乘法慢,不利于实时渲染;(2) MLP 输出可能跨帧跳跃,时间一致性不如 LBS 稳定;(3) 现有引擎全基于 LBS/DQS 构建,替换绑定方案工程成本高。Mesh 本身有拓扑约束兜底,LBS/DQS/SSD 已足够;PartMM 对没有拓扑的 3DGS 价值更大。

✅ DQ:对偶四元数。

P41

Non-linear Skinning

quaternions and SLERP

Can we use quaternions and SLERP?

P42

✅ 不行。原因:第一项与第二项必须要配合好,否则会乱掉。

P43

从公式角度来解释不行的原因

$$ {x}' _ i = ( \sum _ {j=1}^{m} w _ {ij} R _ j) x _ i+ \sum _ {j=1}^{m}w _ {ij}t_ j $$

$$ R \in SO(3) $$

$$ T_j=\begin{bmatrix} R_j & t_j\\ 0 &1 \end{bmatrix} \in SE(3) $$

✅ \(T_j\) 构成一个刚性变换群。

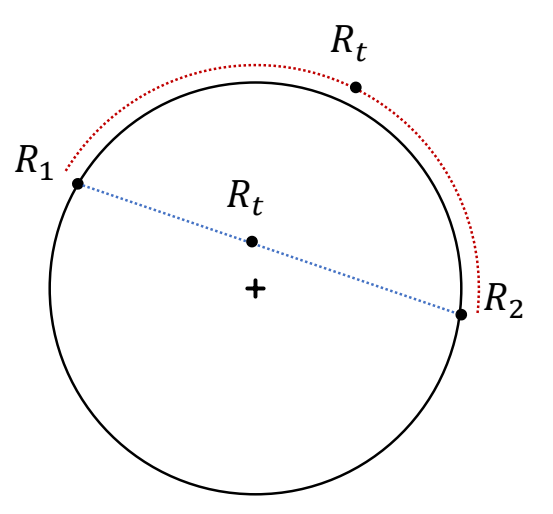

P46

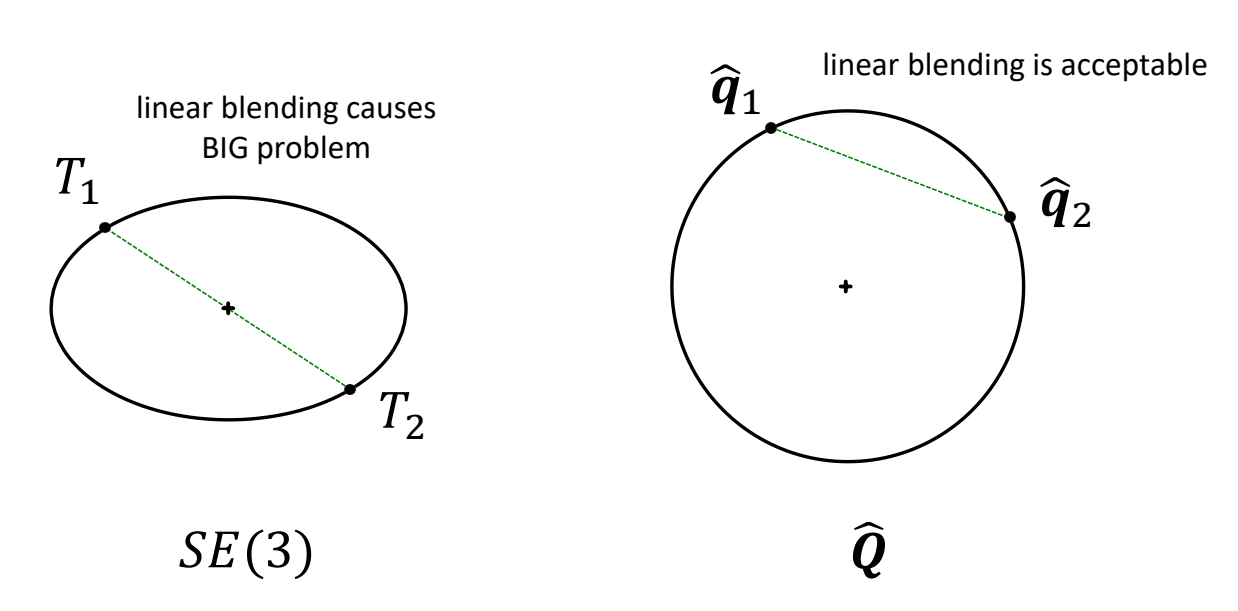

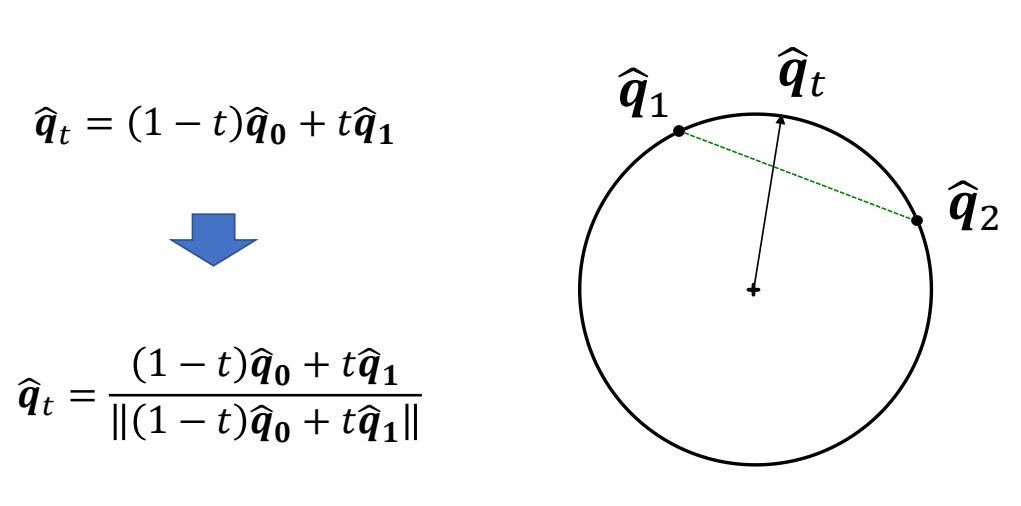

Interpolation in 𝑆𝑂(3)

✅ 线性插值和 SLERP 插值 SO(3) 上。

P49

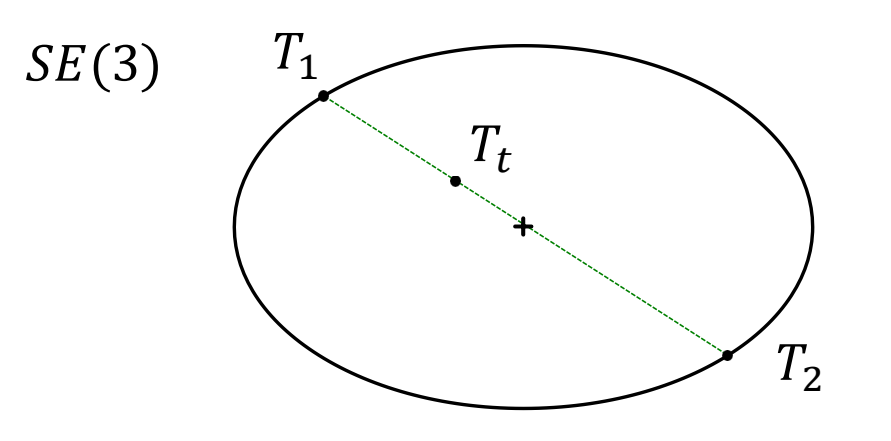

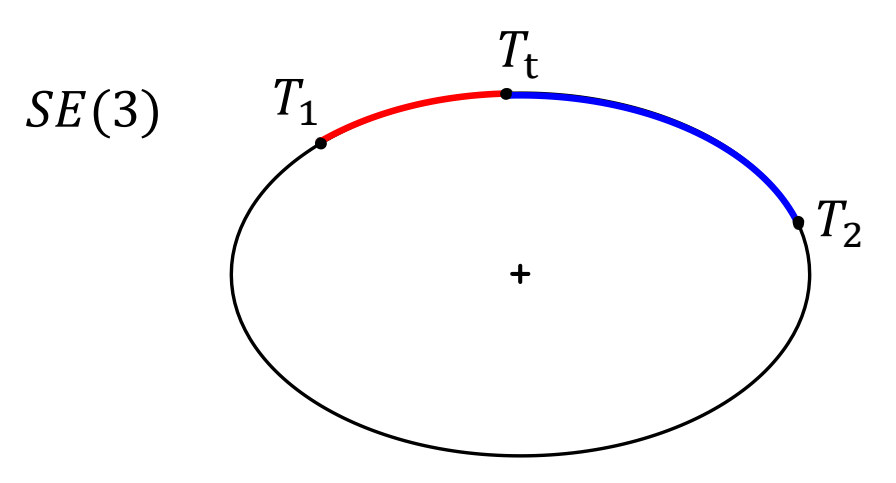

Interpolation in 𝑆𝐸(3)

✅ SE(3)上的线性插值,插值到一个退化的点。

P51

Intrinsic Blending

P52

Dual-Quaternion Skinning (DQS)

- Approximation of intrinsic averages in SE(3)

Ladislav Kavan, Steven Collins, Jiri Zara, Carol O‘Sullivan. Geometric Skinning with

Approximate Dual Quaternion Blending, ACM Transaction on Graphics, 27(4), 2008.

✅ 把旋转 + 平移的刚性变换表达为对偶四元数。

P54

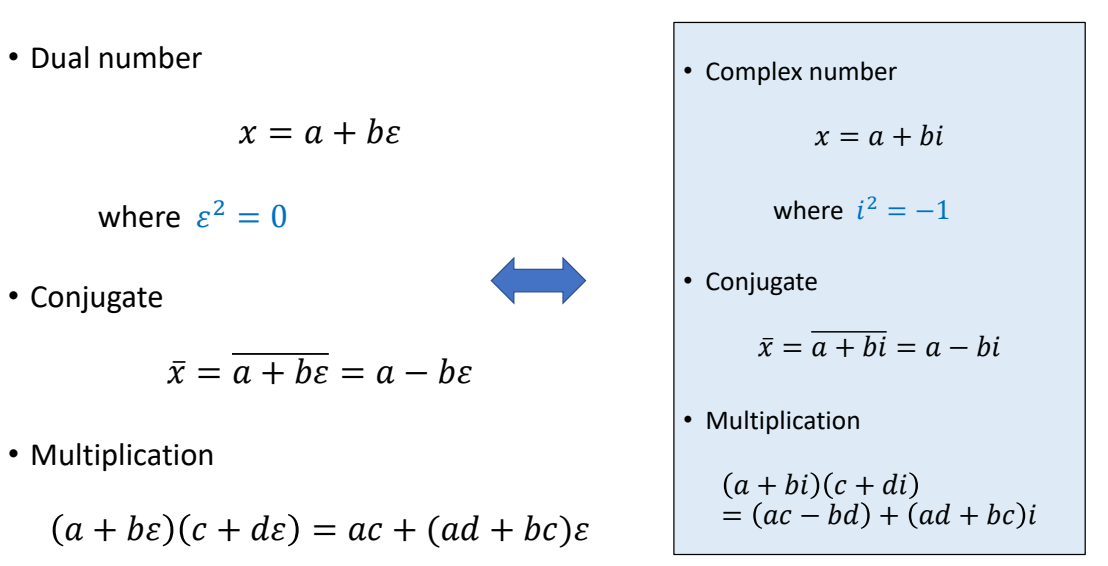

Dual Numbers

P55

Dual Quaternion

- Dual quaternion

$$ \hat{q} =q_0 + \varepsilon q_\varepsilon $$

$$ \text{where } \varepsilon^2=0 $$

A good note of dual-quaternion:

https://faculty.sites.iastate.edu/jia/files/inline-files/dual-quaternion.pdf

P56

Dual Quaternion

- Scalar Multiplication

$$ s\hat{q}=sq_r+sq_\varepsilon\varepsilon $$

- Addition

$$ \hat{q} _ 1 + \hat{q} _2=q _ {r1}+ q _ {r2} + \varepsilon (q _ {\varepsilon 1} + q _ {\varepsilon 2}) $$

- Multiplication

$$ \hat{q} _ 1 \hat{q} _ 2 = q _ {r1} q _ {r2} + \varepsilon (q _ {r1} q _ {\varepsilon 2} + q _ {r2} q _ {\varepsilon 1}) $$

P57

Dual Quaternion

- Dual quaternion

$$ \hat{q}=q_0+\varepsilon q_\varepsilon $$

- Conjugation

$$ \mathrm{I}:\hat{q}^* =q ^ * _ 0+\varepsilon q ^ * _ \varepsilon $$

$$ \mathrm{II}:\hat{q}^ {\circ} =q _ 0 - \varepsilon q _ \varepsilon $$

$$ \mathrm{III}: \hat{q} ^ \star = q ^ * _ 0 - \varepsilon q ^ *_ \varepsilon $$

$$ \quad \quad \quad \quad = ({\hat{q} ^ *}) ^ {\circ} = (\hat{q} ^ {\circ}) ^ * $$

$$ (\hat{q} _1\hat{q}_2)^\times =\hat{q} _1 ^\times \hat{q}_2^\times $$

- Norm

$$ ||\hat{q}||=\sqrt{\hat{q}^*\hat{q}} =||q_0||+\frac{\varepsilon (q_0\cdot q_\varepsilon) }{||q_0||} $$

P58

Dual Quaternion

- Unit dual quaternion: \(||\hat{q}||=1\), which requires:

$$ ||q_0||=1 $$

$$ q_0 \cdot q_\varepsilon=0 $$

P59

Dual Quaternion ⇔ Rigid Transformation

- Like quaternion, any rigid transformation \(T \in SE(3)\) can be converted into a unit dual quaternion

$$ Tx=Rx+t $$

$$ T=[R\mid t]\to \hat{q} =q_0+\varepsilon q_\varepsilon $$

$$ \begin{matrix} q_0=r \quad & \text{ quaternion of } R \quad \quad\quad\quad\\ q_\varepsilon =\frac{1}{2} tr & \text{ pure quaternion } t = (0,t) \end{matrix} $$

✅ 把一个刚性变换表示为对偶四元数。

P60

Dual Quaternion ⇔ Rigid Transformation

- Transform a vector \(v\) using unit dual quaternion

$$ {\hat{v} }' =\hat{q} \hat{v} \hat{q} ^\star $$

where

$$ \begin{align*} \hat{v} & = 1+\varepsilon (0,v) \\ & =(1,0,0,0)+\varepsilon (0,v_x,v_y,v_z) \end{align*} $$

$$ \quad $$

$$ \mathrm{III}: \hat{q} ^ \star = q ^ * _ 0 - \varepsilon q ^ *_ \varepsilon $$

$$ \quad \quad \quad \quad = ({\hat{q} ^ *}) ^ {\circ} = (\hat{q} ^ {\circ}) ^ * $$

P61

Dual Quaternion ⇔ Rigid Transformation

- Like quaternion, any rigid transformation \(T \in SE(3)\) can be converted into a unit dual quaternion

$$ T=[R\mid t]\to \hat{q} =q_0+\varepsilon q_\varepsilon $$

$$ \begin{matrix} q_0=r \quad \\ q_\varepsilon =\frac{1}{2} tr \end{matrix} $$

\(\hat{q}\) and \(-\hat{q}\) represent the same transformation \(\hat{Q}\) is a double cover of \(SE(3)\)

P62

Double Cover Visualized

P63

Interpolating Dual-Quaternion

P64

Dual-Quaternion Linear Blending (DLB)

P65

Dual-Quaternion Skinning (DQS)

P66

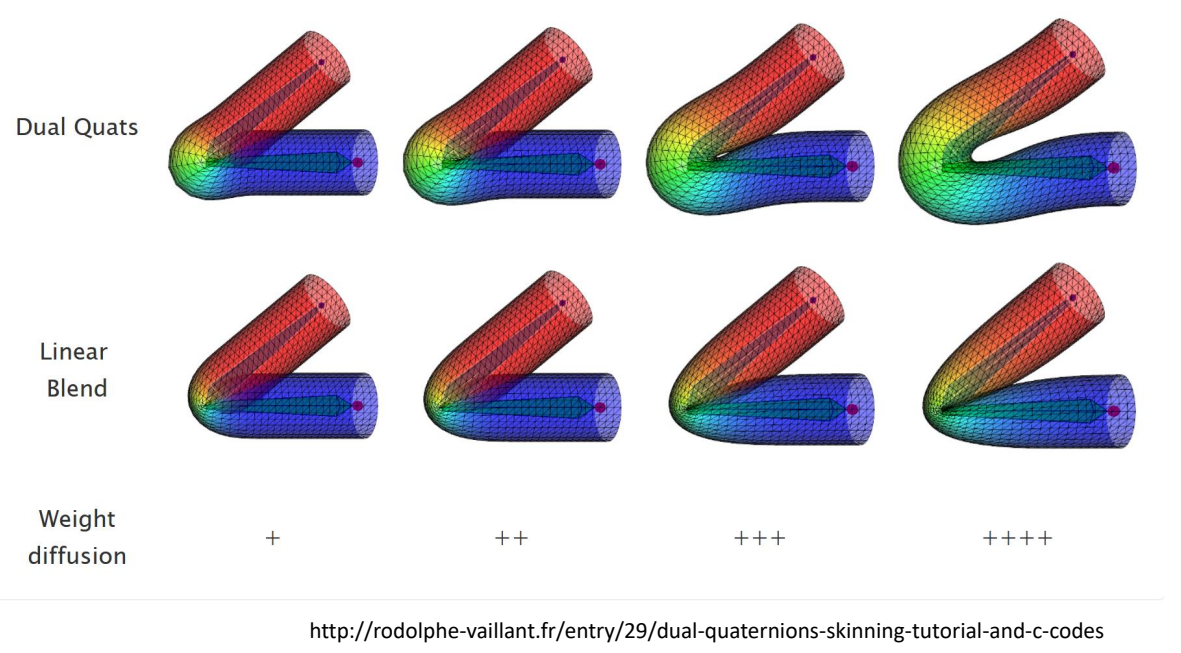

Budging Artifact of DQS

✅ 越往右蒙皮权重越光滑。

✅ DQBS 也有比较严重的 artifacts.

P67

How to Correct LBS?

✅ LBS 的天然缺陷

P69

How to Correct LBS?

P74

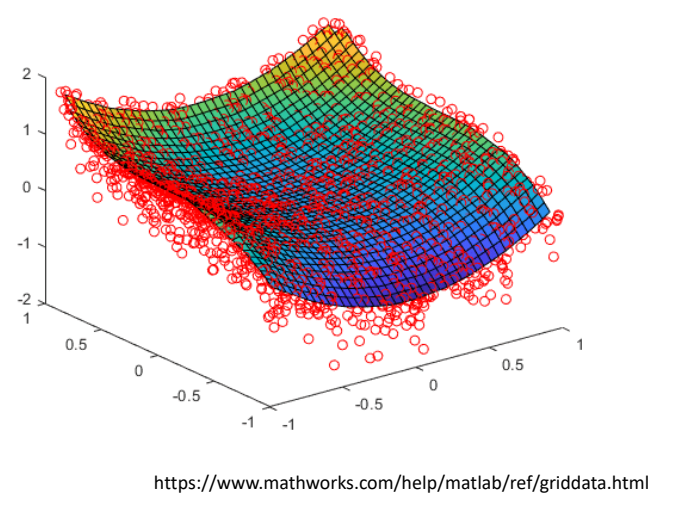

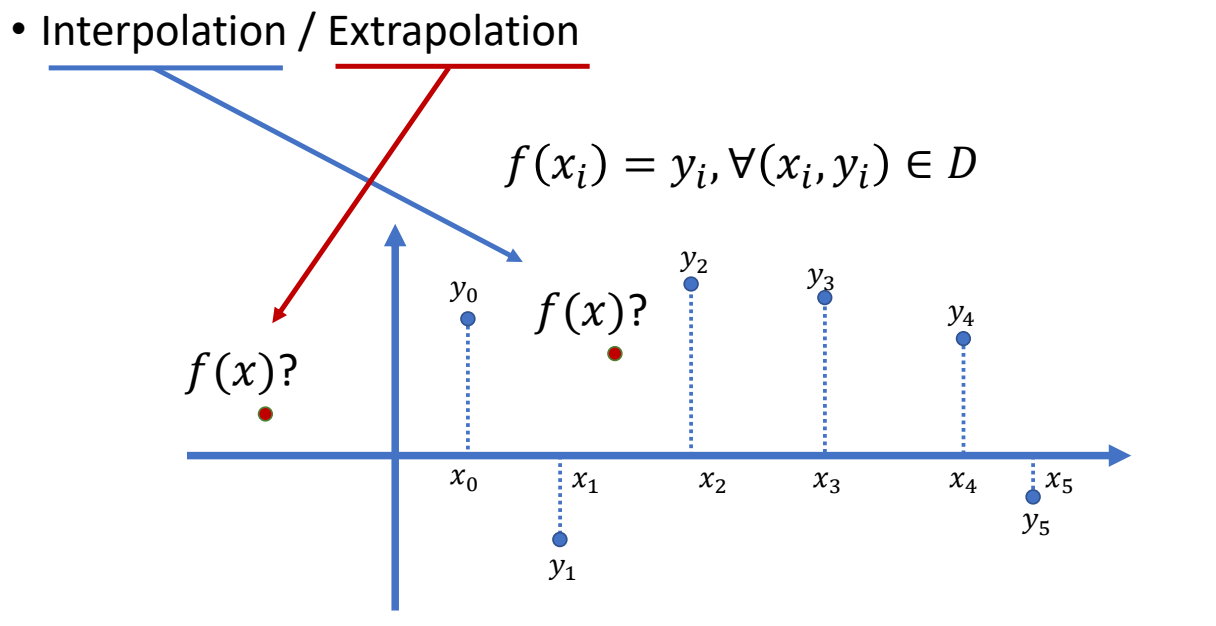

Scattered Data Interpolation

P76

Scattered Data Interpolation

- Linear

- Least squares

- Splines

- Inverse distance weighting

- Gaussian process

- Radial Basis Function

- ……

P81

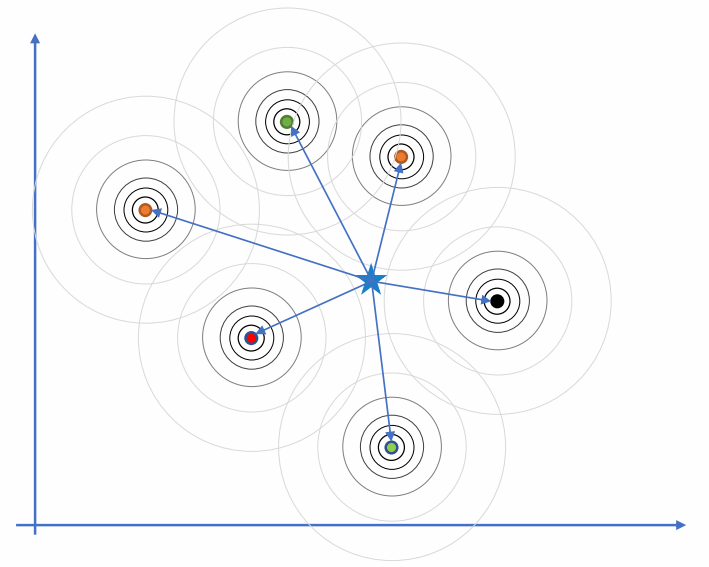

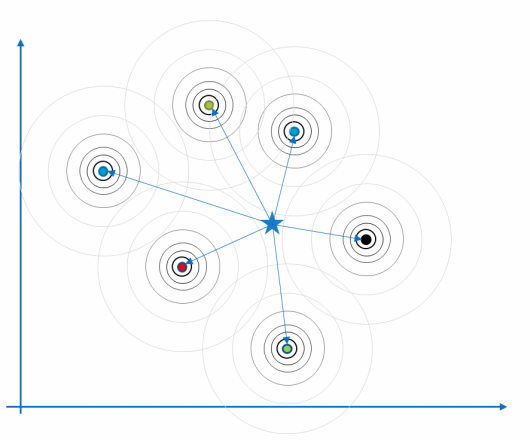

Radial Basis Function (RBF) Interpolation

$$ y=\sum_{i=1}^{k} w_i\varphi (||x-x_i||) $$

P83

Radial Basis Function (RBF) Interpolation

$$ y=\sum_{i=1}^{k} w_i\varphi (||x-x_i||) $$

How to compute \(w_i\) ? We need \(f(x_i)=y_i\)

$$

\begin{bmatrix}

R_{1,1} & R_{1,2} & \cdots & R_{1,K} \\

R_{2,1} & R_{2,2} & & \vdots \\

\vdots & & \ddots & \vdots \\

R_{K,1} & \cdots & \cdots & R_{K,K}

\end{bmatrix} \begin{bmatrix}

w_1\\

w_2 \\

\vdots\\

w_K

\end{bmatrix}=\begin{bmatrix}

y_1\\

y_2 \\

\vdots\\

y_K

\end{bmatrix}

$$

$$ R_{i,j}=\varphi (||x_i-x_j||) $$

P84

Radial Basis Function (RBF)

$$ y=\sum_{i=1}^{k} w_i\varphi (||x-x_i||) $$

- Gaussian:

$$ \varphi (r)=e^{-(r/c)^2} $$

- Inverse multiquadric:

$$ \varphi (r)=\frac{1}{\sqrt{r^2+c^2} } $$

- Thin plate spline:

$$

\varphi (r)=r^2 \log r

$$

- Polyharmonic splines:

$$

\varphi (r)=\begin{cases}

r^k,k=2n+1\\

\\

r^k \log r,k=2n

\end{cases}

$$

P85

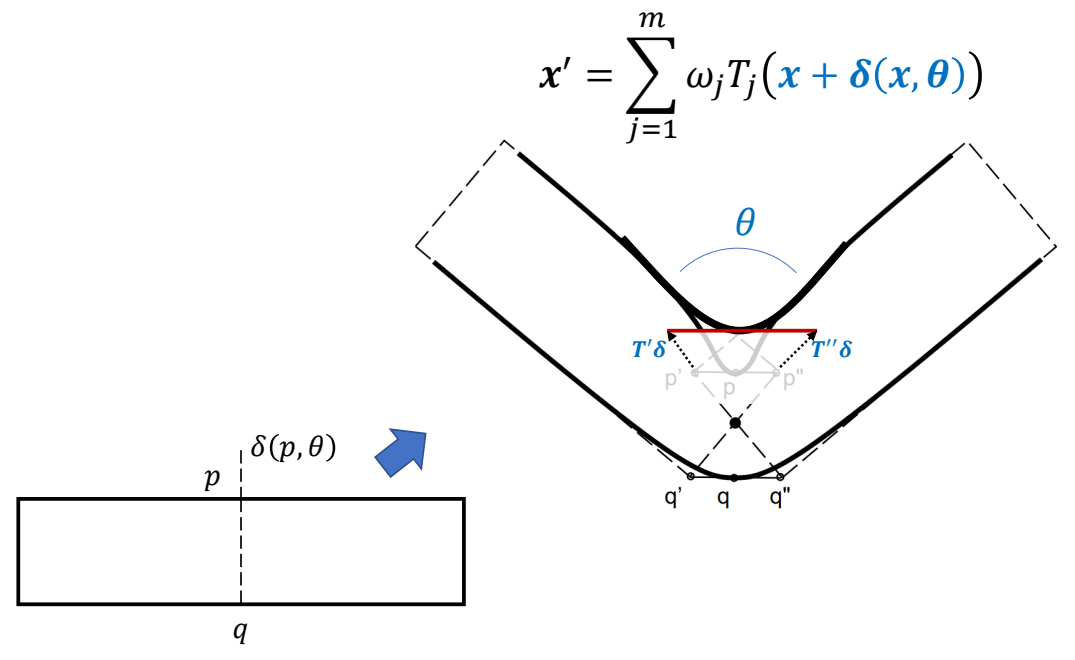

Pose Space Deformation

$$ {x}' =\sum_{j=1}^{m} w_iT_j (x+\delta (x,\theta )) $$

- \({x}'= SKIN(PSD(x))\)

- 𝑃𝑆𝐷 is implemented as RBF interpolation

- Example shapes can be created manually

- Or by 3D scanning real people → the SMPL model

J. P. Lewis, Matt Cordner, and Nickson Fong. 2000. Pose space deformation: a unified approach to shape

interpolation and skeleton-driven deformation. In Proceedings of the 27th annual conference on Computer

graphics and interactive techniques (SIGGRAPH ’00), ACM Press/Addison-Wesley Publishing Co., USA, 165–172.

P86

Pose Space Deformation

P87

Issues

- Per-shape or per-vertex interpolation

- Should we interpolate a shape as a whole?

- Local or global interpolation?

- Should a vertex be affected by all joints?

- Interpolation algorithm?

- Is RBF the only choice?

SIGGRAPH Course 2014 — Skinning: Real-time Shape Deformation

P88

Example-based Skinning (EBS) vs. Skeleton Subspace Deformation (SSD)

\(^\ast \)EBS: PSD

\(\quad\)

- Good: Easy to control

- Good: Good quality

- Good: Pose-dependent details (e.g. bulging muscle and extruding veins)

\(\quad\)

- Bad: Creating examples can be cumbersome

- Bad: Extra storage for examples

- Bad: Interpolation needs careful tuning

\(\quad\)

\(^\ast \)SSD: LBS, DQS, etc.

\(\quad\)

- Good: Easy to implement

- Good: Fast and GPU friendly

\(\quad\)

- Bad: Various artifacts

- Bad: Skinning weights needs careful tuning

- Bad: Hard to create pose-dependent details

P89

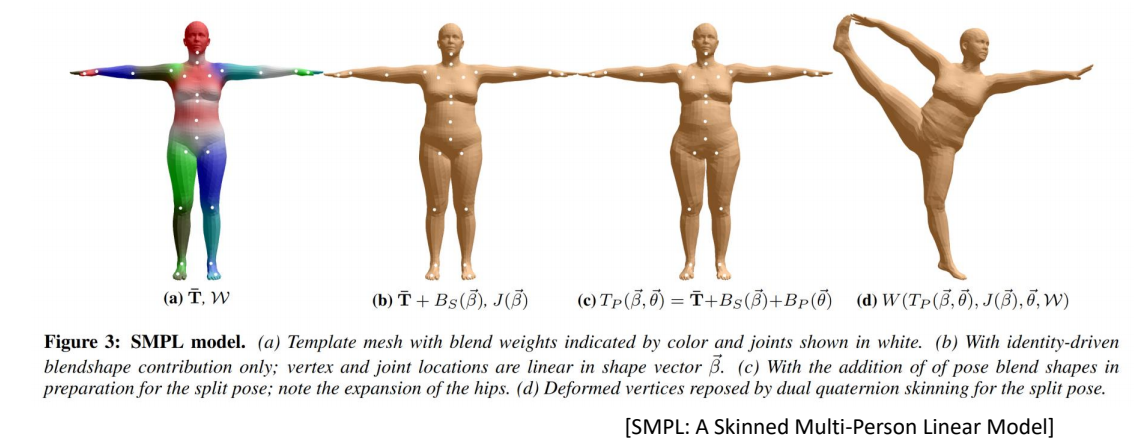

Example: SMPL Model

- A widely adopted human model in ML/CV

- Learned on real scan data

- Combines SSD and EBS techniques

P92

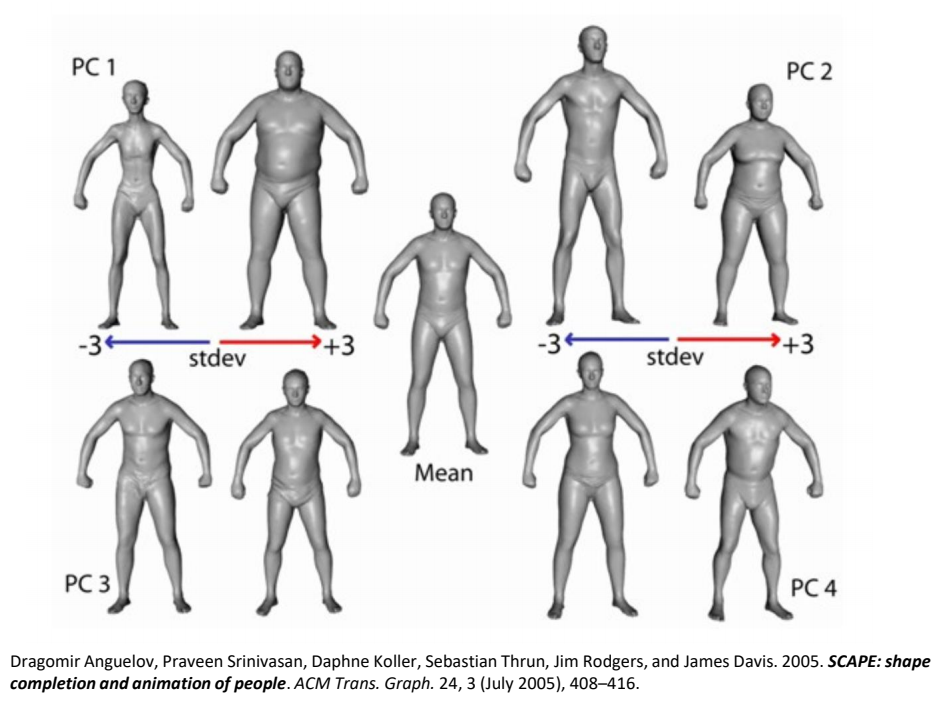

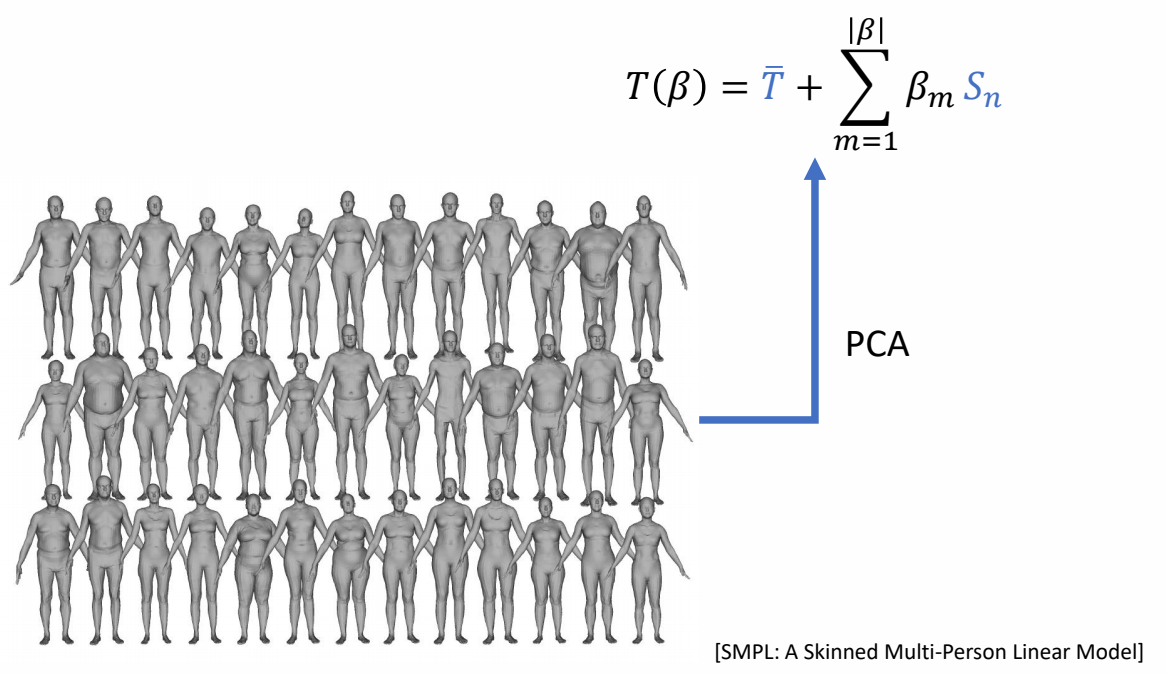

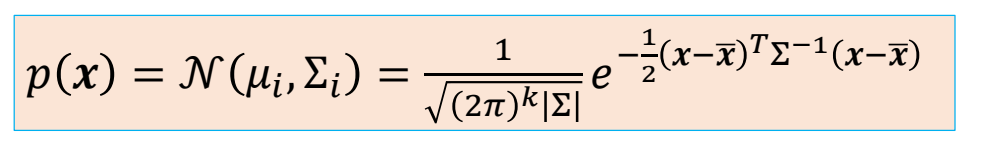

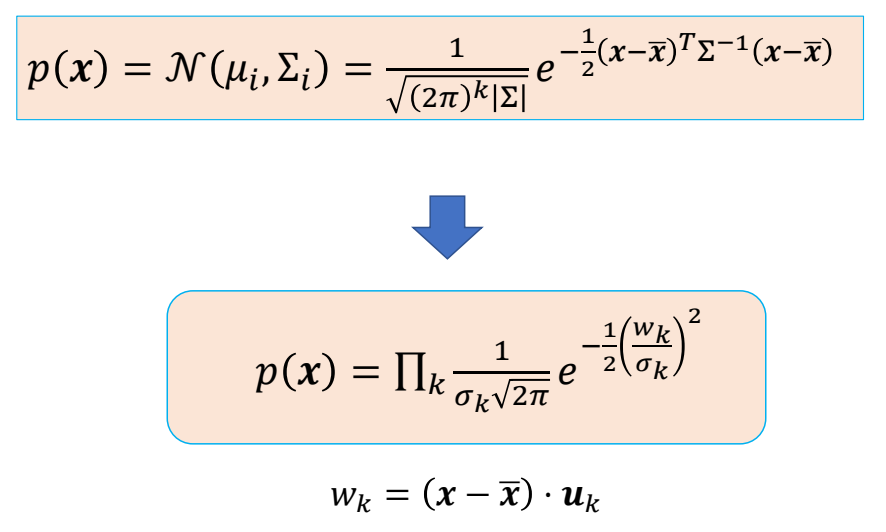

Recall: Principal Component Analysis (PCA)

- Given a dataset {\(x_i\)}, \(x_i \in \mathbb{R} ^N\), then PCA gives

$$ x_i=\bar{x}+\sum_{k=1}^{n} w_{i,k}u_k $$

- \(u_k\) is the \(k\)-th principal component

- A direction in \( \mathbb{R} ^N\) along which the rojection of {\(x_i\)} has the \(k\)-th maximal variance

- \(w_{i,k}=(x_i-\bar{x})\cdot u_k\) is the score of \(x_i\) on \(u_k\)

P93

Recall: Principal Component Analysis (PCA)

• Given a dataset {\(x_i\)}, \(x_i \in \mathbb{R} ^N\), the PCA can be computed by apply eigen decomposition on the covariance matrix

$$ \sum =X^TX=U\begin{bmatrix} \sigma ^2_1 & & & \\ & \sigma ^2_2 & & \\ & & \ddots & \\ & & \sigma ^2_N \end{bmatrix}U^T $$

-

\(X=[x_0-\bar{x}, x_1-\bar{x},\dots ,x_N-\bar{x}]^T\)

-

\(\sigma _i\ge \sigma _j\ge 0\) when \(i< j\), corresponds to the Explained Variance

-

\(U=[u_1,u_2,\dots,u_N]\)

P94

PCA over Body Shapes

P95

SMPL Model: Body Shape

P96

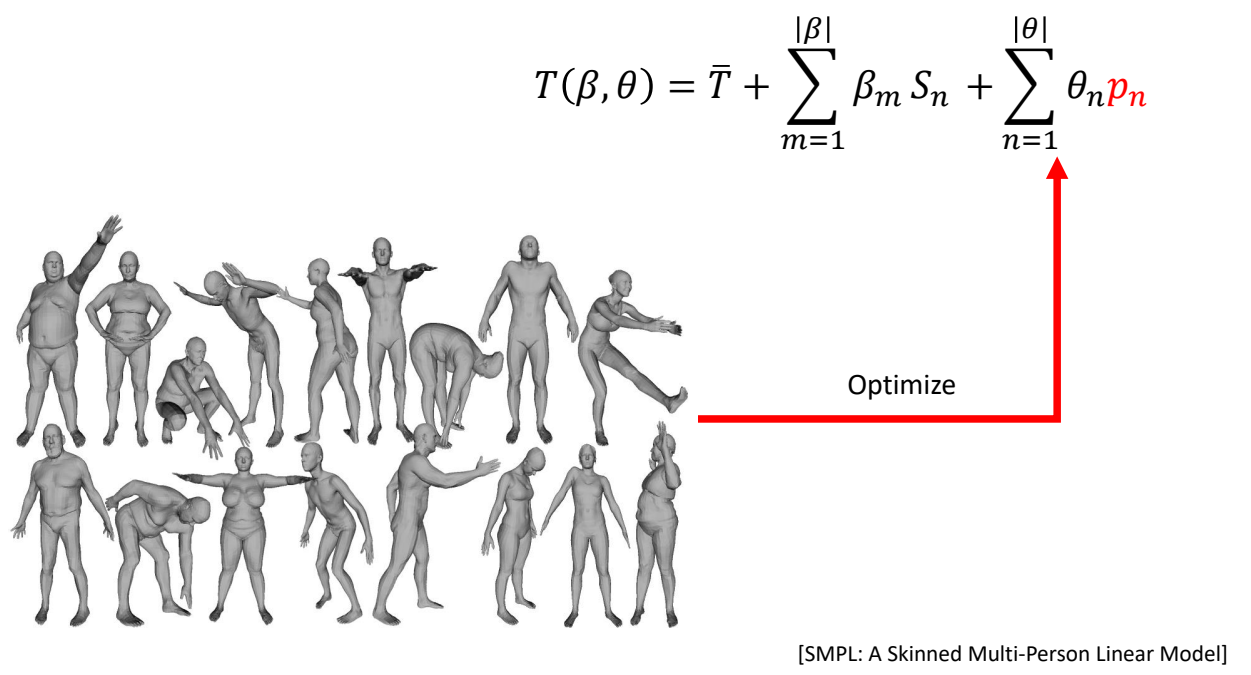

SMPL Model: Pose Blend Shapes

P97

SMPL Model: Deformation

$$ T(\beta ,\theta )=\bar{T} + \sum _ {m=1}^{|\beta |} \beta _ m S_ n + \sum _ {n=1}^{|\theta |}\theta _np_n $$

$$ x=SKIN(T(\beta ,\theta ),\theta ,w) $$

$$ SKIN:\text{LBS, DQS, etc}\dots $$

[SMPL: A Skinned Multi-Person Linear Model]

P99

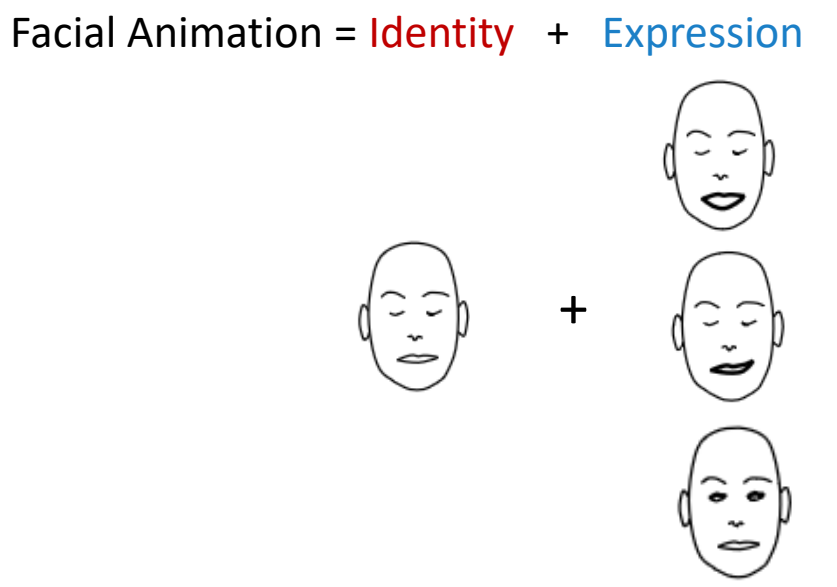

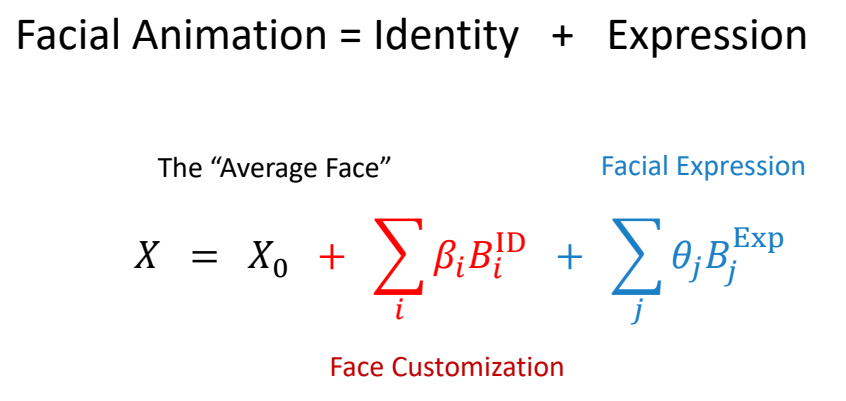

Facial Animation

P101

Facial Animation

✅ \(B_j\) 与 ID 无关,能做出差不多的效果。

✅ 要更精细的效果,可以定义与 ID 相关的 \(B_j\).

P102

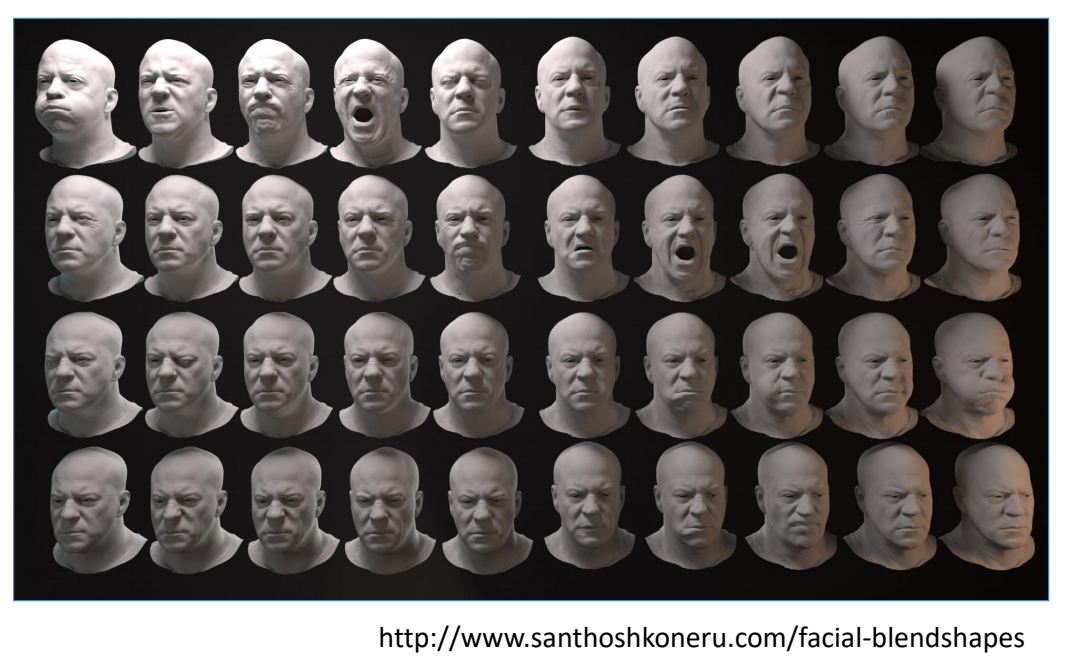

Facial Blendshapes

P103

A Typical Set of Blendshapes (ARKit)

P104

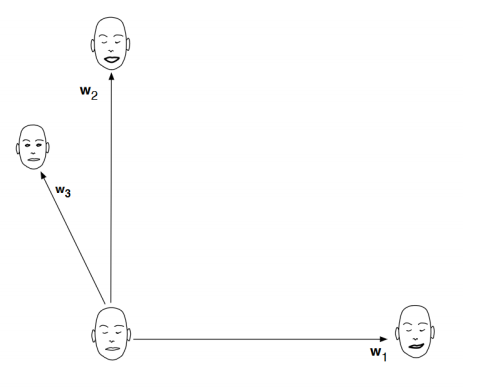

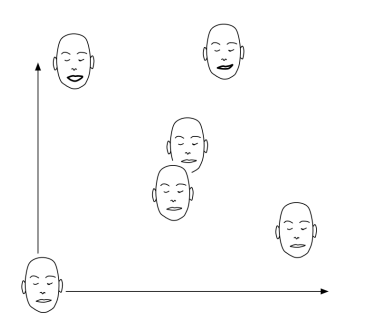

Blendshapes vs. Example-based Skinning

✅ 几种不同的表情基混合方式。

✅ 第二种,直接在几个脸之间做混合,适用于数据少的情况。

P105

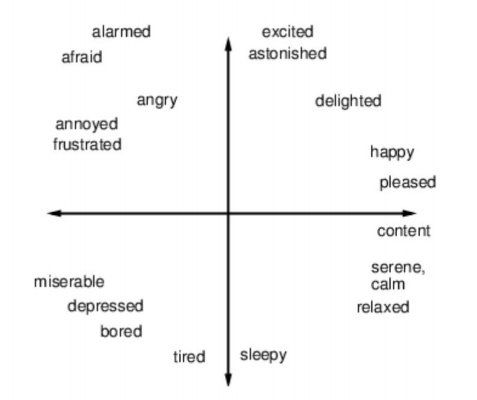

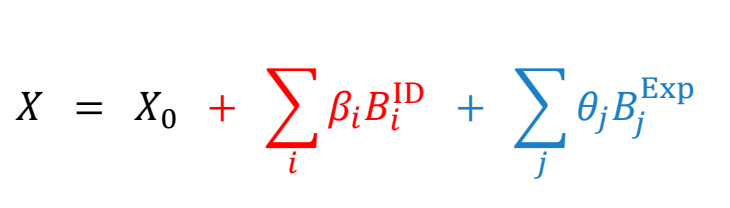

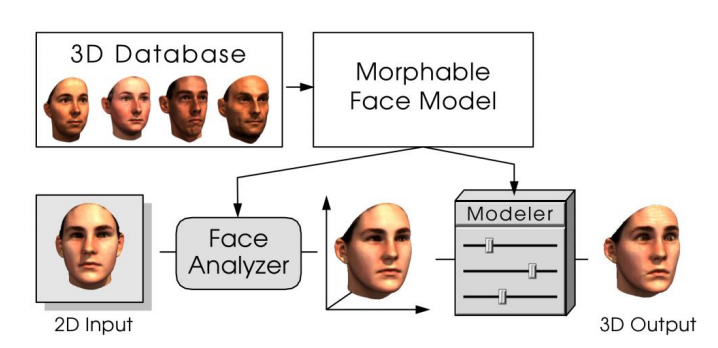

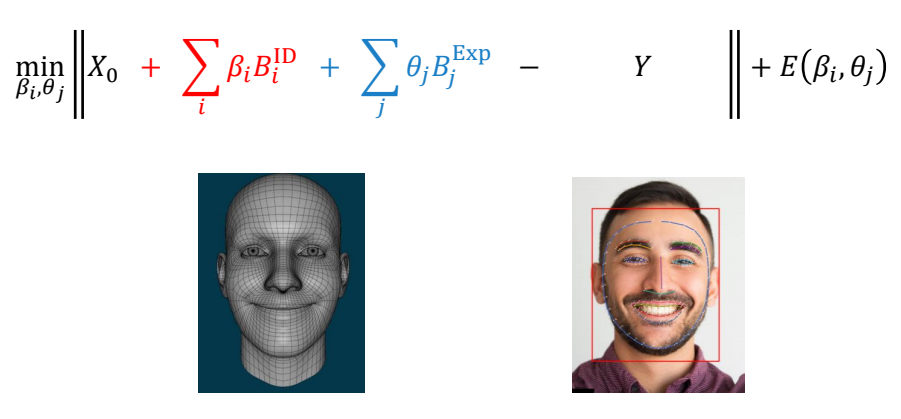

Morphable Face Models

Egger et al. 2020. 3D Morphable Face Models - Past, Present, and Future. ACM Trans. Graph. 39, 5 (June 2020), 157:1-157:38.

✅ 第一项:平均脸。第二项:PCA. 第三项:表情基。

✅ \(B_i^{ID}\) 通常由 PCA 得到。

✅ 基于脸部肌肉的物理仿真。

P107

How to Animate a Face?

P110

Face Tracking

✅ 用一个视频人脸驱动 3D 人脸。

✅ 人脸 \(\overset{①}{\rightarrow} \) 特征点 \(\overset{②}{\rightarrow} \) 表情参数

✅ 1、提取 \(\quad\) 2、IK.

ReadPapers 蒙皮绑定相关论文索引

以下论文收录于 ReadPapers 项目,按核心程度分组。

核心蒙皮 / 绑定论文

| 论文 ID | 论文标题 | 发表 | 蒙皮方法 | 一句话总结 |

|---|---|---|---|---|

| 235 | Smooth Skinning Decomposition with Rigid Bones (SSDR) | SIGGRAPH Asia 2012 | LBS 逆问题 | 从示例姿态反推 LBS 权重和刚性骨骼变换,所有约束作为硬约束严格满足,块坐标下降 + 闭式 SVD 求解,比 LM 快 50-70× |

| 236 | Robust and Accurate Skeletal Rigging from Mesh Sequences | SIGGRAPH 2014 | 全自动绑定 | 从网格序列自动生成骨骼系统:运动驱动聚类 → MST 拓扑重建 → 迭代绑定(权重/关节/变换交替优化)+ 骨骼剪枝 |

基于 LBS 扩展的新表示方法

| 论文 ID | 论文标题 | 发表 | 蒙皮方法 | 一句话总结 |

|---|---|---|---|---|

| 220 | GaussiAnimate: Reconstruct and Rig Animatable Categories with Level of Dynamics | arXiv 2026 | Skelebones (骨架-骨骼脚手架) + PartMM | 从 235/236 取 LBG-VQ 聚类 + SSDR 生成外层 Bones,原创 MCS 骨架化 + 关节检测生成内层 Skeleton,PartMM 非参数化运动匹配解决骨架→骨骼绑定 |

| 234 | SC-GS: Sparse-Controlled Gaussian Splatting for Editable Dynamic Scenes | CVPR 2024 | LBS + 稀疏控制点 | 用 ~512 个稀疏控制点的 6DoF 变换 + LBS 权重插值驱动 ~10 万高斯点,ARAP 正则化保证局部刚性 |

| 225 | TaoAvatar: Real-Time Lifelike Full-Body Talking Avatars for AR via 3DGS | 2025 | SMPL-X++ LBS + 教师-学生蒸馏 | 构建穿衣参数化模板 SMPL-X++,StyleUnet 教师网络学习非刚性变形,蒸馏到轻量 MLP 实现实时 LBS 驱动 |

| 36 | GaussianAvatar: Towards Realistic Human Avatar Modeling from a Single Video | 2023 | SMPL LBS + 3DGS | 以 SMPL 为 template,每个 Mesh 顶点对应一个高斯球,直接复用 SMPL 的 LBS 蒙皮权重驱动 3D 高斯 |

动物/人脸绑定

| 论文 ID | 论文标题 | 发表 | 蒙皮方法 | 一句话总结 |

|---|---|---|---|---|

| 35 | MagicPony: Learning Articulated 3D Animals in the Wild | 2023 | LBS + DMTet 网格 | 单图重建铰接 3D 动物,隐式神经场转显式网格,用 LBS 驱动动物姿态 |

| 32 | Artemis: Articulated Neural Pets with Appearance and Motion Synthesis | 2023 | 体素级 LBS + NGI | CGI 动物资产的体素绑定与蒙皮,复用 CGI 骨骼和蒙皮权重,LBS 驱动八叉树体素形变 + 神经渲染 |

| 95 | SOAP: Style-Omniscient Animatable Portraits | 2024 | 自适应网格重构 + 骨骼插值 | 从单张肖像生成风格化虚拟形象,通过可微分渲染实现网格重拓扑和骨骼绑定,蒙皮权重由邻接边插值 |

说明:论文 ID 对应 ReadPapers 项目中的编号,点击可跳转至完整笔记。其中 235 (SSDR) 和 236 (Rigging) 是本节内容的直接延伸阅读;220 (GaussiAnimate) 展示了经典 LBS/DQS 思想在 3DGS 新表示中的延续。

本文出自CaterpillarStudyGroup,转载请注明出处。

https://caterpillarstudygroup.github.io/GAMES105_mdbook/

P3

Outline

-

Character Kinematics

- Skeleton and forward Kinematics

-

Inverse Kinematics

- IK as a optimization problem

- Optimization approaches

- Cyclic Coordinate Descent (CCD)

- Jacobian and gradient descent method

- Jacobian inverse method

P4

Character Kinematics

the study of the motion of bodies without reference to mass or force

P8

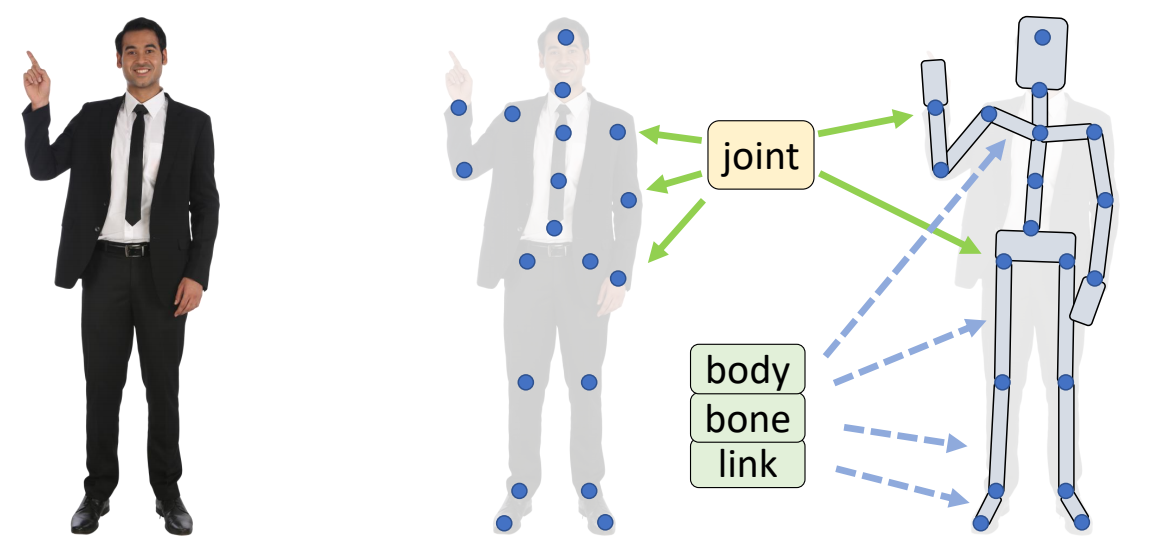

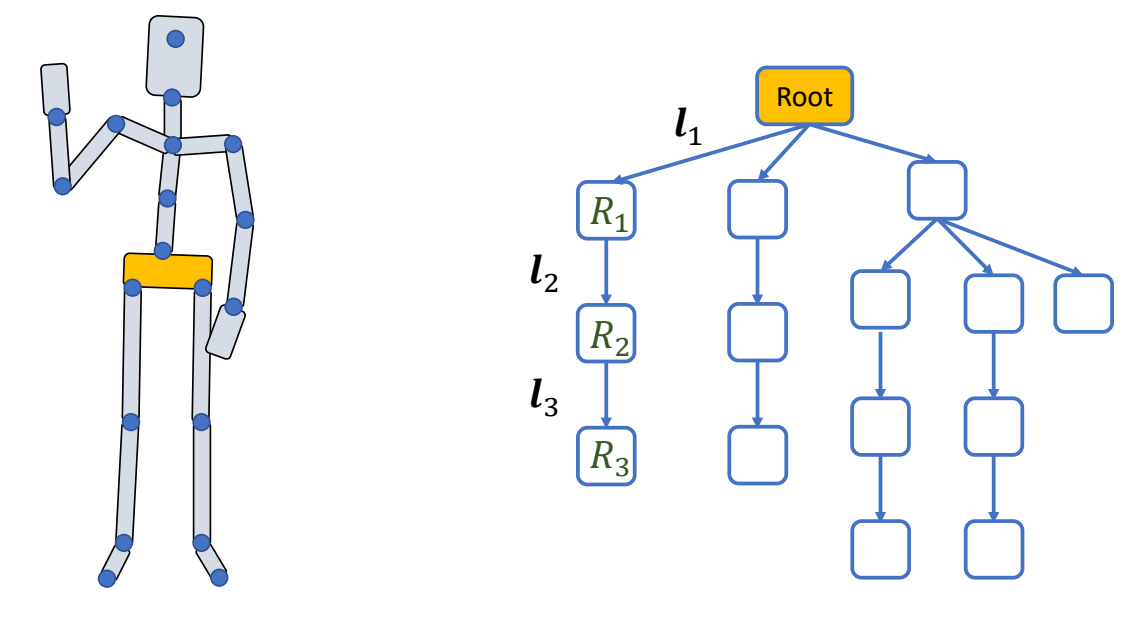

joint, bone, skeleton

✅ 关注关节的位置和旋转

P13

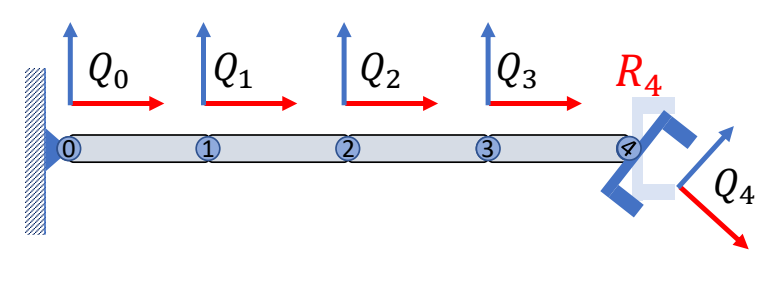

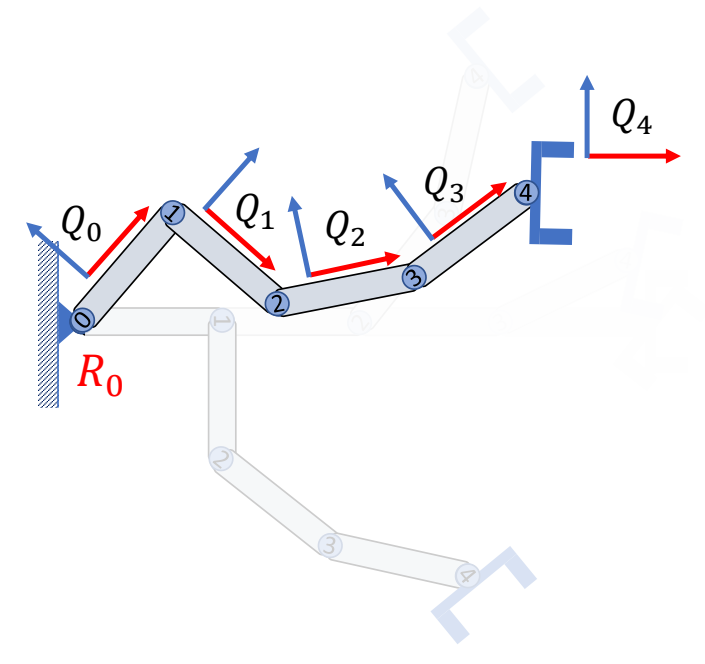

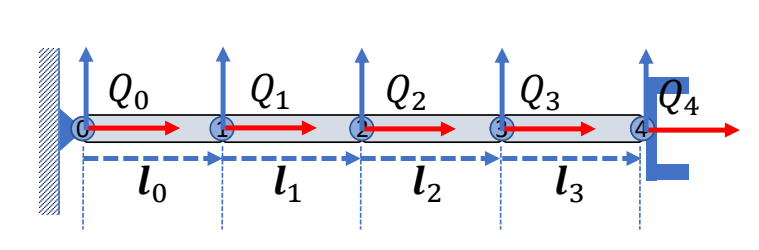

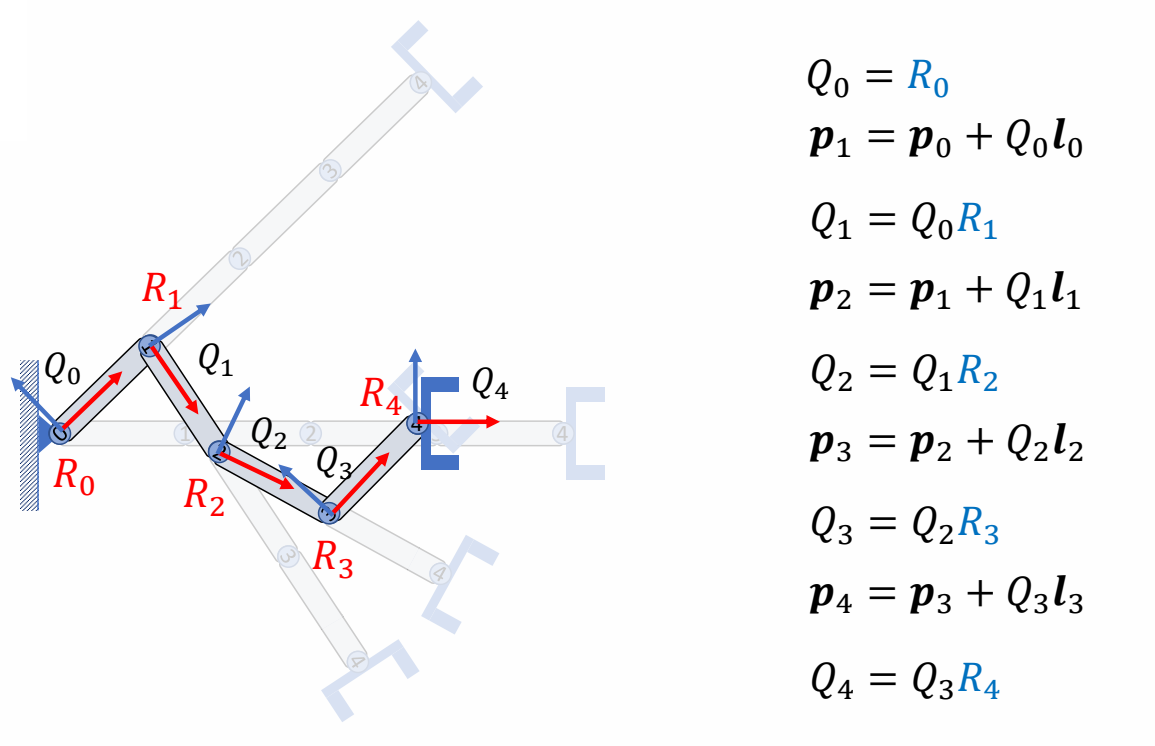

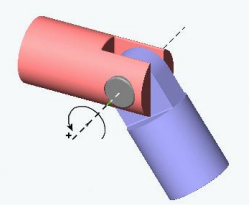

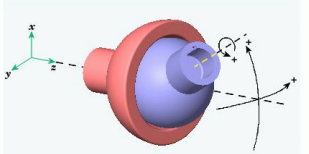

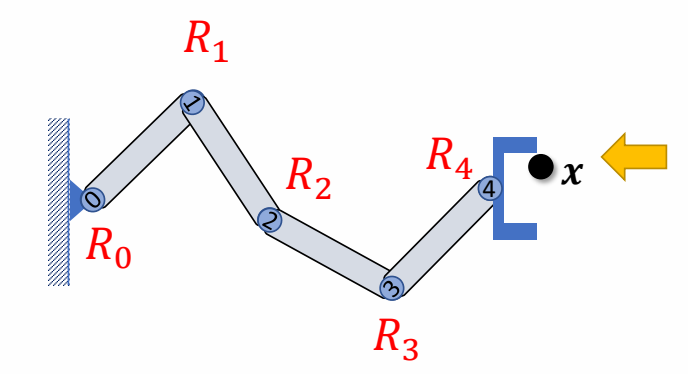

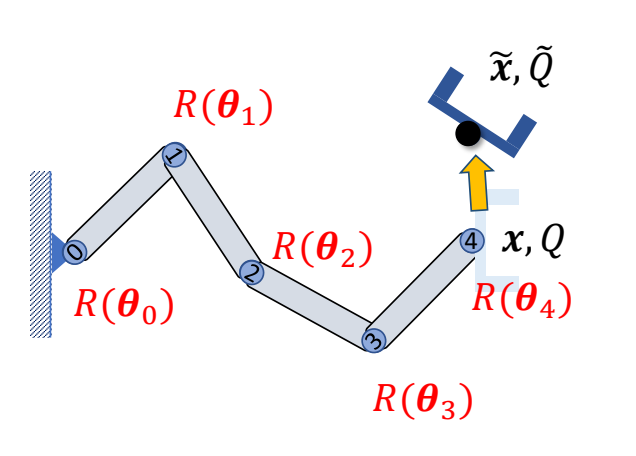

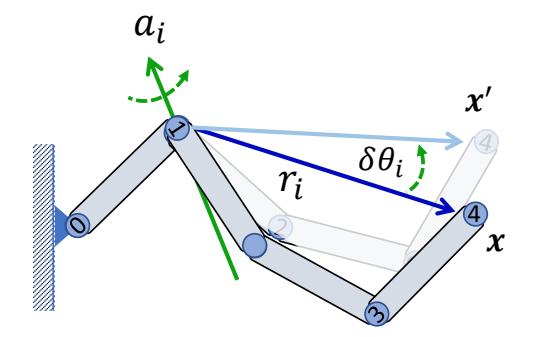

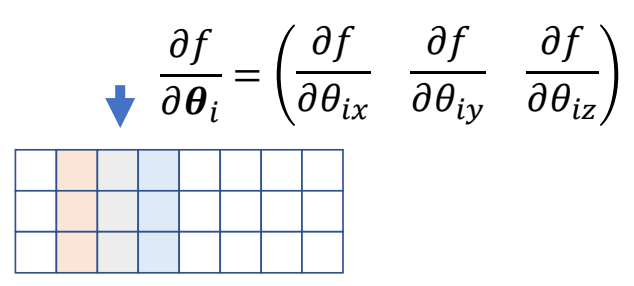

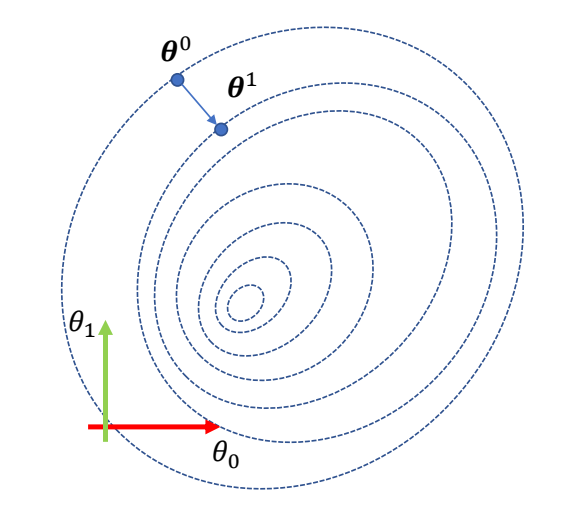

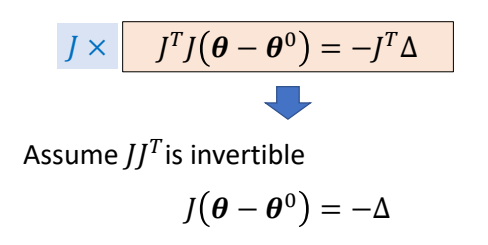

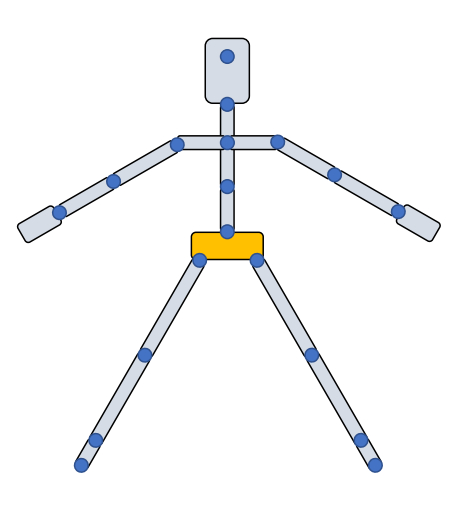

Kinematics of a Chain

问题描述

要使手臂摆成指定的动作,每个关节在各自坐标系下的旋转是多少?

求\(Q_0, Q_1, Q_2, Q_3, Q_4\)

P14

初始pose

$$ Q_0=Q_1=Q_2=Q_3=Q_4=I $$

✅ 这一个定义了5个关节的手臂。在每个关节上绑上一个坐标系。

P15

旋转关节4

把关节4旋转R4以后

✅ \(Q\):在世界坐标系下的朝向

✅ \(R\):在局部坐标系下的旋转

$$

\begin{matrix}

Q_0=I\quad\\

Q_1=I\quad\\

Q_2=I\quad\\

Q_3=I\quad\\

Q_4={\color{Red}{R_4}}

\end{matrix}

$$

P16

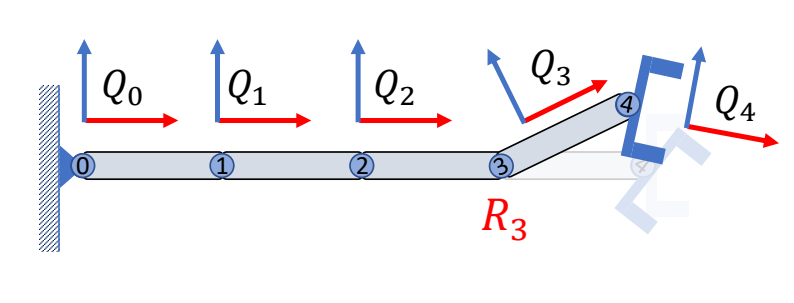

旋转关节3

把关节3旋转R3以后,Q3和Q4会同时受到影响

$$

\begin{matrix}

Q_0=I\quad\quad\\

Q_1=I\quad\quad\\

Q_2=I\quad\quad\\

Q_3={\color{Red}{R_3}}\quad\\

Q_4={\color{Red}{R_3}}R_4

\end{matrix}

$$

P17

依次旋转关节2, 1, 0

$$ \begin{matrix} Q_0={\color{Red}{R_0}}\quad \quad\quad\quad \\ Q_1={\color{Red}{R_0}}R_1 \quad\quad\quad \\ Q_3={\color{Red}{R_0}}R_1R_2R_3\quad \\ Q_4={\color{Red}{R_0}}R_1R_2R_3R_4 \end{matrix} $$

P20

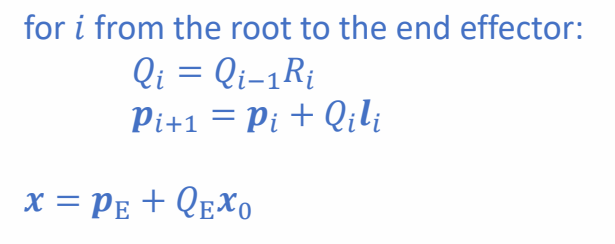

简化公式,用递推的形式描述

P21

From rotation(local) to orientation(global)

$$ Q_i = Q_{i-1}R_i $$

From orientation(global) to rotation(local)

$$ R_i = Q^T_{i-1}Q_i $$

✅ 这些 \(Q\) 都是全局旋转,\(R\) 是局部旋转。

Kinematics with position

P23

初始状态

✅ \( 𝒍 \):子关节位置在父坐标系下的坐标。

P31

positon with pose

✅ \(p\) 是全局位置,\( 𝒍 \) 是局部偏移。

P37

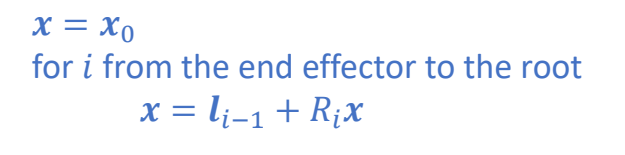

Forward Kinematics of a Chain: Summary

position

Given the rotations of all joints \(R_i\), find the coordinates of \(x_0\) in the global frame \(x\):

✅ \(x_0\) 是 \(R_4\) 坐标系下的点,求它在某个父坐标系下的位置。

✅ \(p\):关节在全局坐标系下的位置

✅ 第1步:根据 \(R_i\) 和 \( 𝒍 _i\) 求出 \(Q_i\) 和 \(P_i\)

✅ 第2步:\(E\) 可以是任意父结点,公式都适用

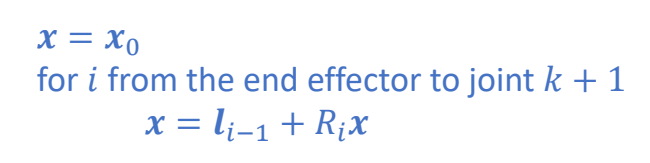

P38

✅ 是上一页的另一种写法,不需提前算出中间变量。

P39

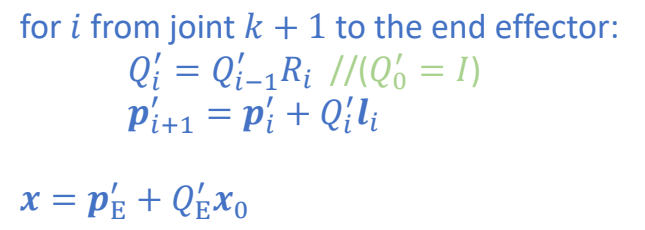

rotation

Given the rotations of all joints \(R_i\), find the coordinates of \(x_0\) relative to the local frame of \(Q_k\):

✅ 已知全局坐标系下的坐标,求 \(Q_k\) 下的坐标。

P40

✅ 对应上一页的另一种写法

P41

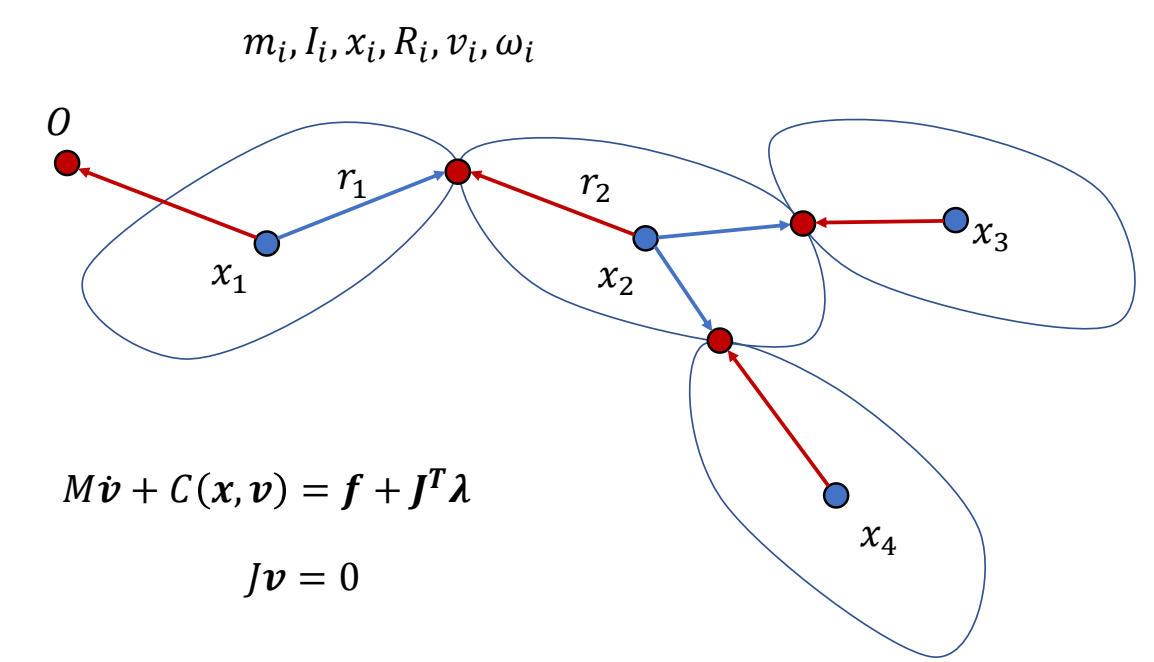

Kinematics of a Character

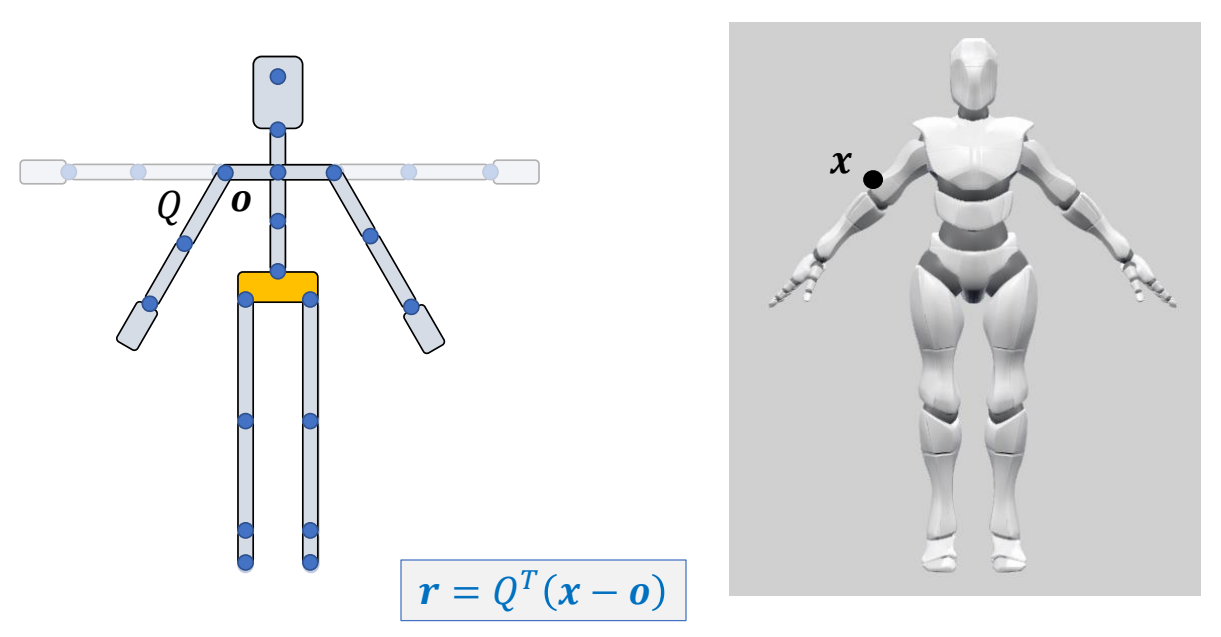

骨骼的参数化表示

✅ 把角色建模成多条关节链。

P43

✅ 以不同关节为 root,同样旋转会得到不同效果。

P45

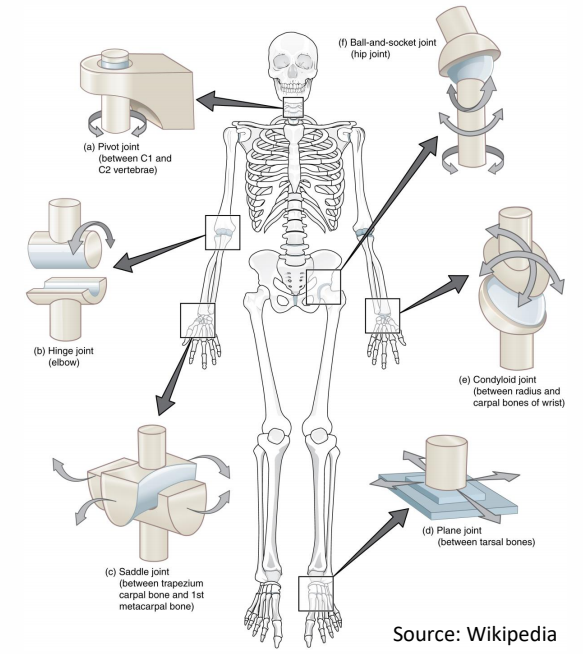

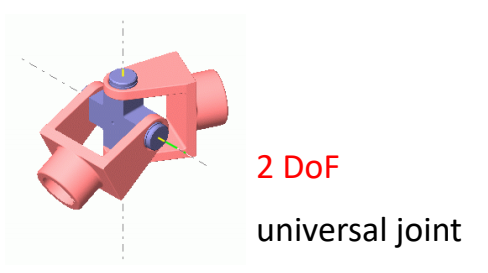

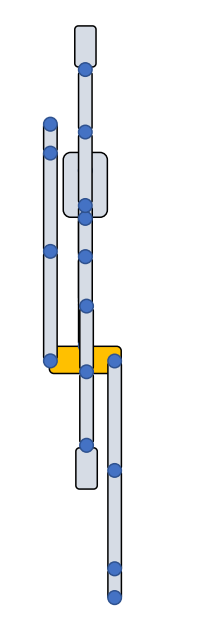

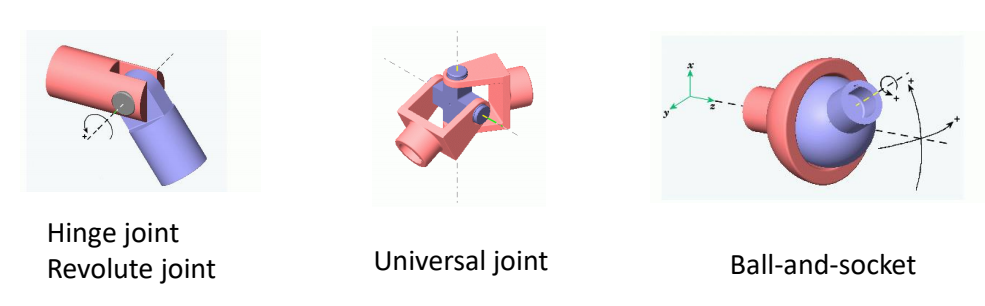

Types of Joints

P50

|  | knee, elbow \({\color{Red}{1 \text{DoF}}}\) \(\theta_{\min }\le \theta\le \theta_{\max } \) hinge joint revolute joint |

|  | hip, shoulder \({\color{Red}{3 \text{DoF}}}\) \(\theta_{\min }\preceq \theta \preceq \theta_{\max } \) ball-and-socket joint |

| 手腕。其实手腕不能自转。 2 Dof |

✅ 关节的自由度最多为3,因为不能自主移动。Hips 除外。 ✅ 自由度:一个物理系统,需要多少参数可以唯一准确地描述它的状态。

✅ 6 DOF=3 平移 + 3 旋转。

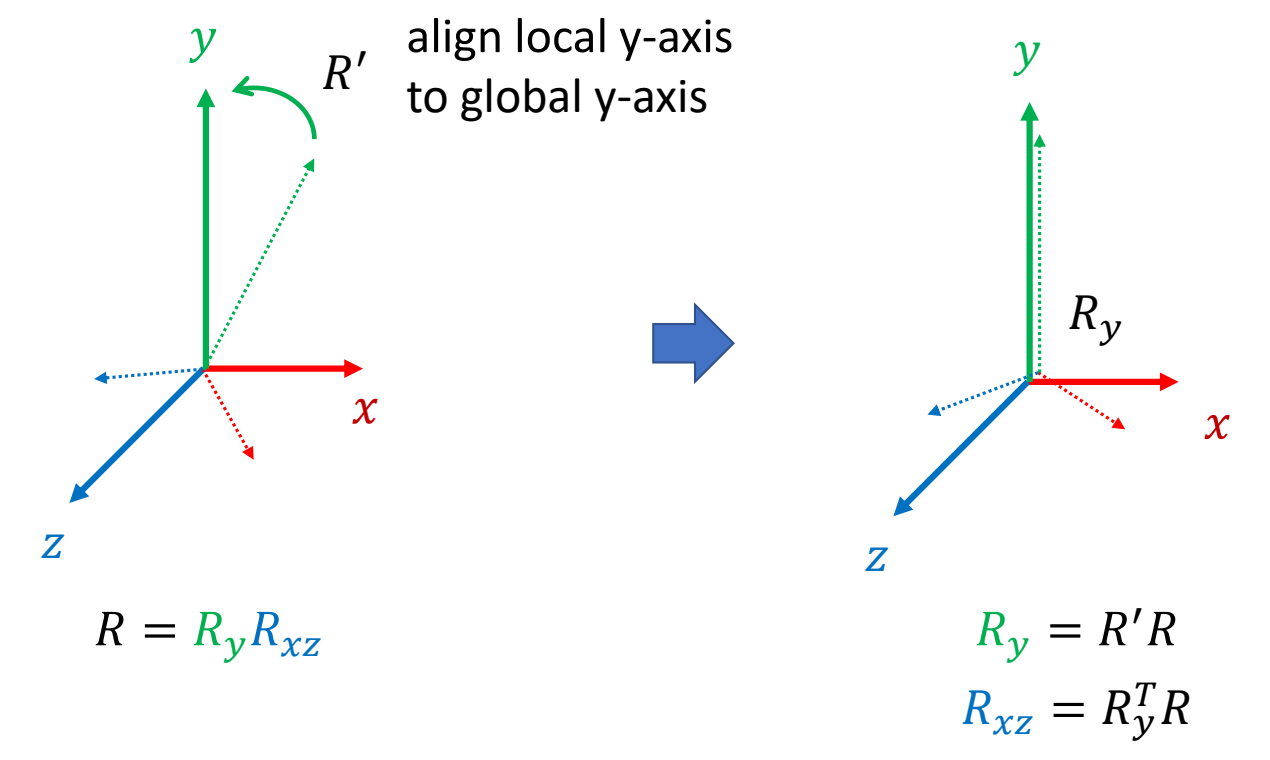

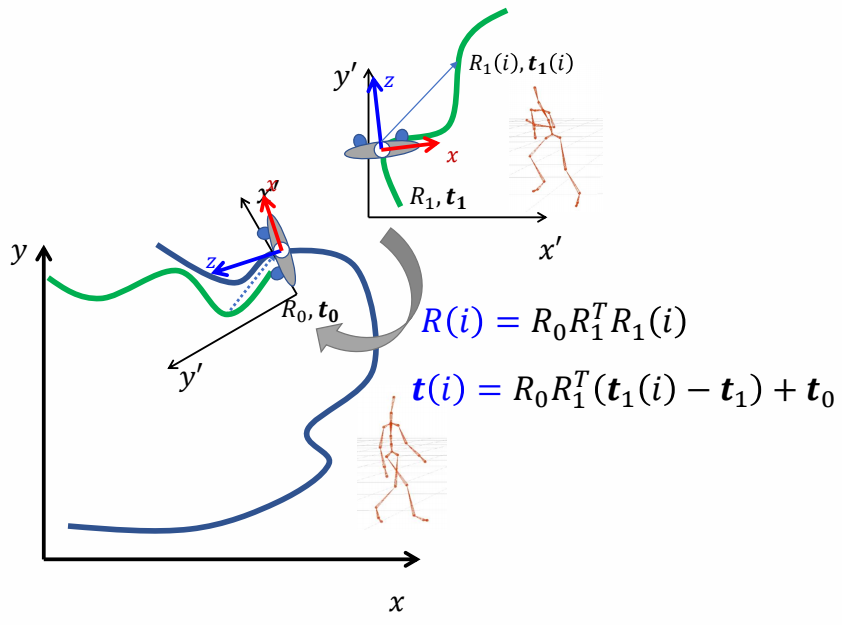

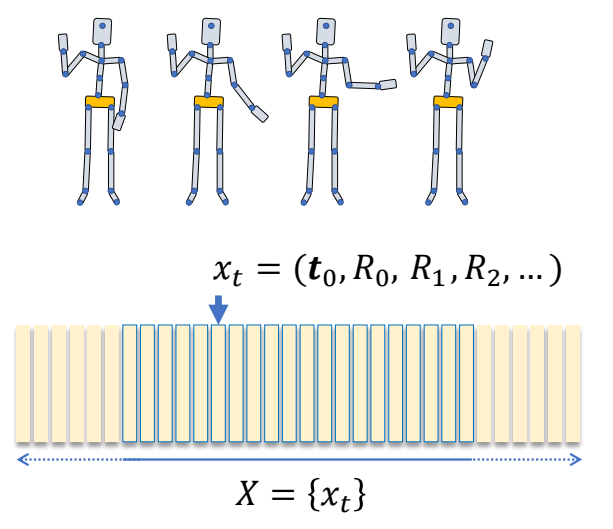

姿态的参数化表示 Pose Parameters

P55

$$ (t_0,R_0,R_1,R_2\dots \dots ) $$

$$ \text{root } \mid \text{ internal joints} $$

joints are typically in the order that every joint precedes its offspring

for \(i\) in joint_list:

$$ \begin{align*} p_i= & i^,\text{ s parent joint} \\ Q_i=& Q_{pi}R_i \\ x_i= & x_{pi} + Q_{pi}l_i \end{align*} $$

✅ 一个动作的参数化表示:

✅ 全局位置+root 朝向+各关节旋转

✅ 通常要求,关节顺序为父在前子在后,这样只须遍历一遍就能完成 FK.

❓ Q2: how should we allow stretchable bones?

✅ 答:增加参数,3 Dof 增加为 6 Dof.

P58

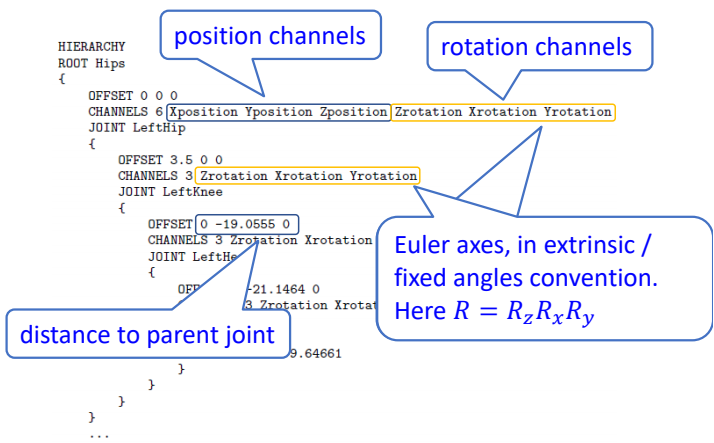

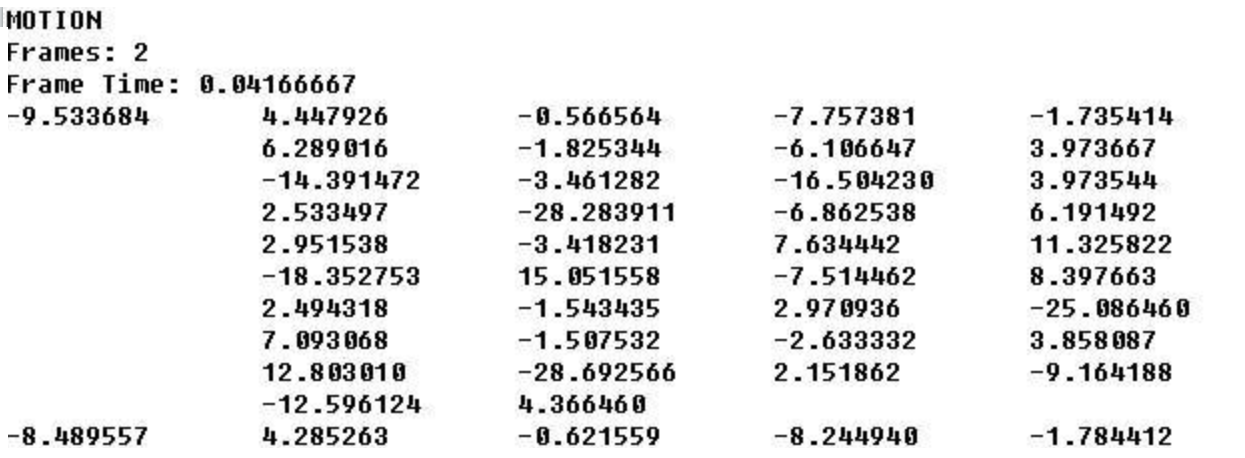

Example: motion data in a file

BVH files

- HIERARCHY: defining T-pose of the character

- MOTION: root position and Euler angles of each joints

See: https://research.cs.wisc.edu/graphics/Courses/cs-838-1999/Jeff/BVH.html

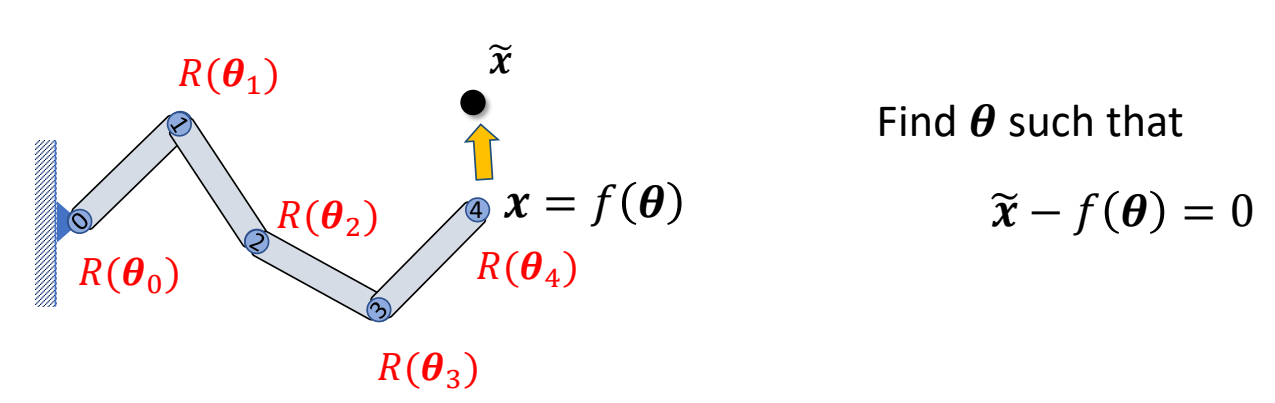

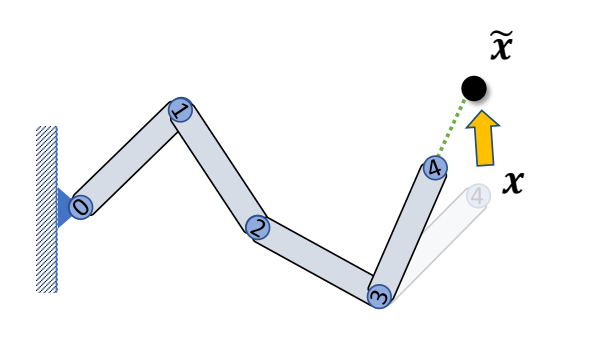

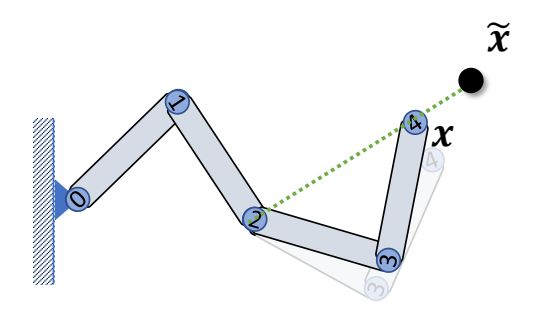

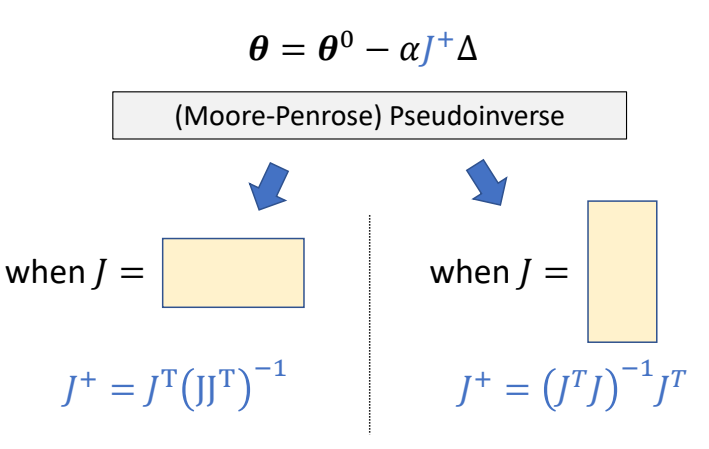

P59

Inverse Kinematics

🔎 A. Aristidou, J. Lasenby, Y. Chrysanthou, and A. Shamir. 2018.

Inverse Kinematics Techniques in Computer Graphics: A Survey.

Computer Graphics Forum

P61

Forward and Inverse Problems

For a system that can be described by a set of parameters \(\theta \), and a property 𝒙 of the system given by

$$ x=f(\theta ) $$

Forward problem:

-

Given \(\theta \), we need to compute \(x \)

-

Easy to compute since \(f\) is known, the result is unique

-

DoF of \( \theta \) is often much larger than that of \(x \). We cannot easily tune \(\theta \) to achieve a specific value of \(x\).

Inverse problem:

-

Given \(x \), we need to find a set of valid parameters \(\theta \) such that\(x=f(\theta) \)

-

Often need to solve a difficult nonlinear equation, which can have multiple solutions

-

\(x\) is typically meaningful and can be set in intuitive ways

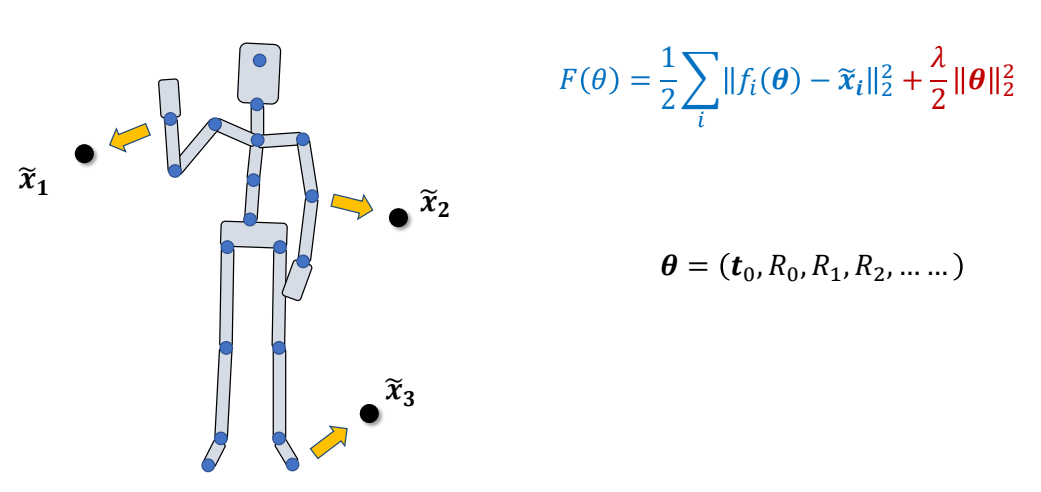

P62

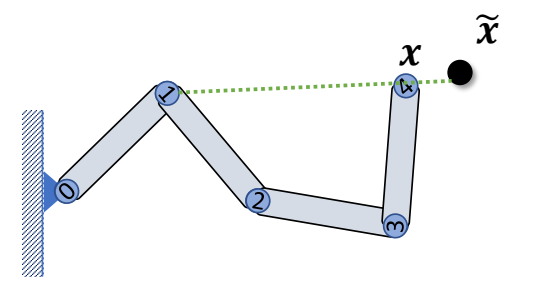

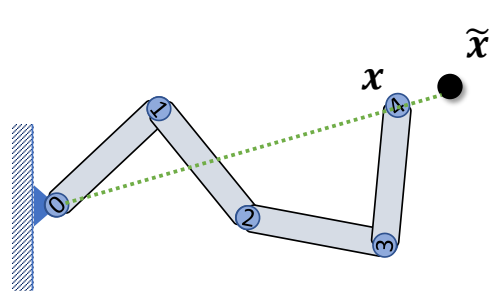

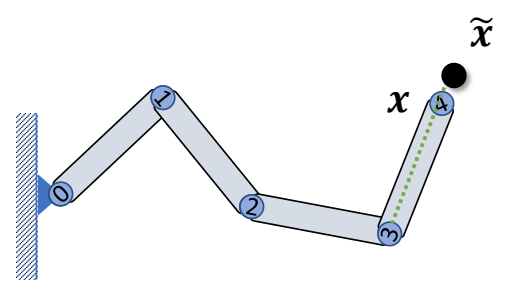

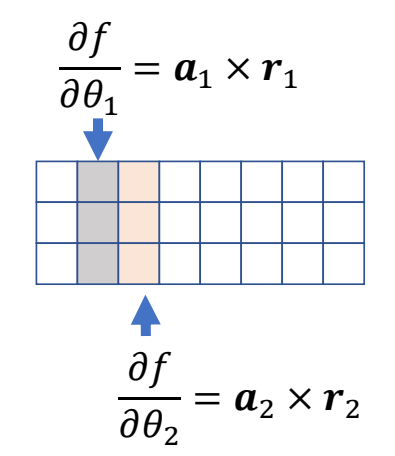

Inverse Kinematics问题描述

Given the position of the end-effector \(x\), Compute the joint rotations \(R_i\)

P64

✅ 大部分情况下IK问题是多解问题

P68

two-joint IK

Step 1: Rotate joint 1 such that

$$ ||l_{ox}||=||l_{02}|| $$

✅ 使用余弦公式

Step 2: Rotate joint 0 such that

$$ l_{ox}=l_{02} $$

✅ 叉乘得到旋轴,点乘得到旋转角。

Step 3: Rotate joint 0 around \(l_{ox}\) if necessary